RedHat6 多服务搭建

实验目的:

掌握多服务的理论和操作

实验理论:

在HA集群坏境中,可以运行多种服务,每运行一种服务都会有一个节点运行,另一个节点作为备份,比如Node1运行Httpd服务,Node2作为备份,Node3运行Vsftpd服务,Node4作为备份,Node5运行Nfs服务,Node6作为备份,如果这样做了,Node2、Node4、Node6没有事情做,不是浪费了这3个节点的资源摸,

为了合理的运用每一台服务器的资源,达到冗余的效果,我们可以这样组合Node1&Node2运行Httpd服务,Node2&Node3运行Vsftpd服务,Node3&Node4运行Nfs服务,这样只有Node4节点的资源被浪费了

我们也可以做到一台服务器的资源都不浪费,Node1&Node2&Node3都运行Httpd服务,优先级为1、2、3。Node1&Node2&Node3都运行vsftpd服务,优先级为3、1、2。Node1&Node2&Node3都运行Nfs服务,优先级为2、3、1

实验步骤:

我在有3个节点的集群坏境中运行Httpd、Vsftpd、Nfs三种服务

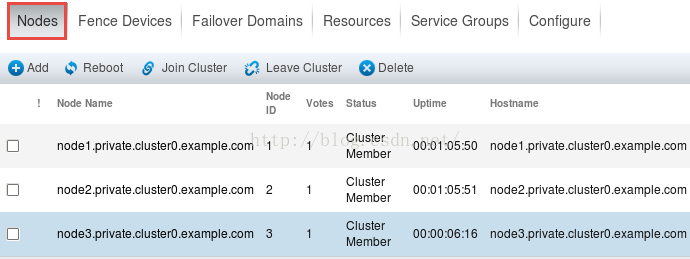

步骤一、节点加入集群

3个节点已经加入到了集群中

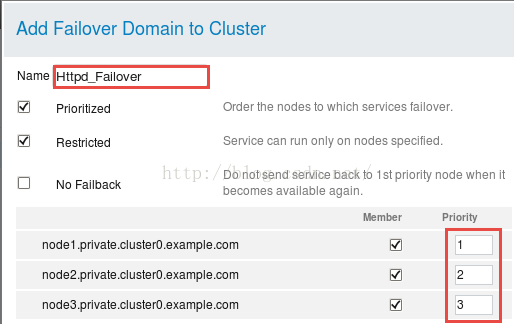

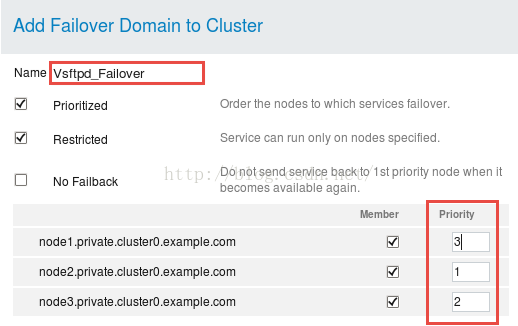

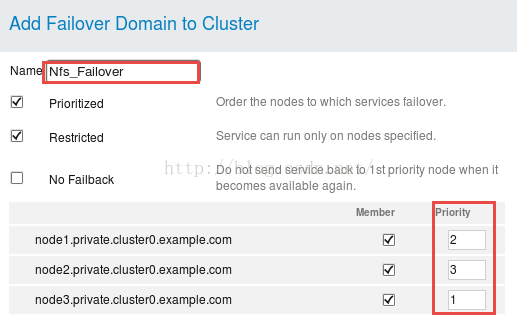

步骤二、添加失效率

Httpd服务的FailOver,Node1的优先级为1,Node2的优先级为2,Node3的优先级为3

Vsftpd服务的失效率,Node2的优先级为1,Node3的优先级为2,Node1的优先级为3

Nfs服务的失效率,Node3的优先级为1,Node1的优先级为2,Node2的优先级为3

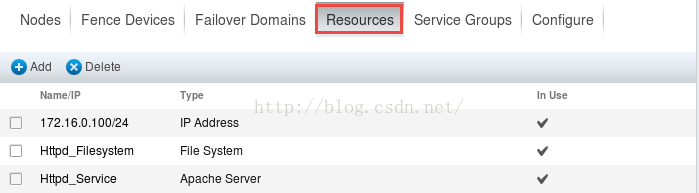

步骤三、添加资源Resources:

注意:各个节点的Selinux都要关掉

Httpd服务:

Httpd服务的三种资源添加,没什么可说的

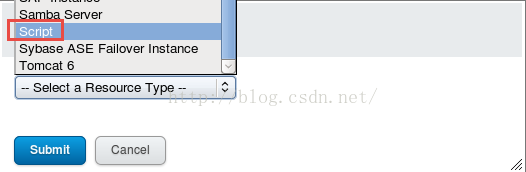

Vsftpd服务:

Vsftpd的IP Adress和FileSystem的添加没有什么好说的

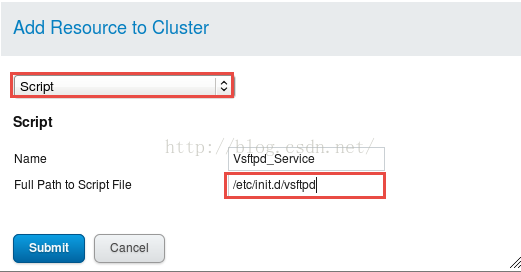

下面是Vsftpd的服务添加,在添加Resources时,有好多服务Resources里没有显示,那么你要添加就用脚本(script)方式添加,填写那个服务的启动脚本即可

/etc/init.d/vsftpd是vsftpd服务的启动脚本

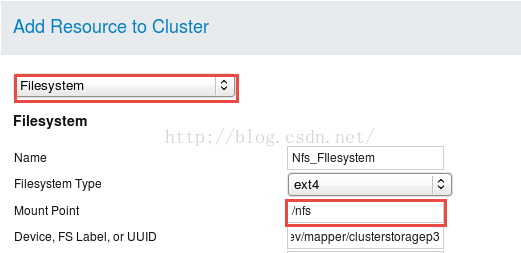

Nfs服务:

添加Nfs的IP Adress资源就不说了,添加Nfs服务的Filesystem要注意一下,每一个节点上都要创建/nfs目录,有一个节点上不创建那个挂载点/nfs目录,nfs服务是起不来的。

[root@node1 ~]# mkdir /nfs

[root@node2 ~]# mkdir /nfs

[root@node3 ~]# mkdir /nfs

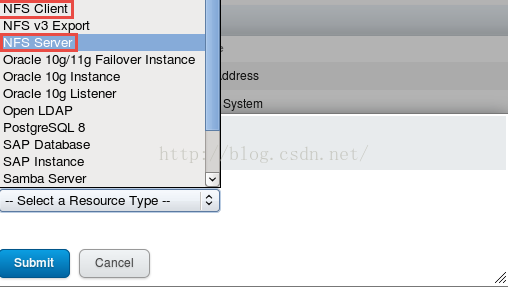

添加Nfs服务时和其它服务不同,它需要添加Nfs Server和Nfs Client两个加起来才算是Nfs完整的服务

Nfs_Server服务端的添加:

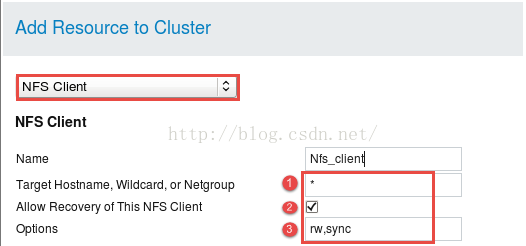

Nfs_Client客户端的添加:

1. 指定可以访问的客户端,这里用*,允许所有机器访问

2. 勾选,允许客户端

3. rw,sync给予客户端对共享资源的可读写权限和实时同步

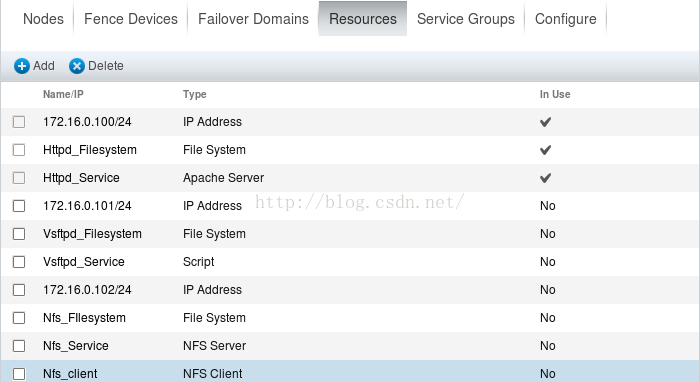

三种服务的所需的资源

步骤四、安装服务、创建分区

安装服务:

Httpd、vsftpd、Nfs服务都要安装,不过Httpd、Nfs服务Redhat6已经默认安装了,所以现在我只安装vsftpd服务了

[root@node1~]# yum -y install vsftpd

[root@node2 ~]# yum -y install vsftpd

[root@node3 ~]# yum -y install vsftpd

安装完服务,但是不启动服务

创建分区:

我现在有两个分区,/dev/mapper/clusterstoragep1分区被用作Httpd服务

/dev/mapper/clusterstoragep2分区被用作Vsftpd服务,都格式化成ext4格式。

[root@node2 ~]# fdisk -l

Disk /dev/mapper/clusterstorage: 2147 MB,2147483648 bytes

Device Boot Start End Blocks Id System

/dev/mapper/clusterstoragep1 1 14 112423+ 83 Linux

/dev/mapper/clusterstoragep2 15 28 112455 83 Linux

创建/dev/mapper/clusterstoragep3分区供Nfs服务使用

[root@node1 ~]# fdisk /dev/mapper/clusterstorage

Command (m for help): n

Command action

e extended

p primary partition (1-4)

p

Partition number (1-4): 3

First cylinder (29-261, default 29):

Using default value 29

Last cylinder, +cylinders or +size{K,M,G}(29-261, default 261): +100M

Command (m for help): w

[root@node1 ~]# partprobe /dev/mapper/clusterstoragep3

[root@node1 ~]# mkfs.ext4 /dev/mapper/clusterstoragep3

Node1上创建了/dev/mapper/clusterstoragep3分区,不仅Node1要partprobe,Node2和Node3也要partprobe

[root@node2 ~]# partprobe /dev/mapper/clusterstoragep3

[root@node3 ~]# partprobe /dev/mapper/clusterstorage

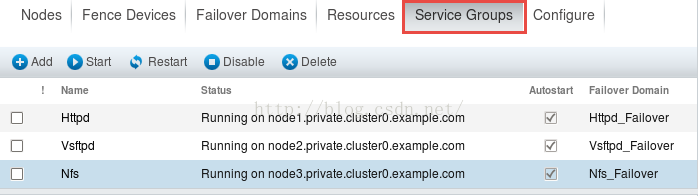

步骤五:创建服务组

Httpd、Vsftpd服务怎么创建服务组我就不多说了。

创建Nfs服务组的时候,点击【Add Resource】按钮,添加Nfs的IP Address资源,在点击【Add Resource】按钮,添加Nfs的Filesystem资源,点击Filesystem资源下的【Add achild Resource】按钮,添加Nfs_Service资源时,点击Nfs_client资源下的【Add a child Resource】按钮,添加Nfs_Client资源

集群服务启动成功后,发现/dev/mapper/clusterstoragep1自动挂载了/var/www/html上。

/dev/mapper/clusterstoragep2自动挂载了/var/ftp/pub上。

/dev/mapper/clusterstoragep3自动挂载了/var/nfs上.

Httpd服务运行在Node1上,Vsftpd服务运行在Node2上,Nfs服务运行在Node3上

这实时暂时挂载,要想永久挂载,需要把挂载信息写到/etc/fstab里面

[root@node1 ~]# df -h

Filesystem Size Used Avail Use% Mounted on

/dev/mapper/clusterstoragep1

107M 5.6M 96M 6% /var/www/html

[root@node2 ~]# df -h

Filesystem Size Used Avail Use% Mounted on

/dev/mapper/clusterstoragep2

107M 5.6M 96M 6% /var/ftp/pub

[root@node3 ~]# df -h

Filesystem Size Used Avail Use% Mounted on

/dev/mapper/clusterstoragep3

107M 5.6M 96M 6% /nfs

1556

1556

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?