iOS开发——Swift & Xcode

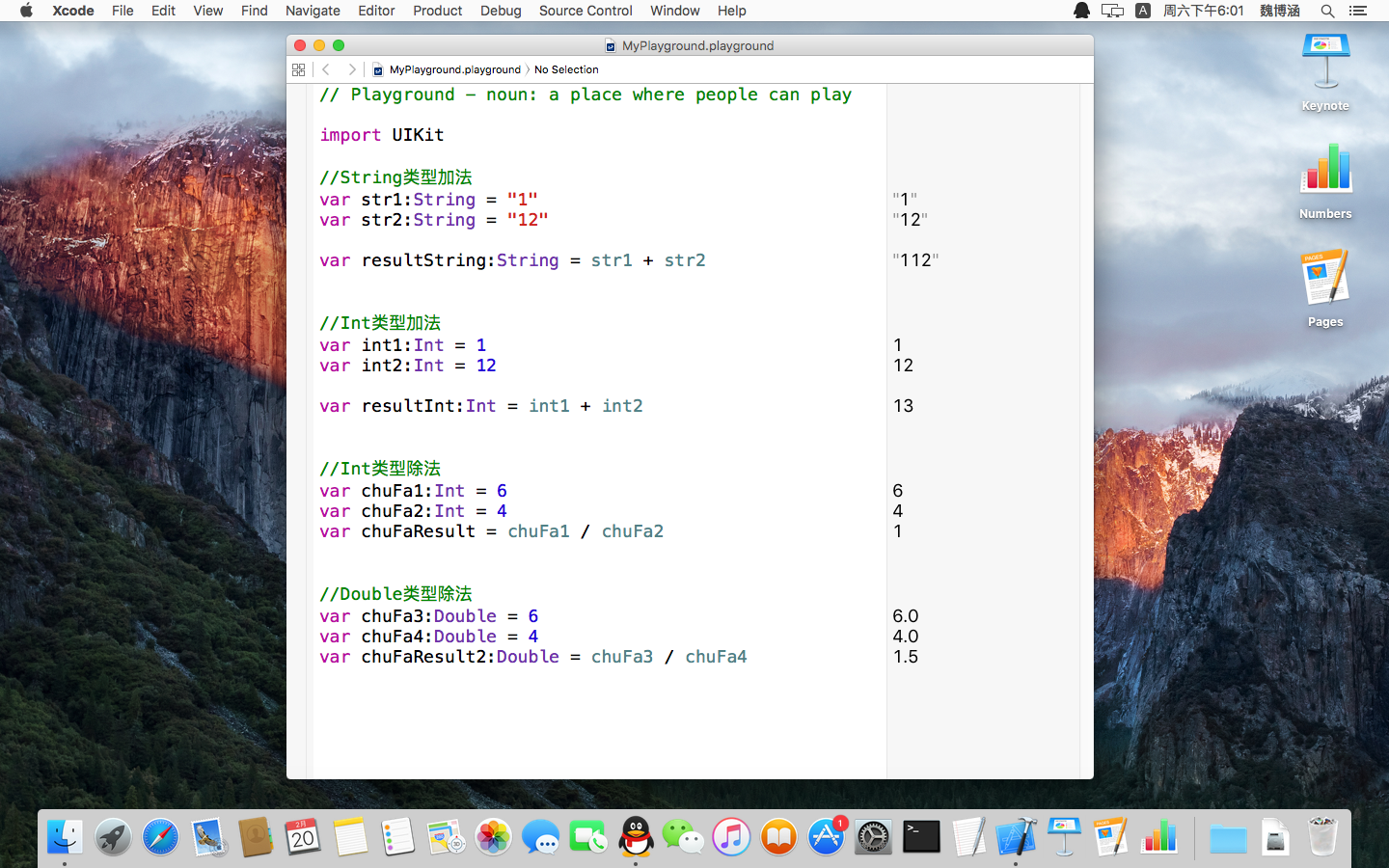

*- 上一节中,我们讨论了一个有趣的问题:“1”+“1”=?

但出乎意料的是,结果是11。

那么这是什么软件,用了什么神奇的代码,能让1+1=11?*

首先,让我们来了解可以适用于多种语言的强大的开发环境——xcode

![]()

Xcode 是运行在操作系统Mac OS X上的集成开发工具(IDE),由苹果公司开发。Xcode是开发OS X 和 iOS 应用程序的最快捷的方式。Xcode 具有统一的用户界面设计,编码、测试、调试都在一个简单的窗口内完成。

——百度百科

通过百度百科的介绍可以看出,我们可以用它进行写代码,不过怎么写呢?那些奇奇怪怪的代码代表什么?

这样,我们需要一门编程语言,按照语法编出我们想要的程序

那么就要看看swift

Swift,苹果于2014年WWDC(苹果开发者大会)发布的新开发语言,可与Objective-C*共同运行于Mac OS和iOS平台,用于搭建基于苹果平台的应用程序。

Swift是一款易学易用的编程语言,而且它还是第一套具有与脚本语言同样的表现力和趣味性的系统编程语言。Swift的设计以安全为出发点,以避免各种常见的编程错误类别。

——百度百科

由此看来,swift是一门很简单的编程语言,那么,我们共同学习这门语言吧!

2519

2519

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?