简介:感知机学习算法,作为机器学习的基础模型,能够处理线性可分的数据集,本文利用此算法解决井字游戏问题。通过MATLAB实现感知机模型,对井字游戏的局面进行预测。感知机通过迭代更新权重找到分类决策边界。训练数据来源于 digitdata2.txt 文件,用于训练和测试模型的性能。训练过程中,模型基于误分类数据更新权重,而测试阶段则评估模型对新游戏局面的预测能力。本内容涵盖感知机算法、MATLAB编程、井字游戏、数据集划分、在线学习和线性分类等关键知识点。

1. 感知机学习算法基础

感知机学习算法是一种基础的线性分类器,由Rosenblatt在1957年提出,是机器学习领域最经典的算法之一。其目的是解决线性可分的二分类问题,通过线性决策边界将样本分为两类。

基本概念

感知机模型包含权重向量和偏置项,输入样本与权重向量进行点乘后加上偏置项,通过激活函数(通常是符号函数)决定样本的分类结果。

历史发展

感知机的发展经历了从早期的简单线性分类器,到后来被证明其局限性的过程。Minsky和Papert的批评暴露了感知机不能处理非线性可分问题的缺点,为后来的神经网络发展提供了理论基础。

应用场景

感知机在手写体识别、邮件垃圾过滤、图像边缘检测等领域有广泛的应用,它作为神经网络的雏形,为后续更复杂的模型提供了学习的起点。

2. MATLAB实现感知机模型

感知机模型是机器学习领域中一种简单的线性分类器,它通过调整权重向量来最小化误差。MATLAB作为一种高效的数学计算和仿真软件,为实现感知机模型提供了便捷的平台。在本章中,我们将深入探讨如何利用MATLAB来实现感知机模型的完整过程。

2.1 MATLAB环境配置

2.1.1 MATLAB软件安装

首先,确保你的计算机上安装了MATLAB软件。如果尚未安装,你需要从MathWorks官网下载最新版本的MATLAB。安装过程中,可以选择安装额外的工具箱,例如神经网络工具箱,以支持更高级的功能。

2.1.2 工具箱的导入和设置

在MATLAB中,工具箱是实现特定功能的函数集合。对于感知机模型而言,通常不需要额外的工具箱,因为MATLAB自带的函数库已足够支持基本的实现。但是,如果需要进行更复杂的操作,可能需要导入机器学习工具箱或神经网络工具箱。

2.1.3 MATLAB工作环境配置

在开始编程之前,需要配置MATLAB的工作环境。这包括设置文件路径、工作目录以及对MATLAB版本进行检查确保兼容性。

addpath('路径地址'); % 添加需要的路径到MATLAB路径列表中

cd('工作目录'); % 更改当前工作目录

version; % 显示当前MATLAB版本信息

2.2 感知机模型编程实现

2.2.1 编写感知机核心算法

在MATLAB中编写感知机核心算法,需要定义权重向量 w 和偏置项 b ,同时实现学习规则。以下是一个简单的感知机核心算法的实现代码:

function [w, b, model] = perceptron(X, y, maxIter)

% 初始化权重和偏置项

n = size(X, 2);

w = zeros(n, 1); % 权重向量

b = 0; % 偏置项

% 感知机学习规则

for iter = 1:maxIter

for i = 1:size(X, 1)

% 计算预测输出

if (X(i, :) * w + b) * y(i) <= 0

% 更新权重和偏置项

w = w + y(i) * X(i, :); % 权重更新

b = b + y(i); % 偏置项更新

***

***

end

end

2.2.2 数据输入与模型训练过程

感知机模型的训练过程包括输入数据的准备和模型的训练。以下代码展示了如何准备数据和调用感知机函数进行模型训练:

% 输入数据准备(特征矩阵X和标签向量y)

X = [1, 2; 3, 4; 5, 6]; % 特征矩阵示例

y = [1; -1; 1]; % 标签向量示例

% 模型训练(设置最大迭代次数)

[trained_w, trained_b, trained_model] = perceptron(X, y, 10);

% 输出训练后的权重和偏置项

disp('训练后的权重:');

disp(trained_w);

disp('训练后的偏置项:');

disp(trained_b);

2.2.3 结果输出与模型验证

训练完成后,需要对模型进行验证,以确保模型的有效性和泛化能力。以下为模型验证和结果输出的示例代码:

% 使用训练好的模型进行预测

predictions = X * trained_w + trained_b;

% 与实际标签比较,验证模型的准确性

accuracy = sum(predictions .* y > 0) / length(y);

disp(['模型准确率为: ', num2str(accuracy)]);

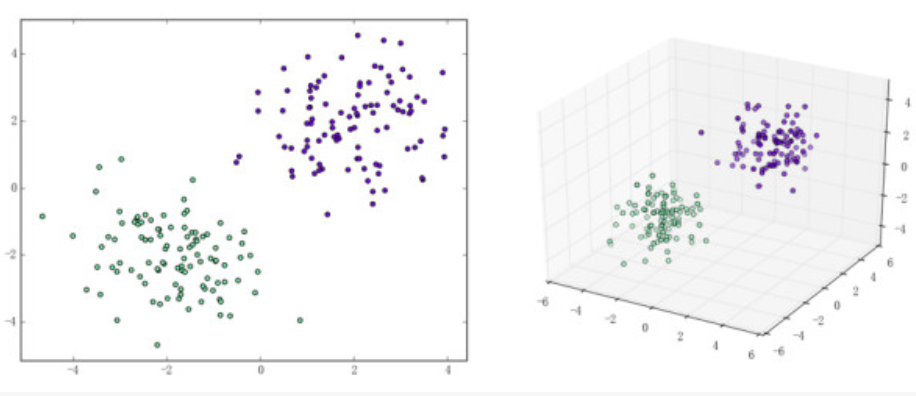

2.3 感知机模型的可视化

在MATLAB中,我们可以利用其内置的绘图功能来可视化感知机模型。以下代码展示了如何绘制数据点和感知机决策边界:

% 创建网格以便绘制决策边界

[x1, x2] = meshgrid(-10:0.5:10);

grid = [x1(:), x2(:)];

grid = grid - mean(grid); % 中心化数据

grid = grid ./ max(abs(grid)); % 归一化数据

predictions_grid = grid * trained_w + trained_b;

% 绘制数据点和决策边界

figure;

plot(X(:,1), X(:,2), 'ro', 'MarkerSize', 10, 'MarkerFaceColor', 'r'); % 绘制数据点

hold on;

contour(x1, x2, reshape(predictions_grid, size(x1)), [-1 0 1]); % 绘制决策边界

xlabel('Feature 1');

ylabel('Feature 2');

title('Perceptron Decision Boundary');

legend('Data Points', 'Decision Boundary');

grid on;

在以上章节中,我们介绍了如何在MATLAB环境中配置工作环境、编写感知机核心算法、进行模型训练与验证,并最终实现了模型的可视化。通过这些步骤,可以加深对感知机模型编程实现的理解,为后续的优化和应用打下坚实的基础。

3. 井字游戏作为应用案例

在本章中,我们将探索一个具有教育意义和实际应用价值的问题——井字游戏。我们将重点研究如何将井字游戏转化为分类问题,并运用感知机算法解决这一问题。通过分析游戏规则和状态,本章将展示感知机算法在游戏策略制定中的实际应用。

3.1 井字游戏规则介绍

3.1.1 游戏玩法和胜负判断

井字游戏(Tic-tac-toe)是一种双人轮流进行的纸笔游戏。游戏在一个3x3的方格上进行,两名玩家轮流在空格中填入“X”和“O”,首先在横线、竖线或对角线上形成连续标记的玩家为胜者。如果所有格子均被填满而没有玩家获胜,则游戏以平局结束。

为了将井字游戏转化为分类问题,我们可以将每一种可能的游戏状态视为一个分类样本。例如,空的游戏板可以被视为一个类别,标记为“空”;而“X”和“O”在游戏板上的任何布局则可以被视为另外两个类别。在这个分类问题中,获胜的玩家所代表的类别是胜利状态,而其他玩家或平局则可以被分类为非胜利状态。

3.1.2 游戏状态的数学表达

为了将游戏状态转化为数学模型,我们可以采用一种称为“one-hot encoding”的方法。在3x3的游戏板上,我们可以使用9维向量表示,其中每个维度对应一个格子。如果某个格子为空,则对应维度的值为0;如果被“X”或“O”标记,则对应维度的值为1。例如,初始的空游戏板可以表示为向量[***]。

通过这种方法,我们可以创建一个包含所有可能游戏状态的数据集,并将每个状态标记为“X”胜利、“O”胜利或平局。这个数据集将用于训练感知机模型。

3.2 感知机在井字游戏中的应用

3.2.1 将井字游戏转化为分类问题

要将井字游戏转化为分类问题,我们需要为感知机算法提供训练数据。在井字游戏中,每个玩家的目标是使自己获胜,同时阻止对手获胜。这使得我们可以为感知机模型定义三个类别:玩家“X”的胜利、玩家“O”的胜利和平局。

我们可以创建一个数据集,其中包含所有可能的游戏状态,每个状态都有一个标签指示哪位玩家获胜或游戏是否以平局结束。在这个数据集中,每个游戏状态都被表示为一个9维向量,表示当前游戏板的配置。例如:

| 标签 | 状态向量 | |------------|--------------------------------------| | X胜利 | [ ] | | O胜利 | [ ] | | 平局 | [***] |

通过训练数据集,感知机算法将学习预测给定游戏状态的标签。

3.2.2 感知机算法的训练与策略制定

在井字游戏中,感知机算法的目标是学习到一个决策边界,这个边界能够将游戏状态分为胜利或非胜利。为了训练感知机模型,我们需要定义损失函数。在二分类问题中,常用的损失函数是逻辑损失(Logistic loss)或平方损失(Square loss)。在多分类问题中,可以使用多类逻辑回归(Multinomial Logistic Regression)。

以下是用伪代码表示的感知机训练过程:

# 感知机模型训练伪代码

def train_perceptron(data, labels, learning_rate, iterations):

# 初始化权重向量和偏置项

weights = [0 for _ in range(len(data[0]))]

bias = 0

# 训练过程

for _ in range(iterations):

for sample, label in zip(data, labels):

# 计算当前样本的预测值

prediction = predict(sample, weights, bias)

# 更新权重和偏置

update_weights(sample, weights, bias, label, prediction, learning_rate)

return weights, bias

def predict(sample, weights, bias):

# 计算加权和

weighted_sum = sum(sample[i] * weights[i] for i in range(len(sample))) + bias

# 应用激活函数

return activation_function(weighted_sum)

def update_weights(sample, weights, bias, label, prediction, learning_rate):

# 计算错误

error = label - prediction

# 更新权重

for i in range(len(sample)):

weights[i] += learning_rate * error * sample[i]

# 更新偏置项

bias += learning_rate * error

# 调用训练函数

weights, bias = train_perceptron(game_states, labels, learning_rate=0.1, iterations=1000)

在这个伪代码中, train_perceptron 函数负责模型训练, predict 函数用来计算样本的预测值, update_weights 函数根据预测错误来更新模型参数。通过这个过程,我们可以训练出一个能够预测井字游戏胜率的感知机模型。

将感知机应用于井字游戏不仅仅是理论上的探讨。在实际的游戏环境中,我们可以实现一个基于感知机的AI对手,它可以实时预测对手的可能行动,并据此作出最佳反应。例如,基于感知机模型的AI会优先选择那些可能导致自己胜利或阻止对手胜利的游戏状态。

通过这种方式,我们可以展示感知机模型在实际应用中的强大潜力。在后续章节中,我们还将讨论如何进一步优化模型,以实现更智能的游戏策略。

4. 数据集划分与模型训练

4.1 数据集的划分与预处理

4.1.1 训练集、验证集和测试集的划分方法

在机器学习中,将数据集划分为训练集、验证集和测试集是一种常见的实践。每个数据集有着不同的作用。训练集用来训练模型,验证集用来调优模型参数和防止过拟合,测试集则用于评估模型的最终性能。

划分数据集的一种简单方法是随机划分。在Python中,可以使用 sklearn.model_selection 模块中的 train_test_split 函数来完成这一任务:

from sklearn.model_selection import train_test_split

X_train, X_temp, y_train, y_temp = train_test_split(X, y, test_size=0.4, random_state=42)

X_val, X_test, y_val, y_test = train_test_split(X_temp, y_temp, test_size=0.5, random_state=42)

在这个例子中,数据集首先被划分为70%的训练集和30%的临时集。然后临时集进一步被划分为50%的验证集和50%的测试集。 random_state 参数保证了每次划分的可复现性。

4.1.2 数据的标准化和归一化处理

在数据预处理阶段,数据的标准化(Standardization)和归一化(Normalization)是两种重要的方法。标准化是调整数据的均值为0和方差为1,归一化是将数据缩放到一个特定的范围,通常是[0,1]。

对于感知机算法,标准化处理尤为重要,因为感知机是基于梯度下降的算法,如果数据特征的范围差异很大,会导致收敛速度变慢。

在Python中可以使用 sklearn.preprocessing 模块来完成数据的标准化或归一化处理:

from sklearn.preprocessing import StandardScaler

scaler = StandardScaler()

X_train_scaled = scaler.fit_transform(X_train)

X_val_scaled = scaler.transform(X_val)

X_test_scaled = scaler.transform(X_test)

上述代码段使用了 StandardScaler 对训练集数据进行标准化处理。 fit_transform 方法同时拟合数据并进行转换,而 transform 方法仅对新数据进行相同的转换。注意,对验证集和测试集的标准化,应该使用 transform 方法,确保使用和训练集相同的均值和方差。

4.2 模型训练与参数优化

4.2.1 训练过程中的损失函数选择

损失函数衡量的是模型的预测值与真实值之间的差异。对于感知机模型,通常使用的是二元分类问题的损失函数,比如逻辑损失(Log Loss)或者Hinge Loss。

在二元分类问题中,逻辑损失适用于概率输出,而Hinge Loss常用于支持向量机(SVM)等线性模型。感知机虽然通常使用Hinge Loss,但在某些实现中也可以使用逻辑损失。

import numpy as np

def hinge_loss(y_true, y_pred):

return np.mean(np.maximum(0, 1 - y_true * y_pred))

上述函数是Hinge Loss的实现,其中 y_true 是真实标签, y_pred 是模型预测值, * 表示逐元素除法。

4.2.2 模型参数的调整和优化策略

模型参数的调整和优化是机器学习模型训练中的关键步骤。对于感知机模型,主要优化的参数包括学习率和迭代次数。

学习率控制了权重更新的幅度,太小会导致训练速度缓慢,而太大则可能导致模型无法收敛。迭代次数决定了学习过程中的总步数,过多的迭代可能造成过拟合,而迭代次数不足则可能导致模型未能充分学习。

learning_rate = 0.1

epochs = 1000

for epoch in range(epochs):

for i in range(len(X_train_scaled)):

# 模型预测和更新权重的代码片段

...

# 可以在每次迭代后评估模型在验证集上的性能,以监控模型的训练过程

在上述伪代码中,我们初始化了学习率和迭代次数,并通过循环来训练模型。在每次迭代中,权重会根据输入数据和误差进行更新。在实际应用中,可能会加入早停(early stopping)机制,当验证集性能不再提升时停止训练。

总结

本章我们深入了解了数据集的划分方法和预处理技术,以及如何通过损失函数和优化策略来训练感知机模型。数据预处理能够大幅提高模型的收敛速度和泛化能力。选择合适的损失函数和调整模型参数是确保模型训练效果的关键。通过这些策略,我们可以为构建高效准确的感知机模型打下坚实的基础。

5. 在线学习与权重迭代更新

5.1 在线学习的基本概念

5.1.1 在线学习与批量学习的区别

在线学习(Online Learning)与批量学习(Batch Learning)是机器学习训练方法的两个不同范式。批量学习指的是一次性用完整的数据集对模型进行训练,训练过程中模型参数只在完整数据集上更新一次。而在线学习则是一种持续学习的方式,模型参数在接收到每一个新的数据点后都会即时更新,无需等待所有数据加载完成。在线学习能够有效应对数据流(Data Stream)场景,即时调整模型,以适应数据的动态变化。

5.1.2 在线学习的优缺点分析

在线学习的主要优点是其在处理大规模数据流时的高效性和灵活性。模型可以实时适应新数据,无需重新训练整个模型,从而节省了大量的计算资源和时间。另外,对于数据分布随时间变化的场景(即概念漂移),在线学习提供了一种有效的应对策略。然而,它也存在一些缺点。在线学习算法容易受到单个样本噪声的影响,可能导致模型参数的不稳定性。此外,若数据流中的样本不是独立同分布(i.i.d),模型可能会难以收敛到最优状态。

5.2 权重迭代更新策略

5.2.1 感知机的权重更新规则

感知机模型的权重更新规则是其在线学习的核心。对于一个二分类问题,给定一个训练样本 (x, y),其中 x 是特征向量,y 是标签(+1 或 -1)。如果当前的感知机预测结果与真实标签不一致,即存在预测错误,感知机的权重会根据以下公式更新:

w = w + η * y * x

其中,w 是权重向量,η 是学习率(取值范围在 0 到 1 之间),y 是样本的标签,x 是样本的特征向量。学习率决定了权重更新的步长,较小的学习率会导致模型在学习过程中的更新较为缓慢,但可能有助于避免过拟合。

5.2.2 学习率和迭代次数的选择

在在线学习过程中,选择合适的学习率和迭代次数对模型性能至关重要。学习率过高可能导致模型震荡,无法收敛;而学习率过低则会使模型学习缓慢。通常学习率的选择需要根据具体问题进行试验确定。迭代次数的选择则与问题复杂度和数据流的特征有关,迭代次数过多可能导致过拟合,过少则可能导致欠拟合。在实际应用中,可以通过验证集来确定最优的学习率和迭代次数。

5.3 应用在线学习于井字游戏

5.3.1 在线学习在游戏策略中的实现

将在线学习应用于井字游戏,可以实时根据对手的最新动作来更新和调整游戏策略。例如,当感知机模型通过在线学习算法训练时,每完成一轮游戏后,模型会接收当前游戏状态作为新的输入,并根据游戏结果更新权重。在井字游戏中,这意味着每一次移动之后,模型都会得到一个信号来指导其对接下来的移动进行预测。

5.3.2 实时数据更新与模型适应性分析

实时数据更新让感知机模型在井字游戏中表现出了良好的适应性。当对手的策略发生变化时,感知机模型能够迅速通过在线学习调整其权重,以适应对手的新策略。这种适应性对于提高游戏策略的有效性至关重要,尤其是在对抗性环境中。模型能够通过学习对手的行为模式来提高胜算,这是在线学习在动态环境中应用的一个明显优势。

简介:感知机学习算法,作为机器学习的基础模型,能够处理线性可分的数据集,本文利用此算法解决井字游戏问题。通过MATLAB实现感知机模型,对井字游戏的局面进行预测。感知机通过迭代更新权重找到分类决策边界。训练数据来源于 digitdata2.txt 文件,用于训练和测试模型的性能。训练过程中,模型基于误分类数据更新权重,而测试阶段则评估模型对新游戏局面的预测能力。本内容涵盖感知机算法、MATLAB编程、井字游戏、数据集划分、在线学习和线性分类等关键知识点。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?