要论9102让人“真香“的产品,苹果9月发布的iPhone 11系列那必须拥有姓名

更广的超广角、虽然晚了点但十分惊艳的夜间模式,以及所有摄像头甚至前置都能拍摄4K 60帧视频、多摄像头同时工作,当然还有不久前刚更新的神级算法功能——DeepFusion!

但素,最近我们收到了一些留言,大意都是在问为什么刚换的iPhone11拍照黄黄的,不光是11,以前的iPhone也是如此~

iPhone拍照为什么发黄?

关于这个问题,我们尝试在网上一搜,会发现的确有很多相同的问题

▼

并且除了最新的11,包括iPhone之前很多的机型6、7、8、x…都有类似的情况。

而问题后,大部分的回答是“因为没有关闭原彩显示”

于是,我们开始了第一个猜想 ~

猜想一:原彩显示

了解iPhone的人都知道,原彩显示的确也是原因之一,具体的原理,可以来看接下来的小测试

首先,为了照顾有的小伙伴可能还不了解什么是原彩显示,小北我先来简单解释一下:

原彩显示(True Tone)技术就是让屏幕根据环境光线,自动调整屏幕的色温与显示效果

用苹果官方的解释来说就是:根据环境光线条件自动调整iPhone以在不同环境下保持色彩显示一致。

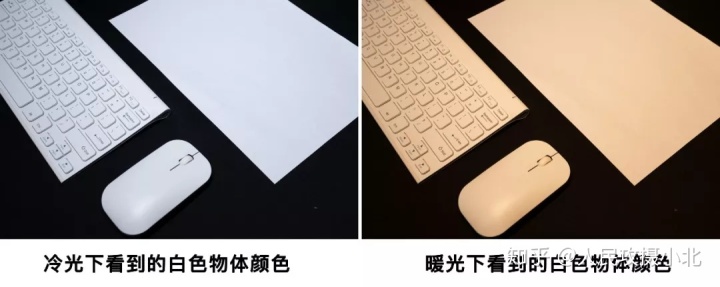

用一个小实验再来演示说明一下

拿一些白色的物体,比如白纸、咱滴白色键盘和鼠标~ 然后把它们放在不同色温的灯光下,就可以清晰地看到它们外表的颜色发生了改变。

而原彩显示就是真实模拟了这个现象!

要知道,自然界的阳光也是会有色温变化的,比如傍晚时分就会更低展现出较黄的光线。

而iPhone的原彩显示就是希望我们在看iPhone屏幕时,屏幕内的物体与周边环境的物体色彩表现是接近的。

我们把开启了原彩显示的iPhone放在不同色温下时,它屏幕显示的亮度和白平衡就自动发生了变化

okay,现在大家对原彩显示都有些了解了吧~

下面咱就用iPhone在关闭原彩显示的前后分别拍了一张照片,看起来是不是就没那么黄了?

但是,问题没这么简单...

我们再用某品牌的其他手机在同样的光线条件下拍了一张,分别导出三张照片,大家来看:

嗯?好像看不太出来?咱们放大看!

两台iPhone拍的照片并没有什么差别啊,反而第三台其他手机相对会白一点点

这个问题很简单,因为原彩显示只作用于你的屏幕,对于最终拍出来的照片其实是不影响的,只要你发到其他设备上,也是正常的照片。

也就是说:这张照片本身并没有你看到的那么黄!

我们可以先简单小结出下面几点:

1 /

如果环境色温偏低(偏暖),开了原彩显示的iPhone拍照后,自己在屏幕上看时的确会偏黄一些;

2 / 原彩显示只影响你的手机显示,照片本身并不受影响,但是为了拍摄时色彩判断更准确,还是建议适时关掉;

3 / 抛开设备显示问题,导出后的照片,iPhone拍照似乎也仍比其他手机稍黄一点点,但也仅限于一点点。

另外,还有不少分用户认为是因为「 夜览模式 」的原因。

其实夜览模式与原彩显示同理,都只是作用于你自己的设备,如果导出照片并没有或者关闭后去看照片,成片并不受影响。

同样需要记住,拍摄时务必暂时关掉夜览模式与原彩显示!!!

那么,影响iPhone拍照轻微泛黄的原因还能是什么呢?我们还有两种猜想

猜想二:与手机拍摄环境中测光有关

我们都知道在拍照时,如果转动手机取景到不同的画面,手机的测光点会改变,然后白平衡、曝光等都会发生改变。

我们在一个画面中加入一张白纸,转动白纸让其在画面中的占比发生改变,然后我们就能看到画面的亮度与色温稍微发生了一点改变。

同样的方式我们用相机去拍摄,可以发现并没有太大的变化。

由此我们可以大概地猜测:

相比相机,手机由于各种复杂优化算法介入的更多,画面中不同主体色彩变化等可能会影响白平衡的基准判断。

而相机因为更多的依靠光学本身成像,只要环境色温不变,那么即使画面主体色彩等发生变化,白平衡也不会变化太大。

比如向下面这样,通过手机单纯地移近、移远,在这个过程中就会发现键盘的颜色也发生了变化。

而且不光是iPhone,其他手机也有类似色彩漂移的情况,只是往往最终成像会偏冷一些~

这是某其他手机

为了避免大家认出

我们裁去了操作页面

换个更容易理解的方式,这也像Ps中的【白平衡工具】。

当我们选择一张照片,使用【白平衡工具】分别吸取不同位置的色彩时,照片白平衡的平衡点就发生了变化

比如选择了窗帘白色的部分为白平衡的平衡点,整体画面的色彩就变成了黄色;

反之,再选择黄木色的凳子,整体画面就有些泛冷了。

猜想三:眼睛“欺骗”了我们

人的眼睛很神奇,神奇在它拥有高达“5.76亿像素”,神奇在它可以帮我们剥去环境色温,“识别物体真正的颜色”。

如果从色彩的心理学和生理学角度上分析, 我们人对事物的色彩其实是有记忆性辨识的

简单来说,我们有“常识”~ 但这一点,相机却做不到。

相机不同于人会存在主观意识,它是利用各种算法,将传感器接受光线产生的电信号最终转换成图像,从而还原那一刻拍摄主体的色彩,其中就包括了环境色温的影响。

这一点无论是相机、手机都是如此,所以在相机拍摄中,我们经常会人为修改白平衡设置,拍摄出符合我们认为的白平衡。

所以,这部分的猜想可以证实一点:

一般相机拍摄的画面其实是接近当时物体真正的颜色(当然,扑街的事也时常发生),因为它一并记录了环境色温的影响;而人会执着于让事物变成自己想象的颜色。

猜想四:iPhone也许根本不Care

也许你会有些疑惑:都说iPhone影像能力很强,那为什么不能解决这个小问题呢?

这个时候让我突然想到之前我们做的 一个测试,用iPhone前置自拍和用其他手机自拍的区别。

其他手机的自拍照看到的是镜像后的自己,而iPhone呈现的是别人看你的视角。

当然也包括自拍美颜,iPhone始终会让我们“更加清晰的认识自己” …

这里还有个小插曲,曾经iPhone为了市场呼声也想偷偷尝试轻量的美颜,但是被国外用户一顿吐槽,立马又改了。

于是,我们第四个大胆的猜想就来了: iPhone也许根本不Care

从近几年来不同版本的iPhone表现来看,iPhone在这个问题上已经优化了很多,只是相比其他手机还是会略显偏暖一些。

所以,如果说iPhone没有能力改变这一点那是不可能的,于是就只有一个可能:

那就是苹果压根不认为这个黄是问题,因为这就是真实环境色温下拍摄主体的色彩呈现呀

而很多安卓手机其实是对色彩进行了专门的优化,根据观察普遍会往“更冷”,也就是更白的方向调整。

这种针对相对更迎合日系韩系等审美风格的个性化审美调教同样在非洲也能看到,比如非洲市场第一的传音手机,它也是我们的自主品牌。

传音手机针对非洲用户的肤色与喜好进行了特定的色彩与音乐外放优化,价格实惠,席卷非洲大陆

可能也有人听过类似“佳能红、尼康黄、宾得绿、奥巴蓝...”这样的段子。

有人说这是各家厂商的色彩风格,就像“佳能红”的确能让人有一种白里透红的感觉,对于人像肤色的调教的确会更讨一部分人的偏爱。

但也有人觉得这本身是一种相机的缺陷。所以啊,每个人的看法不同,而苹果有他的想法~

那么,究竟如何才能解决拍照发黄的问题?

首先,一般情况下iPhone也并没有那么黄,如果你觉得偏暖想要白皙一些,解决方法也很简单,先说说两种。

第一种,改变拍摄环境色温,比如调节环境灯光。

一般因为灯光的偏黄,会导致了照片拍出来发黄,看起来也不够通透。

这主要是手机相机自动白平衡识别不够准确造成的,环境色温偏低就会导致照片偏黄。

因此,调节到合适的环境色温,由我们来帮忙告诉相机“什么是白”,就能很大程度让照片恢复到视觉上正常的颜色

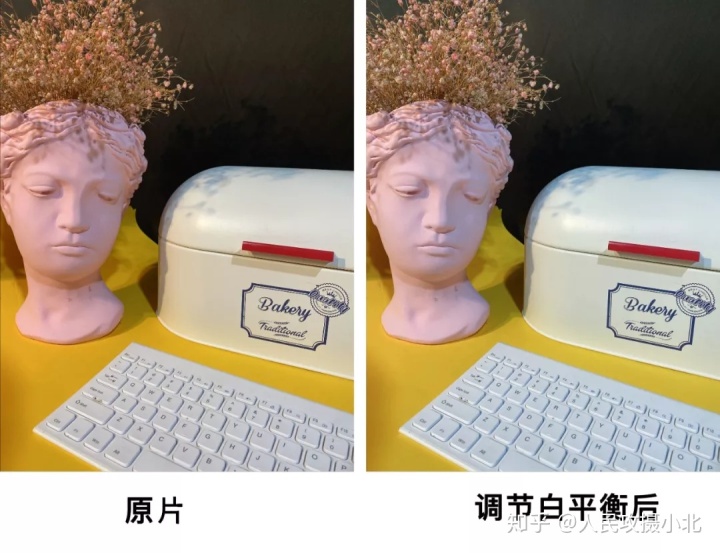

第二种,通过前期或者后期调整设备白平衡。

有时会有调节不了环境灯光的情况,比如呆在室外拍。

这样的话就可以通过前期调整拍摄设备的白平衡设置,或者后期来调整照片的白平衡。

尾声:

你更喜欢把真实环境色温影响下的白平衡表现出来,还是更喜欢给你一张白皙的照片,取决于自己。

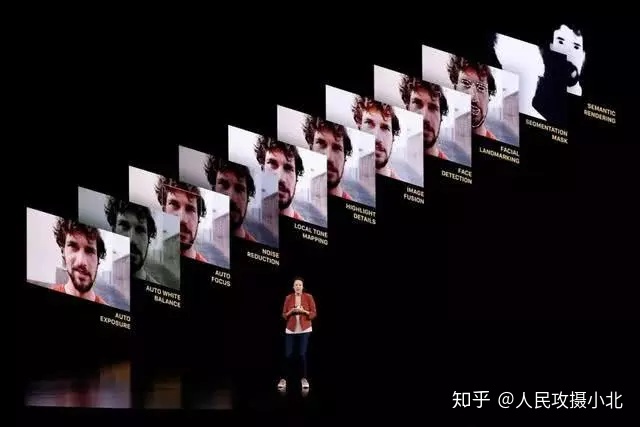

但对于苹果而言,相比花时间去满足某种单一的审美偏好,也许它更愿意把精力投入到真正的拍摄体验中去

比如,黑科技DeepFusion,一下子让1200万像素达到前所未有的极致画质表现(有多极致,我们后面会出测评);

比如,多颗摄像头同时工作,既可以做到真正的顺滑变焦,还可以实现“一机多位”拍摄;

比如,夜间模式,与无差别提亮画面相比,苹果依然坚持对于暗部氛围的保留,同时尽可能压缩了拍摄等待时间;

比如,iPhone的智能HDR,依然是目前最好的HDR算法,没有之一,而且拍摄完全不需要片刻的等待;

再比如,LivePhoto提高了拍照时的时间容错性,我们可以通过倒放追溯错过的某个瞬间。

再比如,超宽镜头取景拍摄提高了拍摄的空间容错性,我们可以通过裁剪寻找遗留在取景之外的精彩画面。

当然,还有全部摄像头都可以拍摄4K 60帧视频等等。

苹果其实一直致力于用户体验的提升,而我们很难觉察。因为我们往往会觉得一切理所应当;因为我们往往需要关注的只是镜头前的画面,以及按下快门时自我的那份期待。

我们认为的黄,在iPhone眼中只是真实的还原,如果想白,App Store中有一堆的修图应用来帮助你解决;而安卓厂商们则明显更懂亚洲用户的审美偏好,主动让画面白一点自然更受欢迎,也免了用户后期的烦恼

那么,你喜欢那种?

okay,今天的内容就到这里,如果你也对iPhone拍照感兴趣,一起来留言里说说你认为的想法把~

就酱~下期见!

4075

4075

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?