1.简介

回归分析是“监督机器学习”的子领域。其目的是建立一定数量特征与连续目标变量之间关系的模型。

在回归问题中,我们寻求获得定量响应,例如关于房地产价格的预测或某人花在观看视频上的秒数。

2.简单线性回归:构建数据行

给定一组点,回归算法建立一个模型,以调整一个独立的特定特征(独立变量X的值)和相应的“结果”值(因变量y的值)之间的依赖关系。

这个关系通过建立一条任意线来实现,并计算线与对应值(x,y)的数据点的距离。该距离即垂直线是“残差”或“预测误差”。

回归算法将在每个交互中重新计算(并移动)直线,找为一个最适合的数据点(X,Y),也就是说,用最少的误差(最接近线的最大分数)。

有几种技术可用于实现这一目标,我们将在下面看到。

2.1移动线

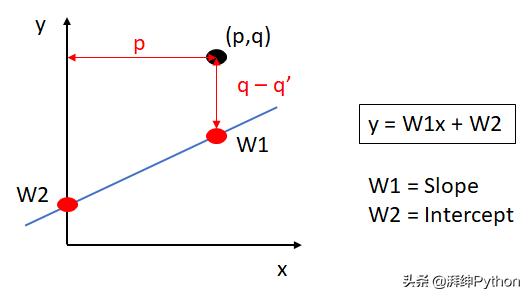

在此图中,我们找到以下元素:

- W1:斜率,是线相对于横坐标轴(x)的倾斜度。

- W2:截距,是纵坐标(y)的直线切点。

2.1.1绝对近似

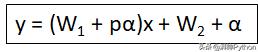

如果我们从一个点和一个线开始,目标是使这条线更接近该点。为此,该算法将使用称为“学习率”的参数。该学习率是将线的参数相乘以实现直线到点的最小近似。

换句话说,学习率将确定每个交互中所覆盖的距离的长度,这将使直线接近该点。通常用α表示。

2.1.2近似方法

它基于以下前提:如果线附近有一个点并且距离很小,则线将移动一小段距离。如果它很远,该线将移动更多。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5650

5650

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?