今天继续向 Python 头条添加数据信息,完成了微信公号的爬虫,接下来会继续通过搜狗的知乎搜索抓取知乎上与 Python 相关的文章、问答。

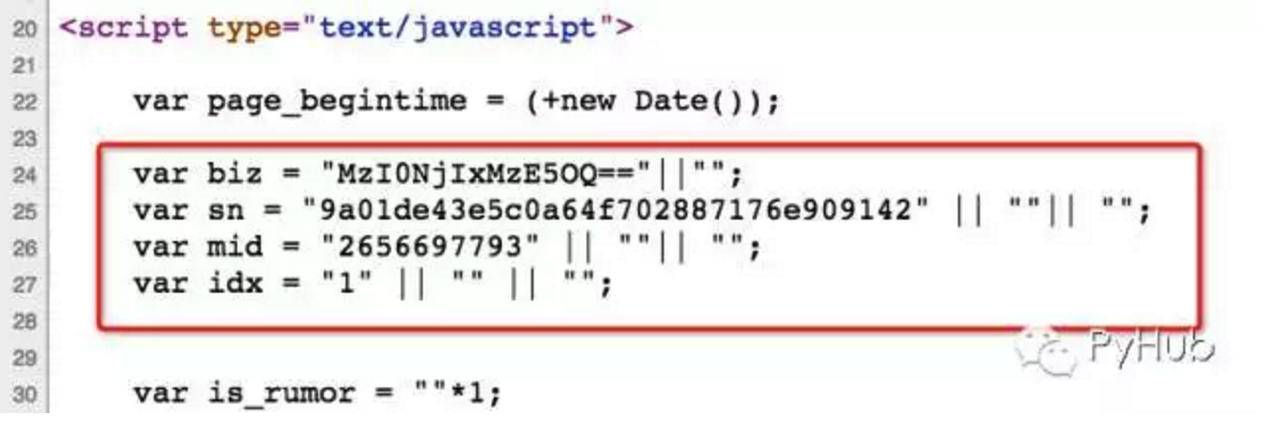

微信公众号的文章链接有些是具有时效性的,过一段时间会变成参数错误而无法访问,但是我们发现从公众号后台点击过去得到的链接却是永久链接,其参数不会改变链接也不会失效,也就是说只要能够获得这些参数就可以得到永久链接。通过观察发现即使从搜狗搜索入口的有时效性的链接访问网页,其源码中也带有这些参数:

所以只要解析这几个参数,就可以构造出永久链接。

首先通过搜狗搜索入口,可以获取 Python 关键词搜索的结果,地址为:HOST = 'http://weixin.sogou.com/'entry = HOST + "weixin?type=2&query=Python&page={}"复制代码

提取链接、标题和摘要信息:import requests as req

import re

rInfo = r'([\s\S]*?)[\s\S]*?\s*([\s\S]*?)'html = req.get(entry.format(1)) infos = re.findall(rInfo, html)复制代码

由于关键词搜索会在标题或摘要中产生特定格式的标签,需要过滤:def remove_tags(s):

return re.sub(r'<.>', '', s)复制代码

然后根据时效性链接获取文章内容,并从中提取参数信息:from html import unescapefrom urllib.parse import urlencodedef weixin_params(link):

html = req.get(link)

rParams = r'var (biz =.*?".*?");\s*var (sn =.*?".*?");\s*var (mid =.*?".*?");\s*var (idx =.*?".*?");'

params = re.findall(rParams, html) if len(params) == 0:returnNonereturn {i.split('=')[0].strip(): i.split('=', 1)[1].strip('|" ') for i in params[0]}for (link, title, abstract) in infos:

title = unescape(self.remove_tag(title))

abstract = unescape(self.remove_tag(abstract))

params = weixin_params(link)

if params isnotNone:

link = "http://mp.weixin.qq.com/s?" + urlencode(params)

print(link, title, abstract)复制代码

由此可以收集到以 Python 为关键词的微信公众号文章,包括链接、标题和摘要。如需文章内容也可以随时通过链接提取,但是为了尊重创作者,请在抓取文章正文的时候请检查原创信息并合理标注作者及引用信息。

微信公众号的抓取的数据也已经加入到 Python 头条,欢迎移步 pyhub.cc 查看!根据昨天发布的投票信息【为你感兴趣的 Python 专题投票】,看到大家对 Python 的爬虫专题比较感兴趣,因此把今天实践操作的一些内容与大家分享,希望可以有所帮助(还没有投票的抓紧投起来~~)。

题图来源:Captain America: Civil War

590

590

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?