谢谢你能看我一本正经的胡说八道。

0) 缘由

为什么要写这么一篇博文呢?

我在很多次面试中,都被问到SVM算法。惭愧的是,我近两年一直关注深度学习算法,对SVM的理论本来就掌握得不熟,加上时间一久,被问到的时候结果可想而知。所以,思来想去,痛定思痛,还是整理一篇博文,作为自己的复习,也为可能看到这篇博文的同学带来一点启发,就更好了。

记得面试的时候,被面试官问起,我说支持向量机是通过查找一个超平面来做二分类的。然后面试官问我,“具体一点,原理是什么可以大致讲一讲么”,我就随口说了几个核函数,然后在被问到核函数原理的时候彻底懵逼。如果你也是这种情况,那么,这篇文章也是为你准备的。

其实,很多算法都是一脉相承的,只是在某些步骤采取了不同的处理方式。相信每个刚看到SVM算法的人都会跟我有相同的感觉,这玩意怎么那么像线性回归,怎么又那么像感知机呢?恭喜,如果有这种感觉的话,说明,你跟我一样,是初学者,哈哈哈。

废话不多说,下边进入正文。

1) 简介

支持向量机(Support Vector Machines, SVM)是一种二分类模型,其基本模型是定义在特征空间上的最大间隔的线性分类器,间隔最大是跟感知机区分开来的地方。

相信看到这里,你绝对是一脸懵逼,最大间隔是啥意思?没关系,我也是!但是,请接着看下去吧,让我们一起解开SVM的神秘面纱。

回归和分类的故事

在数学课上,老师教过我们一个简单的函数,$ y=f(x) = x^2 $ ,很简单,对吧,相信大家都认识这个函数。但是这个函数代表什么意思呢?我们学了那么多年数学,这个基本的函数公式,我们用在了哪里呢?

其实,我们学的很多东西,看似无用,因为很多人确实一辈子可能都用不到。但是,当你用到的时候,你会发现,哇,原来这个东西这么有用!

对的,这个函数其实很有用,当然我不会去讲这个函数多有用。在这里,这个函数仅仅可以让我们了解回归和分类是啥意思。

回归

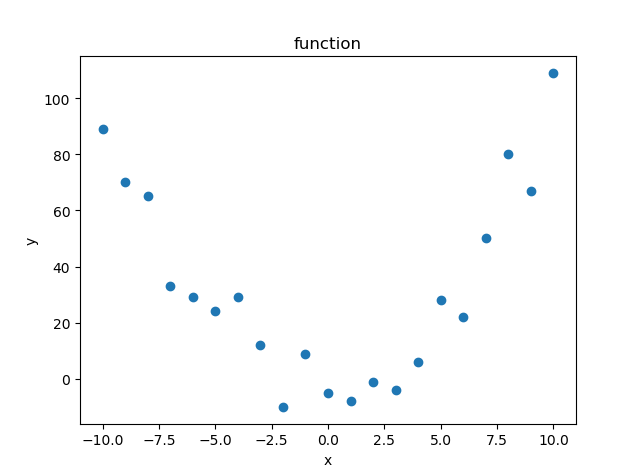

先来看回归,我记得初中还是高中,刚学函数的时候,会有这么一道题目,给定一部分x, 也给定一部分y, 让大家根据x和y的数字,来判断x和y有什么关系。假设,我们有一批数据样本如下图所示(单变量样本):

我们打眼一看,这个分布有点像我们学过的一个函数啊,什么来着?对,特别像$ y

本文介绍了支持向量机(SVM)在文本分类中的应用,通过一个简单的例子展示了如何使用scikit-learn进行文本分类。首先解释了回归与分类的区别,接着介绍了SVM的基本概念,包括超平面和间隔最大化。然后通过IMDB数据集展示了SVM的使用,包括数据预处理、特征选择和模型训练。最后,文章预告了下篇将深入讨论SVM的原理。

本文介绍了支持向量机(SVM)在文本分类中的应用,通过一个简单的例子展示了如何使用scikit-learn进行文本分类。首先解释了回归与分类的区别,接着介绍了SVM的基本概念,包括超平面和间隔最大化。然后通过IMDB数据集展示了SVM的使用,包括数据预处理、特征选择和模型训练。最后,文章预告了下篇将深入讨论SVM的原理。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9万+

9万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?