简介:本项目利用Tesseract OCR引擎,通过图形用户界面(GUI)将图像中的文字转化为可读的文本、盲文以及音频格式,旨在帮助视力受损者通过技术手段获取信息。项目还包括了提升图像处理质量、简化操作流程、以及开源合作等方面,目的是缩小数字鸿沟,促进信息无障碍。

1. OCR技术与视觉障碍者辅助

1.1 OCR技术的概述

OCR(光学字符识别)技术让计算机能够将图像中的文字转换成机器编码的文本形式。这项技术对于视觉障碍者辅助来说,是一种重要的变革性工具。OCR通过扫描和分析文档、图片和其他媒介中的打印或手写文字,实现了信息的数字化,使得视觉障碍者能够借助屏幕阅读器、盲文显示器等辅助设备来理解和处理这些信息。

1.2 视觉障碍者的挑战

对于视觉障碍者而言,日常生活中阅读印刷材料是一大挑战。他们通常依赖于点字和语音输出技术来获取信息,但这些方式速度较慢且可能不够方便。OCR技术可以帮助视觉障碍者更快地获取并处理文本信息,从而在教育、工作及社会活动中拥有更大的自主性。

1.3 OCR技术在视觉障碍者辅助中的应用

将OCR技术整合到视觉障碍者的辅助工具中,可以极大地提升他们的生活质量和工作效率。例如,OCR可以用于手机应用或专用设备中,通过拍照扫描文本,然后将其转换为语音或盲文。此外,OCR技术在文档数字化、信息提取以及辅助阅读方面发挥着关键作用,它可以为视觉障碍者提供更高效的信息访问方式。

在下一章中,我们将深入探讨Tesseract OCR引擎的应用,它是一种开源的OCR技术,广泛应用于多种场景,包括支持视觉障碍者辅助。

2. Tesseract OCR引擎的应用

2.1 Tesseract OCR基本概念

2.1.1 Tesseract OCR简介

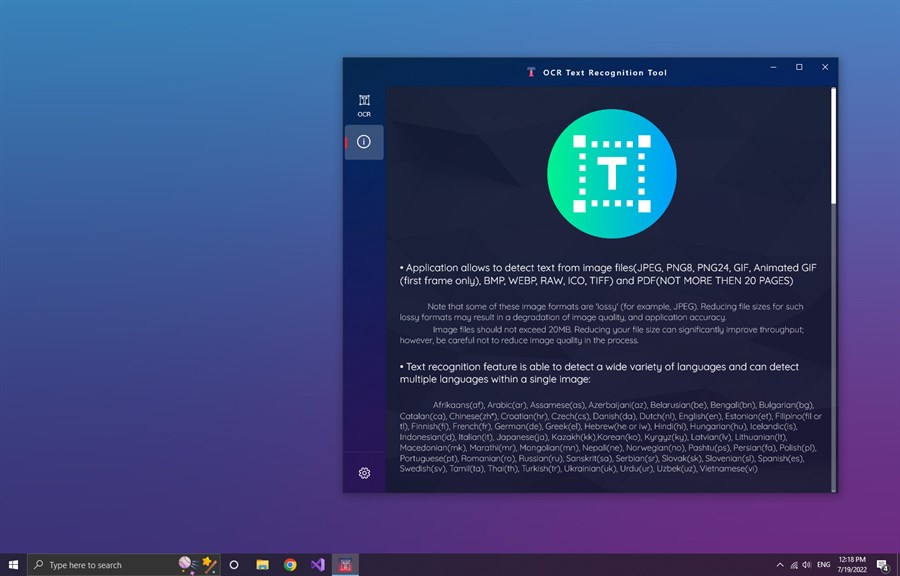

Tesseract是一个开源的光学字符识别(OCR)引擎,由HP开发并开源,后来被Google赞助。Tesseract能够识别多种字体和语言的文本,并将其转换为机器编码文本。由于其出色的性能,它在IT行业得到了广泛应用,特别是在自动化数据录入、图书数字化和辅助技术领域。Tesseract的开源特性不仅使其能够自由使用,还促进了社区对其不断的改进和优化。

2.1.2 Tesseract OCR工作原理

Tesseract的工作流程大体可以分为图像预处理、文本行检测、单词分割、字符识别以及后处理五个阶段。图像预处理包括对图像进行缩放、二值化、去噪等操作,以提升识别准确率。之后,Tesseract进行文本行的定位,分割出单独的文本行,进而分割出单词。在这个基础上,Tesseract识别每个字符,并且根据上下文信息对识别结果进行后处理优化。

2.2 Tesseract OCR的安装与配置

2.2.1 下载安装Tesseract OCR

Tesseract的安装在多数操作系统上都是直接且简单的。在Windows系统上,可以通过官方网站下载安装包并执行安装程序。在Linux系统上,可以使用包管理器进行安装。例如,在Ubuntu系统上,可以使用如下命令:

sudo apt-get update

sudo apt-get install tesseract-ocr

sudo apt-get install libtesseract-dev

在MacOS上,通过Homebrew安装非常简单:

brew install tesseract

安装完成后,可以通过命令行工具 tesseract 检查安装是否成功:

tesseract --version

2.2.2 配置开发环境与测试运行

为了在开发环境中使用Tesseract,需要配置相应的环境变量。对于Python开发者,可以使用 tesseract Python库与Tesseract交互。首先通过pip安装 tesseract Python库:

pip install pytesseract

接下来需要告诉 pytesseract 库Tesseract的安装路径。可以通过修改Python脚本或者设置环境变量 TESSDATA_PREFIX :

import pytesseract

pytesseract.pytesseract.tesseract_cmd = r'C:\Program Files\Tesseract-OCR\tesseract.exe'

安装好库并配置完成后,可以运行一个简单的测试来确认Tesseract是否正常工作:

from PIL import Image

import pytesseract

# 读取图片

img = Image.open('test.png')

# 使用Tesseract进行OCR

text = pytesseract.image_to_string(img, lang='eng')

# 输出识别的文本

print(text)

2.3 Tesseract OCR的命令行使用

2.3.1 命令行工具的基础操作

Tesseract命令行工具提供了多种选项,可以根据不同的需求进行配置。最基本的命令格式如下:

tesseract <input_file> <output_file> -l <language>

其中, <input_file> 是需要识别的图像文件, <output_file> 是输出文件的前缀, <language> 是识别的语言代码。例如,要识别一张名为 sample.jpg 的图片并输出英文识别结果,可以使用:

tesseract sample.jpg output -l eng

Tesseract会生成一个名为 output.txt 的文件,其中包含识别出来的文本。

2.3.2 高级选项和批量处理技巧

Tesseract命令行提供了许多高级选项来帮助用户进行精细的调整。例如,如果需要对图像进行二值化处理,可以使用 -psm 选项设置页面分割模式:

tesseract sample.jpg output -l eng -psm 6

对于批量处理图片,可以编写一个简单的shell脚本或批处理文件来进行自动化处理:

for f in *.jpg; do

tesseract "$f" "${f%.*}" -l eng

done

此脚本会自动处理当前目录下所有的 .jpg 图片文件。

Tesseract的高级使用还包括自定义字典、训练自定义数据模型等,这些都为提高OCR精度提供了额外的方法。

3. 图形用户界面(GUI)的重要性

图形用户界面(GUI)对于现代软件来说至关重要,它为用户提供了直观、可视化的交互方式。本章旨在探讨GUI的设计原则,以及与命令行相比的优势和局限性。

3.1 GUI设计原则

3.1.1 易用性与无障碍设计

易用性是指用户使用产品时的便捷程度,而无障碍设计则是考虑到了包括视觉障碍者在内的所有用户的需求。一个好的GUI应考虑到不同用户的使用场景和特殊需求,例如:

- 颜色对比度应足够高,以确保色弱或色盲用户也能清晰区分界面元素。

- 图标和按钮应使用清晰、易于理解的设计,避免过于抽象的符号。

- 字体大小应可调整,以适应阅读障碍者或老年人的需求。

- 界面布局应简洁,避免复杂的导航和操作流程。

GUI设计的无障碍性能够极大提升视觉障碍者等特殊群体的使用体验,这是与传统命令行界面相比的重要优势。

3.1.2 用户体验与交互设计

用户体验(UX)是衡量一个软件是否成功的关键指标之一。GUI设计中需要关注以下几个方面:

- 一致性 :界面元素和操作流程在不同页面或应用中应保持一致,减少用户的学习成本。

- 反馈及时性 :用户的每一步操作都应有明确的反馈,比如按钮点击的视觉或声音提示。

- 导航逻辑清晰 :菜单和按钮应明确,帮助用户快速找到所需功能。

- 错误预防与纠正 :设计时应考虑用户可能的误操作,提供明确的错误提示,并且允许容易的恢复措施。

良好的用户体验和交互设计能够使用户在使用软件时感到愉悦,减少挫败感和操作错误。

3.2 GUI与命令行的对比分析

3.2.1 GUI的优势

GUI的优势显而易见,主要包括:

- 直观性 :图形界面通过图标、颜色和形状等视觉元素直接传达信息,比文本指令更加直观。

- 易于学习 :对于非技术用户来说,图形界面更容易上手。

- 操作简便 :通过鼠标点击和拖拽等动作即可完成复杂的操作,不需要记住复杂的命令。

GUI的这些优势使其在大多数消费者软件中成为主流,尤其适合面向普通大众的产品。

3.2.2 GUI的局限性与挑战

尽管GUI带来了便利,但在某些情况下,它也存在局限性:

- 资源消耗 :图形界面需要消耗更多的计算资源来渲染和处理复杂的图形效果。

- 定制性不足 :对于高级用户或特定行业用户来说,命令行提供的灵活性和定制性更受青睐。

- 可访问性问题 :在没有视觉或触觉反馈的情况下,如远程或网络延迟较高的情况下,GUI可能不够直观。

GUI的局限性要求设计师和开发者在设计软件时充分考虑用户群体的需求,合理选择界面类型。

3.2.3 GUI的未来展望

随着技术的发展,GUI也在不断进步和演变:

- 增强现实(AR)与虚拟现实(VR) :未来GUI可能不再局限于二维屏幕,而是扩展到三维空间。

- 人工智能(AI) :AI可以更好地理解用户意图和上下文,提供更加个性化的交互体验。

- 手势和语音控制 :随着传感器技术的发展,未来用户可能会通过更自然的手势和语音指令与界面交互。

GUI的发展将使软件应用更加人性化,更加智能和便捷。

为了更全面地理解GUI的重要性,我们可以创建一个简单案例来展示GUI的设计过程,包括设计原则的应用和用户界面(UI)元素的选择。下面是使用伪代码表示的一个简单的GUI设计流程:

设计一个简单的图片编辑器GUI

1. 创建窗口

- 定义窗口尺寸和标题

- 设置窗口背景颜色

2. 添加菜单栏

- 包含“文件”、“编辑”、“视图”、“帮助”等基本选项

3. 设计工具栏

- 集成常用工具,如保存、打开、撤销、重做等

- 提供图标和文字说明

4. 实现图片展示区域

- 显示当前编辑的图片

- 实现缩放和平移功能

5. 添加调整选项卡

- 提供调整图片亮度、对比度、饱和度等功能

6. 实现预览和应用按钮

- 预览调整效果

- 确认更改并应用到图片上

7. 开发帮助文档和快捷键

- 提供软件使用说明

- 设置常用操作的快捷键

通过上述流程,我们可以看出GUI设计需要考虑多方面的因素,以确保最终的用户体验是流畅且友好的。设计过程中要时刻把用户需求放在首位,并通过迭代测试不断优化设计。

4. 图像分辨率对OCR准确率的影响

4.1 图像预处理基础

图像预处理是任何图像识别系统中的重要步骤,尤其对于光学字符识别(OCR)来说,图像质量会直接影响到文字识别的准确性和可靠性。预处理过程包括多个环节,例如图像大小调整、图像去噪、二值化等操作。

4.1.1 图像分辨率的调整

图像分辨率指的是图像中每英寸长度内有多少像素点。分辨率通常以像素每英寸(PPI)来表示。高分辨率图像有更多的像素点,能够提供更多细节,因此在转换成文字时能够提供更好的识别准确率。在进行OCR之前,通常需要确保输入的图像具有合适的分辨率,通常建议最低为300 DPI。

在调整图像分辨率时,我们需要注意的是不要随意增大图像尺寸,因为这会导致像素点被拉伸,从而降低图像质量。推荐的方法是尽可能地从源头获取高分辨率图像,或者使用插值算法在保持边缘清晰度的同时增加图像的分辨率。

from PIL import Image

# 打开一张低分辨率的图片

original_image = Image.open('low_resolution_image.jpg')

# 调整图像大小,以增加图像分辨率

# 使用的是双线性插值方法

resized_image = original_image.resize((1024, 1024), Image.BILINEAR)

# 保存调整后的图像

resized_image.save('high_resolution_image.jpg')

代码逻辑解读: - 首先,我们使用PIL库中的Image模块打开需要调整分辨率的低分辨率图像。 - 然后,我们使用 resize 方法将图像调整为1024x1024像素的尺寸,使用双线性插值算法确保图像质量。 - 最后,我们保存调整后的图像到磁盘。

4.1.2 去噪和二值化处理

在进行图像分辨率调整后,图像去噪和二值化处理是进一步提高OCR准确率的关键步骤。去噪可以清除图像中的随机误差,例如扫描过程中产生的噪点或纸张上的污渍。二值化是将图像中的像素点从灰度转换为黑白两种颜色,这可以简化图像信息,便于后续处理。

二值化处理通常会使用Otsu的方法,这是一种自适应阈值技术,可以自动计算出一个最佳的阈值,从而实现最好的图像分割效果。

import cv2

# 读取图像

image = cv2.imread('high_resolution_image.jpg', cv2.IMREAD_GRAYSCALE)

# 应用Otsu二值化

_, binary_image = cv2.threshold(image, 0, 255, cv2.THRESH_BINARY + cv2.THRESH_OTSU)

# 保存二值化图像

cv2.imwrite('binary_image.jpg', binary_image)

代码逻辑解读: - 使用OpenCV库读取之前处理过的高分辨率图像,并以灰度模式打开。 - 应用Otsu方法进行二值化处理,该方法会自动找到一个最佳的阈值,并将图像转化为二值图像。 - 最后将二值化后的图像保存到磁盘。

4.2 图像质量对识别效果的影响

图像质量,特别是分辨率和清晰度,对OCR系统的识别效果有着直接的影响。分辨率低下或质量差的图像会导致OCR识别错误增加,准确率降低。此外,图像中的噪点和光照不均也会对文字的识别带来挑战。

4.2.1 低分辨率图像的挑战

低分辨率图像包含的信息量较少,每个像素点较大,导致相邻文字之间的像素合并,使文字边缘模糊不清。在这样的情况下,OCR引擎难以分辨字迹之间的边界,最终导致误识别和漏识别。例如,小写的字母"l"和数字"1"在低分辨率图像中可能很容易混淆。

解决低分辨率图像带来的识别挑战需要从图像获取和预处理两个层面入手。图像获取阶段,如果可能,应尽量使用高质量的图像传感器,并设置适当的分辨率。如果图像已经获取,预处理阶段则需要利用图像增强技术来提升图像质量。

4.2.2 解决方案与优化建议

为了减少低分辨率图像对OCR识别的不利影响,可以采取以下几种优化策略:

- 图像增强 :采用图像增强技术来提高图像的对比度和清晰度。常见的增强技术包括直方图均衡化、锐化滤波器等。

-

多帧合成 :如果条件允许,可以拍摄同一场景的多个低分辨率图像,并通过算法将这些图像合成为一个高分辨率图像。

-

深度学习超分辨率 :利用深度学习模型,如卷积神经网络(CNN),对图像进行超分辨率重建。这种方法可以从低分辨率图像中重建出接近高分辨率图像的细节。

-

特殊模型训练 :对于特定类型的图像,可以通过训练Tesseract OCR使用专门的数据集来提高识别的准确性。

综上所述,OCR技术在图像分辨率方面的挑战和优化是一个持续的研究领域,它需要对图像处理技术和OCR算法有深入的理解和应用。通过恰当的预处理和图像增强技术,可以显著提高OCR技术在视觉障碍辅助应用中的可靠性和准确性。

5. 文本、盲文和音频格式的转换功能

5.1 文本到音频的转换

5.1.1 文本到语音技术(TTS)介绍

文本到语音技术(TTS)是一种利用计算机系统将文本信息转换为声音的技术。它允许计算机“阅读”文本文件并将其转换成接近人类语音的音频输出。TTS系统通过合成器将文本转换为语音,并可以在不同的语音和语言中进行调整。TTS广泛应用于屏幕阅读器、自助服务终端、车载导航系统以及智能助手等。

文本到语音转换的核心挑战之一是生成自然流畅且富有表现力的语音。此外,对于视觉障碍者来说,TTS技术还必须支持调整语速和音调,以便用户可以根据自己的需求进行个性化设置。先进的TTS系统还支持使用不同的声音来表示不同的情绪和语气,进一步提高了用户体验。

5.1.2 实现文本到音频转换的方法

要在应用程序中实现文本到音频的转换,可以使用各种编程语言和库。下面是一个使用Python语言和 gTTS (Google Text-to-Speech)库将文本转换成音频文件的基本示例:

from gtts import gTTS

import os

# 输入要转换的文本

text = "欢迎使用文本到语音转换示例。"

# 指定生成的语言

lang = 'zh-cn'

# 生成TTS实例

tts = gTTS(text=text, lang=lang, slow=False)

# 保存音频文件到磁盘

filename = "output.mp3"

tts.save(filename)

print(f"音频文件已保存为 {filename}")

# 播放生成的音频文件

os.system(f"start {filename}")

在上述代码中,首先导入了 gTTS 模块,然后定义了需要转换的文本和目标语言(在这里是中文)。 gTTS 函数创建了一个TTS实例,并通过调用 save() 方法将生成的音频保存为MP3文件。最后,使用操作系统的命令行播放了这个音频文件。

gTTS 还提供了许多高级功能,如改变语速、音调和语音类型。这些功能可以帮助创建更加个性化和适应性强的TTS应用。例如,可以通过 slow=True 参数降低语速,使听者更容易理解复杂的句子结构。

5.2 盲文输出设备的整合

5.2.1 盲文显示器的工作原理

盲文显示器(Braille display)是一种为视觉障碍者提供电脑屏幕上的文字信息的辅助设备。它允许用户通过触摸盲文点来阅读电子文档。盲文显示器通常由一系列小的可动凸点组成,这些点可以独立地升起或降下来形成盲文字符。电脑通过串行端口、USB或无线方式发送指令给盲文显示器,来控制哪些点需要升起或降下,从而显示新的信息。

盲文显示器对于完全失明或有视力障碍的人来说至关重要,因为它提供了即时的、非视觉的电脑接口。盲文显示器通常与屏幕阅读软件配合使用,使得视觉障碍者可以完全独立地操作电脑。

5.2.2 盲文转换的实现与集成

为了将文本信息转换为盲文,必须实现从文本到盲文字符的映射。这个过程涉及到对盲文编码标准的理解,以及对应于每个字符或单词的盲文点阵图案的生成。为了集成盲文转换到现有的软件中,开发者可以使用专门的API或者库,来简化实现过程。

在Python中,可以使用 pybraille 库来实现文本到盲文的转换。下面是一个简单的示例代码:

from pybraille import display, braille

# 要转换的文本

text = "Python for accessibility"

# 使用pybraille库将文本转换为盲文

display.show(braille.from_string(text))

print("文本已转换为盲文点阵,可以使用盲文显示器阅读。")

在这段代码中,我们首先导入了 display 和 braille 模块。然后定义要转换的文本,使用 braille.from_string 方法将文本转换成盲文点阵,最后通过 display.show 方法在盲文显示器上显示出来。对于集成到复杂的应用程序中,开发者可以通过调用这些函数来实现文本信息的实时转换和显示。

盲文转换实现后,还需要考虑如何与现有的盲文显示器集成。大多数现代盲文显示器都是基于USB,并且支持标准的盲文协议。软件开发者需要确保应用程序能够检测到盲文显示器并发送正确的数据包。有些操作系统提供了专门的辅助技术框架,例如在Windows上有Microsoft Active Accessibility(MSAA)和UI Automation,在macOS上有VoiceOver,这些框架都可以用来与盲文显示器集成。

此外,为了确保无障碍性,盲文转换软件通常还会有声音反馈功能,或者可以与语音合成器集成,为用户提供音频反馈。这样,视觉障碍者可以同时通过触觉和听觉接收信息,进一步增强用户体验。

6. Tesseract OCR的进阶应用

随着技术的发展和用户需求的不断变化,Tesseract OCR引擎的进阶应用成为了一个新的研究焦点。本章节将深入探讨Tesseract在多语言支持、字体训练、以及高级图像处理技术方面的应用,揭示如何优化OCR的性能和提高其在不同场景下的实用性。

6.1 多语言支持与字体训练

6.1.1 Tesseract的多语言能力

Tesseract是一个开源的OCR引擎,它支持超过100种语言的识别,并且可以处理各种字体和格式的文本。Tesseract的一个显著优势是其多语言能力,这一点在处理多语种文档时尤其重要。对于视障人士来说,能够在不同的语言环境下保持较高的识别准确率,意味着他们能够接触到更加多元化的信息资源。

Tesseract通过其内置的多语言库来实现多语言识别,用户可以通过在识别命令中指定相应的语言代码来启用特定语言的OCR处理。例如,使用 tesseract image.png output -l eng+fra 可以让Tesseract同时处理英文和法文。

6.1.2 创建自定义字体训练数据

为了提高Tesseract对特定字体或打印风格的识别精度,用户可以创建自己的OCR训练数据。这一过程包括准备样本文本图像和相应的Tessdata文件。下面是创建自定义字体训练数据的基本步骤:

- 准备训练样本:需要收集大量的、高质量的、与目标字体一致的文本图像。这些图像应覆盖字体的各种变体,包括大小、样式、颜色等。

- 生成训练文件:使用Tesseract的tesseract命令行工具配合训练工具,例如

unicharset_extractor和mftraining,生成特定字体的字符集文件。 - 训练Tesseract:最后,使用

cntraining命令根据字符集文件和训练图像生成Tesseract可识别的训练数据。

下面是一个命令行示例,展示如何训练Tesseract识别特定的字体样式:

unicharset_extractor sample_text.png

mftraining -F tessdata/unicharset -U tessdata/unicodes.txt sample_text.tr

cntraining sample_text.tr tessdata/fonts

代码逻辑解读与参数说明:

-

unicharset_extractor sample_text.png:生成未格式化的字符集文件。 -

mftraining:训练形状分类器,-F指定字符集文件,-U指定字符映射文件,最后的参数是训练文件。 -

cntraining:训练连通组件分类器,参数包括上一步生成的训练文件和指定训练字体数据的目录。

6.2 高级图像处理技术

6.2.1 文档图像的自动校正

自动校正是Tesseract在处理文档图像时的一个重要功能,它能够自动识别并修正图像的倾斜,使文字更加清晰易于识别。文档图像的自动校正过程包括以下步骤:

- 图像预处理 :主要是对图像进行二值化处理,以便于后续的分析。

- 边缘检测与分析 :通过边缘检测技术定位文档的边缘,包括文字的行和段落。

- 旋转校正 :计算文档的倾斜角度,并据此旋转图像进行校正。

Tesseract提供了多种命令行选项用于图像校正,比如 --psm 参数可以设定页面分割模式,从而优化文档图像的识别。

6.2.2 文本区域检测与增强

文本区域检测是图像预处理阶段的一个关键步骤,它的目的是将图像中的文本区域从背景中分离出来,以便于后续的OCR处理。文本区域检测主要依赖于图像分析技术,比如连通组件分析和阈值分析。

文本增强则是通过算法增强图像中的文本部分,使其更加易于识别。增强技术包括但不限于:对比度增强、亮度校正、去噪等。Tesseract提供了一系列的图像处理工具来执行这些任务。

在Tesseract的高级应用中,文本区域检测和增强技术的应用可以让OCR引擎更加智能地处理复杂的图像。例如,通过编写脚本整合多种图像处理技术,可以实现如下功能:

- 自动调整图像对比度和亮度。

- 应用去噪和锐化技术改善图像质量。

- 使用连通组件分析提取文本区域。

import cv2

import pytesseract

# 读取图像

image = cv2.imread('document.jpg')

# 应用高斯模糊减少噪声

blurred_image = cv2.GaussianBlur(image, (3, 3), 0)

# 边缘检测

edges = cv2.Canny(blurred_image, threshold1=100, threshold2=200)

# 文本区域检测和图像增强

# 这里可以根据实际图像情况调整参数和算法

# ...

代码逻辑解读与参数说明:

-

cv2.imread('document.jpg'):读取图像。 -

cv2.GaussianBlur:应用高斯模糊减少图像噪声,(3, 3)是模糊核的大小,0是标准差,这里设置为0表示自动选择。 -

cv2.Canny:使用Canny算子进行边缘检测,threshold1和threshold2是检测边缘的高低阈值。

以上代码段展示了如何使用OpenCV和Tesseract进行基本的图像预处理操作。在实际应用中,可能还需要结合其他图像处理库,例如scikit-image或Pillow,以实现更复杂的图像处理功能。

通过本章节的介绍,我们深入探讨了Tesseract在多语言支持、字体训练以及高级图像处理技术方面的进阶应用。在下一章节中,我们将继续探讨开源软件在辅助技术中的应用,并深入解析社区合作的力量。

7. 开源软件的优势与社区合作

7.1 开源软件的定义与价值

开源软件,即开放源代码的软件,其源代码对所有人公开,允许用户自由地使用、复制、修改和分发该软件。开源文化起源于1980年代,随着自由软件运动的发展而兴起,其核心理念是通过合作、共享和参与,推动技术的进步和创新。

7.1.1 开源文化与理念

开源软件的开发模式鼓励全球开发者之间的协作,任何人都可以为项目贡献代码,甚至参与到决策过程中去。这种开放透明的方式,不仅能够聚合多元化的创意和解决方案,还能促进软件质量的提升和成本的降低。

开源软件的优势在于其社区化、多样化的开发模式。例如,Linux操作系统和Apache服务器的广泛使用,展示了开源软件在企业级市场中的巨大潜力。开源软件的另一大优势是其许可证的灵活性,这为用户提供了巨大的自由度,可以根据自身需求定制和优化软件。

7.1.2 开源软件在辅助技术中的应用

在辅助技术领域,开源软件为视觉障碍者提供了众多实用的工具。例如,Tesseract OCR引擎作为开源项目,可以被广泛应用于图像识别和文本提取,帮助视觉障碍者获取电子文档内容。通过社区的努力,Tesseract不断地被改进,以适应更多的语言和字体,提供更高的识别准确率。

此外,开源软件在创建无障碍应用程序和操作系统方面也发挥着关键作用。通过开源项目,开发者能够基于社区的反馈不断优化其辅助技术产品,确保其更好地服务于用户。

7.2 社区协作的力量

开源社区是由对某个开源项目有兴趣的个人和组织构成的网络,他们合作以推进项目的发展。这些社区通常由项目维护者、贡献者、用户和爱好者组成,他们在全球范围内工作,交流和分享知识。

7.2.1 开源社区的参与与贡献

参与开源社区,个人开发者和公司都能从中获益。通过贡献代码、文档或金钱,他们能获得对项目更多的发言权,并能影响项目的未来走向。同时,开源社区也有着一套标准的贡献流程,如对pull requests的管理,代码审查,以及贡献者守则。

开源社区不仅仅是代码的共享地,更是知识与经验的共享平台。社区中的交流和合作推动了技术的快速发展,使得开源项目可以迅速响应市场和技术的变革。

7.2.2 社区支持与项目成功案例

许多成功的开源项目证明了社区合作的力量。比如,Arduino、WordPress和Android等项目,最初都只是小型的社区项目,但随着社区的不断壮大和贡献者的持续加入,这些项目如今已经成为各自领域的领导者。

对于辅助技术领域的项目,社区的支持尤为关键。通过社区的共同努力,许多原本可能被忽视的辅助功能被开发出来,极大地提升了视觉障碍者的日常生活质量。

开源社区的支持不仅限于技术层面,还包括经济支持、法律咨询和市场营销等。例如,通过众筹平台,一些辅助技术项目能够获得启动资金;而法律顾问志愿者可以为开源项目提供必要的法律援助,确保项目在遵守法律的前提下健康发展。

开源软件和社区协作是现代技术领域中的重要力量,它们的活力和贡献对于辅助技术的发展起到了不可或缺的作用。随着技术的不断进步,我们可以预见开源社区将继续在这一领域扮演关键角色。

简介:本项目利用Tesseract OCR引擎,通过图形用户界面(GUI)将图像中的文字转化为可读的文本、盲文以及音频格式,旨在帮助视力受损者通过技术手段获取信息。项目还包括了提升图像处理质量、简化操作流程、以及开源合作等方面,目的是缩小数字鸿沟,促进信息无障碍。

126

126

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?