本篇为联想小新Air14 2020锐龙版新品评测的第一篇:硬件篇。

在本篇中主要介绍产品的外观、硬件配置和性能表现。

6年前,大众关注最多的一句话是“飞机哪里去了?”。

而近3个月以来,关注小新产品的小伙们谈论最多的话题是“YES版哪里去了?”只不过前者是无限的等待,后者则是准时报到。

啥叫幸福?他说“有鱼有肉”,她说“有房有车”,在我看来是“有A有i”,AMD和intel皆可拥有。

2020年联想首款消费笔记本小新Air-14IIL 2020在2月27日正式发售,被称为年度真香14英寸轻薄本,先行上市产品的是基于intel代号Ice Lake的第10代酷睿处理器平台。

在5月15日晚间的B站直播小新锐龙版新品发布会上,联想小新团队终于发布了小新家族2020锐龙版新品。并宣布小新Air-14 ARE 2020从5月16日0点预售,6月1日正式启售。

首批上市的小新Air-14 ARE 2020的为R5 4600U版,媒体价:4499元,首发价:3999元。在618期间按首发价销售,之后将恢复媒体价。

2月20日我直接预订了牙膏i5 1035G1版,2月27日付的尾款(那台和果壳小哥开箱的一样,生产日期都是2020年2月7日,你别告诉我不知道果壳是谁,有些out了,5月31日19点的B站直播看了木?就是那个穿着小新黑色小新T恤高富帅的小哥,同样也是6月1日晚上介绍小新Air14的那位小哥)。

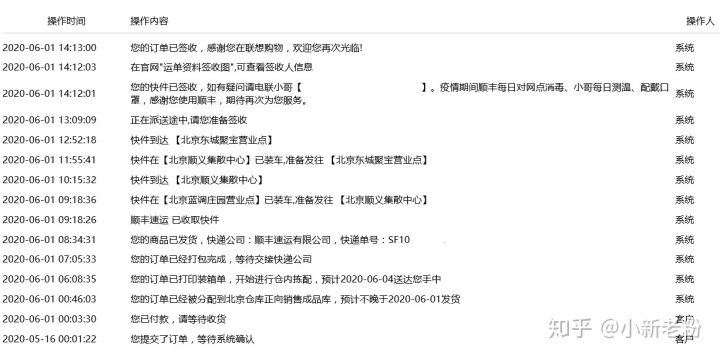

言归正传,说说这次的锐龙版,5月16日0点我直接下单,6月1日0点付完尾款,物流出库配送速度还挺快,当天下午就签收了,赞一个。

这台小新Air14锐龙版算是给自己置办的儿童节礼物之一(还有小新15锐龙版和小新Pro13锐龙版)。

我拿到的这台生产日期是2020年5月27日,下午先带着它去公园旅游拍照,来张本本和包包的合影,时间仓促没带洗手液,不幸把手上的灰尘沾染到屏幕上,各位看官还请海涵。

6月1日23点开机,整体测试完成时间约为凌晨2点,利用约3小时撰写本文,总耗时将近6小时。

鲁大师的硬件检测的截图将拉开本次硬件部分评测的序幕,性能跑

分紧随其后。

减去由核显贡献的异构分数,最终实际得分应为230000分上下。

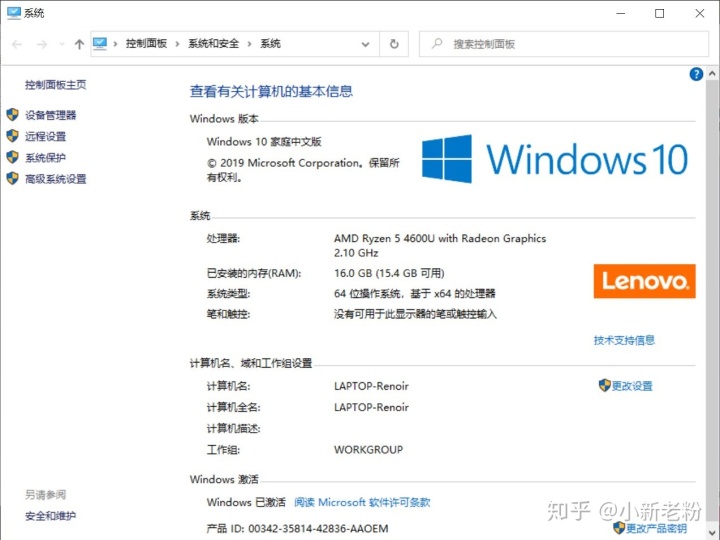

它的硬件配置如下:

处理器:AMD Ryzen 4600U(6C/12T)

显卡:AMD RADEON(6CU,核显)

内存:16G DDR4 3200MHz(板载)

硬盘:512G SSD(NVME协议,TLC)

屏幕:14英寸100%sRGB DC调光IPS雾面屏,300尼特亮度(FHD,1920*1080分辨率)

电池:56.5Wh,3芯

外壳:铝合金

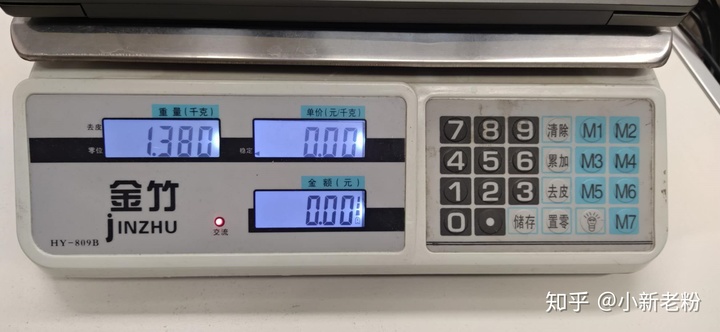

三围:长321.6mm,宽211.6mm,厚16.9mm

体重:1.380kg(不含电源适配器)、1.720g(包含电源适配器),电源适配器的重量请做减法。

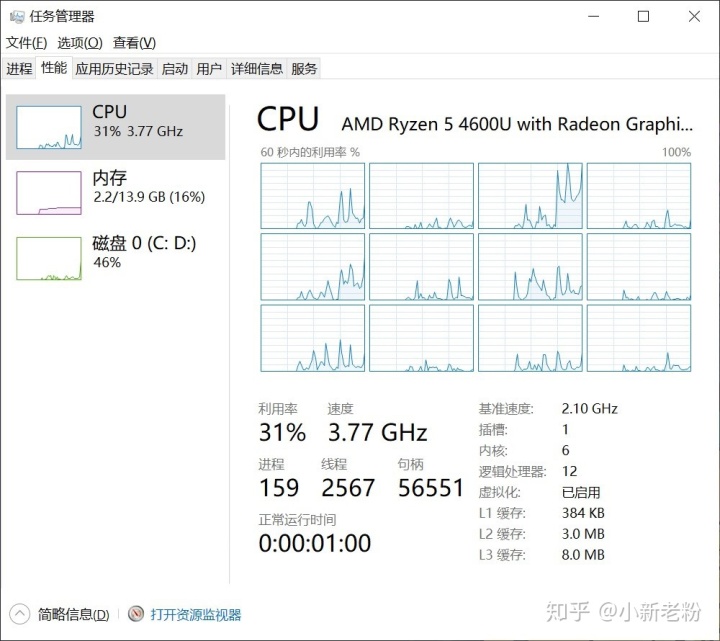

Windows系统信息中显示的硬件情况:

【产品优缺点】

优点

1.高色域DC调光雾面屏,护眼降疲劳;

2.ACD三面铝金属机身,用料考究,坚固耐用;

3.外壳引入高端消费本的深灰配色,与键盘浑然一体,适用于庄重的商务场景。

4.强劲的CPU;

5.Fn+Q一键切换性能模式。

缺点及解决方案

1.电源适配器不够轻巧(建议使用YOGA电源适配器替代);

2.想要大屏幕请选择小新15,喜欢镜面屏请选择小新Pro13。

【升级建议】

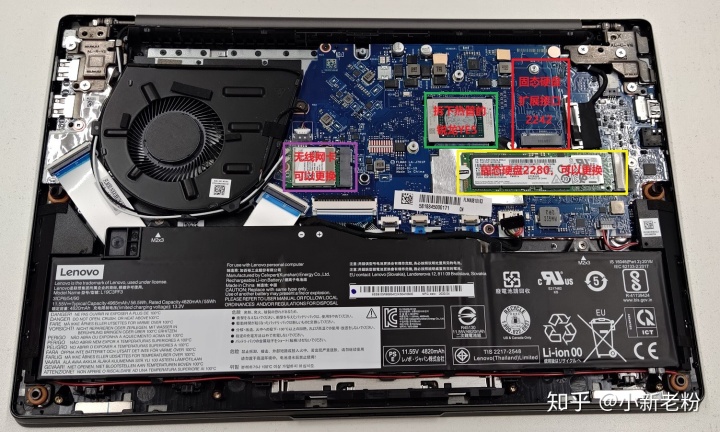

小新Air-14 ARE 2020(以下简称本品)主机后盖(D壳)采用3+4的螺丝设计(上面3颗螺丝类似ThinkPad只能拧松不能拧下,下面4颗螺丝可以拧下),螺丝为内六角,需要使用T5螺丝刀(使用其它型号螺丝刀头会有拧花螺丝帽的风险,请勿特别注意)。拧开螺丝后,从下端左右两角使用撬片沿接缝边缘划开,即可卸下后盖。开盖后对主板接口的任何操作前,请务必断开电池排线,以防静电或短路损坏主板,同时请在BIOS设置或管家中关闭开盖即开机功能后再打开后盖,切记!!!

内存方面:搭载16G板载内存(颗粒在主板的另一面),对于绝对大多数小伙伴来说未来三至五年是足够用的,不用考虑扩容问题。

硬盘方面:搭载1条512G容量NVME协议的2280固态,与intel版产品略有不同,AMD版精心在散热模组右侧预留了一个2242尺寸的硬盘扩容位,同样支持PCIe 3.0 x4。在不用替换原有硬盘的前提下,可以直接扩展1块固态硬盘,省去了重新安装系统以及迁移数据的麻烦。经测试西数SN520固态硬盘跟本品存在兼容性问题,而三星PM991固态硬盘(是2242尺寸的PM991,不是981)可以完美兼容。

【适用人群】

1.预算4000元左右;

2.喜欢金属材质机身;

3.轻中度办公或轻度游戏;

4.商务办公环境中使用轻薄本。

【外观】

与以往的小新家族产品不同,本次首次在小新产品(5系)中引入了以前在7系甚至9系YOGA中才敢使用的深灰配色(小新官方称其为:深空灰),颜值和气质兼备,适用于办公商务环境,更为稳重。

键盘采用三档白色背光,键程达到了1.3mm,打字更为舒适。细心的小伙伴们没觉得吗,这回外壳配色和键盘颜色几乎一致,完美融合。ESC键和FnLock键二合一,可不进入BIOS就可将键盘的首行按键功能默认指定为F1-F12或是功能热键。F12右侧的带S的五角星键为超级功能键,在Windows中可一键启动联想电脑管家(若卸载了管家,则按键不起任何作用),在关机状态下按动可达到用取卡针扎一键恢复按钮的功效(取卡针并不能随身携带,且这个恢复孔除了系统恢复外,还有进入BIOS设置以及选择引导设备的菜单)。为照顾习惯使用ThinkPad键盘布局的小伙伴,可以对调Fn键和左Ctrl键的定义(具体需要在BIOS设置中更改)。

触控板长105mm,宽63mm,可搭配专为本品设计的小新智能键盘R4,只需轻轻一扫就能呼出数字小键盘或者计算器,有效提高学习工作效率。

键盘两侧各有一个2W杜比音效扬声器,至于音质,身临其境。

屏幕可以单手开合(最大开合角度约135°)。屏幕边框依旧是四边窄,两侧宽度2.7mm,上边框宽度7.2mm,下巴宽度8.4mm。屏幕上端为带物理防窥拨片开关(类似ThinkBook的黑阀)的720P高清摄像头模组。

屏幕素质划重点:100% sRGB(典型值)、DC调光、300尼特、IPS雾面屏。

据我了解,联想是2019年业界首款将DC调光屏幕引入笔记本电脑的厂商,即使在灯光较暗或者电池续航的情况下也看不到屏闪,有效避免长时间盯着屏幕眼睛疲劳的现象。100% sRGB高色域屏真实地还原了图像的色彩,更为艳丽逼真。与小新Pro-13的镜面屏不同,Air14选用了表面经过防眩光处理的雾面屏,不会反光,也能有效保证个人隐私。

散热方面,本品采用5V电压“TYPHOON”大体积风扇(这点与intel版的12V风扇不同,毕竟没有独立显卡)及双热管散热设计,降低噪音的同时还能保持散热水平不受影响。值得一提的是本品使用了游戏本上才使用的信越7921硅脂,正是这强大的散热设计和硅脂组合,为后面的“搞事情”做足了功课。

产品背面有两排散热孔(内部安装有防尘网),除此以外还有一条长长的脚垫,除了拎起机器防滑外,还可垫高机器,让D面与桌面保持一定角度有利于散热,有效阻止屏幕转轴处排出的热风回流至散热孔,设计颇为巧妙。

2020年发布的小新Air14新品支持开盖即开机(当然也可禁用,采用传统的电源按键开机)。电源按键和指纹二合一,只需扫描指纹就可一步完成开机加系统登录。在Windows锁屏画面中,若需读取指纹信息,电源键盘的橙色指示灯会闪亮,提醒进行扫描。

Air14搭载了56.5Wh的三芯大容量电池(平均续航时间不少于12小时,1小时可以充80%的电量)结合65W大功率Type-C PD快充电源,它也兼容市面上主流的Type-C接口PD协议便捷充电头和移动电源。因采用金属机身,故采用带有接地功能的三脚插头,缺乏便携性,如有移动办公需求的小伙伴,强烈推荐使用YOGA电源适配器(文末附有产品链接)。

接口方面:左侧有一个全功能USB Type-C接口(充电及数据传输)、HDMI接口、耳机麦克二合一接口、一键恢复孔及电源指示灯。右侧有两个USB 3.2 Gen1接口和一个全尺寸SD读卡器。若有更多接口扩展需求的小伙伴可以考虑联想扩展坞(文末同样给出产品链接)。

说完了外观,再来聊聊直接跟数据打交道的内存和硬盘。

内存为16G DDR4 3200MHz板载内存,不可扩充更换。不承诺使用具体哪个供应商的物料,因产品批次不同可能会选用不同供应商的内存颗粒(但就同一台机器的主板来说,它所用的内存颗粒都是同厂商同型号的)。什么三星、镁光、海力士、记忆科技啥的在我看来,性能真的没啥差异。内存质量不是看品牌,最主要是看频率。

固态硬盘同样不承诺具体使用什么品牌,尽管我评测的这台搭载的是三星PM981a,但我之前几台小新上搭载的西数SN730,忆联AH530以及R7000上的海力士PC611性能也很棒,尤其是西数SN730。关于SSD性能也没啥好测的,PM981a跑分多少小伙们早已心知肚明(性能表现非常出众),这里就不测它了。

【跑分】

如果说刚才没有啥太诸位期待的内容,接下来嘛……

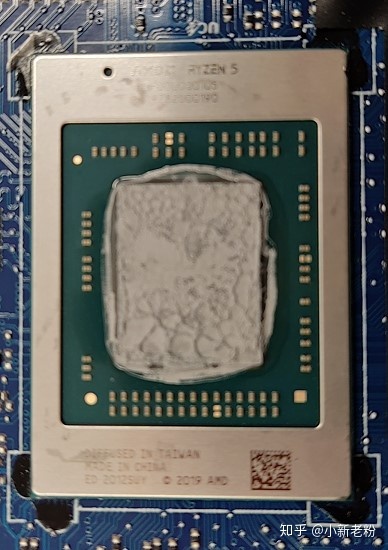

先来个爆照,再看下这款AMD Ryzen R5 4600U CPU的参数:

代号:Renoir(从3000系移动端CPU开始,AMD的产品代号跟画家干上了,上一代是毕加索)

制程:7nm

核心数:6

线程数:12

封装接口:BGA封装FP6接口

基准频率:2.1GHz

最大加速频率:4.0GHz

AMD建议TDP:15W

Air14释放TDP:约26W

这26W的功耗,目前只有联想小新家族敢这么搞(小新15是35W,小新Pro13可达到37.5W),别的厂商想都不敢想,如此给力的性能释放得意于本文一开头说的散热设计。

看了半天我在这唠叨,小伙们可能乏了,来做个游戏舒缓一下,数数任务管理器中有多少个框框?设备管理器中有多少行CPU?(什么,叫行?难道叫个?还是叫颗?还是叫核?GKH哥科喝都来了,拼音早晚被我玩坏)

AMD Yes可不乱叫,性能怎么样,是骡子是马总要拉出来溜溜,一切用分数来说话。

CPU-Z读出的CPU基本信息(CPU的接口为FP6,与Ryzen 3000的FP5不同,这里属于识别错误):

CPU-Z跑分情况:单核成绩484分,优于自家台式机上的8核16线程的第一代标压锐龙处理器R7 1700,多核成绩3934分,跟它打了个平手。

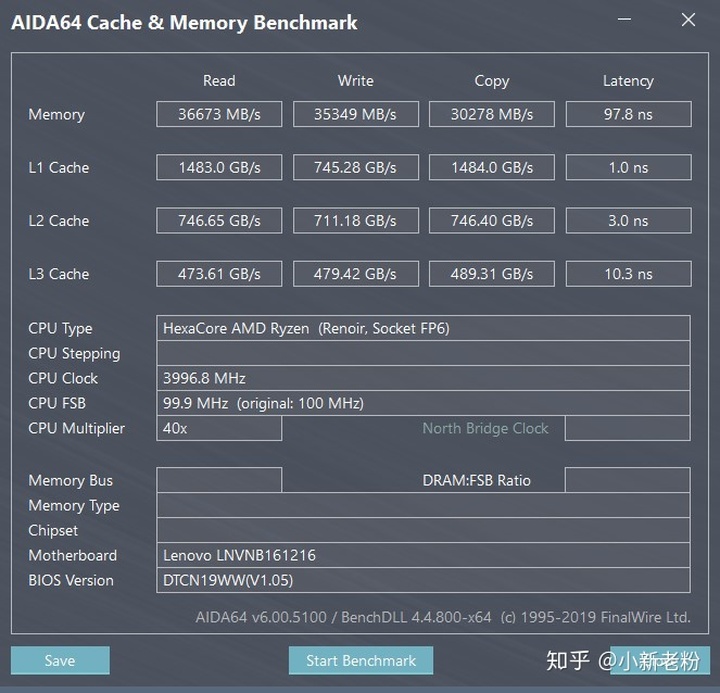

AIDA64对CPU基本信息的识别(这回可算把接口识别正确了):

AIDA64对内存和缓存的评分:内存延迟为97.8ns,较intel Ice Lake版增加了18ns,而L1、L2、L3缓存的延迟分别较intel Ice Lake版减少了0.4ns、0.7ns、4.1ns。

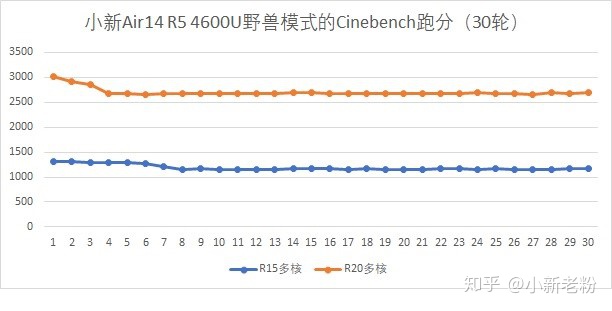

为适用于不同的应用场景,本品采用智能调节技术根据功耗将性能释放由高到低划分为野兽模式(功耗约26W、频率约3.0GHz、温度约81℃)、智能模式(功耗约19W、频率约2.8GHz、温度约70℃)、节能模式(功耗约12W、频率约2.2GHz、温度约52℃),可在高性能和长续航之间由您随意选择,只需Fn+Q即可轻松切换。每次切换过程中,屏幕上均有图标显示,或者通过点击任务栏的电池图标即可查看当前工作于哪种模式之中。

建议后续小新产品学下新款拯救者,通过电源指示灯的颜色得知工作模式。

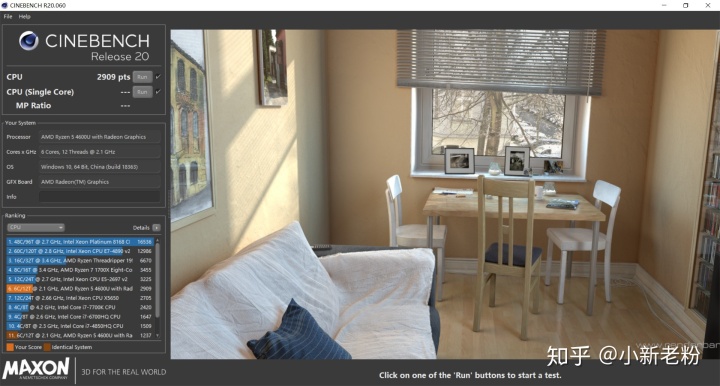

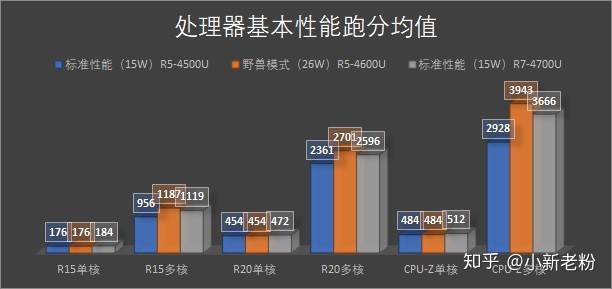

Cinebench R15多核及R20多核跑分,不难看出从第8轮到第30轮均稳定在1150分和2670分以上。

R20多核那个1237分是在未插电的节能模式下的跑分。随机抽了2张跑分过程的图。

因本品采用的R5 4600U和R5 4500U的都是6核处理器,唯一区别就是前者为12线程,后者为6线程。因此在单核方面两者跑分差异不显著(p>0.05),在多核方面4600U吊打4500U。难道只有4500U被吊打吗?比R5 4600U编号大一号的是8核8线程的4700U,这4700U可是R7哦(卖的还贵),总应该能镇住身为R5的4600U吧?起初我也是这么想的,但事实上你和我的如意算盘都打错了,4600U在多核项目上同时也吊打4700U,有图有真相(香)。一方面得益于12线程的算力确实优于8线程,另一方面和小新研发团队的在散热功耗上的努力是分不开的。

经过比较,这AMD R5 4600U已接近友商游戏本intel i7 10750H的性能,注意后者可是i7标压,要贵至少1000大元。我们再一起喊叫一声:AMD,Yes!

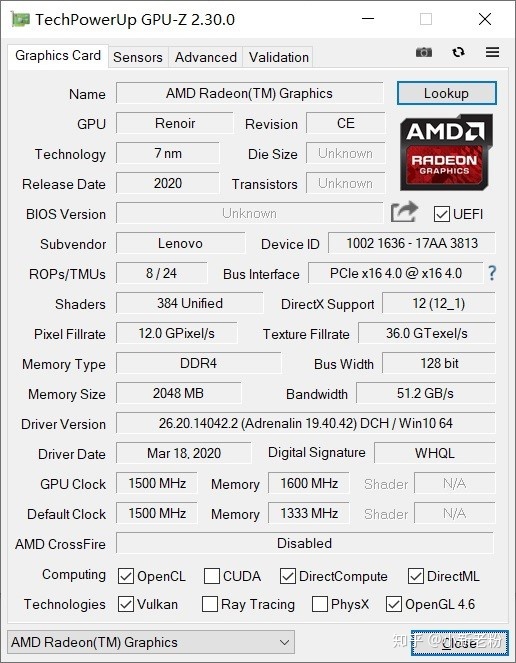

说完了CPU,再来看看CPU中集成的核显。

需要指出的是,R5 4600U中集成的是VEGA6,R7 4800U中集成的是性能更强的VEGA8。这里单说VEGA 6。

GPU-Z中检测到的显卡信息(检测到从内存中扣除显存2G,AMD默认是512M,可在BIOS设置中更改):

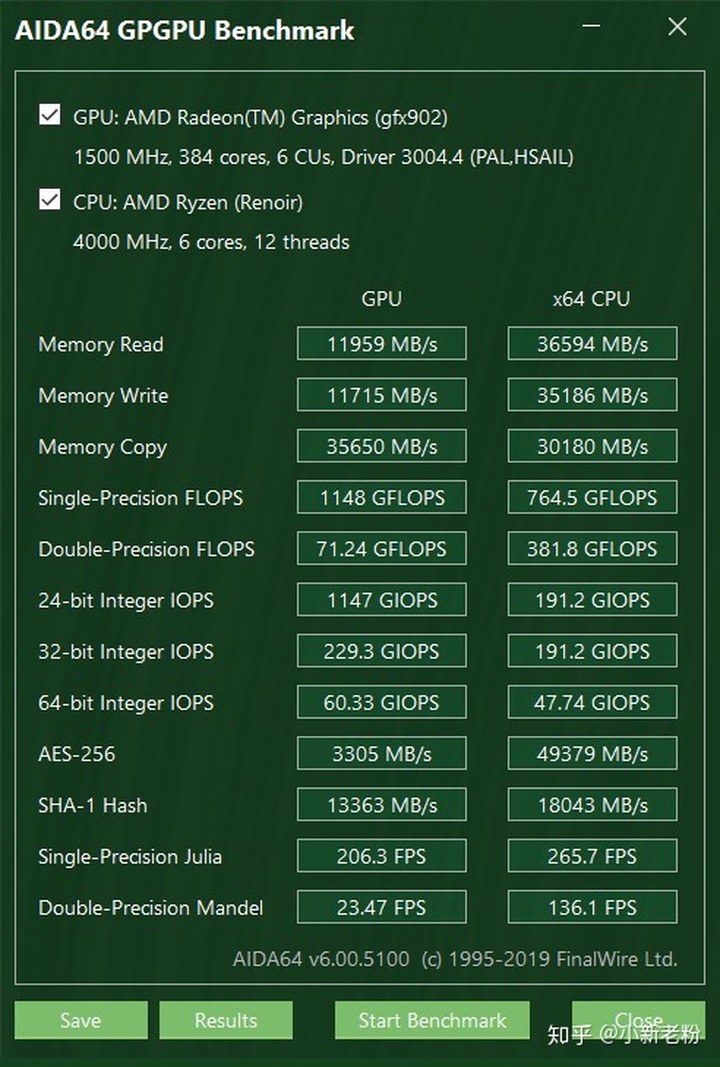

AIDA64中GPGPU的测试结果:

3DMark 11得分为P4685分,Fire Strike得分为2687分,Time Spy得分为978分。

游戏方面,轻薄本不能指望用它来运行3D大作,不过LOL还是不能少的。在游戏中能达到99帧或更高,可以愉快地玩耍。

综合评估,R5 4600U核显的性能接近NVDIA MX250的水平。

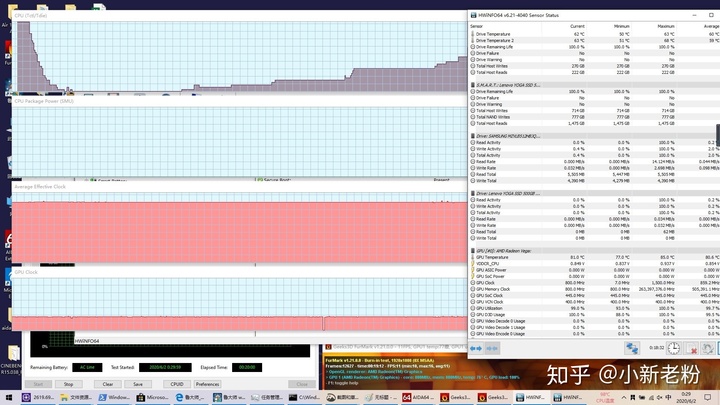

下面就到了“酷刑”阶段,使用ADIA64中的System Stability之Stress FPU和FurMark GPU Stress来进行双烤(烤鸡加烤甜甜圈,大半夜的你们碎觉我这评测,是该来点夜宵)。

初始功耗为37W,在持续3秒钟后功率降至26W,之后一直稳在26W,跑的还是蛮稳滴,几乎没有丘陵和洼地,GPU时钟频率800MHz,温度81℃。具体得分看图:

本品的硬件评测就先聊这么多,由于时间关系没有对温度和噪音进行评测。

产品特性可用九字要诀概括:好屏幕、强劲心、三模式。

软件部分请看评测的第二篇,联想社区和知乎上我的ID是小新老粉,微博上是老粉小新。

本文评测的Yes轻薄本,小新Air14 R5-4600U/16G/512G/核显,为方便小伙伴们查看产品页面,提高效率,特给出链接。

联想(Lenovo)小新Air14 2020锐龙版 全面屏金属超轻薄笔记本电脑(6核R5-4600U 16G 512G IPS高清屏 高色域)灰

联想(Lenovo)65W原装Type-C电源适配器 手机/平板/笔记本充电器 PD/QC3.0快充 便携YOGA凝脂白(1.5米线)

【联想(Lenovo)LX0808】联想 Type-C扩展坞转HDMI/VGA/千兆网口转接头 网线接口转换器苹果华为笔记本电脑拓展坞 LX0808 USB3.0HUB分线器网口网卡【行情 报价 价格 评测】-京东

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?