修改zeppelin 配置文件

在zeppelin-env.sh中添加spark路径和hadoop配置文件路径

export SPARK_HOME=/usr/lib/spark

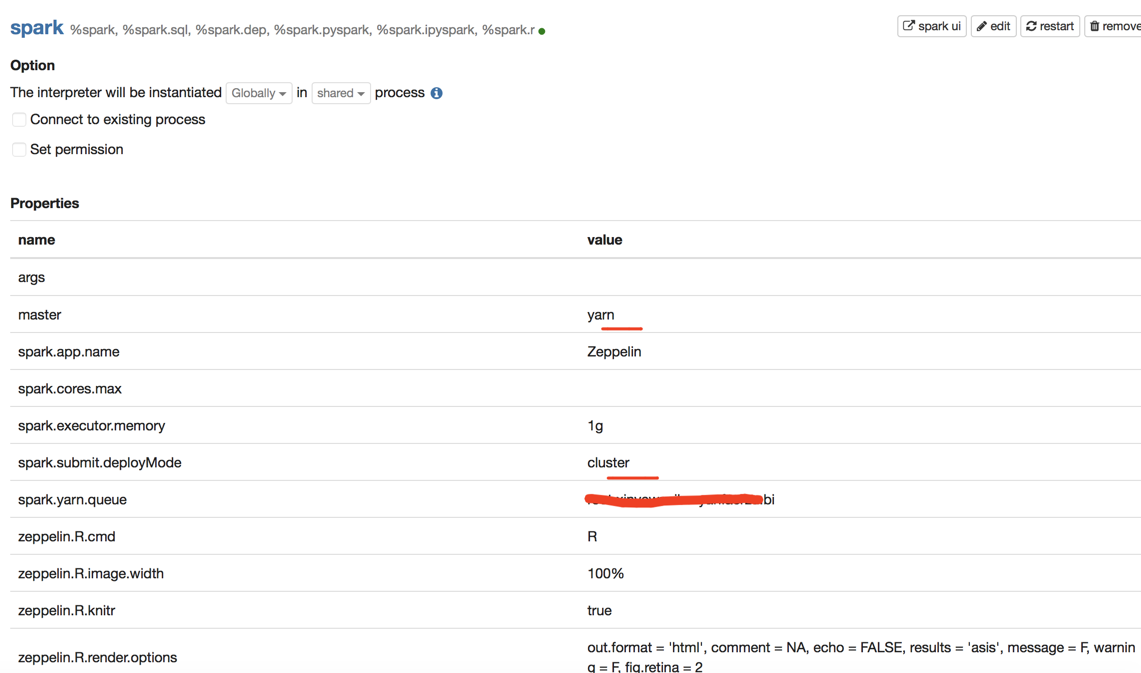

export HADOOP_CONF_DIR=/usr/lib/hadoop修改spark interpreter参数

master 可以为:

local[*] in local mode

spark://master:7077 in standalone cluster

yarn-client in Yarn client mode

yarn-cluster in Yarn cluster mode

mesos://host:5050 in Mesos cluster我这里是 spark on yarn 所以我配置的 master 为yarn,提交模式为 cluster,我设置为 client 的时候运行任务一直卡着不动

排错

我这里是在docker里搭建的,中间还报了其它的错

java.lang.RuntimeException: org.apache.zeppelin.interpreter.InterpreterException: org.apache.thrift.transport.TTransportException: java.net.ConnectException: Connection refused后来发现是AM无法实例化的原因

host -i发现docker 里是一个虚拟ip

解决方法:

启动docker时指定网络连接方式

host模式 :

docker run 使用 --net=host指定

docker使用的网络实际上和宿主机一样遗留问题

1、无法使用client模式

2、无法访问hive表

如果有知道的大佬,请指导

557

557

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?