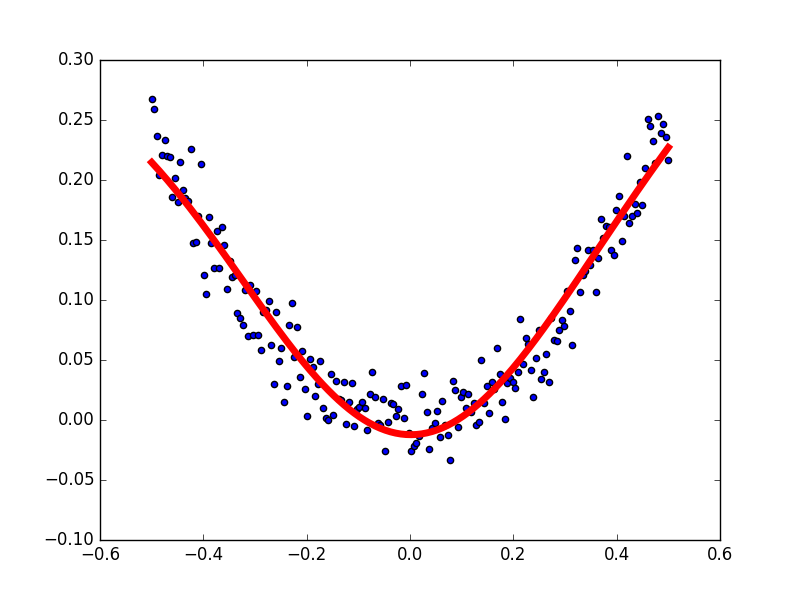

简单线性回归

import os

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

os.environ['TF_CPP_MIN_LOG_LEVEL'] = '2'

# 生成-0.5到0.5 之间的200个点,一行一个样本,200行200个样本

x_data = np.linspace(-0.5, 0.5, 200)[:, np.newaxis]

# 生成噪点

noise = np.random.normal(0, 0.02, x_data.shape)

y_data = np.square(x_data) + noise

# 定义两个占位符,多行一列

x = tf.placeholder(tf.float32, [None, 1])

y = tf.placeholder(tf.float32, [None, 1])

# 神经网络中间层,1是输入神经元个数,10个中间层神经元

weights1 = tf.Variable(tf.random_normal([1, 10]))

biases1 = tf.Variable(tf.zeros([1, 10]))

wx_plus_b1 = tf.matmul(x, weights1) + biases1

# 激活函数 tanh双曲正切函数

# L1 是中间层的输出

L1 = tf.nn.tanh(wx_plus_b1)

# 输出层,中间层10个神经元,输出层1个

weights2 = tf.Variable(tf.random_normal([10, 1]))

biases2 = tf.Variable(tf.zeros([1, 1]))

wx_plus_b2 = tf.matmul(L1, weights2) + biases2

prediction = tf.nn.tanh(wx_plus_b2)

# 二次代价函数

loss = tf.reduce_mean(tf.square(y - prediction))

# 梯度下降法

train_step = tf.train.GradientDescentOptimizer(0.1).minimize(loss)

init = tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init)

writer = tf.summary.FileWriter('logs/', sess.graph)

for i in range(4000):

sess.run(train_step, feed_dict={x: x_data, y: y_data})

# 获得预测值

prediction_val = sess.run(prediction, feed_dict={x: x_data})

# 画图

plt.figure()

plt.scatter(x_data, y_data)

# 红色实线,线宽5

plt.plot(x_data, prediction_val, 'r-', lw=5)

plt.show()

7281

7281

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?