在设计离散事件系统的控制算法时,有一种方式是用“多项式+待定系数”来“回归”出控制策略来。如果系统本身比较接近连续系统,所得到的策略可能会有极好的效果;但万一系统离散性过强,在不同的状态下有着迥异的行为,其有效策略可表示为分段函数,泰勒定理表示惶恐不能,怎么办?

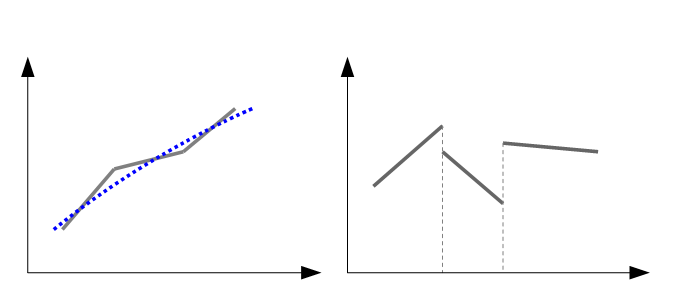

一种思路是“分段回归”:在找到断点的前提下,在各个子区间内进行回归,是一种分治法。这种方法的难点在于如何找到所有必要的断点。

另一种思路是“映射回归”(这个名字是乱起的,不一定合适):这里的“映射”可以理解为一段代码,它基于一定输入得到对应的输出,而这种方法造价于自动构造一棵“运算树”,这棵“树”里不仅包含一般的数学函数,还包含分支和循环。这种方法面临的问题也颇为棘手:“运算树”有着海量的可行空间,要找到有效的映射如大海捞针,目前并没有高效的搜索方法,与碰运气差不多。

此外,由于 Weierstrass 定理只保证连续函数的可逼近性,对于离散函数,用深度神经网络可能也会碰钉子 —— 不过我没试过。

763

763

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?