工具/原料:

hadoop2.6.4 (64位)

centos6.5x64

jdk-7u45-linux-x64.tar.gz

步骤:

四台机器(虚拟机):server ,server1,server2,server3

ip设置:

192.168.0.100

192.168.0.101

192.168.0.102

192.168.0.103

(jdk安装省略)

第一步:配置主机名,内网域名映射,ip

1.配置主机名:

vi /etc/sysconfig/network

修改为:

NETWORKING=yesHOSTNAME=server

依次修改server1,server2,server3

2.内网域名映射:

vi /etc/hosts

添加:

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4::1 localhost localhost.localdomain localhost6 localhost6.localdomain6192.168.0.100 server192.168.0.101 server1192.168.0.102 server2192.168.0.103 server3

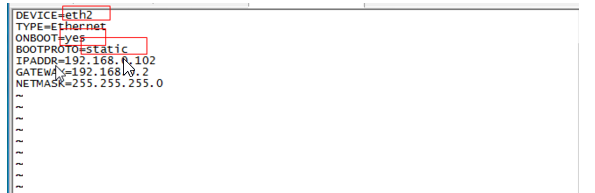

3.修改ip地址

vi /etc/sysconfig/network-scripts/ifcfg-eth0

修改:

DEVICE=eth0TYPE=EthernetONBOOT=yes #是否开机启用BOOTPROTO=static #ip地址设置为静态IPADDR=192.168.0.101NETMASK=255.255.255.0

注意:

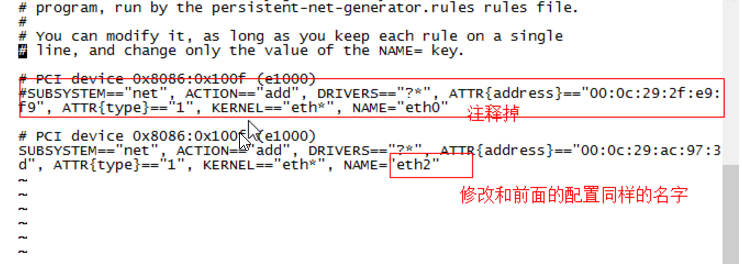

因为虚拟机占内存大,所以我是建了一个server1,server2和server3是复制server1的。因为是复制的,所以要修改网卡

步骤如下:

1.修改 vim /etc/sysconfig/network-scripts/ifcfg-eth0

2.修改 vim /etc/udev/rules.d/70-persistent-net.rules

3.一定要重启系统,重启网卡无效。

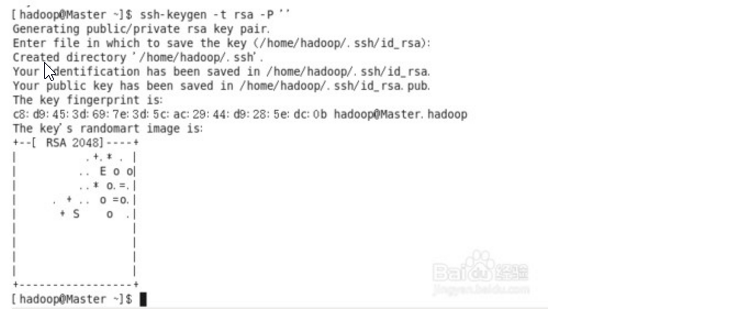

第二步:配置无密钥登录

我把server当作主的,其他的当作辅的,所以配置server到server1,server2,server3的ssh无密钥登录

步骤如下:

ssh-keygen

然后一路回车,直到看到这个

然后

ssh-copy-id 192.168.0.100

依次将server,server1,server2,server3都配置,包括server自己

第三步:配置hadoop

解压好haddop以后,

我的安装路径是:/root/apps/hadoop-2.6.4

vi /etc/profile

| # The java implementation to use. export HADOOP_HOME=/root/apps/Hadoop-2.6.4 export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin |

source /etc/profile

vihadoop-env.sh

| # The java implementation to use. export JAVA_HOME=/usr/local/jdk1.7.0_45(这是jdk安装路径) |

vi core-site.xml

| <configuration> <property> <name>fs.defaultFS</name> <value>hdfs://server:9000</value> </property> <property> <name>hadoop.tmp.dir</name> <value>/root/apps/hadoop-2.6.4/tmp</value> </property> </configuration> |

vi hdfs-site.xml

| <configuration> <property> <name>dfs.namenode.name.dir</name> <value>/root/apps/hadoop/data/name</value> </property> <property> <name>dfs.datanode.data.dir</name> <value>/root/apps/hadoop/data/data</value> </property>

<property> <name>dfs.replication</name> <value>2</value> </property>

<property> <name>dfs.secondary.http.address</name> <value>server:50090</value> </property> </configuration> |

vi mapred-site.xml

| <configuration> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property> </configuration> |

vi yarn-site.xml

| <configuration> <property> <name>yarn.resourcemanager.hostname</name> <value>server</value> </property>

<property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> </configuration> |

vi slaves

|

server1 server2 server3 |

拷贝到每一台机器上

scp -r apps server1:/home/hadoop/

至此,就算完成了

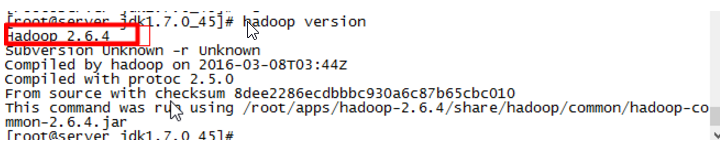

验证一下

hadoop version

祝贺你,hadoop安装成功!

在这里有一点:

我在安装的过程遇到了这个问题:

就是hadoopdeep环境变量虽然配置了,但是hadoop命令不管用,提示:

Hadoop command not found

对于这个问题的解决方法是:

编辑这个文件

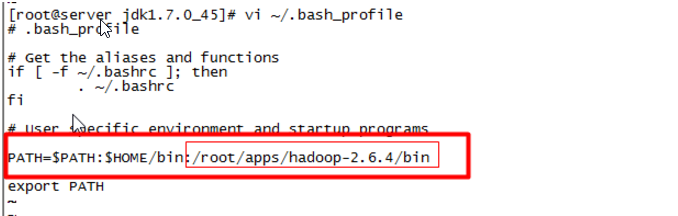

vi ~/.bash_profile

在这里加上hadoop的安装路径

重启系统,问题解决。

3337

3337

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?