本篇文章只做知识的搬运工。

本文目录:

点估计:极大似然估计,最小二乘估计,贝叶斯估计。

区间估计:正态总体且方差已知,或非正态总体、大样本,方差未知;正态总体、方差未知、小样本;总体比例的区间估计; 大样本不重复抽样估计;总体方差的区间估计;

样本量确定:估计总体均值时样本量的确定,估计总体比例时样本量的确定

参数估计包括点估计和区间估计两类。

点估计

点估计(point estimate)是用样本统计量的某个取值直接作为总体参数的估计值。例如,用样本均值x直接作为总体均值μ的估计值,用样本方差s2直接作为总体方差σ2的估计值。点估计的方法有:矩估计法、顺序统计量法、最大似然法、最小二乘法、贝叶斯估计法。

这篇文章主要介绍极大似然估计,最小二乘估计,贝叶斯估计。

勒让德的最小二乘法

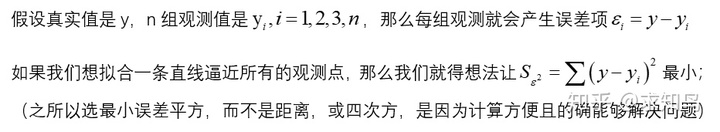

最小二乘法是一种数学优化技术,它通过最小化误差的平方和寻找数据的最佳函数匹配。

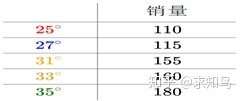

我们来理解最小二乘回归的本质:

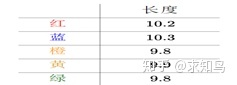

我们得到n组观测值,但真实值只有一个,该如何办?

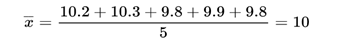

首先想到的是取n组观测值的平均值来当作“真实值”,这样靠谱吗?

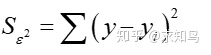

就有人(勒让德)提出最小二乘的思路:

于是,我们对y求导

碰巧,算术平均数可以让误差最小!

接下来,对最小二乘进行扩展:

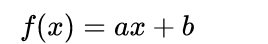

可以假设这条直线的方程是:

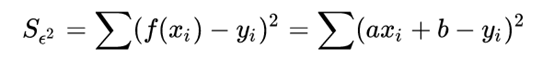

然后用最小二乘回归的思路:

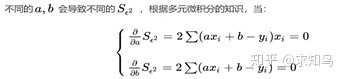

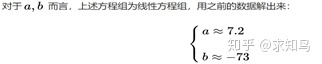

然后对a,b求偏导数求误差平方和的最小值:

一次函数,二次函数都是线性函数!都可以通过解线性方程组来求解!

以上这一套操作,都是假设啊,这时候勤学爱问的高斯就站出来了:

他用另一套思路来回答这个问题!

勒让德用误差平方和最小来拟合直线:

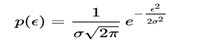

现在可以来解这个微分方程了。最终得到:

这不就是我们的正态分布密度函数吗!

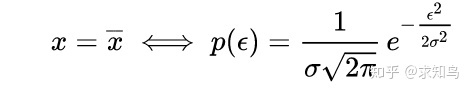

并且这还是一个充要条件:

也就是说,如果误差项服从正态分布,那么最小二乘估计就是完美的!

那么误差项服从正态分布吗?

如果误差项是随机产生的,那么根据中心极限定律,误差的分布就服从正态分布!

由此,勒让德虽然提出了最小二乘的思路,但真正使它发扬光大的是高斯,高斯的努力,才真正奠定了最小二乘法的重要地位。

学术上使用最小二乘估计一般遵循这样:

求知鸟:关于统计学的思考(2)zhuanlan.zhihu.com

最小二乘估计的前提:随机误差项满足正态分布!最小二乘估计一般用在线性回归中,用来估

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1317

1317

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?