学习目录

目录:

1、推导LR损失函数(1)

2、学习LR梯度下降(2)

3、Softmax原理(3)

4、softmax损失函数(4)

5、softmax梯度下降(5)

1、推导LR损失函数

逻辑回归中选择 Sigmoid函数作为预测函数。

Sigmoid函数:

g

(

z

)

=

1

1

+

e

−

z

g(z)=\frac{1}{1+e^-z}

g(z)=1+e−z1

由这个函数可得:当z趋于正无穷时,g(z)趋于1,而当z趋于负无穷时,g(z)趋于0。

对该函数求导有:

g

′

(

z

)

=

g

(

z

)

(

1

−

g

(

z

)

)

g'(z)=g(z)(1-g(z))

g′(z)=g(z)(1−g(z))

具体推导过程参考先前文章。

# Sigmoid曲线:

import matplotlib.pyplot as plt

import numpy as np

def Sigmoid(x):

return 1.0 / (1.0 + np.exp(-x))

x = np.arange(-10, 10, 0.1)

h = Sigmoid(x) # Sigmoid函数

plt.plot(x, h)

plt.axvline(0.0, color='k')

plt.axhline(y=0.5, ls='dotted', color='k')

plt.yticks([0.0, 0.5, 1.0]) # y axis label

plt.title(r'Sigmoid函数曲线', fontsize = 15)

plt.text(5,0.8,r'$y = \frac{1}{1+e^{-z}}$', fontsize = 18)

plt.show()

2、学习LR梯度下降

- 随机梯度下降法(

Θ

j

\Theta j

Θj)推到:

- 梯度下降代码实现:

- LR算法实现及分析

在这里插入代码片

3、Softmax原理

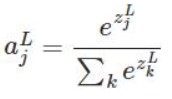

softmax的函数公式:

387

387

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?