曾梦想执剑走天涯,我是程序猿【AK】

简述概要

了解梯度提升树(GBDT)

知识图谱

梯度提升树(Gradient Boosting Decision Tree,简称GBDT)是一种集成学习算法,它通过结合多个决策树(通常是CART树)来提高预测性能。GBDT 是梯度提升(Gradient Boosting)算法的一种实现,它在各种机器学习竞赛和实际应用中都取得了显著的成绩。

基本原理:

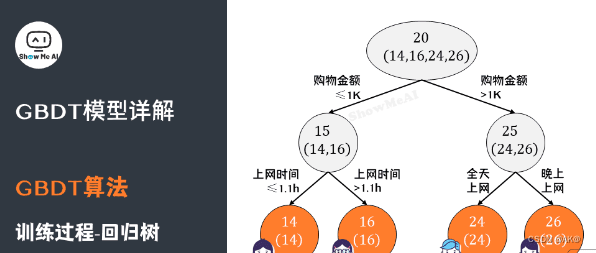

GBDT 的核心思想是迭代地构建一系列决策树,每一棵树都尝试纠正前一棵树的预测错误。在每一轮迭代中,算法会计算当前模型的负梯度(损失函数的梯度),然后在这个负梯度的基础上训练一棵新的决策树。新树的输出会与前一轮的输出相加,形成下一轮的模型。这个过程会重复进行,直到达到预定的迭代次数或者模型的性能不再显著提升。

算法步骤:

- 初始化:使用一个基准预测(如均值或中位数)作为初始模型。

- 迭代:对于每一轮迭代 t(t=1,2,…,T):

- 计算当前模型的负梯度(损失函数的梯度)。

- 在负梯度的基础上训练一棵新的决策树。

- 更新模型:将新树的输出乘以学习率(通常小于1)后与当前模型相加。

- 输出:最终模型是所有决策树输出的加权和。

损失函数:

GBDT 通常使用平方损失(Squared Loss)或对数损失(Log Loss)作为损失函数。在分类问题中,可以使用逻辑损失(Logistic Loss)或交叉熵损失(Cross-Entropy Loss)。

应用场景:

GBDT 在许多领域都有广泛的应用,包括但不限于:

- 信用评分:预测客户的信用风险。

- 保险定价:根据客户特征估计保险费用。

- 股票市场分析:预测股票价格或市场趋势。

- 推荐系统:根据用户行为预测用户可能感兴趣的项目。

- 能源消耗预测:预测建筑或设备的能源需求。

- 生物信息学:基因表达数据分析,疾病预测等。

主要解决的问题:

GBDT 主要解决的是回归问题,但它也可以通过引入二分类损失函数来解决分类问题。GBDT 能够处理各种类型的数据,包括数值型和类别型特征。它对于特征的分布没有严格的假设,因此可以很好地处理实际数据中的复杂关系。

优点:

- 强大的预测能力:GBDT 在许多机器学习竞赛中表现优异。

- 灵活性:可以处理各种类型的数据和复杂的关系。

- 可解释性:虽然不如单一决策树那样直观,但GBDT 的决策过程仍然具有一定的可解释性。

缺点:

- 计算成本:训练GBDT模型可能需要较长的时间,尤其是在数据集很大或迭代次数很多的情况下。

- 过拟合风险:如果不适当调整参数,GBDT 容易过拟合。

- 调参复杂:GBDT 有许多超参数需要调整,如树的数量、树的最大深度、学习率等。

在实际应用中,为了提高GBDT的性能,通常需要进行特征工程、超参数调优和模型验证。在Java中,可以使用如XGBoost、LightGBM等库来实现GBDT。

推荐链接:

梯度提升技术

CS229 - 监督学习速查表(Supervised Learning)

梯度提升树(Gradient Boosted Trees):模型理解

机器学习 | 详解GBDT梯度提升树原理,看完再也不怕面试了

---- 永不磨灭的番号:我是AK

1084

1084

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?