如题。

我指的本地,是指数据存放在windows系统的磁盘里,那如何把数据进行上传到hive表呢?为了后续的数据分析。

1、数据文件上传linux服务器

先找到一台能登录hive、hdfs的服务器终端,登录上去,切换成hdfs用户: su - hdfs

2、上传文件至hdfs :rz 上传

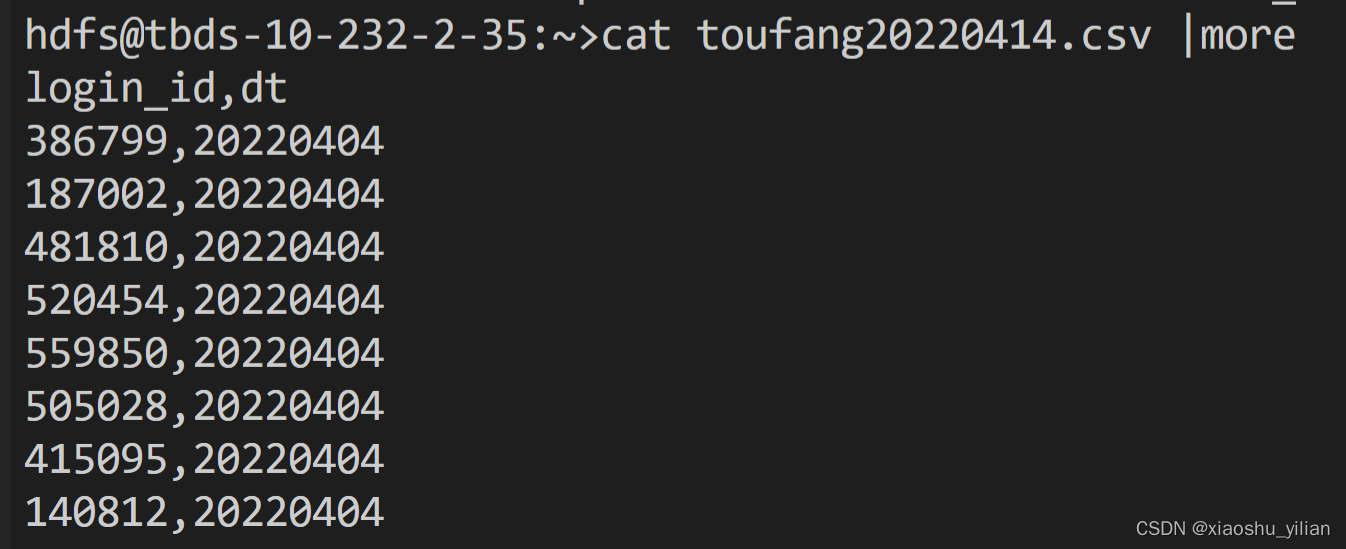

3、上传了之后查看下数据格式是否正确:

我这里数据只有两个字段,以逗号为sep,以防索引保留下来,可以这样保留你的csv数据,data.to_csv(’./toufang20220414.csv’,index=None)

4、把服务器本地文件上传hdfs :

hdfs dfs -put /home/hdfs/toufang20220414.csv “hdfs dir”

在此之前,有些公司对于文件上传至hdfs有权限要求,遵循即可。

5、登录hive,把hdfs文件数据上传至hive表

load data inpath “hdfs dir”+toufang20220414.csv’ OVERWRITE into table temp.temp_toufang_test_20220414

在此之前要先建一张hive表:

create table temp.temp_toufang_test_20220414

(login_id string,

dt bigint

) row format delimited fields terminated by ‘,’

完毕!

3095

3095

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?