RL进阶原理

文章平均质量分 94

强化学习进阶原理。

小小何先生

总是感觉自己是个英雄,还很帅!

展开

-

多智能体强化学习(二) MAPPO算法详解

文章目录PPO实战技巧(未写完)MAPPO算法伪代码详解MAPPO实战技巧参考 MAPPO论文全称为:The Surprising Effectiveness of MAPPO in Cooperative, Multi-Agent Games 官方开源代码为:https://github.com/marlbenchmark/on-policy 这篇文章更多的提出的是一些工程上的trick,并且有较详细对比协作式多智能体的一些文章。 多智能体强化学习算法大致上可以分为两类,中心式和分散式。中原创 2021-05-26 18:37:27 · 23775 阅读 · 35 评论 -

多智能体强化学习(一) IQL、VDN、QMIX、QTRAN算法详解

文章目录独立Q学习值分解网络QMIX思考参考 QMIX论文全称为:QMIX: Monotonic Value Function Factorisation for Deep Multi-Agent Reinforcement Learning 一个完全合作式的多智能体任务(我们有n个智能体,这n个智能体需要相互配合以获取最大奖励)可以描述为去中心化的部分可观测马尔可夫决策模型(Dec-POMDP),通常用一个元组GGG来表示:G=⟨S,U,P,r,Z,O,n,γ⟩G=\langle S, U, P原创 2021-05-25 21:05:24 · 12685 阅读 · 7 评论 -

【RLchina第六讲】Imitation Learning

文章目录Imitation LearningBehavior cloningApprentice LearningGenerative Adversarial Imitation Learning 本文与原视频部分内容有些出入,我觉得应该是老师讲错了。。。。不喜勿喷! 监督学习的优化目标可以写成如下形式:θ∗=argminθ∑i∥f(xi∣θ)−yi∥+∥θ∥\theta^{*}=\arg \min _{\theta} \sum_{i}\left\|f\left(x_{i} \mid \the原创 2021-05-04 20:15:58 · 472 阅读 · 0 评论 -

【RLchina第五讲】Control as Inference

文章目录概率图基础强化学习与概率图的连接最大熵强化学习和变分推断Soft Q-LearningSoft Actor-Critic概率图基础 概率图模型就是用图的结构来表示多个随机变量的联合概率分布(joint probability distribution), 上图是一个有向图模型,箭头表示变量之间的相互依存关系。有向图模型的联合概率分布可以表示为父节点条件下的条件概率乘积 p(x)=∏k=1Kp(xk∣pak)p(\mathbf{x})=\prod_{k=1}^{K} p\left(x_{k原创 2021-02-24 21:53:42 · 821 阅读 · 2 评论 -

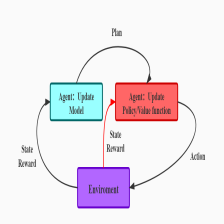

【RLchina第四讲】Model-Based Reinforcement Learning

文章目录Model-Based Reinforcement learningModel-Free RL V.S. Model-Based RLModel-Based RL:Blackbox and WhiteboxIntroduction to MBRL from DynaShooting methods:RS,PETS,POPLINRandom Shooting(RS)PETS:Probabilistic Ensembles with Trajectory SamplingPOPLINTheoretic原创 2021-02-23 11:23:42 · 2667 阅读 · 0 评论 -

【RLchina第二讲】 Foundations of Reinforcement Learning

文章目录策略方法VIPIComputational learning theoryTheoretical analysisApproximate dynamic programmingPerformance boundsSample complexity推荐书籍 所有强化学习的方法无外乎两个近似的东西: 一个是sample的性质,我们不可能把所有的state-action遍历,就有function approximation的方法。而近似的方法,会衍生出另外一个问题,sample complex的问原创 2020-09-02 21:38:19 · 565 阅读 · 0 评论 -

【RLchina第二讲】汪军老师推荐的强化学习理论学习资料

推荐书籍machine learning and learning theory books1. Mehryar Mohri, Afshin Rostamizadeh, and Ameet Talwalkar. Foundations of machine learning. MIT press, 2018. 22. Shai Shalev-Shwartz and Shai Ben-David. Understanding machine learning: From theory to algori原创 2020-09-02 21:38:29 · 748 阅读 · 0 评论 -

强化学习进阶【逆强化学习】

最早的模仿学习是行为克隆,行为克隆的方法只能模仿轨迹,无法进行泛化。而逆向强化学习是从专家(人为)示例中学到背后的回报函数,能泛化到其他情况,因此属于模仿到了精髓。[1] Apprenticeship learning via inverse reinforcement learning (2004年学徒学习)[2] Maximum Margin Planning (2006年 最大边际规划)[3] Inverse reinforcement learning through structur原创 2020-08-28 11:03:44 · 6571 阅读 · 4 评论 -

模仿学习简介

什么是模仿学习? 模仿学习(Imitation Learning):Learns from expert demonstrations 。也就是基于这些专家经验数据进行学习。Given only the trajectories from expert,The reward function is not available。 难点就是没有reward 如果人为构建reward的话,它很难...原创 2020-08-28 11:09:53 · 2342 阅读 · 0 评论 -

多智能体强化学习

当整个强化学习系统存在多个智能体的时候,我们称作多智能体强化学习。强化学习中智能体与环境交互获得数据以及一些反馈信号,通过不断的交互和反馈信号最终达到控制目标。 那如果是Multi-Agent的话,从一个Agent角度来看,环境当中还会存在其它Agent,环境中的Agent也在执行强化学习算法。这样的环境我们称作Non-stationary environment,也就是说环境中的分布、s...原创 2020-08-28 11:07:17 · 3925 阅读 · 2 评论 -

Soft Value function基础和Soft Q Learning中Policy Improvement 证明

本文主要是来自Reinforcement Learning with Deep Energy-Based Policies文章中Appendices A的学习笔记。 本文主要证明Soft Q Learning在 maximum entropy objective中的Policy Improvement。首先我们定义一个稍微有点细致(slightly more nuanced)的最大熵目标的...原创 2020-08-28 11:06:13 · 1684 阅读 · 3 评论 -

Soft Bellman Equation and Soft Value Iteration证明

本节基础知识Soft Value function基础和Soft Q Learning中Policy Improvement 证明 首先回顾一下Soft value function的定义:Vsoffπ(s)≜log∫exp(Qsoftπ(s,a))daV_{\mathrm{soff}}^{\pi}(\mathbf{s}) \triangleq \log \int \exp \lef...翻译 2020-08-28 11:06:01 · 673 阅读 · 0 评论 -

Trust Region Policy Optimization (TRPO) 背后的数学原理

本文是自己的TRPO算法学习笔记,在数学原理推导核心部分附有自己的理解与解释。整篇文章逻辑清晰,思路顺畅。有想推导的同学可以一起学习。 TRPO和PPO都是基于Minorize-Maximization MM的算法。Surrogate function RL中期望maximizing the expected discounted rewards,期望折扣奖励 η\etaη 可用如下...翻译 2020-07-31 14:23:00 · 856 阅读 · 1 评论 -

如何通俗易懂地理解基于模型的强化学习?

Model Free Reinforcement Learning(MFRL)算法:MFRL中无须知道Transition或者Reward Models。解决这类问题的方法大体上有三种:Value-Based Method (Q-Learning)。Policy-Based Method (Policy Gradient)。Policy and Value Based Method(Actor Critic)。Model-Based基本思想 在model-based的RL方法中,需要学原创 2020-07-31 14:20:14 · 760 阅读 · 0 评论 -

强化学习中价值迭代和策略迭代各有什么优缺点?

策略迭代 策略迭代法(Policy Iteration method)是动态规划中求最优策略的基本方法之一。它借助于动态规划基本方程,交替使用“求值计算”和“策略改进”两个步骤,求出逐次改进的、最终达到或收敛于最优策略的策略序列。 我们发现如果想知道最优的策略,就需要能够准确估计值函数。然而想准确估计值函数,又需要知道最优策略,数字才能够估计准确。所以实际上这是一个“鸡生蛋还是蛋生鸡”的问...原创 2020-07-31 14:17:37 · 2607 阅读 · 1 评论 -

LQR、Stochastic Bandits、Bayesian Bandits、Contextual Bandits与基于模型的强化学习浅析

很多做基于模型的强化学习算法的学者(MBRL)都知道其与最优控制有千丝万缕的关系。那是什么关系呢? 在强化学习算法中所谓的model-based指的是控制对象(强化学习中称之为环境environment)的状态转移xt+1=f(xt,ut)x_{t+1}=f(x_{t},u_{t})xt+1=f(xt,ut) (在强化学习中用的是状态之间的转移概率)和损失函数c(x,u)c(x,u)c(x,u)(强化学习中称之为奖励,由当前状态下采取某个动作所决定)已知。 不管是最优控制还是强化学习,一切原创 2020-08-28 11:03:52 · 960 阅读 · 1 评论 -

多臂老虎机导论(二)Stochastic Bandits

问题描述如下: 算法的目标是最大化累计奖励,基于三个假设:奖励的设定遵循bandit feedback。也就是说算法只能观测到所选择动作的奖励。对于每个动作aaa,都有一个奖励分布Da\mathcal{D}_{a}Da与之对应,每次这个动作aaa被选中,反馈的奖励将会从这个分布中进行采样,并返回给算法。奖励有界 [0,1][0,1][0,1]。 往往在实际过程中更多考虑奖...翻译 2020-08-28 11:05:32 · 1148 阅读 · 1 评论 -

多臂老虎机导论(一)引言

本系列主要是上述这本Introduction to Multi-Armed Bandits的读书笔记。 多臂老虎机是一个简单但非常强大的算法框架,主要是在一段时间内不确定情况下做出决策。主要描述的是,一个算法有K个可能的动作可供选择,也就是臂,还有T轮。在每一轮中,算法选择一个臂,并为这个臂收集一个奖励。奖励是独立于某个固定的分布(即,只取决于所选的臂),但算法不知道这个分布。算法最核心...翻译 2020-05-18 14:12:18 · 902 阅读 · 1 评论

分享

分享