引自详解TF中的Embedding操作!

1、什么是embedding?

先来看看什么是embedding,我们可以简单的理解为,将一个特征转换为一个向量。在推荐系统当中,我们经常会遇到离散特征,如userid、itemid。对于离散特征,我们一般的做法是将其转换为one-hot,但对于itemid这种离散特征,转换成one-hot之后维度非常高,但里面只有一个是1,其余都为0。这种情况下,我们的通常做法就是将其转换为embedding。

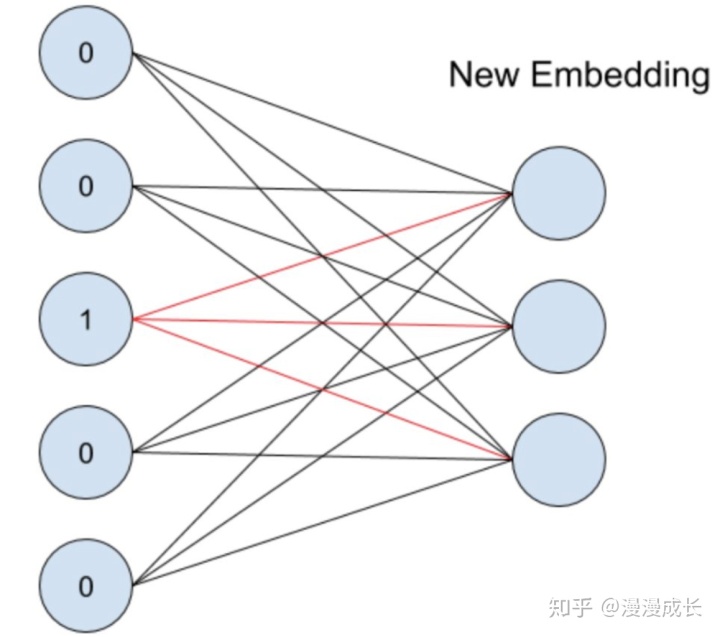

embedding的过程是什么样子的呢?它其实就是一层全连接的神经网络,如下图所示:

假设一个特征共有5个取值,也就是说one-hot之后会变成5维,我们想将其转换为embedding表示,其实就是接入了一层全连接神经网络。由于只有一个位置是1,其余位置是0,因此得到的embedding就是与其相连的图中红线上的权重。

2、tf2.0中embedding实现

在tf2.0中,embedding可以通过embedding_lookup来实现,不过不同的是,我们不需要通过sess.run来获取结果了,可以直接运行结果,并转换为numpy。

embedding = tf.constant(

[

[0.21,0.41,0.51,0.11],

[0.22,0.42,0.52,0.12],

[0.23,0.43,0.53,0.13],

[0.24,0.44,0.54,0.14]

],dtype=tf.float32)

feature_batch = tf.constant([2,3,1,0])

get_embedding1 = tf.nn.embedding_lookup(embedding,feature_batch)

feature_batch_one_hot = tf.one_hot(feature_batch,depth=4)

get_embedding2 = tf.matmul(feature_batch_one_hot,embedding)

print(get_embedding1.numpy().tolist())如果想要在神经网络中使用embedding层,推荐使用Keras:

num_classes=10

input_x = tf.keras.Input(shape=(None,),)

embedding_x = layers.Embedding(num_classes, 10)(input_x)

hidden1 = layers.Dense(50,activation='relu')(embedding_x)

output = layers.Dense(2,activation='softmax')(hidden1)

x_train = [2,3,4,5,8,1,6,7,2,3,4,5,8,1,6,7,2,3,4,5,8,1,6,7,2,3,4,5,8,1,6,7,2,3,4,5,8,1,6,7,2,3,4,5,8,1,6,7,2,3,4,5,8,1,6,7,2,3,4,5,8,1,6,7]

y_train = [0,1,0,1,1,0,0,1,0,1,0,1,1,0,0,1,0,1,0,1,1,0,0,1,0,1,0,1,1,0,0,1,0,1,0,1,1,0,0,1,0,1,0,1,1,0,0,1,0,1,0,1,1,0,0,1,0,1,0,1,1,0,0,1]

model2 = tf.keras.Model(inputs = input_x,outputs = output)

model2.compile(optimizer=tf.keras.optimizers.Adam(0.001),

#loss=tf.keras.losses.SparseCategoricalCrossentropy(),

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

history = model2.fit(x_train, y_train, batch_size=4, epochs=1000, verbose=0)

1708

1708

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?