Email:ht0909@mail.ustc.edu.cn

原创内容,转载请标明,本文主要介绍CART的剪枝部分,其他内容比较简单

参考:《统计学习方法》李航

一. ID3和C4.5算法

ID3算法的核心是在决策树各个结点上应用信息增益准则选择特征

C4.5算法是应用信息增益比来选择特征

信息增益的相关知识可参考我的另一篇文章,不过多阐述

黑夜不再来:决策树(一)熵、条件熵、信息增益zhuanlan.zhihu.com

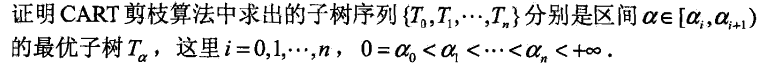

二.CART算法

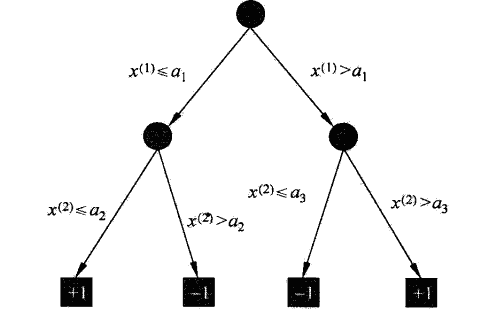

CART生成分为回归树的生成和分类树的生成,对回归树用平方误差最小化准则,对分类树用基尼指数最小化准则,进行特征选择,生成二叉树

- 回归树生成

可参考下面这个博客

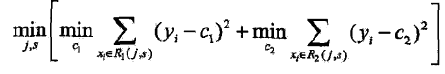

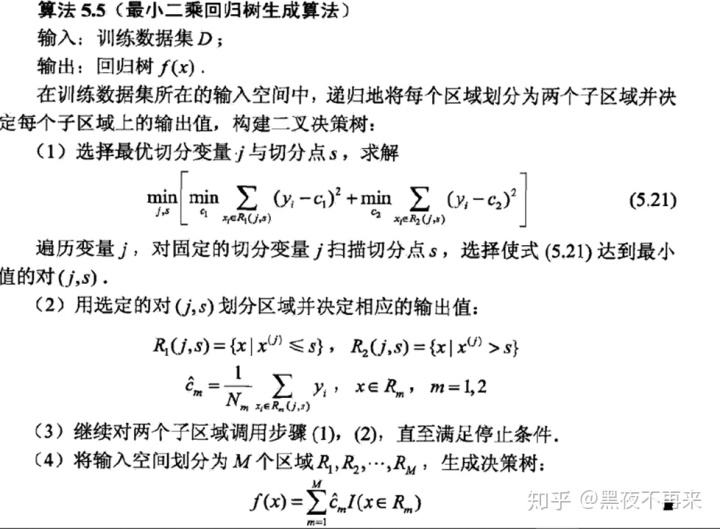

https://blog.csdn.net/weixin_40604987/article/details/79296427blog.csdn.net选择第j个变量x(j)和它取得值s,作为切分变量,将输入空间切分为两个区域,分别在两个区域内求均值

寻找最小平方误差的变量和切分值即可。

- 分类树生成

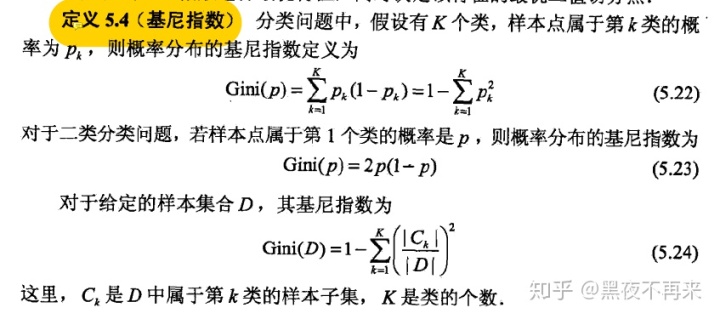

CART分类树生成采用基尼指数选择最优特征,同时决定该特征的最优二值切分点

CART剪枝

先参考《统计学习方法》

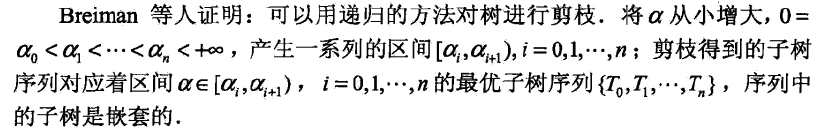

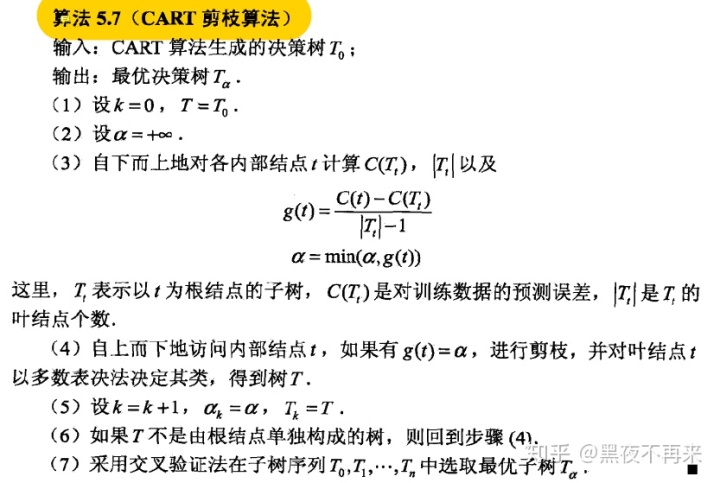

CART剪枝算法由两步组成:首先从生成算法产生的决策树

这里的关键就在于如何剪枝得到合适的子树序列。

这是代价复杂度剪枝的核心思想

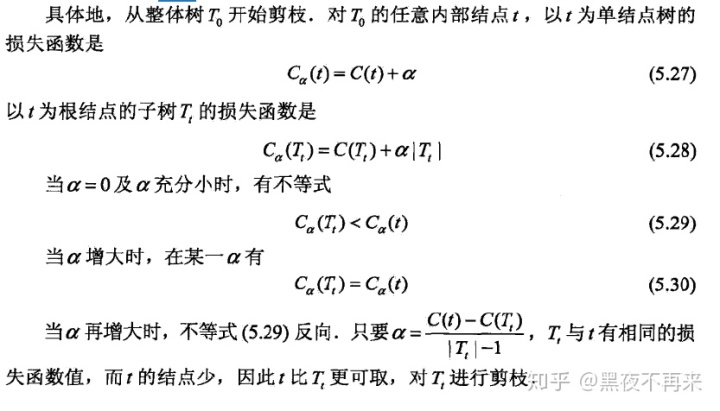

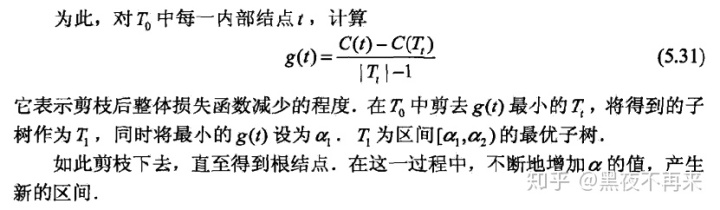

我们每次剪枝剪的都是某个内部节点的子节点,也就是将某个内部节点的所有子节点回退到这个内部节点里,并将这个内部节点作为叶子节点。因此在计算整体的损失函数时,这个内部节点以外的值都没变,只有这个内部节点的局部损失函数改变了,因此我们本需要计算全局的损失函数,但现在只需要计算内部节点剪枝前和剪枝后的损失函数。

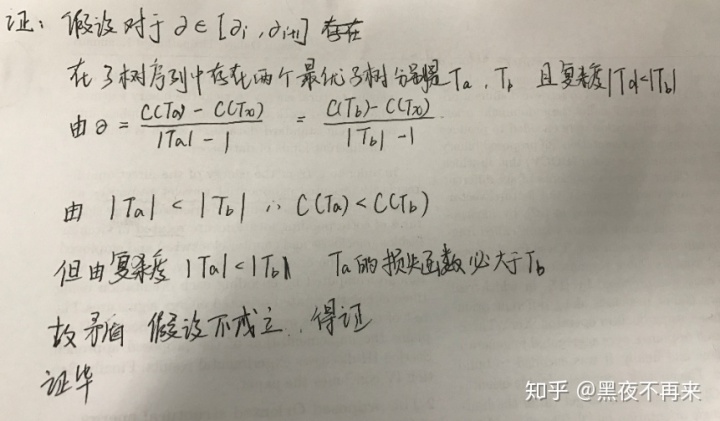

课后习题5.4:

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?