写在前面

这篇文章将从3个角度:加权、模版匹配与几何来理解最后一层全连接+Softmax。掌握了这3种视角,可以更好地理解深度学习中的正则项、参数可视化以及一些损失函数背后的设计思想。

全连接层与Softmax回顾

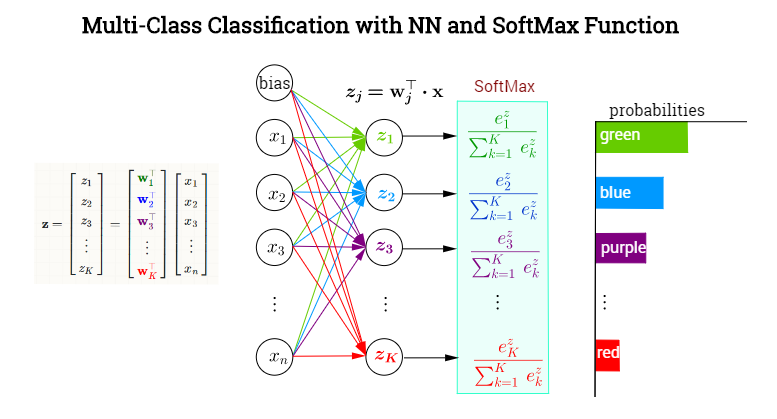

深度神经网络的最后一层往往是全连接层+Softmax(分类网络),如下图所示,图片来自StackExchange。

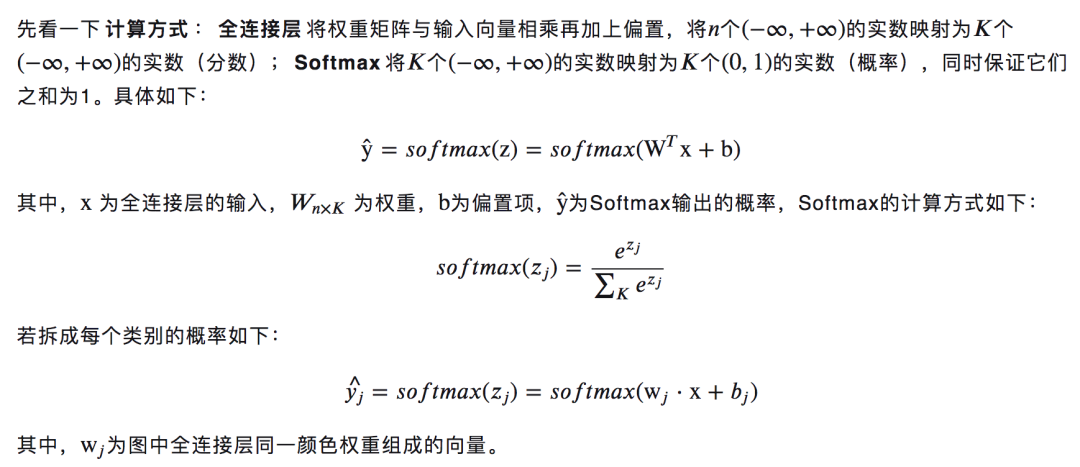

先看一下计算方式:

该如何理解?

下面提供3个理解角度:加权角度、模版匹配角度与几何角度

加权角度

加权角度可能是最直接的理解角度。

通常将网络最后一个全连接层的输入,即上面的x,视为网络从输入数据提取到的特征

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4610

4610

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?