写在前面:之前专栏的所有文章因为系统原因都被删除了,联系了知乎小管家也没有解决恢复,所以一度没有再写的打算了。但是不断的有收到挺多同学的知乎消息,所以最近打算重新写一些,让更多的同学了解三维点云的相关内容。

//-------------------------------------------绪论-------------------------------------------//

1、引言

在计算机视觉发展初期,机器对客观世界的视觉感知主要依赖相机捕获的二维图像或图像序列[1]。然而世界在欧氏空间内是三维的,图像因为仅仅捕捉了世界在某个视角下投影的信息将在对物体的尺度和几何属性表征上产生不确定性。相比之下,点云(Point cloud)作为一种最原始的三维数据表征[2]能够精准地反映物体的真实尺寸和形状结构,逐渐成为了机器视觉感知所依赖的另一种数据形式。

点云是一种由若干离散、无序、无拓扑结构的三维点组成的集合,通常是三维传感系统所获取数据的初始形式,具有抗光照和尺度变化等优点。当前主流的点云数据传感器分为两类:主动式和被动式。主动式传感器又可分为基于 TOF(Time of Flight)系统和三角测量系统两种,其中 TOF 系统通过测量所发射信号到达物体表面和返回接收器之间的时间间隔来确定传感器到物体表面的真实距离,而三角测量系统则通过两个传感器在不同地点对物体同一点之间的测量关系计算点的空间位置。被动式传感器依赖图像对或图像序列并根据相机参数来从二维图像数据中复原出三维数据。典型的主动式传感器包括 LiDAR(Light Detection And Ranging)、TOF 相机、结构光传感器等;典型的被动式传感器包括立体相机、SFM(structure from motion)系统、SFS(shape from shading)系统等。图1展示了 Velodyne 激光雷达和 ZED 双目相机以及它们捕获的点云数据。近年来,诸如微软 Kinect、谷歌 Tango 平板、英特尔 Real Sense 等廉价传感器的涌现使得点云数据的获取和图像一样便捷,进一步推动了三维计算机视觉技术的发展。

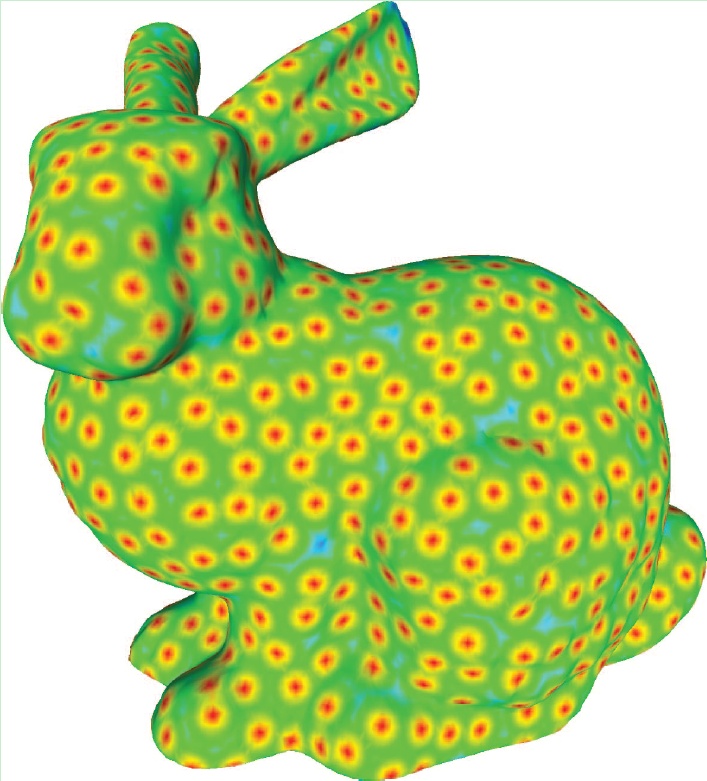

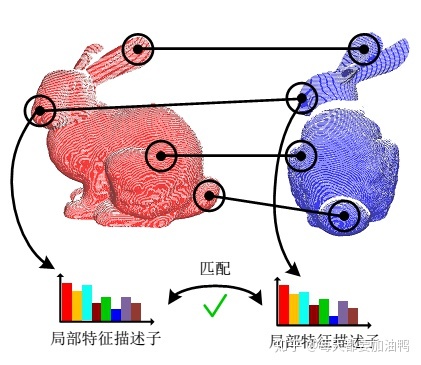

和图像感知类似,对于点云数据的感知任务包括检测、识别、分类、分割、匹配等,本专栏致力于研究点云视觉任务中一个基础而关键的问题,即点云之间点对点对应关系的建立。该问题也被称作三维点匹配问题,在计算机视觉[3,4]、计算机图形学[5,6]、遥感[7,8]、机器人[9,10]等领域均有着广泛的应用。我们以源点云和目标点云来命名两组待匹配的点云序列,当两组点云之间发生了旋转、平移等刚性变换时,我们称之为刚性点云匹配数据;当两组点云之间发生了伸缩、仿射、变形等非刚性变换时,则称之为非刚性点云匹配数据。本文研究的数据对象为刚性点云匹配数据,通常为传感器在不同视角或不同场景下捕获的刚体目标点云数据序列。对于刚性点云匹配数据之间的点对应关系建立通常包含两步:局部几何特征描述和特征匹配[11,12]。如图2所示,局部几何特征描述的目的是用一个特征向量来表征隐含在局部曲面内的空间信息和几何信息[13];特征匹配的目的是通过度量两组点云特征集中任意两个特征的相似性确定初始匹配并筛选出正确的匹配子集[14]。当点云数据体量较大时,在初始点云中检测若干稀疏且具有区分能力的关键点是一种常用的预处理方案[15]。在二十一世纪初期,曾有一系列点云关键点检测子被陆续提出, 例如三维 Harris 检测子(Harris 3D,H3D)[16] 和本征形状签名(intrinsic shape signature,ISS)[17]。但最近关于点云关键点检测子评估研究[15]指出现有的检测子在现实应用场景数据中可重复性低且较为耗时。另外,取代传统关键点检测子的均匀采样和随机采样方法在目标识别以及点云配准应用中均被证明为一种快速有效的关键点选取方式[13,18]。因此,当前的研究热点主要集中在点云局部特征描述和特征匹配两方面。对于点云局部特征描述子的质量评估主要体现在以下五个方面:

• 刚体变换不变性—当目标或者传感器进行了旋转和平移等刚体运动时,在对应点提取的局部特征应当具有不变性;

• 描述性—因为点和点之间是一一对应的,局部特征需要具有一定的鉴别能力来区分相同目标之内或不同目标之间的局部几何模式;

• 鲁棒性—局部特征需要对由于自遮挡、遮挡、嘈杂、测量距离变化等引起的孔洞、噪声、数据分辨率变化等干扰具有鲁棒性;

• 时效性— 机器人等实时性高的应用平台对于局部特征计算的速度有着严格的要求;

• 紧凑性—局部特征的紧凑性取决于其占用的内存资源,主要受特征维度和特征数据类型影响,紧凑性高的局部特征有着维度低、二值化等特点。

然而,现有的点云局部特征仍难以充分满足上述需求[19],而且对于数据模态和应用场景的变化较为敏感。对于特征匹配的质量评估一方面体现在抗离群点(错误匹配)的干扰能力,另一方面体现在匹配的效率。评估研究表明大部分现有特征匹配算法存在耗时长、对高离群点率敏感的缺陷。

为了有效解决上述问题,本专栏将致力于研究同时具有刚体变换不变性、区分性、高效、紧凑且对数据模态和应用场景变化具有鲁棒性的点云局部特征描述子以及抗高离群点率干扰能力强的高效特征匹配方法。

2、研究意义

我们首先从工程应用的角度来例证本研究所能带来的社会价值,然后分析当前点云局部特征描述与匹配领域存在的难点与挑战来表明理论研究意义。点云局部特征描述与匹配在计算机视觉、计算机图形学、机器人学、遥感等领域具有重要的实际应用价值,对应的应用场景通常取决于两组点云序列的分别表征的物理含义,可分为“不同视角”、“不同时刻”、“模型-模型”以及“模型-场景”四类。照此分类,我们分别例举点云局部特征描述与匹配在如下实际场景中的应用:

• 不同视角:此类数据利用点云之间的点匹配关系旨在估算不同视角点云序列之间的空间变换关系,从而完成姿态归一化来得到更大视场范围内的点云或进行三维重建。在计算机视觉领域的应用包括三维目标重建[20,21]、三维场景重建[22] 以及三维数据融合[13,23]。在遥感领域的应用包括大场景遥感点云拼接[24] 以及地形场景重建[25]。在文化遗产保护领域的应用包括基于多目点云拼接重建的古文物数字模型库构建[26,27],在我国该技术已被应用于故宫数字博物馆的建立。

• 不同时刻:对于该类数据,点云特征匹配可以解算物体在给定时间内所产生的三维旋转和空间位移变化,从而得到物体在三维空间中的运动信息包括速度、角速度、动量等并能跟踪运动物体。在计算机视觉领域的典型应用为三维运动物体的姿态跟踪[28]。在航空航天领域的应用包括太空非合作目标的运动位姿解算[29] 等。

• 模型-模型:此类数据主要通过建立两个属于同一类别模型之间的特征对应关系来衡量模型之间的相似性。在计算机视觉中的应用包括三维人脸识别[30,31] 和三维物体分类[32]。

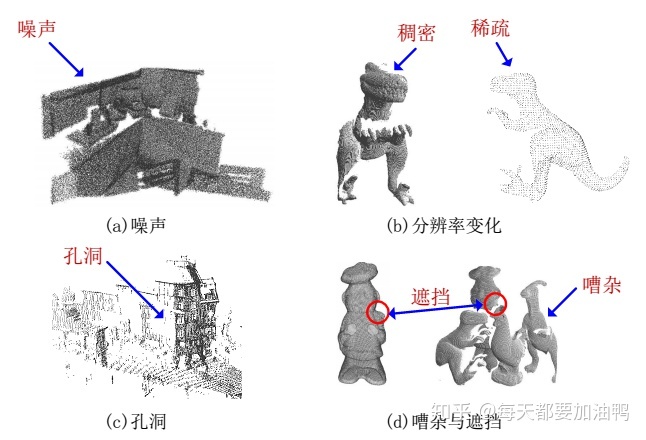

• 模型-场景:该类数据中模型是指感兴趣目标的三维模型,场景数据则为传感器在特定视角捕获的、包含感兴趣目标的场景数据(通常称为 2.5D 数据),这类数据广泛应用于嘈杂和遮挡环境中的三维目标识别。在计算机视觉中的主要应用为三维目标检测与识别[18,33]。在机器人领域的主要应用包括物体的抓取[34] 及摆放姿态的估计[35]。在国防领域的应用包括空对地的精准目标打击[36] 等。点云局部特征描述与匹配的研究已历经三十余年,尽管取得了一定的进展,例如刚体变换不变性问题的解决,但是仍然面临着如下挑战(图 3):

• 噪声:由于环境的干扰和设备的缺陷等因素,初始捕获的点云数据通常含有大量不同尺度的噪声,这种干扰在廉价传感器例如微软Kinect 获取的数据中尤为明显。噪声的存在将扰乱点云的局部几何结构,干扰特征的精准表达。

• 数据分辨率变化:尽管点云数据具有尺度不变性,但是相同物体在不同距离被捕获的点云将呈现出不同的分辨率。这里点云的分辨率为一组点云中任意两个相邻点之间的平均距离[37]。不同分辨率的点云对于物体局部形状信息的表达将产生差异,例如低分辨率的点云难以表征物体微小的局部结构,从而进一步增加了特征描述的困难。

• 孔洞:物体丰富的形状结构也会造成某个视角下捕获的点云存在自遮挡现象,进一步形成了孔洞;另外某些物体的材质(例如玻璃)也会导致点云数据出现数据缺失。分布在孔洞边缘的局部区域因为数据不完整的问题,将难以对局部曲面原本具有的几何结构进行正确表征。即使在理想情况下,该曲面与对应的匹配曲面之间的相似度也将大大降低,使得问题更具挑战性。

• 重复模式:现实世界中有许多物体具有轴对称性,这种对称性将造成重复模式的存在。由于目标的局部模式是一一对应的,这些重复模式将导致特征匹配的二义性。

上述干扰的存在一方面影响着点云局部特征的描述性和鲁棒性,另一方面将造成初始匹配集中掺杂大量误匹配而进一步给正确匹配的识别带来严重干扰。最近关于点云局部特征描述子 [19] 和特征匹配方法[17] 的实验评估表明现存方法难以充分克服以上干扰。综上,本专栏从理论及应用角度均具有重要的研究意义。

参考文献:

[1] Krig S. Computer vision metrics. Survey, taxonomy and analysis of computer vision. Visual Neuroscience, and Deep Learning. Springer, 2016, page 637.

[2] Rusu R B, Cousins S. 3d is here: Point cloud library (pcl). in: Proceedings of the IEEE International Conference on Robotics and Automation, 2011, 1–4.

[3] Johnson A E, Hebert M. Surface matching for object recognition in complex threedimensional scenes. Image and Vision Computing, 1998, 16(9):635–651.

[4] Johnson A E, Hebert M. Using spin images for efficient object recognition in cluttered 3D scenes. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1999, 21(5):433–449.

[5] Gelfand N, Mitra N J, Guibas L J, et al. Robust global registration. in: Proceedings of Symposium on Geometry Processing, 2005, 5.

[6] Aubry M, Schlickewei U, Cremers D. The wave kernel signature: A quantum mechanical approach to shape analysis. in: Proceedings of the IEEE International Conference on Computer Vision Workshops. IEEE, 2011, 1626–1633.

[7] Zai D, Li J, Guo Y, et al. Pairwise registration of TLS point clouds using covariance descriptors and a non-cooperative game. ISPRS Journal of Photogrammetry and Remote Sensing, 2017, 134:15–29.

[8] Dong Z, Yang B, Liang F, et al. Hierarchical registration of unordered TLS point clouds based on binary shape context descriptor. ISPRS Journal of Photogrammetry and Remote Sensing, 2018, 144:61–79.

[9] Tateno K, Tombari F, Navab N. When 2.5 D is not enough: Simultaneous reconstruction, segmentation and recognition on dense SLAM. in: Proceedings of the IEEE International Conference on Robotics and Automation. IEEE, 2016, 2295–2302.

[10] Rusu R B, Marton Z C, Blodow N, et al. Persistent point feature histograms for 3D point clouds. in: Proceedings of the 10th International Conference on Intelligent Autonomous Systems, 2008, 119–128.

[11] Mian A S, Bennamoun M, Owens R A. Automatic correspondence for 3D modeling: an extensive review. International Journal of Shape Modeling, 2005, 11(02):253–291.

[12] Guo Y, Bennamoun M, Sohel F, et al. 3D object recognition in cluttered scenes with local surface features: A survey. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2014, 36(11):2270–2287.

[13] Yang J, Cao Z, Zhang Q. A fast and robust local descriptor for 3D point cloud registration. Information Sciences, 2016, 346:163–179.

[14] Yang J, Xian K, Xiao Y, et al. Performance evaluation of 3D correspondence grouping algorithms. in: Proceedings of the International Conference on 3D Vision. IEEE, 2017, 467–476.

[15] Tombari F, Salti S, Di Stefano L. Performance evaluation of 3D keypoint detectors. International Journal of Computer Vision, 2013, 102(1-3):198–220.

[16] Sipiran I, Bustos B. Harris 3D: a robust extension of the Harris operator for interest point detection on 3D meshes. The Visual Computer, 2011, 27(11):963–976.

[17] Zhong Y. Intrinsic shape signatures: A shape descriptor for 3D object recognition. in: Proceedings of the International Conference on Computer Vision Workshops. IEEE, 2009, 689–696.

[18] Guo Y, Sohel F, Bennamoun M, et al. Rotational projection statistics for 3D local surface description and object recognition. International Journal of Computer Vision, 2013, 105(1):63–86.

[19] Guo Y, Bennamoun M, Sohel F, et al. A comprehensive performance evaluationof 3D local feature descriptors. International Journal of Computer Vision, 2016, 116(1):66–89.

[20] Mian A S, Bennamoun M, Owens R. Three-dimensional model-based object recognition and segmentation in cluttered scenes. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2006, 28(10):1584–1601.

[21] Guo Y, Sohel F, Bennamoun M, et al. An accurate and robust range image registration algorithm for 3D object modeling. IEEE Transactions on Multimedia, 2014, 16(5):1377–1390.

[22] Choi S, Zhou Q Y, Koltun V. Robust reconstruction of indoor scenes. in: Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2015, 5556–5565.

[23] Rusu R B, Blodow N, Marton Z C, et al. Aligning point cloud views using persistent feature histograms. in: Proceedings of the IEEE/RSJ International Conference on Intelligent Robots and Systems, 2008, 3384–3391.

[24] Dong Z, Yang B, Liu Y, et al. A novel binary shape context for 3D local surface description. ISPRS Journal of Photogrammetry and Remote Sensing, 2017, 130:431–452.

[25] Lei H, Jiang G, Quan L. Fast descriptors and correspondence propagation for robust global point cloud registration. IEEE Transactions on Image Processing, 2017, 26:3614–3623.

[26] Tombari F, Remondino F. Feature-based automatic 3D registration for cultural heritage applications. Algorithms, 2013, 24:25.

[27] Gomes L, Bellon O R P, Silva L. 3D reconstruction methods for digital preservation of cultural heritage: A survey. Pattern Recognition Letters, 2014, 50:3–14.

[28] Vongkulbhisal J, Torre F, Costeira J P. Discriminative optimization: Theory and applications to point cloud registration. in: Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2017, 3975–3983.

[29] Lim T W. Point cloud modeling using the homogeneous transformation for noncooperative pose estimation. Acta Astronautica, 2015, 111:61–76.

[30] Chang K I, Bowyer K W, Flynn P J. Multiple nose region matching for 3D face recognition under varying facial expression. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2006, 28(10):1695–1700.

[31] Abate A F, Nappi M, Riccio D, et al. 2D and 3D face recognition: A survey. Pattern Recognition Letters, 2007, 28(14):1885–1906.

[32] Rusu R B, Bradski G, Thibaux R, et al. Fast 3d recognition and pose using the viewpoint feature histogram. in: Proceedings of the IEEE/RSJ International Conference on Intelligent Robots and Systems. IEEE, 2010, 2155–2162.

[33] Tombari F, Di Stefano L. Object recognition in 3D scenes with occlusions and clutter by Hough voting. in: Proceedings of the Fourth Pacific-Rim Symposium on Image and Video Technology. IEEE, 2010, 349–355.

[34] Krainin M, Henry P, Ren X, et al. Manipulator and object tracking for inhand 3D object modeling. The International Journal of Robotics Research, 2011, 30(11):1311–1327.

[35] Drost B, Ulrich M, Navab N, et al. Model globally, match locally: Efficient and robust 3D object recognition. in: Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. IEEE, 2010, 998–1005.

[36] Kechagias-Stamatis O, Aouf N, Gray G, et al. Local feature based automatic target recognition for future 3D active homing seeker missiles. Aerospace Science and Tech-nology, 2018, 73:309–317.

[37] Tang K, Song P, Chen X. 3D object recognition in cluttered scenes with robust shape description and correspondence selection. IEEE Access, 2017, 5:1833–1845.

1541

1541

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?