Recurrent Neural Networks (RNN)

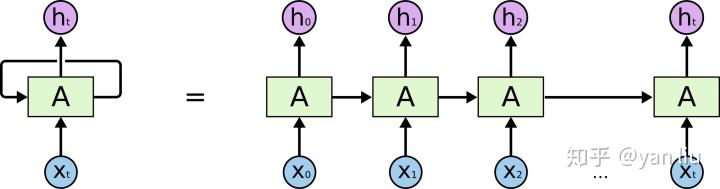

在使用深度学习处理时序问题时,RNN是最常使用的模型之一。RNN之所以在时序数据上有着优异的表现是因为RNN在

RNN的数学表达式可以表示为

而传统的DNN的隐节点表示为

对比RNN和DNN的隐节点的计算方式,我们发现唯一不同之处在于RNN将上个时间片的隐节点状态

所以,RNN的隐节点

- 计算在该时刻的预测值

:

- 计算下个时间片的隐节点状态

RNN的该特性也使RNN在很多学术和工业前景,例如OCR,语音识别,股票预测等领域上有了十足的进展。

长期依赖(Long Term Dependencies)

在深度学习领域中(尤其是RNN),“长期依赖“问题是普遍存在的。长期依赖产生的原因是当神经网络的节点经过许多阶段的计算后,之前比较长的时间片的特征已经被覆盖,例如下面例子

eg1: The cat, which already ate a bunch of food, was full.

| | | | | | | | | | |

t0 t1 t2 t3 t4 t5 t6 t7 t8 t9 t10

eg2: The cats, which already ate a bunch of food, were full.

| | | | | | | | | | |

t0 t1 t2 t3 t4 t5 t6 t7 t8 t9 t10我们想预测'full'之前系动词的单复数情况,显然full是取决于第二个单词’cat‘的单复数情况,而非其前面的单词food。根据图1展示的RNN的结构,随着数据时间片的增加,RNN丧失了学习连

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5920

5920

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?