- 线性回归

线性回归中的数学知识

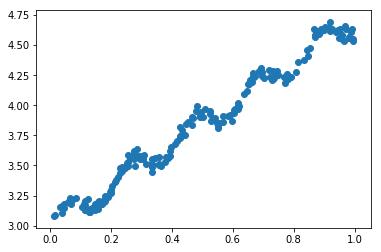

在线性回归中,最重要的莫过于在一大堆的数据中找回归方程

比较简单的方法是,可以利用最小二乘法寻找误差最小的那条直线.

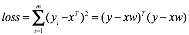

利用最小二乘法计算loss可以写为:

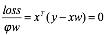

为了找到loss最小的那条直线,我们可以对w求导,得到

因此求回归方程转变为求参数w.

实现代码

def standRegres(xArr,yArr): xMat=np.mat(xArr) yMat=np.mat(yArr).T xTx=xMat.T*xMat if np.linalg.det(xTx)==0.0: print('error') return ws=xTx.I*(xMat.T*yMat) return ws求出参数w

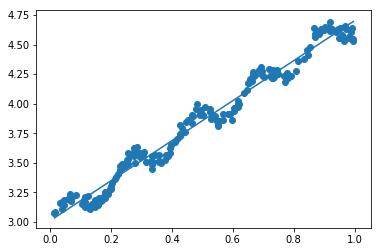

将回归直线去拟合实际数据

import matplotlib.pyplot as pltfig=plt.figure()ax=fig.add_subplot(111)ax.scatter(xMat[:,1].flatten().A[0],yMat.T[:,0].flatten().A[0])xCopy=xMat.copy()xCopy.sort(0)yHat=xCopy*wsax.plot(xCopy[:,1],yHat)plt.show()

可以看到虽然直线显示了大概的趋势,但并不能很好的去拟合数据,下面介绍一种强大的回归--""局部加权线性回归

4872

4872

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?