💝💝💝欢迎来到我的博客,很高兴能够在这里和您见面!希望您在这里可以感受到一份轻松愉快的氛围,不仅可以获得有趣的内容和知识,也可以畅所欲言、分享您的想法和见解。

- 推荐:kwan 的首页,持续学习,不断总结,共同进步,活到老学到老

- 导航

- 檀越剑指大厂系列:全面总结 java 核心技术,jvm,并发编程 redis,kafka,Spring,微服务等

- 常用开发工具系列:常用的开发工具,IDEA,Mac,Alfred,Git,typora 等

- 数据库系列:详细总结了常用数据库 mysql 技术点,以及工作中遇到的 mysql 问题等

- 新空间代码工作室:提供各种软件服务,承接各种毕业设计,毕业论文等

- 懒人运维系列:总结好用的命令,解放双手不香吗?能用一个命令完成绝不用两个操作

- 数据结构与算法系列:总结数据结构和算法,不同类型针对性训练,提升编程思维,剑指大厂

非常期待和您一起在这个小小的网络世界里共同探索、学习和成长。💝💝💝 ✨✨ 欢迎订阅本专栏 ✨✨

博客目录

- 前言

- 1. 本地部署 Llama3.1

- 2. 本地安装 LobeChat 可视化 UI 界面

- 3. 在 LobeChat 中添加 Llama3.1

- 4. 安装 Cpolar 内网穿透

- 5. 实现公网访问 LobeChat

- 6. 固定 LobeChat 公网地址

前言

本篇文章主要介绍如何在本地安装 Llama3.1,以及在本地部署 LobeChat 可视化 UI 界面,并且结合 Cpolar 内网穿透,实现公网远程使用 Llama3.1。

就在前一阵,Meta 宣布推出迄今为止最强大的开源模型——Llama3.1 405B,Llama 3.1 是 Meta 最新推出的开源大语言模型,支持八种语言。它能够提供通用知识、数学计算、多语言翻译和工具使用能力,开放下载并允许开发者定制和微调。

通过 LobeChat 可视化 UI 界面来使用 Llama,实现在 web 界面就可以直接来使用,那么接下来如何进行操作。

1. 本地部署 Llama3.1

本地电脑硬件要求:

Windows:3060 以上显卡+8G 以上显存+16G 内存,硬盘空间至少 20G

Mac:M1 或 M2 芯片 16G 内存,20G 以上硬盘空间

本篇文章测试环境:Windows10 专业版

首先需要安装 Ollama 客户端,来进行本地部署 Llama3.1 大模型

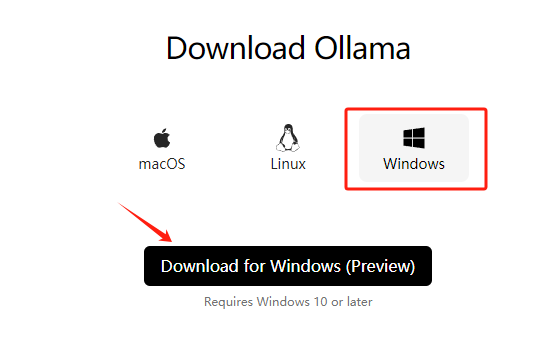

下载地址:https://ollama.com/download

在下载页面点击 Windows,然后点击下载按钮。

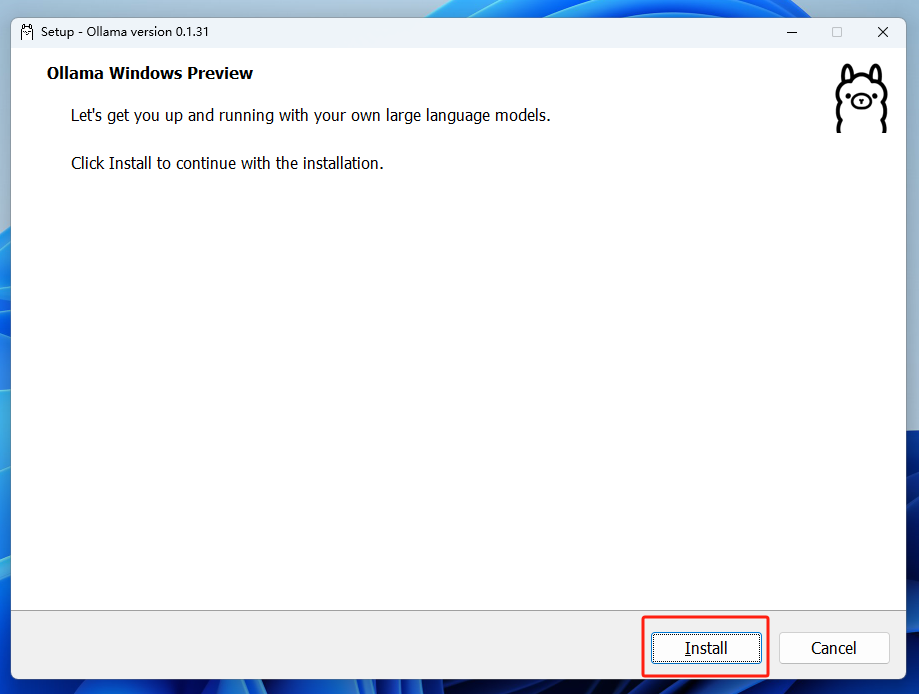

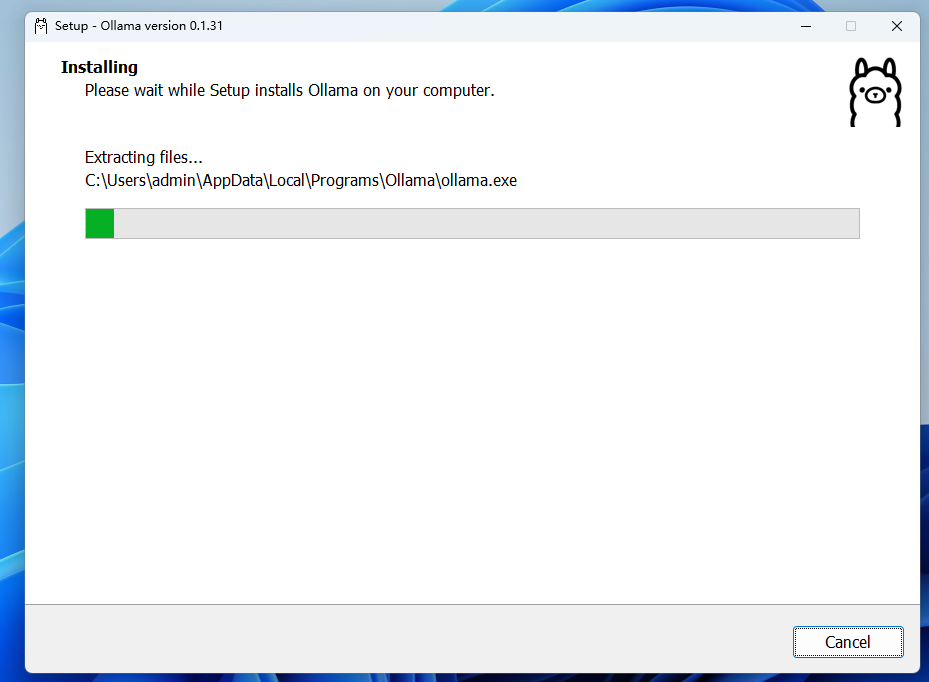

下载完成后,双击下载的安装程序。

点击 Install 进行安装。

安装完成后,双击 ollama 客户端自动打开 Windows Power Shell,如果没有自动弹出,也可以手动打开 cmd,这里打开 cmd 为例:

我们在终端中输入ollama,它会显示出当前这款 ollama 程序,它的使用及安装命令

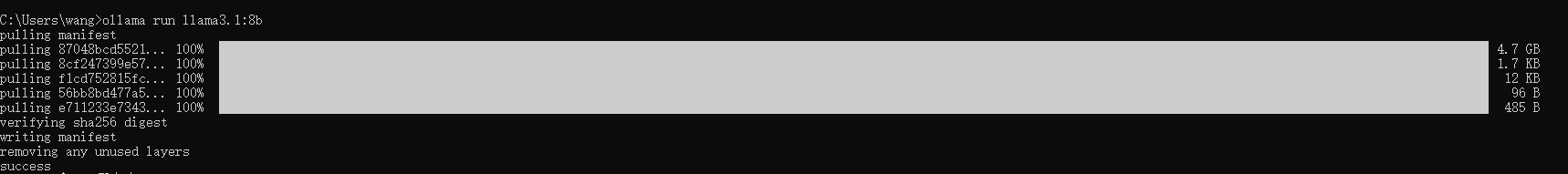

接下来继续在终端中安装 Llama3.1-8b(至少需要 8G 显存)

上方显示已安装成功,接下来就可以进行使用了,比如这里可以在终端中输入问题

我们已经成功的在本地部署了 Llama3.1,但是只能在终端中来使用,如果能使用 web 界面进行交互,使用体验会更好,也可以保留之前的聊天记录,方便查找和使用,下面带大家安装 LobeChat 可视化 UI 界面!

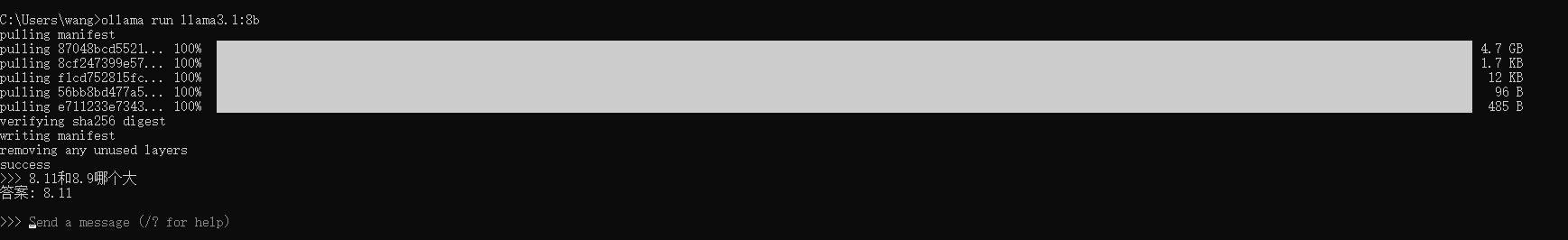

2. 本地安装 LobeChat 可视化 UI 界面

Lobe Chat 作为一款开源、现代化设计的聊天应用,具有许多令人青睐的特点和功能,接下来教大家如何在本地安装 LobeChat。

**官网地址:https://lobehub.com/zh

**GitHub 地址:https://link.zhihu.com/?target=https%3A//github.com/lobehub/lobe-chat

本地安装流程:

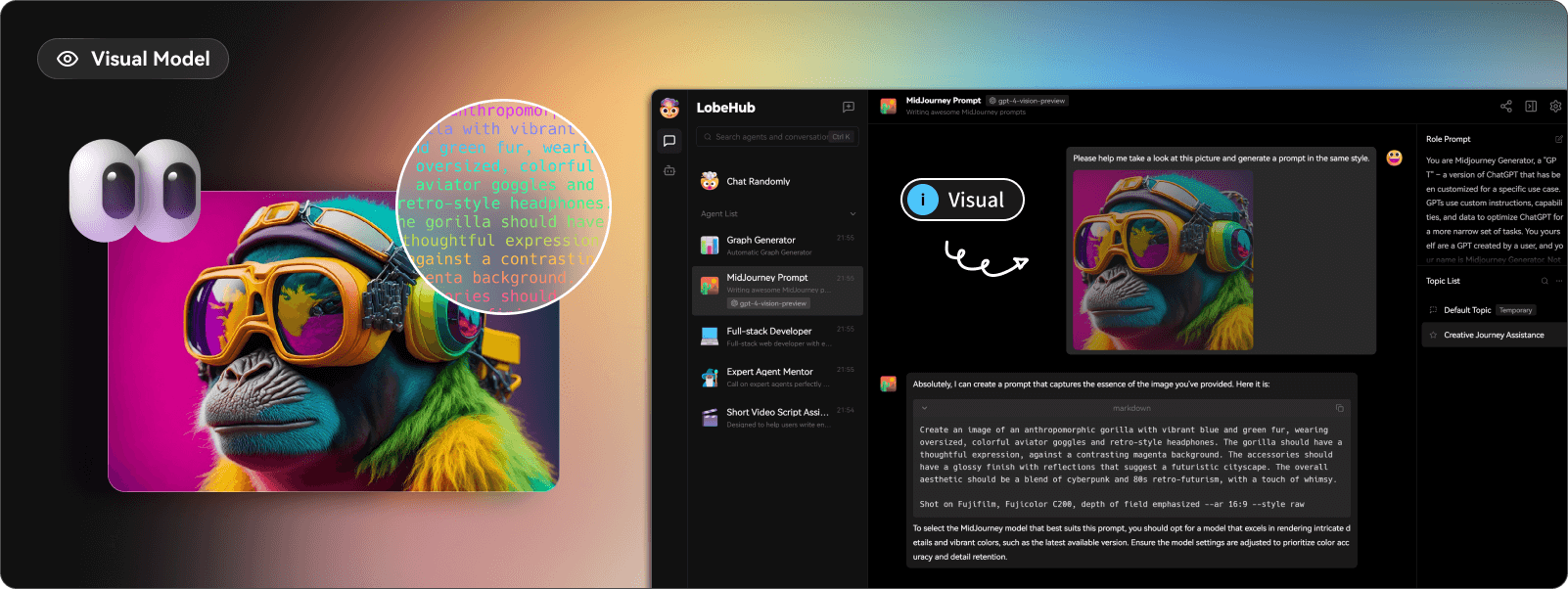

首先从 github 上克隆 lobechat(如果没有安装 git 的话,进入 git 官网进行下载 windows 版本 https://git-scm.com/downloads)

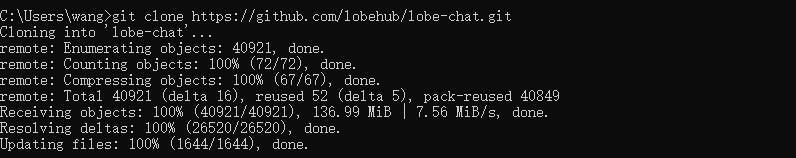

打开命令行,从 github 下载项目到本地,执行下面的命令

创建新目录

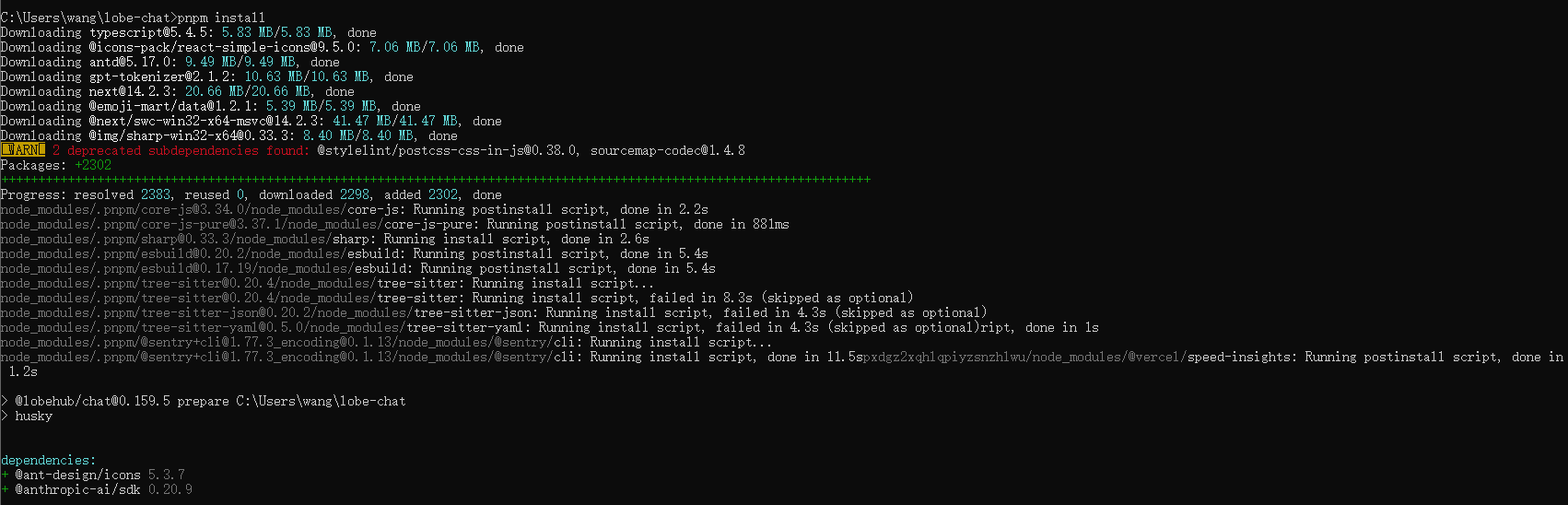

在项目的根目录下,执行下面的命令,下载依赖。

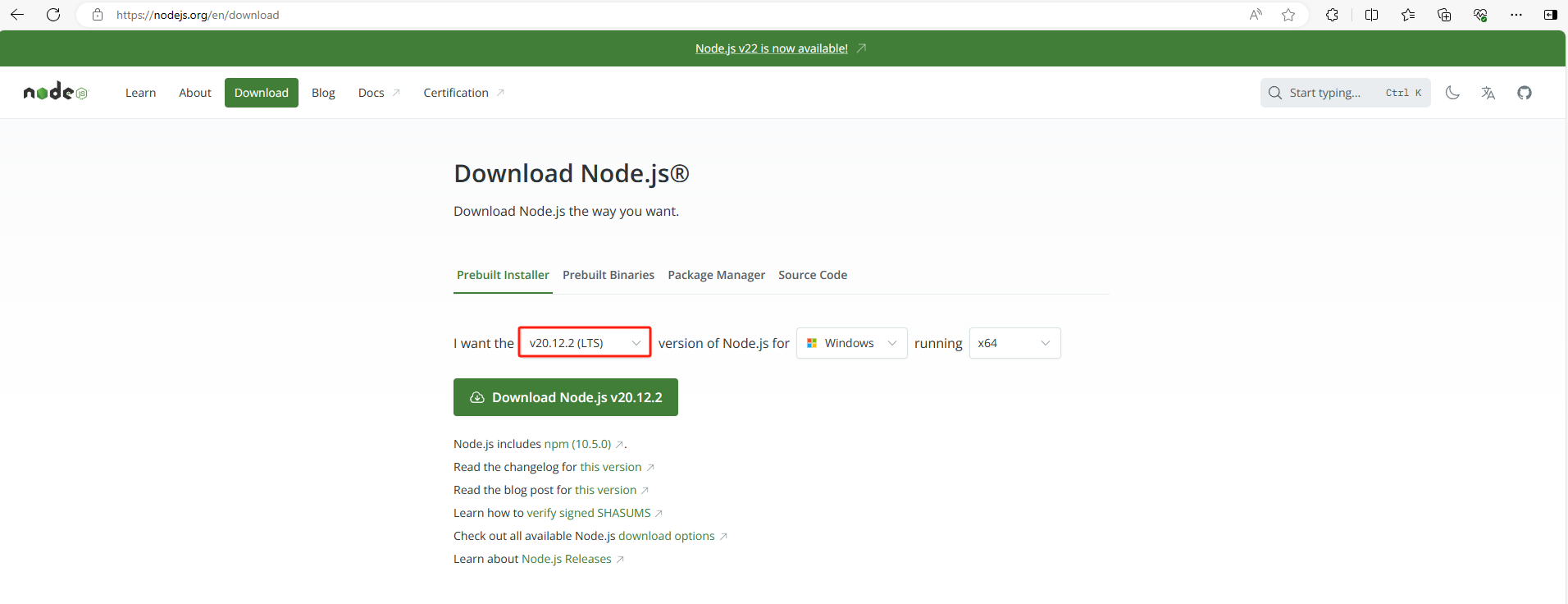

(注意:没有安装 Node.js 的话,点击官网下载链接https://nodejs.org/en/download,这里演示版本是v20.12.2)

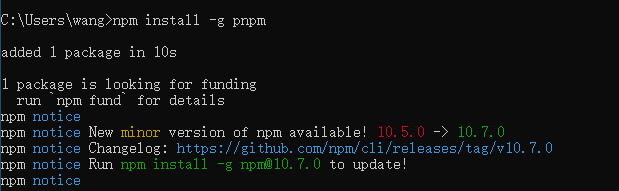

(注意:如果未安装 pnpm,需要使用下方代码一键安装 pnpm)

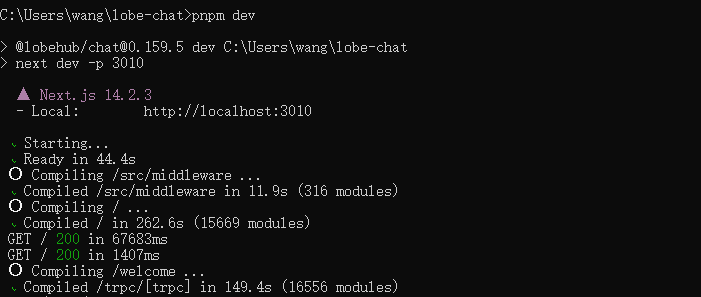

在项目的根目录下,运行 LobeChat,可以看到运行成功,出现 http://localhost:3010

3. 在 LobeChat 中添加 Llama3.1

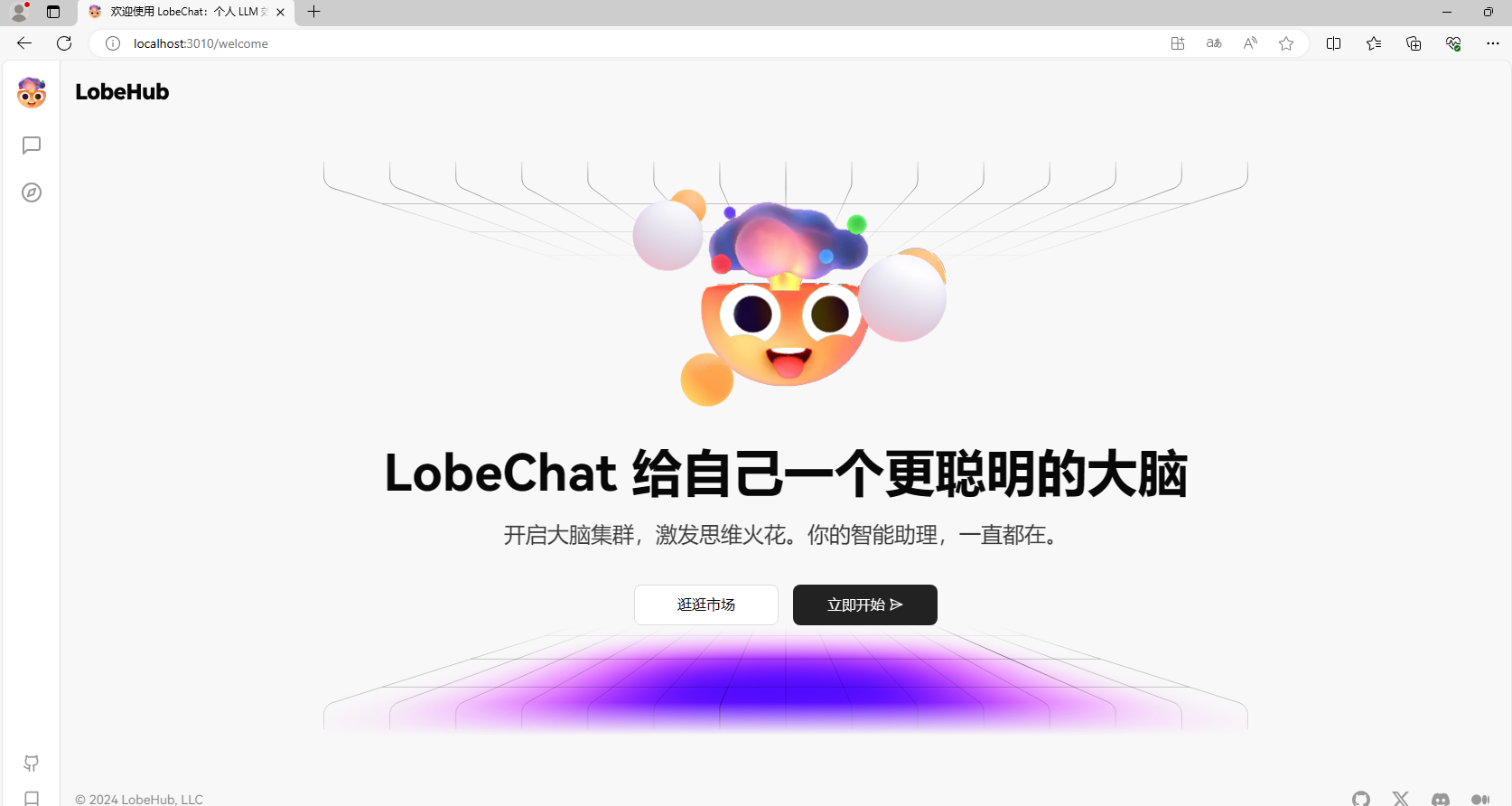

可以看到我们已经在本地部署了 LobeChat,测试一下是否部署成功打开新的浏览器输入:http://localhost:3010

可以看到进入到了 LobeChat 的主界面

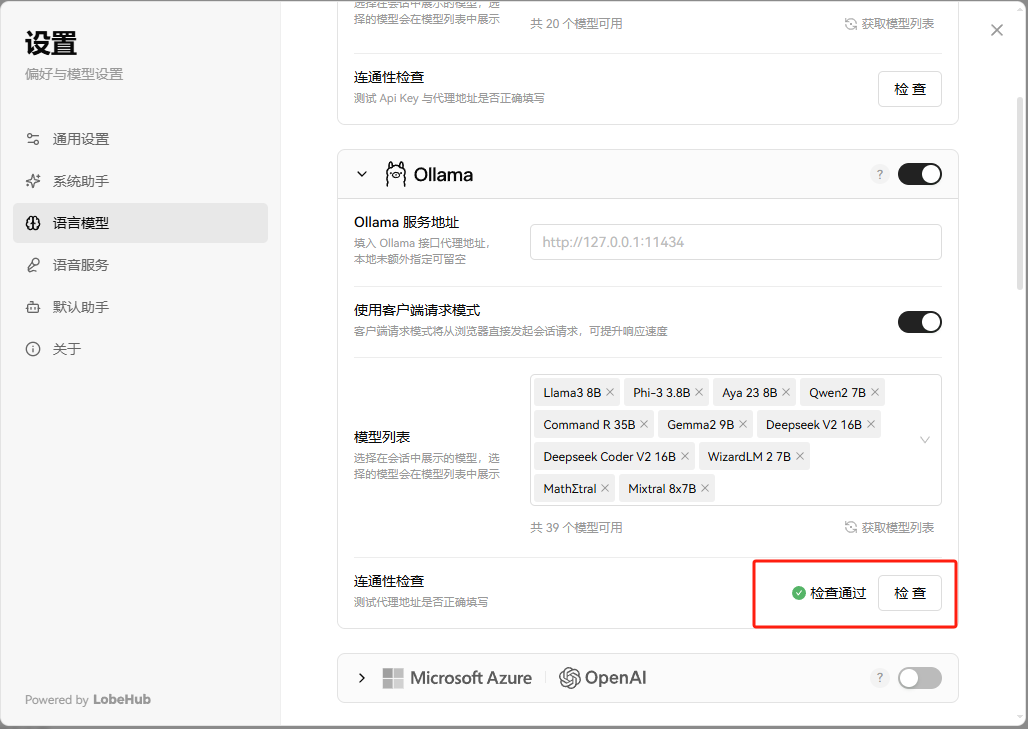

- 点击左上角头像,找到设置,选择语言模型,找到 Ollama,开启它,并做连通性检查 。

- 检查通过,获取模型列表

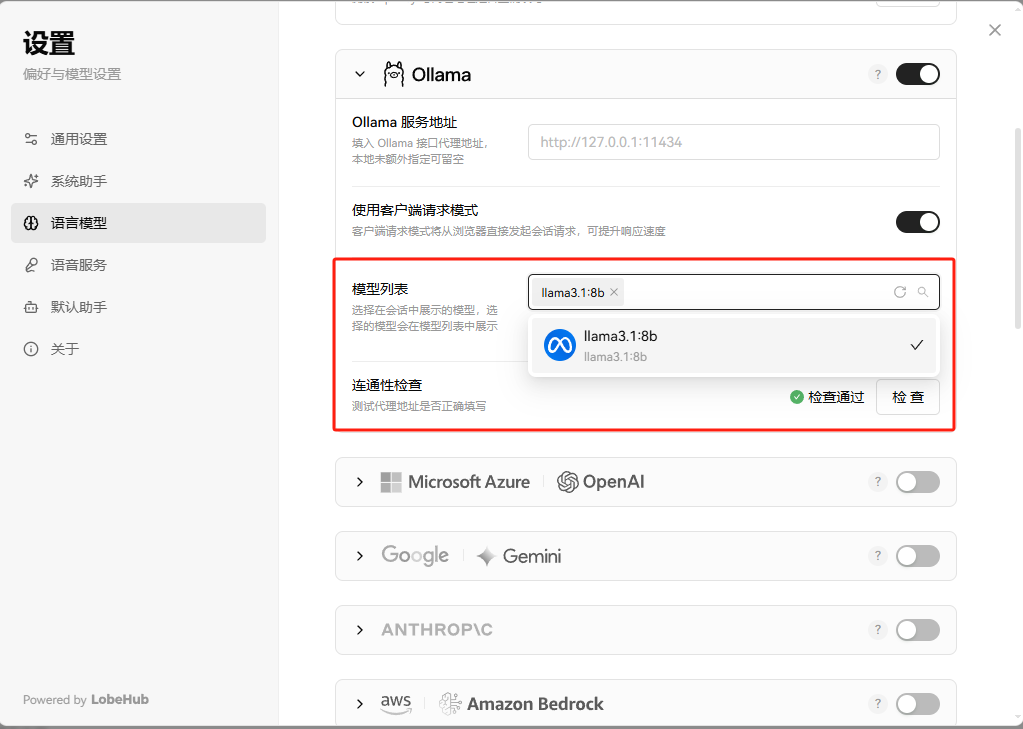

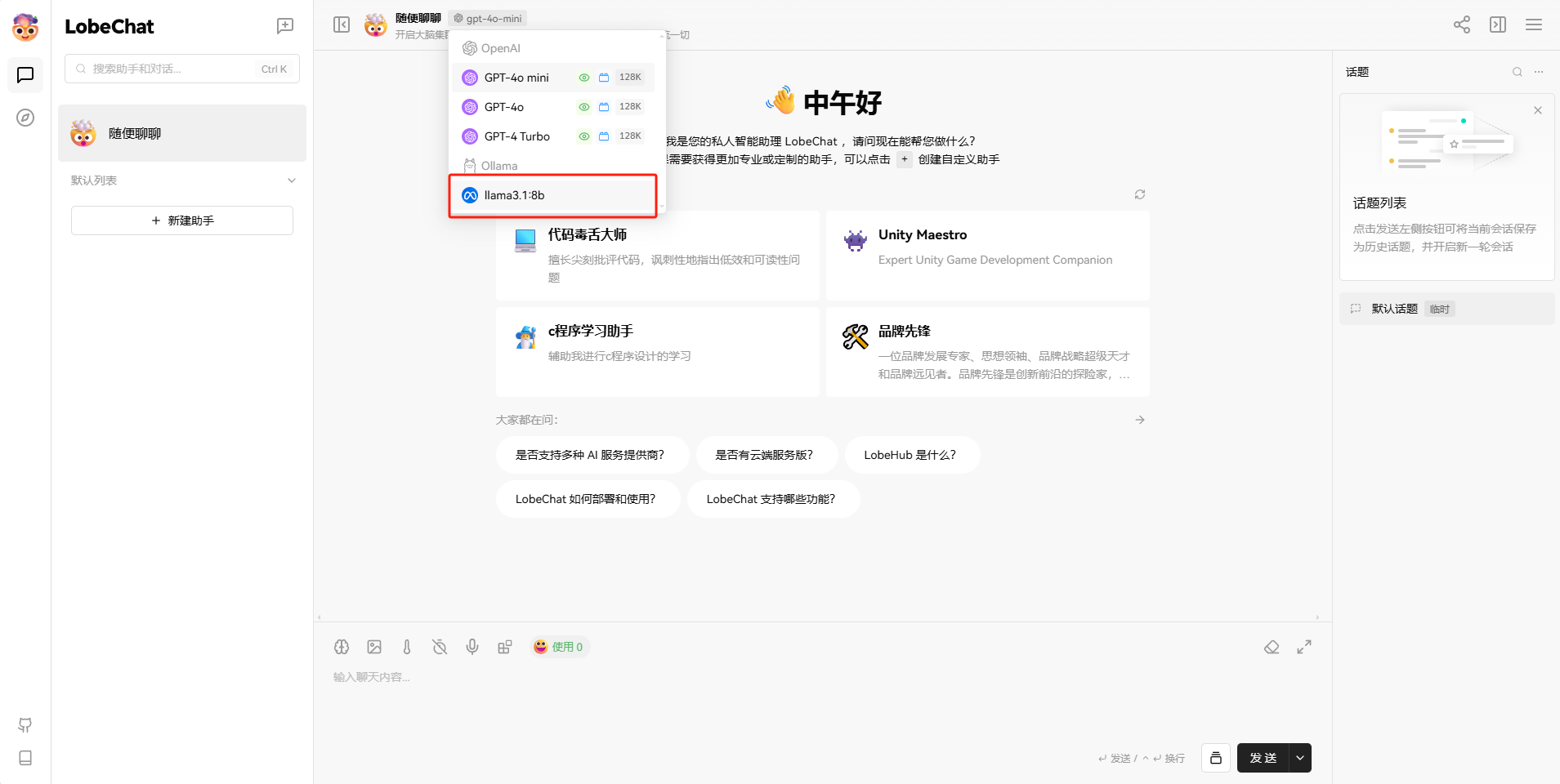

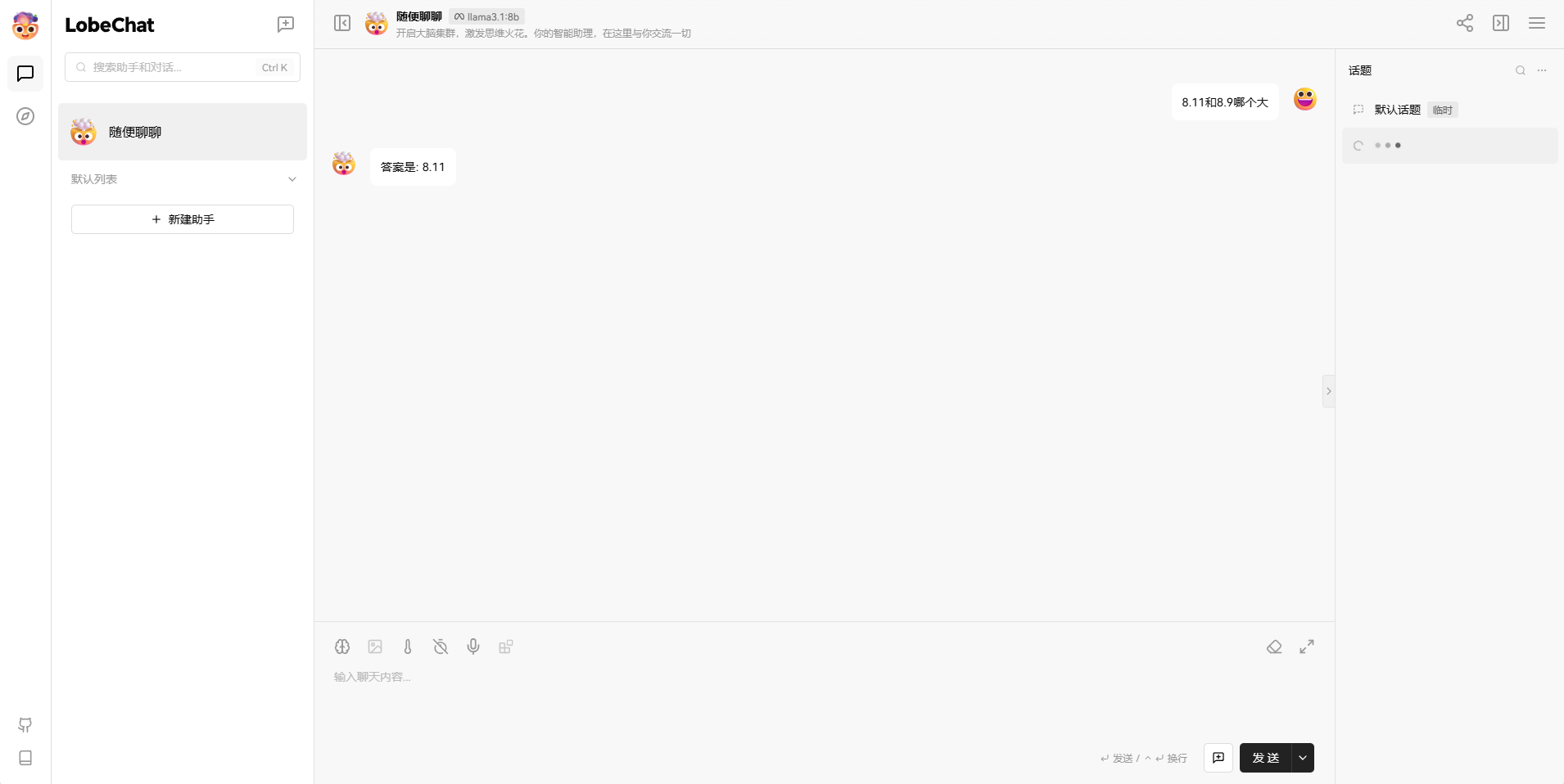

- 回到聊天窗口,选择 llama3.1:8b 模型

接下来就可以进行聊天了。

目前我们在本机部署了 LobeHub,并且还添加了 Llama3.1 大模型,如果想团队协作多人使用,或者在异地其他设备使用的话就需要结合 Cpolar 内网穿透实现公网访问,免去了复杂得本地部署过程,只需要一个公网地址直接就可以进入到 LobeChat 中。

接下来教大家如何安装 Cpolar 并且将 LobeChat 实现公网访问。

4. 安装 Cpolar 内网穿透

下面是安装 cpolar 步骤:

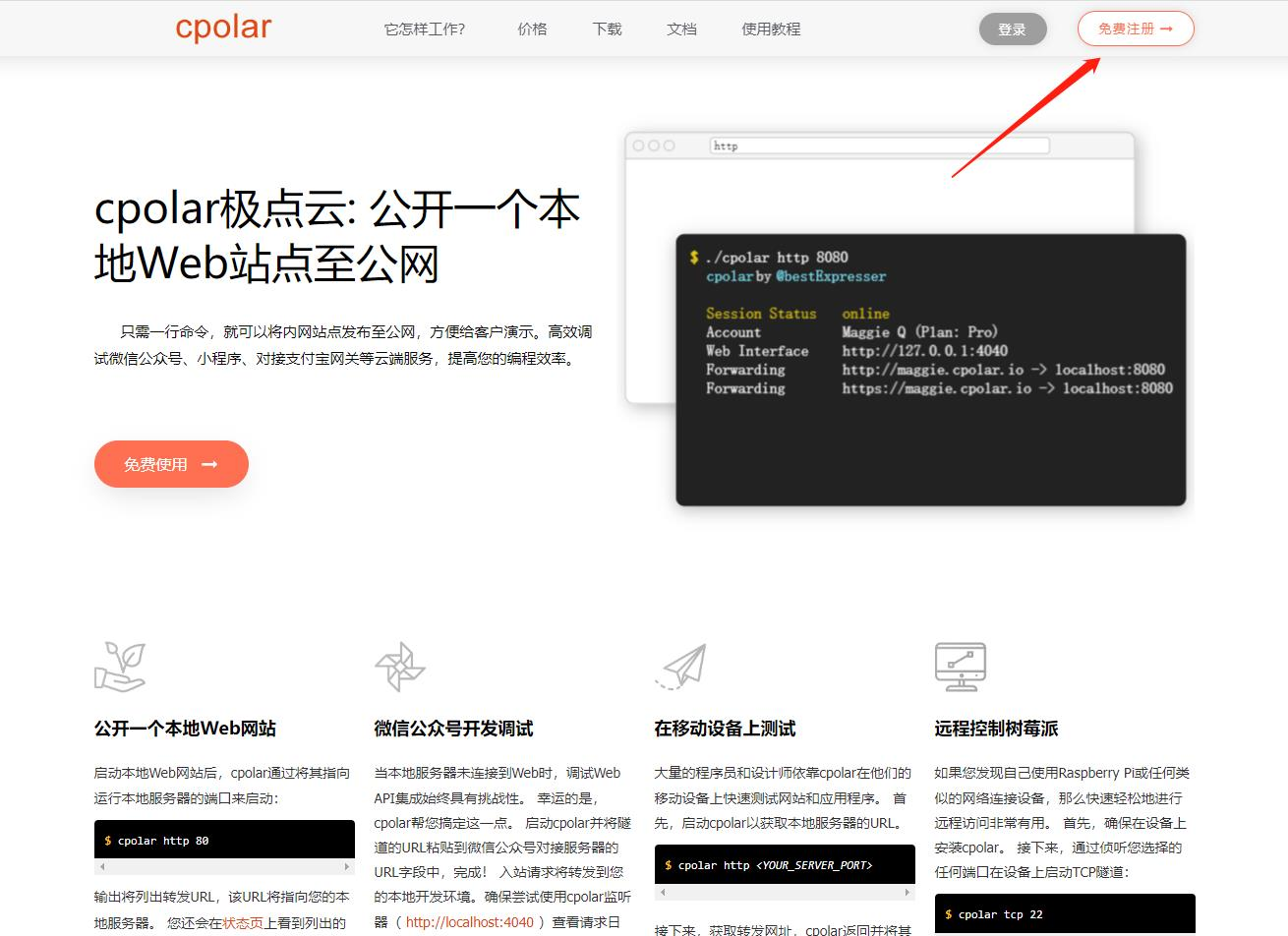

Cpolar 官网地址: https://www.cpolar.com

点击进入 cpolar 官网,点击免费使用注册一个账号,并下载最新版本的 Cpolar

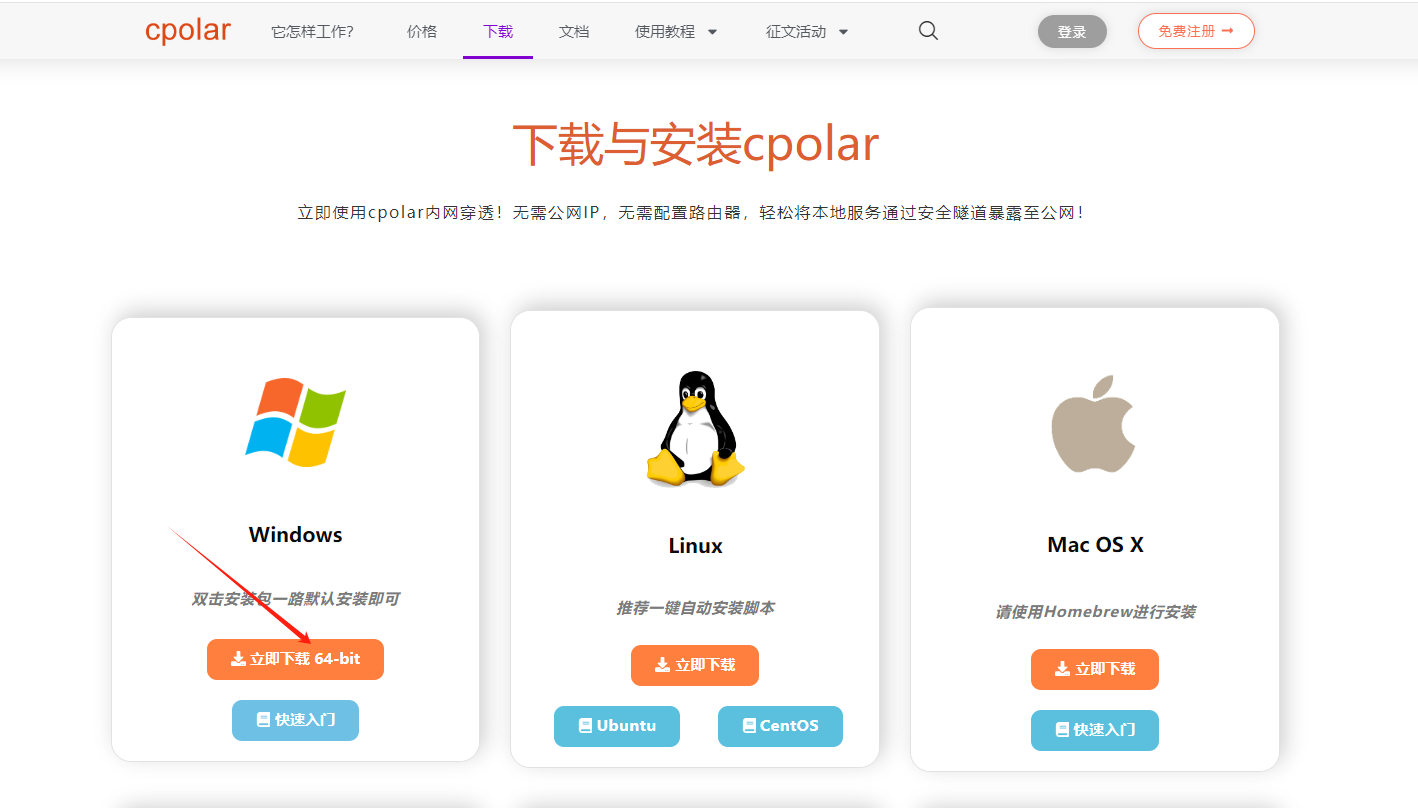

登录成功后,点击下载 Cpolar 到本地并安装(一路默认安装即可)本教程选择下载 Windows 版本。

Cpolar 安装成功后,在浏览器上访问 http://localhost:9200,使用 cpolar 账号登录,登录后即可看到 Cpolar web 配置界面,结下来在 web 管理界面配置即可。

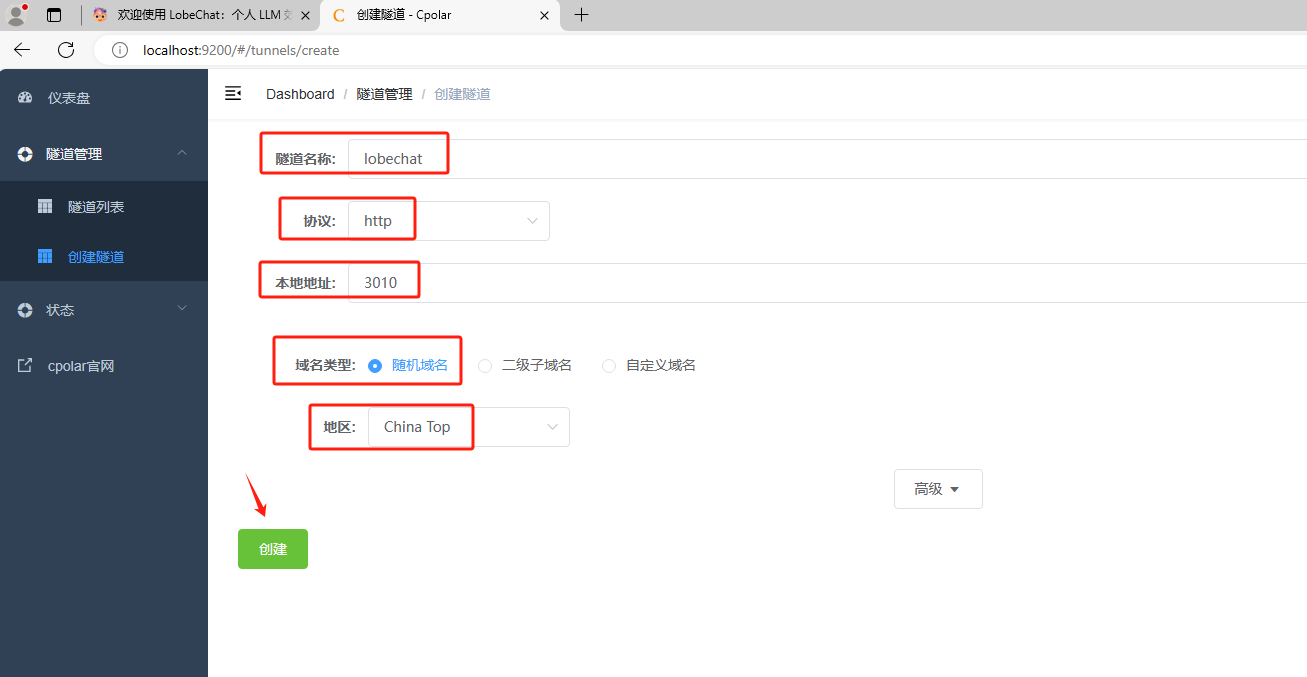

接下来配置一下 LobeChat 的公网地址,

登录后,点击左侧仪表盘的隧道管理——创建隧道,

创建一个 LobeChat 的公网 http 地址隧道

- 隧道名称:可自定义命名,注意不要与已有的隧道名称重复

- 协议:选择 http

- 本地地址:3010 (本地访问的地址)

- 域名类型:免费选择随机域名

- 地区:选择 China Top

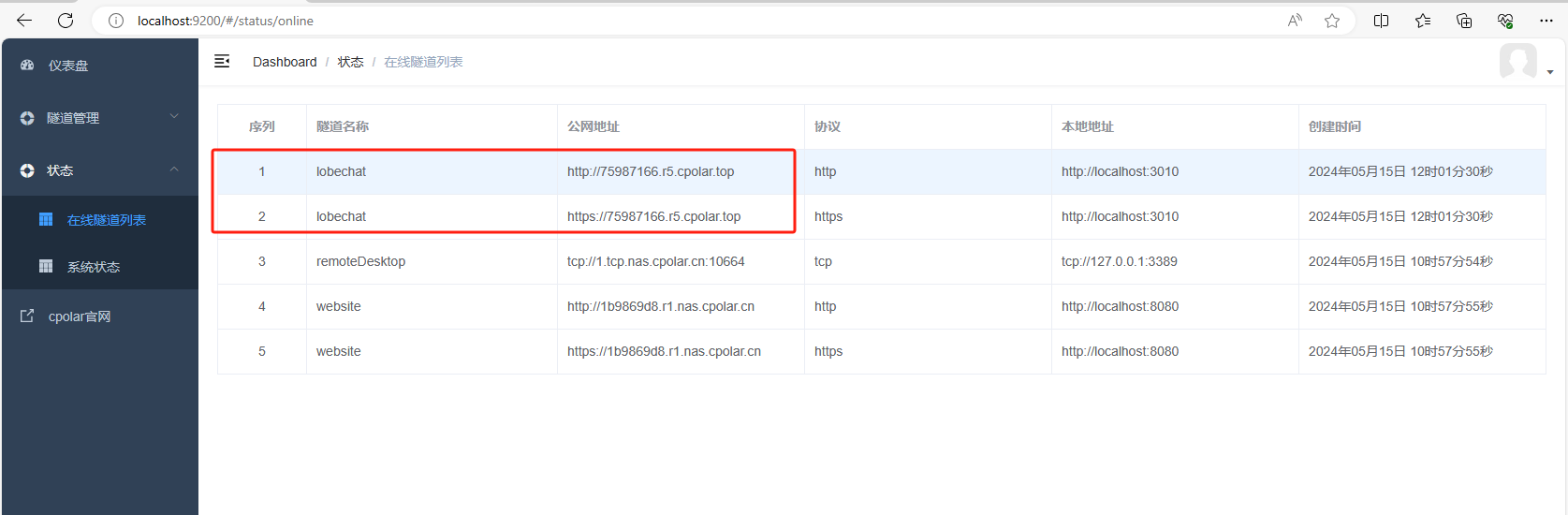

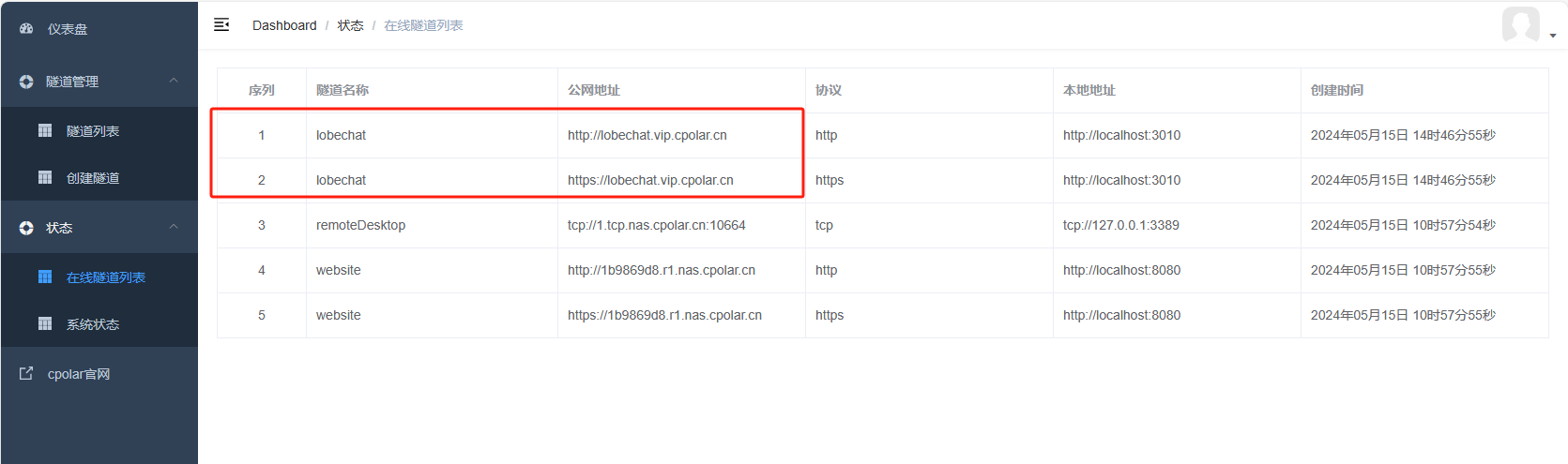

隧道创建成功后,点击左侧的状态——在线隧道列表,查看所生成的公网访问地址,有两种访问方式,一种是 http 和 https

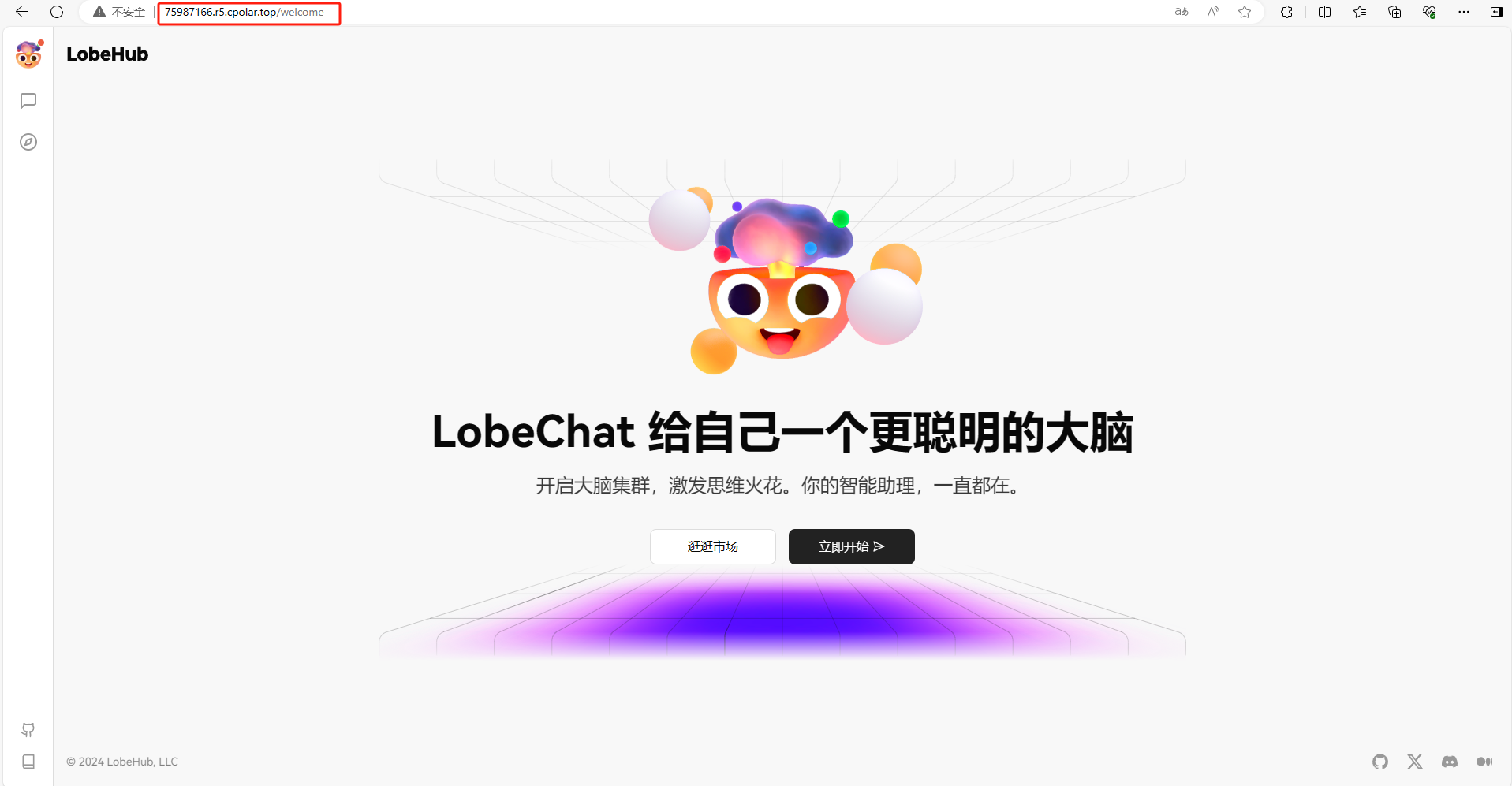

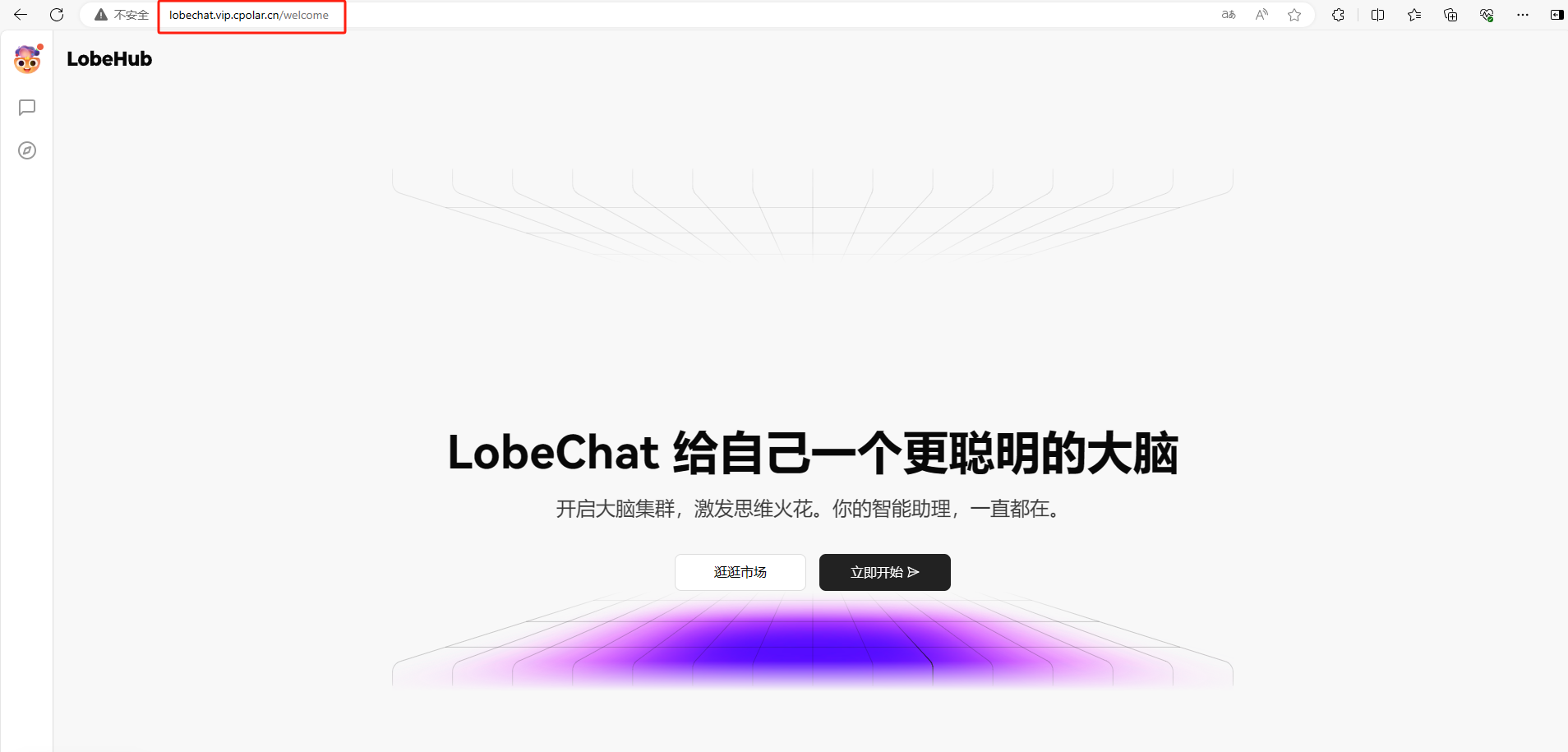

使用上面的 Cpolar https 公网地址,在手机或任意设备的浏览器进行登录访问,即可成功看到 LobeChat 界面,这样一个公网地址且可以远程访问就创建好了,使用了 Cpolar 的公网域名,无需自己购买云服务器,即可到公网访问 LobeChat 了!

5. 实现公网访问 LobeChat

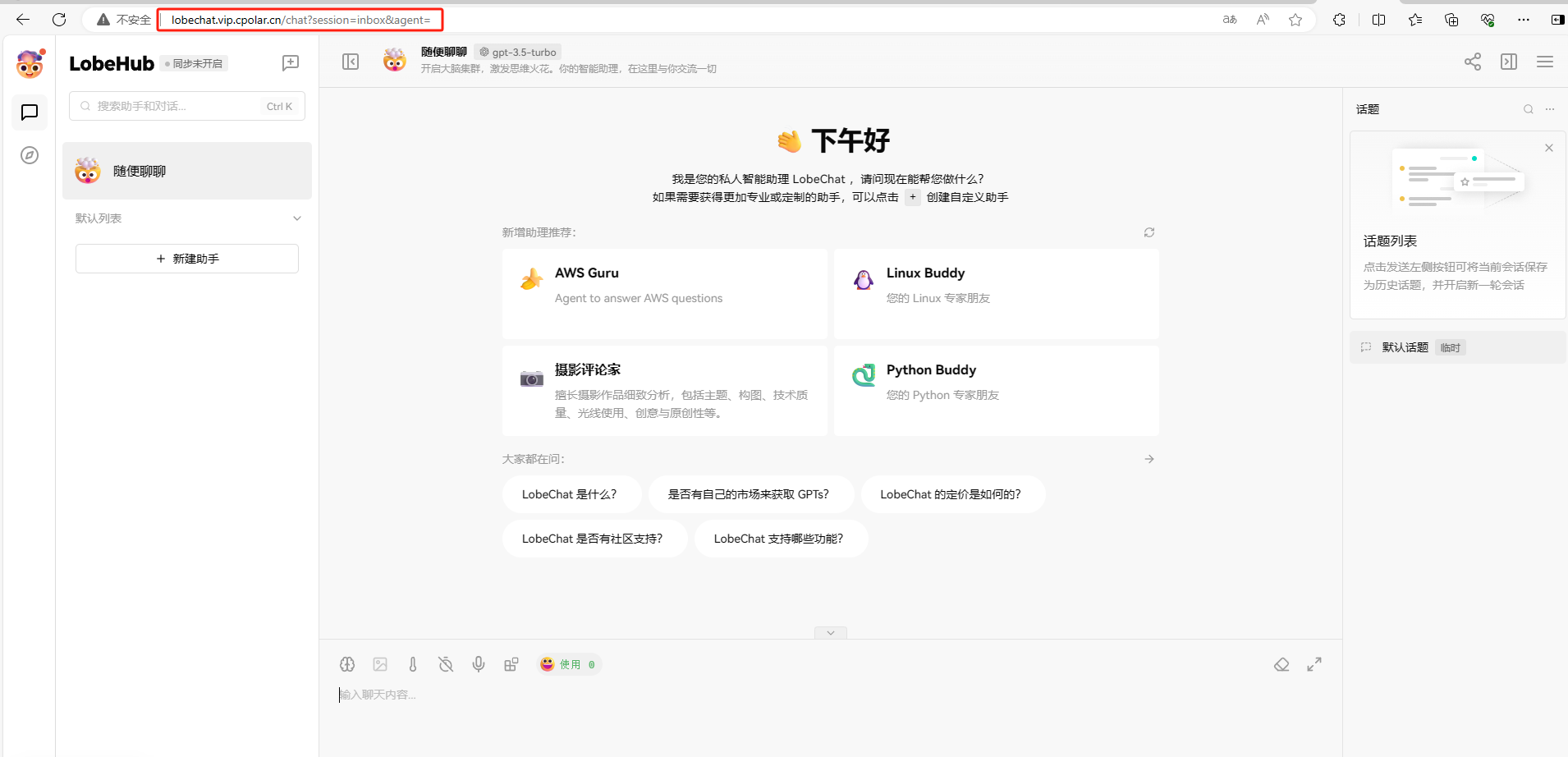

我们用刚才 cpolar 生成的公网地址,打开一个新的浏览器复制粘贴,可以看到进入到了 LobeChat 项目管理界面,然后选择 Llama3.1 大模型就可以进行在公网来使用了。

小结

如果我们需要长期进行团队协作的话,由于刚才创建的是随机的地址,24 小时会发生变化。另外它的网址是由随机字符生成,不容易记忆。如果想把域名变成固定的二级子域名,并且不想每次都重新创建隧道来访问 LobeChat,我们可以选择创建一个固定的 http 地址来解决这个问题。

6. 固定 LobeChat 公网地址

我们接下来为其配置固定的 HTTP 端口地址,该地址不会变化,方便分享给别人长期查看你的博客,而无需每天重复修改服务器地址。

配置固定 http 端口地址需要将 cpolar 升级到专业版套餐或以上。

登录 cpolar 官网,点击左侧的预留,选择保留二级子域名,设置一个二级子域名名称,点击保留,保留成功后复制保留的二级子域名名称。

保留成功后复制保留成功的二级子域名的名称

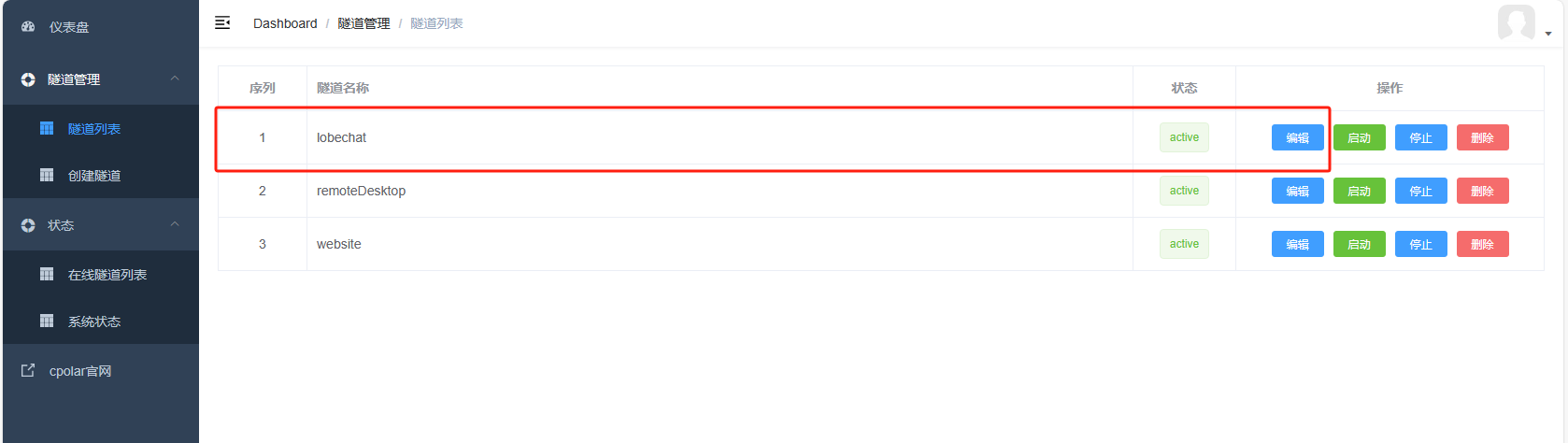

返回登录 Cpolar web UI 管理界面,点击左侧仪表盘的隧道管理——隧道列表,找到所要配置的隧道,点击右侧的编辑

修改隧道信息,将保留成功的二级子域名配置到隧道中

- 域名类型:选择二级子域名

- Sub Domain:填写保留成功的二级子域名

点击更新(注意,点击一次更新即可,不需要重复提交)

更新完成后,打开在线隧道列表,此时可以看到公网地址已经发生变化,地址名称也变成了固定的二级子域名名称的域名

最后,我们使用固定的公网 https 地址在任何浏览器打开访问,可以看到访问 LobeChat 成功了这样一个固定且永久不变的公网地址就设置好了,然后选择一下 Llama3.1 大模型就可以。

接下来就可以随时随地进行异地公网来使用 Llama3.1 大模型了,把固定的公网地址分享给身边的人,方便团队协作,同时也大大提高了工作效率!自己用的话,无需云服务器,还可以实现异地其他设备登录!以上就是如何在本地安装 Llama3.1 以及在本地部署 LobeChat 可视化界面的全部过程。

觉得有用的话点个赞

👍🏻呗。

❤️❤️❤️本人水平有限,如有纰漏,欢迎各位大佬评论批评指正!😄😄😄💘💘💘如果觉得这篇文对你有帮助的话,也请给个点赞、收藏下吧,非常感谢!👍 👍 👍

🔥🔥🔥Stay Hungry Stay Foolish 道阻且长,行则将至,让我们一起加油吧!🌙🌙🌙

703

703

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?