背景

基于雪花算法生成ID,在for循环里面,会产生重复ID,如下

测试代码

利用Snowflake生成10000个Id,在打印Id

package com.example.java.test;

import com.example.java.util.SnowFlakeUtil;

import java.util.ArrayList;

import java.util.List;

import java.util.Locale;

import java.util.UUID;

public class ForDuplicateKeyTest {

public static void main(String[] args) {

List<String> idList = new ArrayList<>();

for (int i = 0; i < 10000; i++) {

idList.add(SnowFlakeUtil.getSnowFlakeId()+"");

}

idList.forEach(p -> {

System.out.println(p);

});

}

}

结果发现有很多重复的Id,这时因为机器性能太好(现在的电脑基本都会出现这个问题),for循环太快,几乎在同一时间生成了同一个Id

解决方案

在SpringBoot项目中,可以将雪花算法作为一个服务注册到Spring容器里,交友Spring容器托管,然后使用SpringContext上下文环境获取该服务,调用服务即可,代码如下

Snowflake服务

package com.example.java.util.id;

import org.springframework.stereotype.Service;

/**

* snowflake service

* zj 20220711

*/

@Service

public class SnowflakeIdService {

/** 数据中心ID(0~31) */

private long datacenterId;

/** 工作机器ID(0~31) */

private long instanceId;

/**

* Twitter_Snowflake<br>

* SnowFlake的结构如下(每部分用-分开):<br>

* 0 - 0000000000 0000000000 0000000000 0000000000 0 - 00000 - 00000 - 000000000000 <br>

* 1位标识,由于long基本类型在Java中是带符号的,最高位是符号位,正数是0,负数是1,所以id一般是正数,最高位是0<br>

* 41位时间截(毫秒级),注意,41位时间截不是存储当前时间的时间截,而是存储时间截的差值(当前时间截 - 开始时间截)

* 得到的值),这里的的开始时间截,一般是我们的id生成器开始使用的时间,由我们程序来指定的(如下下面程序IdWorker类的startTime属性)。41位的时间截,可以使用69年,年T = (1L << 41) / (1000L * 60 * 60 * 24 * 365) = 69<br>

* 10位的数据机器位,可以部署在1024个节点,包括5位datacenterId和5位instanceId<br>

* 12位序列,毫秒内的计数,12位的计数顺序号支持每个节点每毫秒(同一机器,同一时间截)产生4096个ID序号<br>

* 加起来刚好64位,为一个Long型。<br>

* SnowFlake的优点是,整体上按照时间自增排序,并且整个分布式系统内不会产生ID碰撞(由数据中心ID和机器ID作区分),并且效率较高,经测试,SnowFlake每秒能够产生26万ID左右。

*/

/** 开始时间截 2020-06-26 10:40:04*/

private final long twepoch = 1593139205000L;

/** 机器id所占的位数 */

private final long workerIdBits = 5L;

/** 数据标识id所占的位数 */

private final long datacenterIdBits = 5L;

/** 支持的最大机器id,结果是31 (这个移位算法可以很快的计算出几位二进制数所能表示的最大十进制数) */

private final long maxWorkerId = -1L ^ (-1L << workerIdBits);

/** 支持的最大数据标识id,结果是31 */

private final long maxDatacenterId = -1L ^ (-1L << datacenterIdBits);

/** 序列在id中占的位数 */

private final long sequenceBits = 12L;

/** 机器ID向左移12位 */

private final long workerIdShift = sequenceBits;

/** 数据标识id向左移17位(12+5) */

private final long datacenterIdShift = sequenceBits + workerIdBits;

/** 时间截向左移22位(5+5+12) */

private final long timestampLeftShift = sequenceBits + workerIdBits + datacenterIdBits;

/** 生成序列的掩码,这里为4095 (0b111111111111=0xfff=4095) */

private final long sequenceMask = -1L ^ (-1L << sequenceBits);

/** 毫秒内序列(0~4095) */

private long sequence = 0L;

/** 上次生成ID的时间截 */

private long lastTimestamp = -1L;

/**

* 构造函数

*/

public SnowflakeIdService() {

if (instanceId > maxWorkerId || instanceId < 0) {

throw new IllegalArgumentException(String.format("worker Id can't be greater than %d or less than 0", maxWorkerId));

}

if (datacenterId > maxDatacenterId || datacenterId < 0) {

throw new IllegalArgumentException(String.format("datacenter Id can't be greater than %d or less than 0", maxDatacenterId));

}

}

/**

* 获得下一个ID (该方法是线程安全的)

* @return SnowflakeId

*/

public synchronized long nextId() {

long timestamp = timeGen();

//如果当前时间小于上一次ID生成的时间戳,说明系统时钟回退过这个时候应当抛出异常

if (timestamp < lastTimestamp) {

throw new RuntimeException(

String.format("Clock moved backwards. Refusing to generate id for %d milliseconds", lastTimestamp - timestamp));

}

//如果是同一时间生成的,则进行毫秒内序列

if (lastTimestamp == timestamp) {

sequence = (sequence + 1) & sequenceMask;

//毫秒内序列溢出

if (sequence == 0) {

//阻塞到下一个毫秒,获得新的时间戳

timestamp = tilNextMillis(lastTimestamp);

}

}

//时间戳改变,毫秒内序列重置

else {

sequence = 0L;

}

//上次生成ID的时间截

lastTimestamp = timestamp;

//移位并通过或运算拼到一起组成64位的ID

long id= ((timestamp - twepoch) << timestampLeftShift) //

| (datacenterId << datacenterIdShift) //

| (instanceId << workerIdShift) //

| sequence;

return id;

}

/**

* 阻塞到下一个毫秒,直到获得新的时间戳

* @param lastTimestamp 上次生成ID的时间截

* @return 当前时间戳

*/

protected long tilNextMillis(long lastTimestamp) {

long timestamp = timeGen();

while (timestamp <= lastTimestamp) {

timestamp = timeGen();

}

return timestamp;

}

/**

* 返回以毫秒为单位的当前时间

* @return 当前时间(毫秒)

*/

protected long timeGen() {

return System.currentTimeMillis();

}

}

获取Snowflake服务的工具类,也由Spring容器管理

思路:通过实现ApplicationContextAware接口,获取到ApplicationContext中注册的Snowflake服务

package com.example.java.util.id;

import org.springframework.beans.BeansException;

import org.springframework.context.ApplicationContext;

import org.springframework.context.ApplicationContextAware;

import org.springframework.stereotype.Component;

/**

* IdGenerator

* zj 20220711

*/

@Component

public class IdGenerator implements ApplicationContextAware {

private static SnowflakeIdService snowflakeIdService;

/**

* 得到下一个通用 id

*

* @return 消息 id

*/

public static String nextCommonId() {

return String.valueOf(snowflakeIdService.nextId());

}

@Override

public void setApplicationContext(ApplicationContext applicationContext) throws BeansException {

snowflakeIdService = applicationContext.getBean(SnowflakeIdService.class);

}

}

测试类

生成10000个雪花ID,并打印

package com.example.java.test;

import com.example.java.util.id.IdGenerator;

import org.junit.jupiter.api.Test;

import org.springframework.boot.test.context.SpringBootTest;

import java.util.concurrent.CopyOnWriteArrayList;

@SpringBootTest

public class SnowflakeIdDuplicateTest {

@Test

public void test() throws InterruptedException {

CopyOnWriteArrayList idList = new CopyOnWriteArrayList();

for (int i = 0; i < 10000; i++) {

idList.add(IdGenerator.nextCommonId() +"");

}

idList.forEach(p -> {

System.out.println(p);

});

}

}

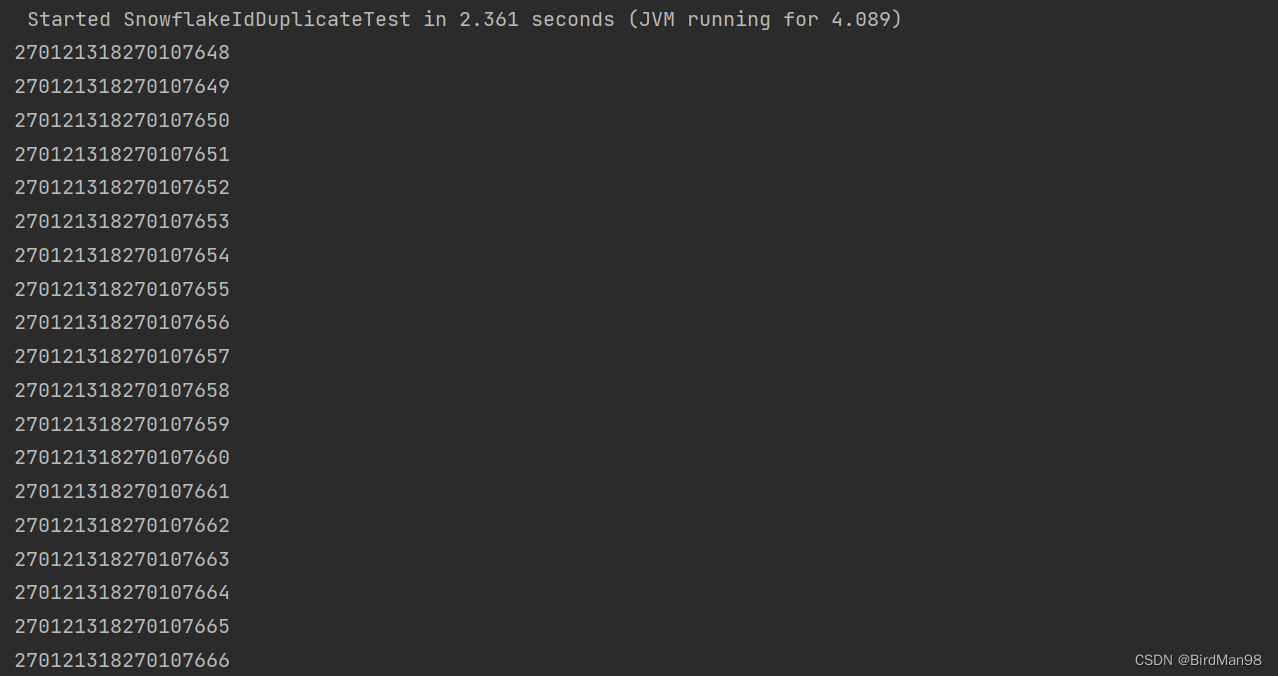

结果是严格递增的

1409

1409

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?