6月3日晚,著名开源大模型平台Stability AI的联合首席执行官Christian Laforte,在AMD的产品发布会上宣布,文生图模型 Stable Diffusion 3将于6月12日在Hugging Face开源权重。

(之前申请了等待名单,结果今天收到邮件^ ^)

本次开源的是Stable Diffusion 3的Medium模型,有20亿参数,在照片真实感、样式、图片质量、算力资源消耗等方面都进行了大幅度优化,将比前两代更好。

同时Stable Diffusion 3也是对标闭源文生图产品Midjourney、DALL·E 3的最佳模型之一,该系列已经被全球数百万开发者使用,很多文生视频/3D模型也借鉴了该架构。

以下是一些突出的功能:

- 逼真: 克服手部和面部的常见伪影,无需复杂的工作流程即可提供高质量图像。

- 排版: 在排版方面实现了强大的效果,优于较大的先进模型。

- 性能: 优化的尺寸和效率使其成为消费系统和企业工作负载的理想选择。

- 微调: 能够从小型数据集中吸收微妙的细节,是定制和创造的完美选择。

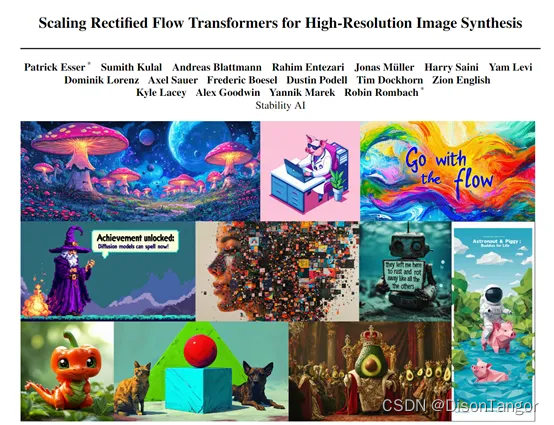

根据Stable Diffusion 3论文显示,使用了与Sora相同的架构Diffusion Transformer。

Diffusion模型作为生成模型的一种,主要通过数据到噪声的逆过程来创造新的数据点。这种方法在图像和视频生成方面应用非常广泛。

但是随着Diffusion不断迭代,预训练、推理对算力需求呈指数级增长,对于中小企业、个人开发者来说非常不友好。

所以,在Diffusion基础之上又融合了大模型界非常知名的Transformer架构,通过独立的权重处理图像和文本模态,并实现了这两种模态之间的双向信息流。

DiffusionTransformer架构引入新的噪声采样技术,改进了训练Rectified Flow模型的方法。通过偏向感知上相关的尺度,提高了训练的效率和性能。

该架构采用了模拟无关的流训练方法,直接回归一个向量场,用于生成数据分布和噪声分布之间的概率路径,有效避免了求解常微分方程所带来的超高算力成本,同时也极大增强了文本语义理解、文字嵌入和图片样式等。

Midjourney 和 DALL·E3,准备好迎接诸多挑战者了吗?

1173

1173

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?