机器学习

嘻嘻嘻嘻嘻嘻啊

这个人特别特别懒。什么都不想写。

展开

-

机器学习————基础概念及NLP基础

文章目录基础概念及NIP基础基础概念简单的机器学习流程训练集/验证集(开发集)/测试集有监督机器学习和无监督机器学习NLP实例1:马蜂窝评论造假文本相似度分析:步骤:步骤详解:代码实现基础概念及NIP基础基础概念简单的机器学习流程将学习算法细分:训练集/验证集(开发集)/测试集在机器学习和模式识别等领域中,一般需要将样本分成独立的三部分训练集(train set),验证集(val...原创 2019-08-05 10:43:33 · 1016 阅读 · 0 评论 -

机器学习————识别验证码

文章目录识别验证码首先生成验证码代码实现识别验证码首先生成验证码代码实现import randomfrom PIL import Image, ImageDraw, ImageFontdef getRandomStr(): random_num = str(random.randint(0, 9)) return random_numdef getRand...原创 2019-08-12 14:06:21 · 343 阅读 · 0 评论 -

机器学习————SVM支持向量机

文章目录机器学习————SVM支持向量机支持向量机的损失函数由逻辑回归的损失函数改进至支持向量机的损失函数向量内积性质的复习SVM的核函数:用来使SVM能够处理非线性分类如何选择标记点呢?机器学习————SVM支持向量机支持向量机的损失函数由逻辑回归的损失函数改进至支持向量机的损失函数向量内积性质的复习SVM的核函数:用来使SVM能够处理非线性分类给定了x后,通过计算和...原创 2019-08-12 11:55:35 · 738 阅读 · 0 评论 -

机器学习————朴素贝叶斯

文章目录朴素贝叶斯独立事件朴素贝叶斯独立事件我们现在用p1(x,y)表示数据点(x,y)属于类别1(圆)的概率,用p2(x,y)表示数据点(x,y)属于类别2(三角)的概率那么对于一个新的数据点(x,y) 我们可以用下面的规则来判断它的类型如果p1(x,y) > p2(x,y),那么类别为1如果p2(x,y) > p1(x,y),那么类别为2独立事件:在一次实验中,一...原创 2019-08-12 11:47:24 · 135 阅读 · 0 评论 -

机器学习————聚类

文章目录机器学习————聚类聚类聚类算法计算距离相似度簇K-Means聚类K-Means 改进K-Mediods二分K-MeansK均值损失函数机器学习————聚类聚类聚类是一个无监督的算法有X没有Y利用X相似性对大量未标注的数据集,按内在相似性划分为多个类别,类别内相似度大,类之间相似度小聚类算法计算距离欧几里得距离(欧式距离)欧几里得距离(欧式距离)曼哈顿距离闵可夫...原创 2019-08-12 11:40:01 · 1289 阅读 · 0 评论 -

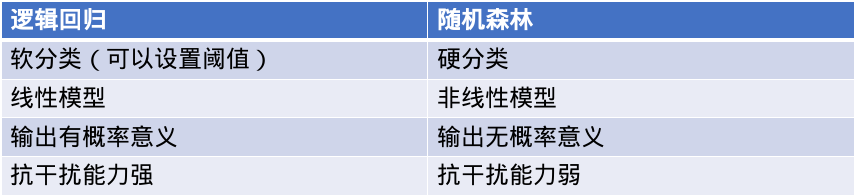

机器学习————决策树&随机森林

文章目录机器学习————决策树&随机森林决策树损失函数决策树的参数决策树和逻辑回归的比较代码实现决策树随机森林随机森林和逻辑回归的比较剪枝:就是决策数的正则化机器学习————决策树&随机森林决策树决策树是一种非线性有监督离散型分类模型决策树是通过固定...原创 2019-08-12 11:21:19 · 699 阅读 · 0 评论 -

机器学习————卷积神经网络代码实现

import tensorflow as tffrom tensorflow.examples.tutorials.mnist import input_dataimport osfrom PIL import Imagemnist = input_data.read_data_sets('MNIST_data_bak/', one_hot=True)sess = tf.Interac...原创 2019-08-19 15:14:38 · 376 阅读 · 0 评论 -

机器学习————卷积神经网络

文章目录卷积神经网络案例:计算机如何模拟人的行为进行识别计算机处理图像识别的思路神经网络和卷积神经网络的联系卷积神经网络的基础 – 卷积运算卷积神经网络的原理 - 边缘检测卷积神经网络的原理 - 灰度图卷积神经网络的原理 - 边缘检测的另一个例子卷积神经网络的原理 - 不同的边缘检测过滤器卷积核的表示Padding & Stride (填充和步长)卷积运算的缺点解决的方法Vaild...原创 2019-08-19 15:13:07 · 315 阅读 · 0 评论 -

机器学习————神经网络的算法优化

文章目录神经网络的算法优化正则化Inverted DropOut反向随机失活梯度下降的优化算法指数加权平均指数加权平均的作用动量梯度算法RMSpropAdamSoftmax代码实现tensorflow实现DNNSoftmax_regression神经网络的算法优化正则化Inverted DropOut反向随机失活d3 = np.randm.rand(a3.shape[0], a3.sha...原创 2019-08-19 14:16:34 · 632 阅读 · 0 评论 -

机器学习————神经网络

文章目录神经网络神经网络的介绍神经元感知器与神经网络线性阈值单元LTU一个神经元的数学表示一层神经网络的数学表示神经网络的TF-IDF激活函数为什么需要非线性激活函数如何训练神经网络反向传播的理解计算图计算图的导数神经网络的梯度下降神经网络的传播过程的公式推导总结神经网络神经网络的介绍神经网络是为了模拟人的大脑神经网络起源于1943年,A Logical Calculus of Ideas...原创 2019-08-19 14:00:44 · 375 阅读 · 0 评论 -

机器学习————逻辑回归练习(音乐分析)

文章目录逻辑回归练习(音乐分析)问题详情代码实现结果图示逻辑回归练习(音乐分析)问题详情根据已给的数据预测出测试数据的音乐风格代码实现'''Date:2019-08-04 16:53User:ChenXiE-mail:15091630326@163.com'''import numpy as npfrom sklearn.linear_model import Logisti...原创 2019-08-05 14:32:13 · 360 阅读 · 0 评论 -

机器学习————逻辑回归

文章目录逻辑回归逻辑回归的引入更新的模型:为什么要用sigmoid函数逻辑回归的决策边界逻辑回归的损失函数熵逻辑回归逻辑回归的引入有监督机器学习线性回归:预测一个连续的值逻辑回归:预测一个离散的值当我们要做二分类的时候,我们一般只希望得到两个值 y = 0 或 1但是, 线性回归得到的值是在一个范围内的连续值,而且可能远 > 1 或远 < 0这样会给分类带来困难我...原创 2019-08-05 14:07:13 · 210 阅读 · 0 评论 -

机器学习—————线性回归、损失函数

文章目录线性回归一元线性回归梯度下降多变量线性回归建立模型多元梯度下降特征缩放(归一化)特征缩放——最大值方法特征缩放——平方均值法损失函数随机梯度下降和‘Mini-batch’梯度下降如何选择:线性回归一元线性回归一元线性回归是分析只有一个自变量(自变量x和因变量y)线性相关关系的方法。对于一元线性回归(单变量线性回归)来说,学习算法为 y = ax + b我们换一种写法: hθ(x)...原创 2019-08-05 11:53:55 · 1722 阅读 · 0 评论 -

机器学习————keras与循环神经网络

文章目录keraskeras的优点通过keras建立序列模型循环神经网络RNN什么是循环神经网络RNN模型RNN的前向传播的算法keraskeras的优点Keras是一个高层神经网络API,Keras由纯Python编写而成并基Tensorflow、Theano以及CNTK后端。keras具有以下优点:简易和快速的原型设计(keras具有高度模块化,极简,和可扩充特性)支持CNN和RN...原创 2019-08-26 15:26:09 · 386 阅读 · 0 评论

分享

分享