近年来,视频生成模型(Video Generation Model)以其惊人的图像生成能力逐渐受到关注,特别是基于DiT(Diffusion Transformer)架构的模型在视频生成领域获得了显著突破。然而,业内对其是否真正“理解”物理规律一直存在争议,OpenAI曾宣称通过扩大模型参数和数据量,视频生成模型或许能成为“物理世界通用模拟器”。但许多学者,包括图灵奖得主杨立昆(Yann LeCun)和Keras之父弗朗索瓦·肖莱(François Chollet),则持怀疑态度。

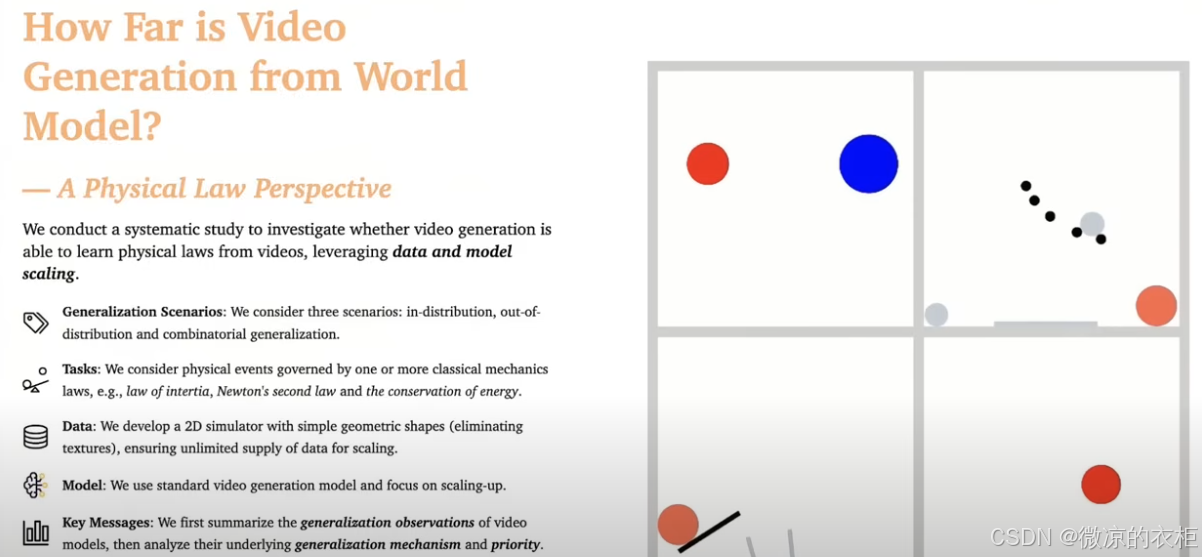

为解决这一疑问,字节跳动豆包团队历时8个月,进行了系统性研究,并发布了一篇题为《视频生成距离世界模型还有多远:站在物理定律的视角》的研究论文。这项研究从物理定律的角度出发,测试了视频生成模型在物理规律理解上的局限性。该研究结果发布后,引起了学术界的广泛关注,杨立昆等业内权威也对该研究表示了认可。

1. 研究背景与问题探讨

视频生成模型近年来发展迅速,从OpenAI的Sora模型到其他基于DiT架构的生成系统,视频生成的效果已愈发逼真。然而,生成的图像效果是否等同于理解了物理规律?这一问题的答案对视频生成模型的实际应用有着深远影响。只有真正“理解”物理规律的模型,才能成为“世界模型”,在实际场景中具有更广泛的泛化能力和应用价值。

1.1 视频生成模型的现状与局限性

视频生成模型的基本工作原理是通过逐帧生成视频内容,使视频连贯且逼真。然而,许多业内人士质疑,模型在生成逼真图像的同时,是否真的能抽象出物理世界中的规律。具体而言,模型是否能在未经训练的物理场景中准确预测物体的运动?例如,牛顿定律或抛物线运动等基本物理定律在视频生成模型中能否得到体现?

杨立昆认为,Sora等模型无法真正理解物理世界,因为其本质上是通过像素生成建模,而非基于物理规律进行推理。相比之下,弗朗索瓦·肖莱则指出,Sora模型的确具备“物理模型”,但其泛化能力和对新情境的预测力仍存在疑问。

2. 研究方法与实验设计

豆包团队为定量分析视频生成模型对物理规律的理解程度,专门开发了一个物理引擎,用于合成经典物理场景的视频,如匀速直线运动、弹性碰撞、抛物线运动等。研究团队基于这些视频训练模型,并通过对比生成视频的物体运动状态,评估其是否符合经典物理学方程。

2.1 泛化能力的定义

在研究过程中,团队考察了视频生成模型的三种泛化能力:

- 分布内泛化(ID):训练数据和测试数据来自同一分布。

- 分布外泛化(OOD):当模型面对从未见过的新场景时,是否能应用学到的物理规律。

- 组合泛化:训练数据包含了所有的概念或物体,但这些物体的组合方式在训练集中未完全出现。

2.2 实验设置与物理场景

豆包团队选择了三种典型的物理场景:匀速直线运动、弹性碰撞和抛物线运动,通过不同的数据集和模型规模的扩展,评估视频生成模型在这三种运动下的表现。

- 匀速直线运动:一个球在水平方向上匀速运动,以体现惯性定律。

- 弹性碰撞:两个球在碰撞后保持动量守恒和能量守恒。

- 抛物线运动:一个球在重力作用下沿抛物线轨迹下落,以体现牛顿第二定律。

3. 研究结果与分析

豆包团队的实验结果显示,虽然模型在分布内泛化中表现较好,随着模型规模和数据量的增加,生成视频的误差确实降低,但在分布外泛化上,模型表现欠佳,且增加数据量和模型参数对降低OOD误差影响不大。

3.1 分布内与分布外泛化的对比

在分布内泛化中,模型能够较好地保持物理规律。例如,模型在匀速直线运动的训练数据中,可以生成符合惯性定律的运动。然而,一旦超出训练数据范围(例如更高或更低的速度区间),模型则无法遵循物理规律。

3.2 组合泛化的测试

为测试组合泛化能力,团队使用了Phyre模拟器,构建了多种物体组合场景,并发现随着训练数据组合数量的增加,模型在未见过的组合场景中的表现显著提升。然而,在模板内测试中,模型的表现仍优于模板外,这表明模型依赖于特定的训练样本,难以完全脱离训练数据的限制实现泛化。

4. 视频生成模型的局限性与Scaling Law

研究表明,单纯按照“Scaling Law”增加模型参数和数据量,并不足以让视频生成模型“理解”物理规律。虽然模型在特定的分布内生成表现较好,但在新情境中的泛化能力依然不足。特别是在复杂物理场景下,模型对案例的依赖大于对物理规律的抽象理解。

4.1 模型属性选择的偏向性

实验还发现,视频生成模型在生成新视频时,更倾向于通过颜色、大小等显著属性来寻找相似参考,而非通过形状。这也解释了现有视频生成模型在保持形状一致性上的困难,模型在运动状态的生成上偏向颜色、大小等属性组合,难以实现基于形状的精确预测。

4.2 视觉模糊对物理建模的影响

研究进一步表明,视频生成模型在细粒度物理建模方面也存在误差,例如物体尺寸的像素级差异可能导致物理预测不准确。因此,单纯依赖视觉表示难以进行精确的物理建模。

5. 未来展望:通向“世界模型”之路

豆包团队的研究结果表明,目前的DiT架构视频生成模型在理解物理规律方面依然面临巨大挑战。单纯依赖视觉像素生成模型难以实现对物理规律的抽象推理能力。因此,构建真正的“世界模型”还需要进一步探索新架构和新算法,或引入多模态信息来丰富物理规律的表征。

未来的研究方向或许应更多关注以下几点:

- 数据集的多样性:构建涵盖丰富组合场景的数据集,以提升模型的组合泛化能力。

- 多模态学习:通过引入多模态信息,例如物体属性、触觉信息等,弥补视觉模糊带来的物理建模缺陷。

- 新架构探索:探索更接近人类认知的建模方法,使模型不仅限于像素级学习,而是真正能通过抽象推理理解物理规律。

6. 总结

豆包团队的研究为视频生成模型的物理规律泛化能力提供了系统性验证,证实目前的视频生成模型还不足以理解物理规律。通过该研究,学术界和工业界对视频生成模型的潜力和局限性有了更深入的认知,未来的研究或将朝向更深层次的世界模型发展。

视频生成模型的真正突破,不仅需要更大的数据量和更复杂的模型,还需要理解和抽象出通用的物理规律,走向“理解”而非“记忆”。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?