-

集成学习

集成学习 (ensemble learning)通过构建并结合多个学习器来完成学习任务。先产生一组"个体学习器" (individual learner),再用某种策略将它们结合起来。 -

个体学习器

个体学习器通常由一个现有的学习算法从训练数据产生,例如 C4.5 决策树算法、 BP 神经网络算法等。当集成中只包含同种类型的个体学习器,例如"决策树集成" 中全是决策树,“神经网络集成"中全是神经网络,这样的集成是"同质” 的(homogeneous)。 集成也可包含不同类型的个体学习器,例如同时包含决策树和神经网络,这样的集成是"异质"的(heterogenous)。

在一般经验中,如果把好坏不等的东西掺到一起,那么通常结果会是比最坏的要好一些,比最好的要坏一些。集成学习把多个学习器结合起来,如何能获得比最好的单一学习器更好的性能呢?

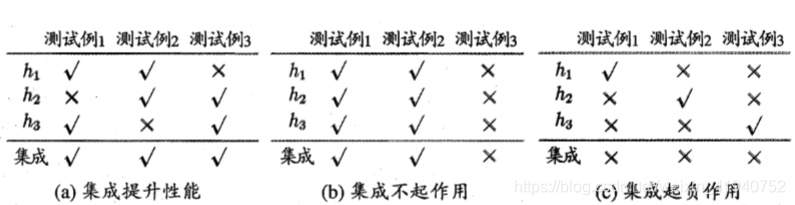

考虑一个简单的例子:在二分类任务中,假定三个分类器在三个测试样本上的表现如图 所示,集成学习的结果通过投票法产生,即"少数服从多数"在图(a) 中,每个分类器都只有 66.6% 的精度,但集成学习却达到了 100%;在图(b)中,三个分类器没有差别,集成之后性能没有提高;在图 ©中,每个分类器的精度都只有 33.3%,集成学习的结果变得更糟。这个简单的例子显示出:要获得好的集成,个体学习器应"好而不同”,即个体学习器要有一定的准确性,且个体学习器之间要有差异。 -

boosting与bagging

Boosting 是串行式集成学习方法最著名的代表。这族算法的工作机制类似:先从初始训练集训练出一个基学习器,再根据基学习器的表现对训练样本分布进行调整,使得先前基学习器做错的训练样本在后续受到更多关注,然后基于调整后的样本分布来训练下一个基学习器;如此重复进行,直至基学习器数目达到事先指定的值 T, 最终将这 T 个基学习器进行加权结合。Boosting 族算法最著名的代表是 AdaBoost。

从偏差一方差分解的角度看出, Boosting 主要关住降低偏差,因此 Boosting 能基于泛化性能相当弱的学习器构建出很强的集成。

Bagging 是并行式集成学习方法最著名的代表。从名字即可看出,它直接基于西瓜书 2.2.3 节介绍过的自助采样法 (bootstrap sampling)。给定包含 m 个样本的数据集,我们先随机取出一个样本放入采样集中,再把该样本放回初始数据集,使得下次采样时该样本仍有可能被选中,这样,经过 m 次随机采样操作,我们得到含 m 个样本的采样集,初始训练集中有的样本在采样集里多次出现,有的则从未出现。由西瓜书中式(2.1)可知,初始训练集中约有 63.2% 的样本出现在来样集中。

采样出 T 个含 m 个训练样本的采样集,然后基于每个采样集训练出一个基学习器,再将这些基学习器进行结合。这就是 Bagging 的基本流程。在对预测输出进行结合时, Bagging 通常对分类任务使用简单投票法,对回归任务使用简单平均法。若分类预测时出现两个类收到同样票数的情形,则最简单的做法是随机选择一个,也可进一步考察学习器投票的置信度来确定最终胜者。

Bagging 是一个很高效的集成学习算法,与标准 AdaBoost 只适用于二分类任务不同, Bagging 能不经修改地用于多分类、回归等任务。

自助采样过程还给 Bagging 带来了另一个优点:由于每个基学习器只使用了初始训练集中约 63.2% 的样本&#x

随机森林

最新推荐文章于 2025-03-05 20:33:01 发布

集成学习通过构建多个学习器结合以提升性能,其中随机森林是重要代表。随机森林结合了 Bagging 和属性随机选择,增加了个体学习器的多样性。随机森林在处理高维数据和特征缺失时表现出色,其优点包括高效训练、提供特征重要性评估。但也有过拟合风险,需合理调整参数,如 n_estimators、max_features 等。

集成学习通过构建多个学习器结合以提升性能,其中随机森林是重要代表。随机森林结合了 Bagging 和属性随机选择,增加了个体学习器的多样性。随机森林在处理高维数据和特征缺失时表现出色,其优点包括高效训练、提供特征重要性评估。但也有过拟合风险,需合理调整参数,如 n_estimators、max_features 等。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3442

3442

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?