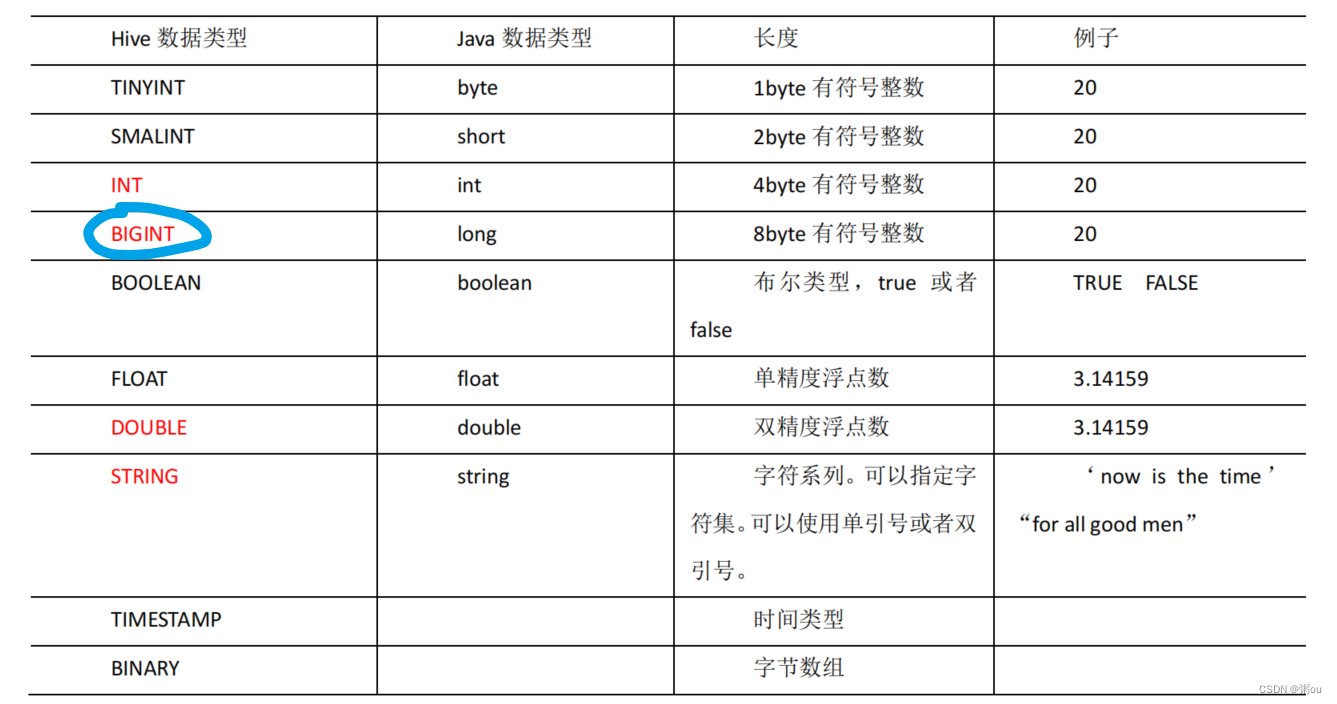

Hive 数据类型

基本数据类型

Hive 的 String 类型相当于数据库的 Varchar 类型

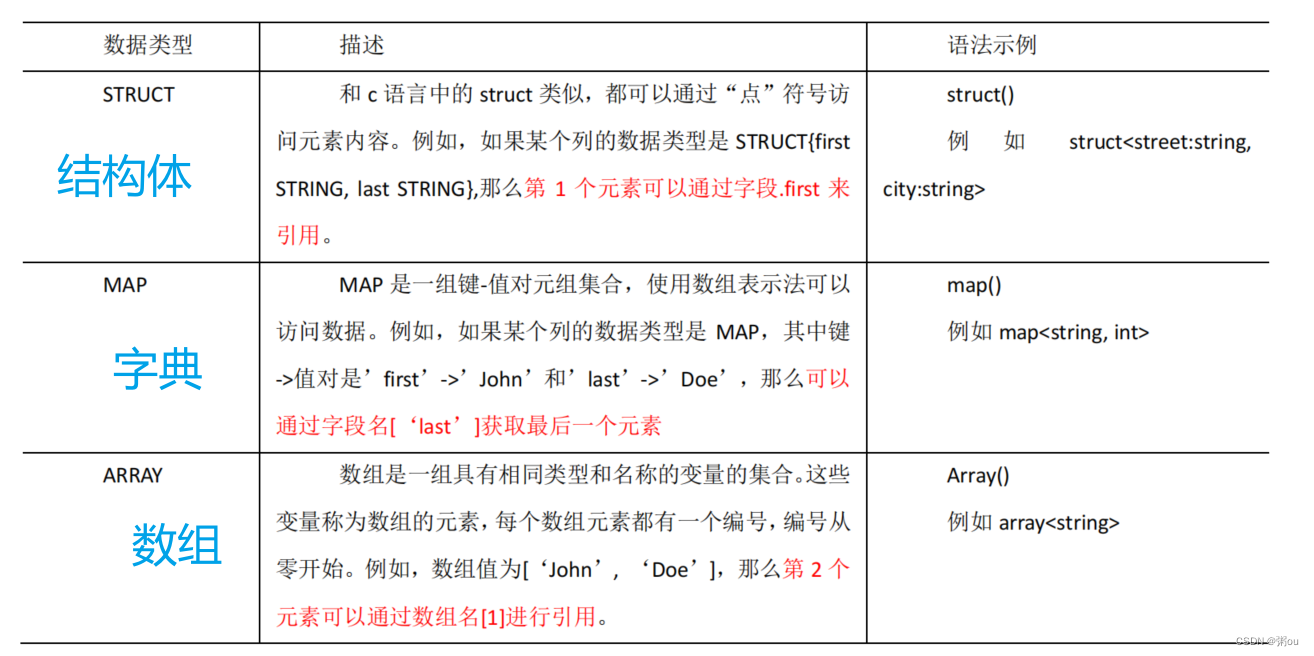

集合数据类型

Hive

有三种复杂数据类型

ARRAY

、

MAP

和

STRUCT

。

ARRAY

和

MAP

与

Java

中的

Array

和

Map

类似,而

STRUCT

与

C

语言中的

Struct

类似,它封装了一个命名字段集合,复杂数据

类型允许任意层次的嵌套。

假设某表有如下一行(JSON格式表示)

{

"name": "songsong",

"friends": ["bingbing" , "lili"] , //列表 Array,

"children": { //键值 Map,

"xiao song": 18 ,

"xiaoxiao song": 19

}

"address": { //结构 Struct,

"street": "hui long guan",

"city": "beijing"

} }

创建本地测试文件 test.txt

songsong,bingbing_lili,xiao song:18_xiaoxiao song:19,hui long guan_beijing

yangyang,caicai_susu,xiao yang:18_xiaoxiao yang:19,chao yang_beijing

MAP

,

STRUCT

和

ARRAY

里的元素间关系都可以用同一个字符表示,这里用

“_”

Hive 上创建测试表

test

create table test(

name string,

friends array<string>,

children map<string, int>,

address struct<street:string, city:string> )

row format delimited fields terminated by ','

collection items terminated by '_'

map keys terminated by ':'

lines terminated by '\n';

row format delimited fields terminated by ',' --

列分隔符

collection items terminated by '_' --MAP STRUCT

和

ARRAY

的分隔符

(

数据分割符号

)

map keys terminated by ':' -- MAP 中的

key

与

value

的分隔符

lines terminated by '\n'; -- 行分隔符

导入文本数据到测试表

load data local inpath '/opt/module/hive/datas/test.txt' into table test;访问三种集合列里的数据,以下分别是 ARRAY,MAP,STRUCT 的访问方式

hive (default)> select friends[1],children['xiao song'],address.city from

test where name="songsong";

OK

_c0 _c1 city

lili 18 beijing

Time taken: 0.076 seconds, Fetched: 1 row(s)

隐式类型转换规则:

任何类型都可以隐式地转换为一个范围更广的类(小的类型可以转到大的类型)

BOOLEAN

类型不可以转换为任何其它的类型。

使用

CAST

操作显示进行数据类型转换:

CAST('1' AS INT)

将把字符串

'1'

转换成整数

1

;如果强制类型转换失败,如执行 CAST('X' AS INT),表达式返回空值

NULL

hive (default)> select '1'+2,cast('1' as int)+2;

OK

_c0 _c1

3.0 3

Time taken: 2.594 seconds, Fetched: 1 row(s)

DDL 数据定义 acd(alter ,create,drop)

创建数据库

创建一个数据库,数据库在

HDFS

上的默认存储路径是

/user/hive/warehouse/*.db

hive (default)> create database if not exists db_hive;

创建一个数据库,指定数据库在

HDFS

上存放的位置

hive (default)> create database if not exists db_hivetest location '/db_hivetest.db';

OK

Time taken: 0.761 seconds

过滤显示查询的数据库

hive> show databases like 'db_hive*';

OK

db_hive

db_hive_1

显示数据库详细信息

hive (default)> desc database extended db_hivetest;

OK

db_name comment location owner_name owner_type parameters

db_hivetest hdfs://hadoop102:8020/db_hivetest.db xwt USER

Time taken: 0.022 seconds, Fetched: 1 row(s)

修改数据库

用户可以使用

ALTER DATABASE

命令为某个数据库的

DBPROPERTIES

设置键

-

值对属性值, 来描述这个数据库的属性信息

hive (default)> alter database db_hive

set dbproperties('createtime'='20170830');

删除的数据库不存在,最好采用

if exists

判断数据库是否存在

hive (default)> drop database if exists db_hivetest;

如果数据库不为空,可以采用

cascade

命令,强制删除

hive> drop database db_hive cascade;

创建表

建表语法

CREATE [EXTERNAL] TABLE [IF NOT EXISTS] table_name

[(col_name data_type [COMMENT col_comment], ...)]

[COMMENT table_comment]

[PARTITIONED BY (col_name data_type [COMMENT col_comment], ...)]

[CLUSTERED BY (col_name, col_name, ...)

[SORTED BY (col_name [ASC|DESC], ...)] INTO num_buckets BUCKETS]

[ROW FORMAT row_format]

[STORED AS file_format]

[LOCATION hdfs_path]

[TBLPROPERTIES (property_name=property_value, ...)]

[AS select_statement]

EXTERNAL

关键字可以让用户创建一个外部表,在建表的同时可以指定一个指向实

际数据的路径(

LOCATION

),

在删除表的时候,内部表的元数据和数据会被一起删除,而外

部表只删除元数据,不删除数据。内部表又叫管理表,

删除一个管理表时,

Hive

也会删除这个表中数据。管理表不适合和其他工具共享数据。

STORED AS

指定存储文件类型

常用的存储文件类型:

SEQUENCEFILE

(二进制序列文件)、

TEXTFILE

(文本)、

RCFILE

(列

式存储格式文件)

如果文件数据是纯文本,可以使用

STORED AS TEXTFILE

。如果数据需要压缩,使用

STORED

AS SEQUENCEFILE

。

LOCATION

:指定表在

HDFS

上的存储位置。

AS:后跟查询语句,根据查询结果创建表。

LIKE 允许用户复制现有的表结构,但是不复制数据。

案例实操

原始数据

1001 ss1

1002 ss2

1003 ss3

1004 ss4

1005 ss5

1006 ss6

1007 ss7

1008 ss8

1009 ss9

1010 ss10

1011 ss11

1012 ss12

1013 ss13

1014 ss14

1015 ss15

1016 ss16

(1)普通创建表

create table if not exists student(

id int, name string

)

row format delimited fields terminated by '\t'

stored as textfile

location '/user/hive/warehouse/student';

(2)根据查询结果创建表(查询的结果会添加到新创建的表中)

create table if not exists student2 as select id, name from student;

(3)根据已经存在的表结构创建表

create table if not exists student3 like student;

(4)查询表的类型

hive (default)> desc formatted student2;

Table Type: MANAGED_TABLE

外部表

因为表是外部表,所以

Hive

并非认为其完全拥有这份数据。删除该表并不会删除掉这 份数据,不过描述表的元数据信息会被删除掉。

实操

分别创建部门和员工外部表,并向表中导入数据。

原始数据

dept:

10 ACCOUNTING 1700

20 RESEARCH 1800

30 SALES 1900

40 OPERATIONS 1700

emp

:

7369 SMITH CLERK 7902 1980-12-17 800.00 20

7499 ALLEN SALESMAN 7698 1981-2-20 1600.00 300.00 30

7521 WARD SALESMAN 7698 1981-2-22 1250.00 500.00 30

7566 JONES MANAGER 7839 1981-4-2 2975.00 20

7654 MARTIN SALESMAN 7698 1981-9-28 1250.00 1400.00 30

7698 BLAKE MANAGER 7839 1981-5-1 2850.00 30

7782 CLARK MANAGER 7839 1981-6-9 2450.00 10

7788 SCOTT ANALYST 7566 1987-4-19 3000.00 20

7839 KING PRESIDENT 1981-11-17 5000.00 10

7844 TURNER SALESMAN 7698 1981-9-8 1500.00 0.00 30

7876 ADAMS CLERK 7788 1987-5-23 1100.00 20

7900 JAMES CLERK 7698 1981-12-3 950.00 30

7902 FORD ANALYST 7566 1981-12-3 3000.00 20

7934 MILLER CLERK 7782 1982-1-23 1300.00 10

(1)上传数据到 HDFS

hive (default)> dfs -mkdir /student;

hive (default)> dfs -put /opt/module/datas/student.txt /student;

(2)建表语句,创建外部表

创建部门表

create external table if not exists dept(

deptno int,

dname string,

loc int

)

row format delimited fields terminated by ' ';

创建员工表

create external table if not exists emp(

empno int,

ename string,

job string,

mgr int,

hiredate string,

sal double,

comm double,

deptno int)

row format delimited fields terminated by ' ';

(3)查看表格式化数据

hive (default)> desc formatted dept;

Table Type: EXTERNAL_TABLE

(4)删除外部表

hive (default)> drop table dept;

外部表删除后,hdfs 中的数据还在,但是 metadata 中 dept 的元数据已被删除

管理表与外部表的互相转换

修改内部表

student2

为外部表

alter table student2 set tblproperties('EXTERNAL'='TRUE');

修改外部表

student2

为内部表

alter table student2 set tblproperties('EXTERNAL'='FALSE');

重命名表

hive (default)> alter table dept_partition2 rename to dept_partition3;

增加

/

修改

/

替换列信息

(1)更新列,更新某一列(列名,数据类型)

ALTER TABLE table_name CHANGE [COLUMN] col_old_name col_new_name column_type

hive (default)> alter table dept change column deptdesc desc string;

(2)增加和替换列

ALTER TABLE table_name ADD|REPLACE COLUMNS (col_name data_type [COMMENT col_comment], ...)

注:ADD 是代表新增一字段,字段位置在所有列后面 REPLACE 则是表示替换表中所有字段。

hive (default)> alter table dept add columns(deptdesc string);

hive (default)> alter table dept replace columns(deptno string, dname

string, loc string);删除列可用替换列操作进行代替

删除表

hive (default)> drop table dept;DML 数据操作 dui

数据导入

向表中装载数据(

Load

)

hive> load data [local] inpath '数据的 path' [overwrite] into table student [partition (partcol1=val1,…)];(1)load data:表示加载数据

(2)local:表示从本地加载数据到 hive 表;否则从 HDFS 加载数据到 hive 表

(3)inpath:表示加载数据的路径

(4)overwrite:表示覆盖表中已有数据,否则表示追加

(5)into table:表示加载到哪张表

(6)student:表示具体的表

本地是cp,hdfs是mv,只是修改了namenode里的元数据,所以快。

实操

创建一张表

hive (default)> create table student(id string, name string) row format delimited fields terminated by '\t';

(1)加载本地文件到 hive

hive (default)> load data local inpath '/opt/module/hive/datas/student.txt' into table default.student;

(2)加载

HDFS

文件到

hive

中

上传文件到

HDFS

dfs -put /opt/module/hive/data/student.txt /user/xwt/hive;

加载

HDFS

上数据

hive (default)> load data inpath '/user/xwt/hive/student.txt' into table default.student;

(3)加载数据覆盖表中已有的数据

hive (default)> load data inpath '/user/xwt/hive/student.txt' overwrite into table default.student;

通过查询语句向表中插入数据(

Insert

)

1)

基本插入数据

hive (default)> insert into table student values(1,'wangwu'),(2,'zhaoliu');

2)基本模式插入(根据单张表查询结果)

hive (default)> insert overwrite table student select id, name from student where month='201709';

insert into

:以追加数据的方式插入到表或分区,原有数据不会删除

insert overwrite

:

会覆盖表中已存在的数据

注意:

insert

不支持插入部分字段(列信息保持一致)

3)多表(多分区)插入模式(根据多张表查询结果)

hive (default)> from student

insert overwrite table student partition(month='201707')

select id, name where month='201709'

insert overwrite table student partition(month='201706')

select id, name where month='201709';

创建表,并指定在

hdfs

上的位置

hive (default)> create external table if not exists student5(

id int, name string

)

row format delimited fields terminated by '\t'

location '/student;数据导出

Insert

导出

1

)将查询的结果导出到本地

hive (default)> insert overwrite local directory

'/opt/module/hive/data/export/student'

select * from student;

2

)将查询的结果格式化导出到本地

hive(default)>insert overwrite local directory

'/opt/module/hive/data/export/student1'

ROW FORMAT DELIMITED FIELDS TERMINATED BY '\t'

select * from student;

3

)将查询的结果导出到

HDFS

上

(

没有

local)

hive (default)> insert overwrite directory '/user/atguigu/student2'

ROW FORMAT DELIMITED FIELDS TERMINATED BY '\t'

select * from student;

Export

导出到

HDFS

上

hive (default)> export table default.student

to '/user/hive/warehouse/export/student';

Import

数据到指定

Hive

表中

注意:

先用

export

导出后,再将数据导入。

hive (default)> import table student2

from '/user/hive/warehouse/export/student';

export

和

import

主要用于两个

Hadoop

平台集群之间

Hive

表迁移。

清除表中数据(

Truncate

)

注意:

Truncate

只能删除管理表,不能删除外部表中数据

hive (default)> truncate table student;

333

333

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?