从大语言模型的训练过程来理解微调

大预言模型训练主要包含四个阶段:预训练、有监督微调、奖励建模、强化学习。

预训练(Pretraining)阶段需要利用海量的训练数据,完成深度神经网络参数训练,构建基础语言模型 (Base Model)。

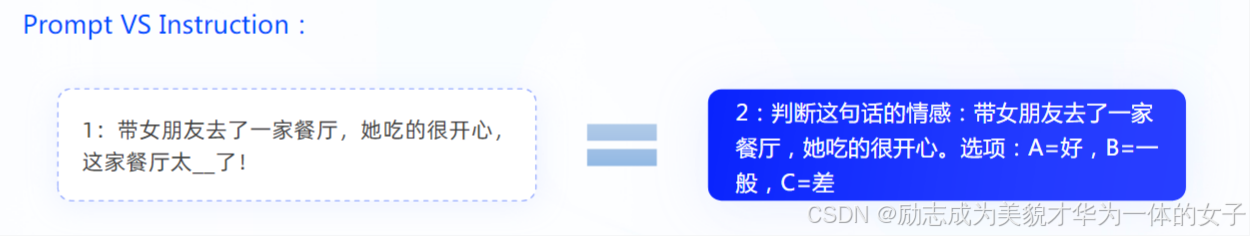

有监督微调(Supervised Finetuning),也称为指令微调(Instruction Tuning),利用少量高质量数据集合,包含用户输入的提示词(Prompt)和对应的理想输出结果。用户输入包括问题、闲聊对 话、任务指令等多种形式和任务。得到有监督微调模型(SFT 模型)

奖励建模(Reward Modeling)阶段目标是构建一个文本质量对比模型,对于同一个提示词,SFT模型给出的多个不同输出结果的质量进行排序。如果 RM 模型的目标是针对 所有提示词系统所生成输出都能够高质量的进行判断,该问题所面临的难度在某种程度上与文本 生成等价,因此如何限定 RM 模型应用的泛化边界也是本阶段难点问题。

强化学习(Reinforcement Learning)阶段根据数十万用户给出的提示词,利用在前一阶段训练的 RM 模型,给出 SFT 模型对用户提示词补全结果的质量评估,并与语言模型建模目标综合得到更好的效果。使用强化学习,在 SFT 模型基础上调整参数,使得最 终生成的文本可以获得更高的奖励(Reward)。由于强化学习方法稳定性不高,并且超参数众多,使得模型收敛难度大,再叠加 RM 模型的准确率问题,使得在大规模 语言模型如何能够有效应用强化学习非常困难。

SFT能学到新知识吗:[论文阅读] 大模型SFT真的能学到新知识吗? - 知乎

大模型微调步骤

数据准备、选择基础模型、设置微调参数(学习率、训练轮次(epochs)、批处理大小(batch size)等超参数)、微调(加载预训练的模型和权重、选择微调方法、选择合适的损失函数和优化器、训练)

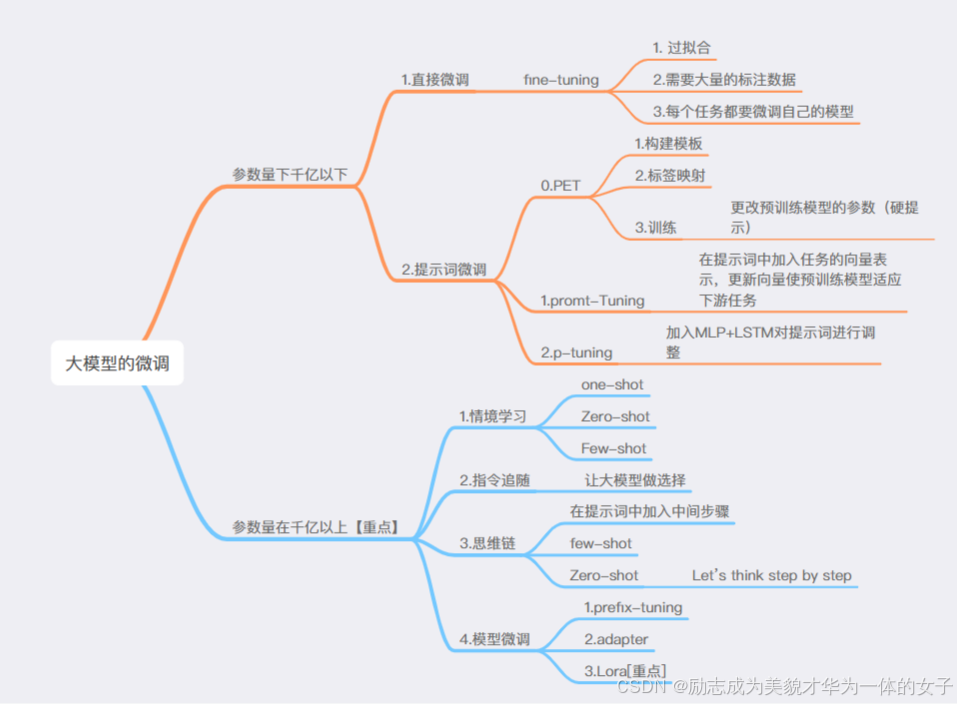

一、按微调参数规模划分

1.1全参微调(Full Parameter Fine-Tuning,FPFT)

用预训练权重作为初始化权重,在特定数据集上继续训练,全部参数都更新。

1.2低参微调(Parameter Efficient Fine-Tuning,PEFT)

用更少的计算资源完成参数的更新,只更新部分参数,或者通过对参数进行某种结构化约束,例如稀疏化或低秩近似解来降低微调的参数量。

可以分为以下三类方法

- 增加额外参数(Additive)。又主要分为:类适配器(Adapter-like)方法、软提示(Soft prompts)

- 选取一部分参数更新(Selective)

- 重参数化(Reparametrization-based)

补充:

稀疏化:稀疏化是指通过去除矩阵或向量中的大部分元素,将其变得稀疏(即非零元素较少)的过程。有阈值法、L1正则化、PCA主成分分析可以实现这些方法。

低秩近似解:矩阵的秩代表了矩阵中线性无关的行(或列)的最大数量,通过减少矩阵的秩来去除冗余信息,同时保留数据的主要特征,从而降低存储空间和计算量。应用于矩阵补全、数据压缩等问题中。可以通过凸或者非凸松弛方法实现。

请复习线性代数的相关知识

1.2.1LoRA

LoRA(Low-Rank Adaptation)是一种旨在微调大型预训练语言模型(如GPT-3或BERT)的技术。其核心理念在于,在模型的决定性层次中引入小型、低秩的矩阵来实现模型行为的微调,而无需对整个模型结构进行大幅度修改。

为了达到降秩且最小化目标矩阵与原矩阵差异的目的,常用的方法是对原矩阵进行奇异值分 解并裁去较小的奇异值。

这种方法的优势在于,在不显著增加额外计算负担的前提下,能够有效地微调模型,同时保留模型原有的性能水准。

LoRA的操作流程如下:

确定微调目标权重矩阵:首先在大型模型(例如GPT)中识别出需要微调的权重矩阵,这些矩阵一般位于模型的多头自注意力和前馈神经网络部分。

引入两个低秩矩阵:然后,引入两个维度较小的低秩矩阵A和B。

计算低秩更新:通过这两个低秩矩阵的乘积AB来生成一个新矩阵,其秩(即r)远小于原始权重矩阵的秩。这个乘积实际上是对原始权重矩阵的一种低秩近似调整。

结合原始权重:最终,新生成的低秩矩阵AB被叠加到原始权重矩阵上。因此,原始权重经过了微调,但大部分权重维持不变。这个过程可以用数学表达式描述为:新权重 = 原始权重 + AB。

以一个具体实例来说,假设我们手头有一个大型语言模型,它通常用于执行广泛的自然语言处理任务。现在,我们打算将其微调,使其在处理医疗健康相关的文本上更为擅长。

AdaLoRA :LoRA 算法给所有的低秩矩阵指定了唯一的秩,从而忽略了不同模块、不同层的参数对于微调 特定任务的重要性差异。因此,文献 [147] 提出了 AdaLoRA(Adaptive Budget Allocation forParameterEfficient Fine-Tuning)算法,在微调过程中根据各权重矩阵对下游任务的重要性动态调整秩的大 小,用以进一步减少可训练参数量的同时保持或提高性能。

1.2.2QLoRA

QLoRA(Quantized Low-Rank Adaptation)是一种结合了LoRA(Low-Rank Adaptation)方法与深度量化技术的高效模型微调手段。

QLoRA的核心在于量化技术:QLoRA采用创新的技术将预训练模型量化为4位。这一技术包括低精度存储数据类型(4-bit NormalFloat,简称NF4)和计算数据类型(16-bit BrainFloat)。这种做法极大地减少了模型存储需求,同时保持了模型精度的最小损失。

补充:

量化是一个将连续信号转换为离散信号的过程

1Byte=8bit

32位浮点数占用4个字节的存储空间。量化后的表示将原始的32位浮点数转换为4位,也就是0.5个字节。新的集合由16个不同的值组成(因为2^4=16)。

微调阶段:在训练期间,QLoRA先以4-bit格式加载模型,训练时将数值反量化到bf16进行训练,这样大幅减少了训练所需的显存。例如,33B的LLaMA模型可以在24 GB的显卡上进行训练。

量化过程的挑战在于设计合适的映射和量化策略,以最小化精度损失对性能的影响。在大型模型中,这种方法可以显著减少内存和计算需求,使得在资源有限的环境下部署和训练成为可能。

1.2.3适配器调整(Adapter Tuning)

适配器调整的方法是在模型的每个层或选定层之间插入小型神经网络模块,称为“适配器”。这些适配器是可训练的,而原始模型的参数则保持不变。

适配器调整的关键步骤包括:

以预训练模型为基础:初始阶段,我们拥有一个已经经过预训练的大型模型,如BERT或GPT,该模型已经学习了丰富的语言特征和模式。

插入适配器:在预训练模型的每个层或指定层中,我们插入适配器。适配器是小型的神经网络,一般包含少量层次,并且参数规模相对较小。

维持预训练参数不变:在微调过程中,原有的预训练模型参数保持不变。我们不直接调整这些参数,而是专注于适配器的参数训练。

训练适配器:适配器的参数会根据特定任务的数据进行训练,使适配器能够学习如何根据任务调整模型的行为。

针对任务的调整:通过这种方式,模型能够对每个特定任务进行微调,同时不影响模型其他部分的通用性能。适配器有助于模型更好地理解和处理与特定任务相关的特殊模式和数据。

高效与灵活:由于只有部分参数被调整,适配器调整方法相比于全模型微调更为高效,并且允许模型迅速适应新任务。

hard prompt和soft prompt:【调研】Soft Prompt Tuning 模型发展调研:P-tuning,Prefix-tuning,Prompt-tuning,P-tuning v2,PPT-CSDN博客

1.2.4前缀调整(Prefix Tuning)

这个链接说明了前缀调整的本质:

模型微调方法Prefix-Tuning_prefix tuning-CSDN博客

1.2.5 提示调整(Prompt Tuning)

前缀微调(Prefix-tining)占用序列长度。有一定方的额外计算开销:前缀微调(Prefix-tining)在每层都加了 prompt的参数,改动较大。只在前边只有一层没有MLP

只在输入层加入 prompt tokens,并且不需要加入MLP进行调整来解决难训练的问题:随着预训练模型参数量的增加,Prompt Tuning的方法会逼近全参数微调的结果。

1.2.6 P-Tuning

同prefiex类似,也是一种连续提示方法,主要适合自然语言理解任务,该方法将Prompt转换为可以学习的Embedding层,并用MLP+LSTM的方式来对Prompt Embedding进行一层处理。相比Prefix Tuning,P-Tuning加入的可微的virtual token,但仅限于输入层,没有在每一层都加;另外,virtual token的位置也不一定是前缀,插入的位置是可选的。这里的出发点实际是把传统人工设计模版中的真实token替换成可微的virtual token。

1.2.7. P-Tuning v2

P-Tuning v2的改进在于,不仅在第一层插入连续提示,而是在多层都插入连续提示,且层与层之间的连续提示是相互独立的。P-Tuning V2是升级版本,主要解决P-Tuning V1 在小参数量模型上表现差的问题. P-Tuning v2 方法的核心思想:在模型的每一层都应用连续的prompts, 并对 prompts 参数进行更新优化. 同时, 该方法也是针对 NLU 任务优化和适配的.具体做法基本同Prefix Tuning,可以看作是将文本生成的Prefix Tuning技术适配到NLU任务中。

二、按训练流程划分

LLM训练流程

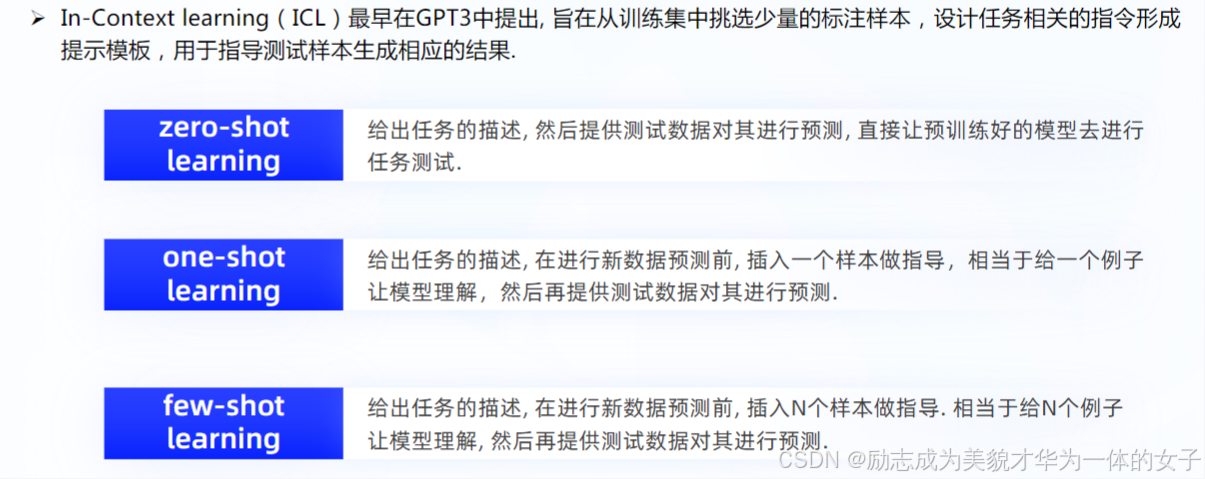

2.1上下文学习(In-Context learning,ICL)

不对 LLMs 执行任何的微调,直接将模型的输入输出拼接起来作为一个prompt,引导模型根据输入的数据结构demo,给出任务的预测结果。提示微调(Prompt Tuning)属于ICL的方式之一。

2.1.1语境学习(Incontext Learning, ICL)

是指模型可以从上下文中的几个例子中学习:向模型输入特定任务的一些具体例子(也称示例(Demonstration))以及要测试的样例,模型可以根据给定的示例续写出测试样例的答案。语境学习的关键思想是从类比中学习,整个过程并不需要对模型进行参数更新,仅执行向前的推理。

2.1.2模型上下文窗口扩展

上下文窗口(context window)是指语言模型在进行预测或生成文本时,所考虑的前一个词元(token)或文本片段的大小范围。

2.2有监督微调(Supervised Fine-Tuning,SFT)

又称指令微调,使用标记数据对预训练模型进行微调的过程

2.3RLHF(Reinforcement Learning from Human Feedback)

还没学完这部分单独写一篇文章

强化学习(Reinforcement Learning)结合人类反馈(Human Feedback)来微调大语言模型

2.3.1强化学习基本概念

智能体在环境中获取某个状态后,会根据该状态输出一个动作,也称为决策。 动作会在环境中执行,环境会根据智能体采取的动作,给出下一个状态以及当前动作所带来的奖励。智能体的目标就是尽可能多地从环境中获取奖励。

从机器狗学习抓飞盘的深入理解强化学习的概念

机器狗扔飞盘,机器狗形成了一个智能体。它会执行动作。飞盘的轨迹、速度构成了环境。机器狗根据当前环境反馈的关于飞盘的状态来决定采取什么动作。同时,根据机器狗所执行的动作,环境随后会给出一个反馈即奖励。

机器狗根据不同的环境状态采取不同的动作的过程就是学习策略的过程,同时它会根据价值函数来预测自己所采取的行为可能带来的奖励是多少。

总体来说,强化学习的目标就是让智能体通过与环境的互动,学习到一个策略,使其能够在将来获得的奖励最大化。这使得强化学习不总是关注近期奖励,而是在短期的奖励与远期奖励之间找到平衡。

动作分类:离散动作空间、连续动作空间

策略:将输入的状态变成动作。随机性策略:根据输入的状态利用概率分布采样一个动作,确定性策略:智能体直接采取最有可能的动作。

价值函数:对未来奖励的预测。

智能体分类:基于价值的智能体(Value-based Agent)显式地学习价值函数,隐式地学习策略。基于策略的智能体(Policy-based Agent)则 是直接学习策略函数。策略函数的输入为一个状态,输出为对应动作的概率。演员-评论员智能体(Actor-critic Agent)则 是把基于价值的智能体和基于策略的智能体结合起来。

在LLM中智能体是模型,动作是它输出的结果

2.3.2基于人类反馈的强化学习

步骤1:预训练语言模型+有标签数据微调

步骤2:训练奖励模型

评判模型输出的回答在人类看来是否质量不错,即输入 [提示(prompt),模型生成的回答] ,奖励模型输出一个能表示回答质量的标量数字。这些不同的排序结果会通过某种归一化的方式变成定量的数据丢给模型训练,从而获得一个奖励模型。也就是一个裁判员。

步骤3:通过强化学习微调语言模型

近端策 略优化的实施流程如下:

(1) 环境采样:策略模型基于给定输入生成一系列的回复,奖励模型则对这些回复进行打分获得奖励。

(2) 优势估计:利用评论模型预测生成回复的未来累积奖励,并借助广义优势估计(Generalized Advantage Estimation,GAE)算法来估计优势函数,能够有助于更准确地评估每次行动的 好处。

(3) 优化调整:使用优势函数来优化和调整策略模型,同时利用参考模型确保更新的策略不会有 太大的变化,从而维持模型的稳定性。

三 总结

提示词工程和参数高效微调是两种微调方法

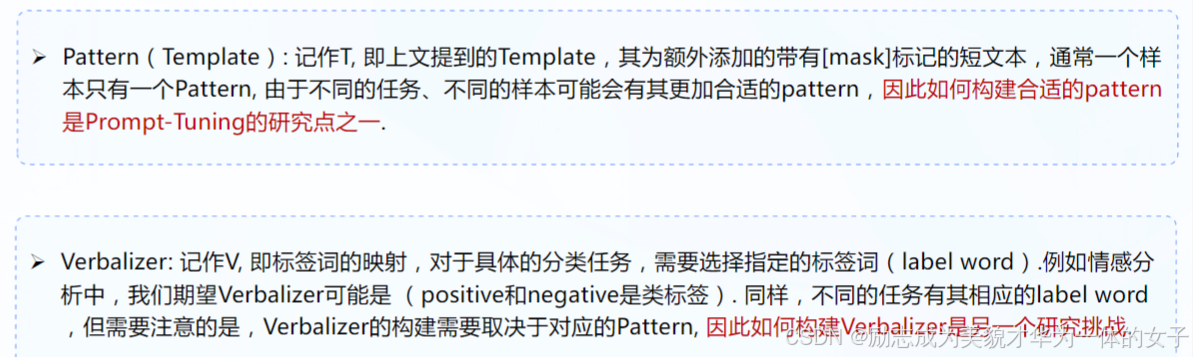

Prompt Tuning:

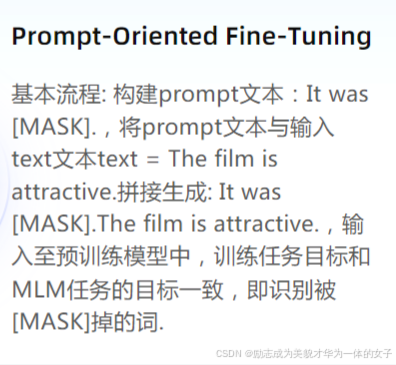

构建模板:获得Prompt-Tuning的输入:[CLS] I like the Disney films very much. [SEP] It was [MASK]. [SEP]. 将其喂入BERT模型中,并复用预训练好的MLM分类器,即可直接得到[MASK]预测的各个token的概率分布.

标签词映射 (Verbalizer ): 因为[MASK]只对部分词感兴趣,因此需要建立一个映射关系. 例如如果[MASK]预测的词是“great” ,则认为是positive类,如果是“terrible”,则认为是negative类.

训练: 根据Verbalizer ,则可以获得指定label word的预测概率分布,并采用交叉信息熵进行训练。此时因为只对预训练好的MLM head进行微调,所以避免了过拟合问题.

通过添加模板的方法来避免引入额外的参数,从而让模型可以在小样本(few-shot)或者零样本(zero-shot)场景下达到理想的效果。

(1)Prompt-Tuning的鼻祖----GPT3:In-context Learning、Demonstrate Learning

(2)PET(Pattern-Exploiting Training):

构建Pattern的方法:Prompt-Oriented Fine-Tuning、Prompt-Tuning、P-Tuning 方法

Prompt-Oriented Fine-Tuning:将目标任务转换为适应预训练模型的预训练任务,预训练模型参数是可变的,果每次针对下游任务,都需要更新预训练模型的参数,资源成本及时间成本都会很高,因此后续陆续提出了不更新预训练模型参数,单纯只针对prompt进行调优的方法.

(3)指令学习(Instruction-Tuning)

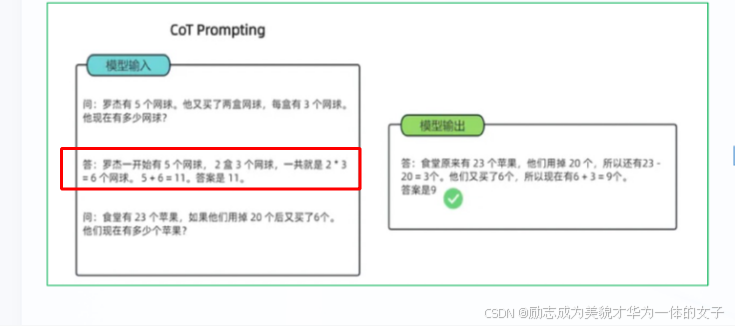

(4)思维链 chain of thought

参考说明

1.【大模型微调】一文掌握7种大模型微调的方法-CSDN博客

2.大模型学习路线(4)——大模型微调_p-tuning v2是全参微调吗-CSDN博客

3.五万字综述!Prompt-Tuning:深度解读一种新的微调范式 - 知乎 (zhihu.com)

4.【大模型开发 】 一文搞懂Fine-tuning(大模型微调)_finetuning大模型-CSDN博客

5. 《大规模语言模型从理论到实践》书第5、6章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?