简介:行人闯红灯自动告警抓拍系统运用图像处理和人工智能算法提高交通安全,减少事故。系统通过高清摄像头实时分析视频流,利用深度学习模型如YOLO或SSD进行目标检测,并结合光流法追踪行人及交通信号灯状态来判断闯红灯行为。告警机制通过多种方式提醒行人,并记录违规证据。系统还具备自我学习和优化能力,通过历史数据提高识别准确性。这套系统在提升交通管理水平和增强公众安全意识方面发挥着重要作用。

1. 智能交通系统应用与图像识别技术

随着城市交通问题的日益严重,智能交通系统(ITS)的发展和应用得到了广泛关注。本章节将介绍智能交通系统的基本概念、发展现状以及图像识别技术在其中的核心作用。

1.1 智能交通系统概述

1.1.1 智能交通系统的定义与发展

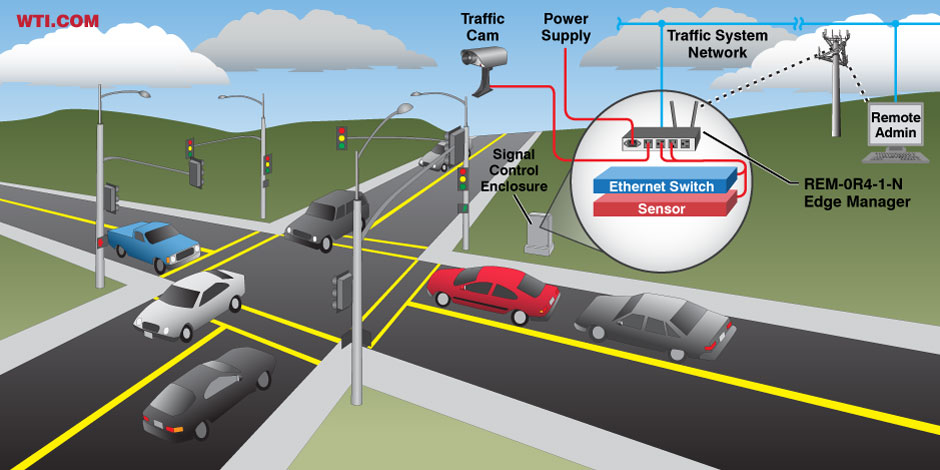

智能交通系统是应用现代信息技术、通信技术、数据处理技术、控制技术和电子传感技术等高新技术,对交通进行管理的综合交通管理系统。它旨在实现交通流的智能调控,提高道路使用效率,减少交通事故,改善交通环境。

1.1.2 行人闯红灯问题与智能交通的关系

行人闯红灯是交通管理中的一个重要问题。智能交通系统能够通过摄像头、传感器等设备采集交通信息,并利用图像识别技术实时监控和分析行人行为,及时发出告警,提高交通安全性。

1.2 图像识别技术在智能交通中的作用

1.2.1 图像识别技术简介

图像识别技术是使用计算机技术来模拟人类视觉系统处理和理解图像的技术。它包括了诸如图像采集、预处理、特征提取、分类器设计等多个方面。

1.2.2 图像识别技术的重要性与应用前景

在智能交通系统中,图像识别技术能够识别并追踪车辆、行人等交通参与者,对于维持交通秩序、预防和减少交通事故具有极其重要的作用。随着深度学习等先进技术的发展,图像识别技术在智能交通领域的应用前景十分广阔。

接下来的章节将会深入探讨图像识别技术在智能交通系统中的具体应用,包括实时视频流分析、目标检测、行为分析和告警机制等方面。

2. 实时视频流分析与目标检测

2.1 实时视频流分析技术

实时视频流分析是智能交通系统中对视频图像进行实时处理的关键技术。它允许系统即时捕捉并分析来自监控摄像头的视频流,以检测和响应交通场景中的各种事件。在这一部分,我们会深入探讨视频流的获取与处理方法,并面对技术难点提出解决方案。

2.1.1 视频流的获取与处理

视频流获取主要通过安装在交通路口的摄像头实现,这些摄像头连续不断地捕获图像并转换为数字信号,形成视频流。视频流处理包括了视频帧的接收、解码、以及可能的格式转换等步骤。

例如,在使用FFmpeg这类工具时,可以实现视频流的实时获取和初步处理。以下是一个简单的FFmpeg命令行示例,用于获取和预处理视频流:

ffmpeg -i "rtsp://192.168.1.1/cam/realmonitor?channel=1&subtype=0" -vf "fps=25,scale=640:480" -vcodec mpeg4 -f mpegts udp://239.255.1.1:5004

这个命令做了以下几件事: - -i 参数指定了输入源,这里是一个RTSP协议的网络摄像头。 - -vf 参数用于指定视频过滤器,这里设置帧率为每秒25帧,视频分辨率调整为640x480像素。 - -vcodec 和 -f 参数则分别指定视频编码格式和输出格式。

经过处理的视频流将被送往后续的目标检测算法进行分析。

2.1.2 视频流分析的技术难点与解决方案

视频流分析面临的主要技术难点包括实时处理性能、准确率、以及环境变化适应性。例如,不同的天气条件、光照变化、甚至是摄像头角度变动都会对分析结果产生影响。

为应对这些挑战,常见的解决方案有以下几种:

- 使用高性能硬件 :如GPU加速视频编码与解码,以提高处理速度。

- 优化算法 :通过深度学习等技术训练模型,以提高对复杂环境的适应性。

- 多传感器数据融合 :结合来自不同传感器的数据(如红外、激光雷达),提升检测准确率。

2.2 目标检测与位置定位算法

目标检测是智能交通系统的核心任务之一,它旨在从视频流中检测出行人、车辆等目标,并对其位置进行精确定位。

2.2.1 目标检测的基本原理与方法

目标检测可以分为传统图像处理方法和深度学习方法。传统的图像处理方法依赖于手工设计的特征和分类器,比如背景差分法和帧间差分法。而深度学习方法通常采用卷积神经网络(CNN)来自动提取特征和完成分类任务,例如R-CNN、YOLO和SSD等。

以YOLO(You Only Look Once)算法为例,其检测过程可以分为以下几个步骤:

- 将输入图像划分为一个个格子。

- 每个格子预测边界框(bounding box)和置信度。

- 对于每个边界框,预测其包含目标的概率。

- 使用非极大值抑制(NMS)来去除重叠的检测框。

YOLO算法的关键优势在于其快速性,每秒可以处理超过40帧,非常适合于实时目标检测。

2.2.2 位置定位技术的实现与优化

位置定位通常指的是确定目标在视频帧中的坐标位置。为了提高定位的精度,常用的技术有:

- 锚框(Anchors)机制 :为不同大小和比例的目标预先设定参考框。

- 特征金字塔网络(FPN) :在多尺度上提取特征,提升小目标的检测性能。

- 高精度检测头 :使用更加复杂的网络结构,如Hourglass网络,对关键点进行精确定位。

在实际应用中,还需要考虑算法的实时性与准确性之间的平衡,以及如何处理监控视频中的复杂场景。

在本章节中,我们探索了实时视频流分析技术与目标检测的基础知识,并讨论了它们在智能交通系统中的具体应用。视频流分析与目标检测技术是智能交通系统的核心组成部分,它们的有效实施对于交通安全管理至关重要。接下来的章节将深入讲解行为分析与闯红灯判断机制,进一步理解智能交通系统是如何识别和响应违规行为的。

3. 行为分析与闯红灯判断机制

3.1 行为分析方法论

3.1.1 行为识别技术的基本框架

行为分析技术是智能交通系统中的核心组成部分,它能够识别和理解交通参与者的行为模式。在智能交通系统中,行为识别技术的基本框架主要由以下几个步骤组成:

- 数据采集:从摄像头等传感器获取实时视频流数据。

- 预处理:对视频流数据进行去噪、增强等预处理操作以提高图像质量。

- 特征提取:从预处理过的图像中提取关键信息,如行人、车辆的速度、方向等。

- 行为模式识别:使用机器学习或深度学习算法分析提取的特征,并识别出特定的行为模式。

行为识别框架利用深度学习中的卷积神经网络(CNN)或循环神经网络(RNN)等模型,能够从连续帧中捕捉到时空信息,实现更为精准的行为理解。

# 示例:使用CNN进行行为识别

from keras.models import Sequential

from keras.layers import Conv2D, MaxPooling2D, Flatten, Dense

# 构建简单的CNN模型

model = Sequential()

model.add(Conv2D(32, (3, 3), activation='relu', input_shape=(64, 64, 3)))

model.add(MaxPooling2D(pool_size=(2, 2)))

model.add(Flatten())

model.add(Dense(units=128, activation='relu'))

model.add(Dense(units=1, activation='sigmoid'))

# 编译模型

model.compile(optimizer='adam', loss='binary_crossentropy', metrics=['accuracy'])

3.1.2 行为分析中的关键问题与技术突破

尽管行为识别技术已取得诸多进展,但仍面临诸多挑战,如动态场景中的复杂背景、不同光照条件下的准确度问题等。解决这些问题的关键技术突破包括:

- 更先进的算法:研究更有效的算法来提高行为识别的准确性和鲁棒性。

- 多传感器融合:结合多种传感器数据,如红外、毫米波雷达等,提高识别效果。

- 上下文感知:利用上下文信息辅助行为分析,提高对复杂场景的理解。

3.2 闯红灯判断与规则制定

3.2.1 闯红灯行为的特征与识别

闯红灯行为的特征通常包括:行人或车辆在红灯亮起时穿过停止线。利用行为识别技术,可以对这些行为特征进行实时捕捉和识别。这要求模型不仅要识别出交通信号灯的状态,还要能够准确地定位行人的位置并判断其行为意图。

3.2.2 制定智能判断规则与算法

制定智能判断规则时,需要考虑多个因素,包括信号灯状态、行人和车辆的位置、行人的移动方向和速度等。使用这些参数,可以构建复杂的判断逻辑,以实现对闯红灯行为的准确识别。

# 示例:判断逻辑实现

import cv2

import numpy as np

# 假设已经得到行人和信号灯的图像区域

pedestrianRegion = None # 行人区域

trafficLightRegion = None # 信号灯区域

# 定义判断逻辑

def judge_red_light_crossing(pedestrianRegion, trafficLightRegion):

# 假设已经对图像区域进行了处理,提取出信号灯颜色和行人状态

lightColor, pedestrianState = process_image(pedestrianRegion, trafficLightRegion)

if lightColor == "red" and pedestrianState == "moving":

return True # 判断为闯红灯

else:

return False # 未闯红灯

# 处理图像函数示例

def process_image(pedestrianRegion, trafficLightRegion):

# 对图像区域进行处理和分析

# 返回信号灯颜色和行人状态

pass

# 判断闯红灯行为

if judge_red_light_crossing(pedestrianRegion, trafficLightRegion):

print("闯红灯行为被检测到")

else:

print("正常行为")

在上述代码中,通过定义判断逻辑和图像处理函数,可以实现对行人闯红灯行为的智能识别。实际应用中,图像处理和逻辑判断会更为复杂,涉及大量的图像分析和机器学习算法。

4. ```

第四章:告警机制与多媒体告警方式

告警机制是智能交通系统中的重要组成部分,其作用在于及时发现并通知交通违规行为或潜在的安全威胁。一个有效的告警机制应具备快速响应、准确识别与高效通信三大特征。在本章节中,我们将详细介绍告警机制的设计与实施方法,并深入探讨多媒体告警方式的实现原理。

4.1 告警机制的设计与实施

4.1.1 告警机制的重要性与目标

告警机制的建立基于对交通场景中异常事件或违规行为的实时监控和分析,其核心目的在于减少事故发生的可能性、降低安全风险,并提供及时的反馈给管理者或直接参与交通的个体。其主要目标包括但不限于以下几点:

- 即时性 :告警系统必须能够在违规行为发生时,立即发出告警,以便相关人员可以迅速采取行动。

- 准确性 :告警需要有高准确率以避免误报和漏报,错误的告警可能会导致交通参与者对系统失去信任。

- 适应性 :告警系统应该能够适应不同的交通环境和条件,例如不同的时间段、天气状况等。

- 简洁性 :告警信息应尽可能简洁明了,便于接收者快速理解并采取相应行动。

4.1.2 告警流程的设计与优化

告警流程设计的核心在于将传感器收集到的数据转换为决策信息,并最终生成告警。下面是一个典型的告警流程设计及优化的步骤:

- 数据采集 :首先从摄像头、传感器等设备采集实时数据。

- 数据预处理 :对原始数据进行必要的处理,如去噪、格式转换等。

- 事件检测 :应用图像识别和行为分析算法,检测交通场景中的异常事件。

- 事件分类 :对检测到的事件进行分类,以区分不同的违规行为或安全威胁。

- 告警决策 :根据预设的告警标准和阈值,判断是否发出告警。

- 告警传达 :通过合适的媒介将告警信息传达给相关人员或系统。

- 反馈处理 :收集告警效果反馈,用于优化告警机制。

在优化告警流程时,特别需要考虑减少处理时间,提高系统稳定性和可靠性,以及通过用户反馈来持续改进告警规则。

4.2 多媒体告警方式的实现

多媒体告警是指运用视觉、听觉等多种感官通道,向用户传递告警信息。多媒体告警方式能够增强告警信息的可见性与可听性,提高接收者的响应速度和准确性。

4.2.1 视觉告警的设计原理

视觉告警的设计着重于通过图像或动态信号吸引用户的注意力,常见的视觉告警方式有LED警示灯、屏幕上的高亮显示等。视觉告警的设计应遵循以下原则:

- 颜色对比 :使用高对比度的颜色组合,确保在不同环境下都能清晰可见。

- 动态元素 :结合闪烁或动画效果来提高视觉冲击力,引起注意。

- 位置布置 :告警标志或灯光应放置在最易被观察到的位置,例如路边或交通标志上。

4.2.2 声音告警的设计原理

声音告警通过特定的声音模式通知用户注意,设计时应考虑以下几个方面:

- 音量控制 :确保告警声音足够大,可以覆盖到嘈杂的背景噪声,但也要避免对周围环境造成过度干扰。

- 音色与音调 :选择容易辨识的声音,如警报声或特定频率的声音,以区别于日常背景噪音。

- 节奏与模式 :设置独特的节奏或模式,帮助接收者区分不同的告警级别或信息。

在实际应用中,视觉告警和声音告警通常结合使用,以达到更好的告警效果。例如,在检测到闯红灯行为时,系统可以同时启动闪烁的告警灯和特定的告警音,从而向行人和驾驶员传递强烈的警告信号。

为了进一步说明告警机制与多媒体告警方式的应用,下面是一个简化的告警系统实现的伪代码示例:

import time

# 假定这是一个监控视频流并检测违规行为的函数

def detect_violations(video_stream):

# 实现视频流的获取与处理逻辑

# ...

# 假设检测到违规行为

return True

# 告警函数,启动视觉和声音告警

def activate_alerts():

# 启动视觉告警,例如:点亮LED灯

turn_on_visual_alerts()

# 启动声音告警,例如:播放告警声音

play_alert_sound()

print("警告:检测到违规行为!")

# 主控制循环

while True:

if detect_violations(video_stream):

activate_alerts()

time.sleep(1) # 为避免资源消耗,适当延迟

def turn_on_visual_alerts():

# 视觉告警的实现逻辑

pass

def play_alert_sound():

# 声音告警的实现逻辑

pass

在实际部署中,还需要考虑告警系统的冗余设计、远程监控与控制功能,以及与其他智能交通系统的集成等。通过不断的技术迭代和优化,我们可以期待智能交通系统中的告警机制将更加智能化、个性化和高效化。

如上所述,本章节通过分析告警机制的流程设计和优化,阐述了视觉与声音告警的设计原理,并通过代码示例和伪代码逻辑,展示了告警系统在智能交通中的具体实施方式。

# 5. 系统后端与持续学习优化

## 5.1 数据存储与处理机制

### 5.1.1 数据采集与存储策略

在智能交通系统中,后端的数据存储与处理机制是整个系统高效运作的基石。数据采集主要依赖于前端的摄像头、传感器等设备,它们源源不断地提供实时交通数据,如车辆流量、速度、行人行为等。数据的存储需要采用高效且稳定的方案以应对大量数据的快速录入和查询需求。常见的存储方案包括传统的关系型数据库(如MySQL)、分布式文件系统(如HDFS)以及NoSQL数据库(如MongoDB)。设计时应考虑数据的快速读写、数据的完整性以及持久化策略。

例如,针对视频流数据,可能需要结合时序数据库进行存储,并通过特定的数据格式(如H.264编码)确保视频质量与压缩比的平衡,从而降低存储空间的占用。

```sql

-- 示例SQL代码:创建一个用于存储实时交通数据的表

CREATE TABLE TrafficData (

DataID INT AUTO_INCREMENT PRIMARY KEY,

Timestamp DATETIME,

VehicleCount INT,

PedestrianCount INT,

SpeedAverage FLOAT,

Location VARCHAR(255)

);

5.1.2 数据处理与分析方法

收集来的数据必须经过适当的处理才能用于智能分析。数据处理包括数据清洗、数据标准化、数据转换等步骤。数据清洗是去除异常值、填补缺失数据的过程。数据标准化涉及到将数据转换成统一格式或尺度,以便分析。数据转换可能包括特征提取、维度降低等操作。

数据分析方法通常包括统计分析、机器学习等。统计分析用于处理数据集中的趋势、模式和关联性;而机器学习则用于创建预测模型,例如预测特定时间段的车流量。以下是一个简单的例子,使用Python的pandas库来处理交通数据。

import pandas as pd

# 假设有一个DataFrame df,包含了从数据库中读取的实时交通数据

df = pd.read_csv('traffic_data.csv')

# 数据清洗:处理缺失值

df.fillna(method='ffill', inplace=True)

# 数据标准化:归一化数据

df[['VehicleCount', 'PedestrianCount']] = df[['VehicleCount', 'PedestrianCount']].apply(lambda x: (x - x.min()) / (x.max() - x.min()))

# 特征提取:从时间戳中提取小时和星期信息

df['Hour'] = pd.to_datetime(df['Timestamp']).dt.hour

df['Weekday'] = pd.to_datetime(df['Timestamp']).dt.weekday

# 输出处理后的数据

print(df.head(10))

5.2 云计算和大数据在智能交通中的应用

5.2.1 云计算技术的优势与应用

云计算技术在智能交通中的应用可以为城市交通管理提供弹性、可扩展的计算资源,能够支撑大规模的实时数据处理和分析。云计算平台如AWS、Azure、阿里云等提供了强大的计算能力、数据存储和网络资源。这些资源可以按需分配,从而实现成本的最优化。

在智能交通系统中,云平台可以部署大数据处理框架如Apache Hadoop和Spark,支持复杂的交通数据分析任务。此外,云计算还可以提供多租户模式,允许不同部门或城市共同访问共享资源和服务,实现数据和资源的高效利用。

5.2.2 大数据处理与决策支持

大数据处理涉及从大规模、多样化的数据集中快速提取有价值信息的能力。在智能交通系统中,大数据处理平台能够高效地分析实时交通流数据、历史交通模式、天气状况、事故信息等多种数据源,帮助交通管理者做出基于数据驱动的决策。

例如,通过对历史交通数据进行时间序列分析,可以预测未来的交通流量,进而制定交通管制措施,优化信号灯控制策略。另外,大数据分析还可以辅助识别交通拥堵的根本原因,并为建设新的基础设施提供依据。

5.3 持续学习与优化能力的构建

5.3.1 系统学习机制的实现

智能交通系统的持续学习机制依赖于机器学习算法和深度学习模型,它们能够在海量数据的基础上不断迭代优化。系统通过不断地学习交通模式的变化,可以适应新的交通条件,预测潜在的问题,并提供决策支持。

实现系统学习机制的关键是建立一个反馈循环。在实际应用中,算法模型会基于新收集的数据进行训练,模型的表现会定期评估,并根据评估结果调整算法参数。此外,系统还可以通过人工标注或自动识别异常事件来不断改进学习模型。

5.3.2 迁移学习策略在智能交通中的应用

迁移学习是一种机器学习方法,它允许将从一个任务学习到的知识应用到另一个相关但不同的任务中。在智能交通领域,迁移学习尤其有用,因为它可以减少对大量标注数据的依赖,加快模型训练的速度,提高模型在新环境下的适应能力。

例如,一个在大城市道路上训练的车辆识别模型可以迁移到乡村道路上,而无需从零开始训练。迁移学习通过将已有的知识(即模型参数)应用到新的但相关的任务上,从而提高了学习效率和模型的泛化能力。

通过持续学习和优化,智能交通系统能够不断地提高对交通事件的识别准确度、预测未来交通状况的能力,以及在实际环境中对突发状况的应对能力。这不仅提升了交通系统的智能化水平,也为城市交通的可持续发展提供了强有力的技术支持。

简介:行人闯红灯自动告警抓拍系统运用图像处理和人工智能算法提高交通安全,减少事故。系统通过高清摄像头实时分析视频流,利用深度学习模型如YOLO或SSD进行目标检测,并结合光流法追踪行人及交通信号灯状态来判断闯红灯行为。告警机制通过多种方式提醒行人,并记录违规证据。系统还具备自我学习和优化能力,通过历史数据提高识别准确性。这套系统在提升交通管理水平和增强公众安全意识方面发挥着重要作用。

597

597

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?