相同点:都是对Pytorch中tensor的复制。

区别:

-

repeat_interleave():在原有的tensor上,按每一个tensor复制。

-

repeat():根据原有的tensor复制n个,然后拼接在一起。

具体实例:

(主要通过对第一维度来说明函数)

import torch

a = torch.rand([3, 2])

# 对第一维度

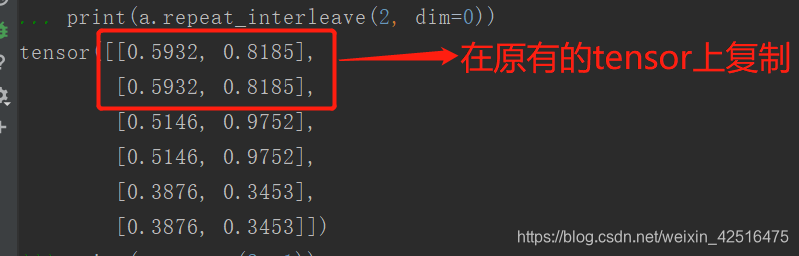

print(a.repeat_interleave(2, dim=0)) # 复制后大小:【6,2】

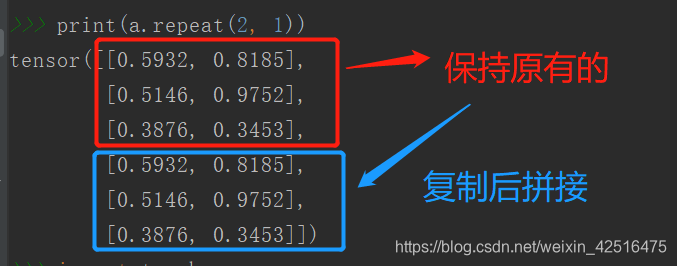

print(a.repeat(2, 1)) # 复制后大小:【6,2】

# 对第二维度

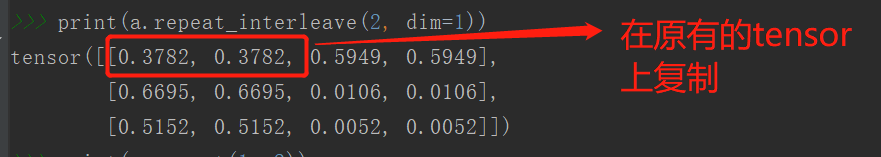

print(a.repeat_interleave(2, dim=1)) # 复制后大小:【3,4】

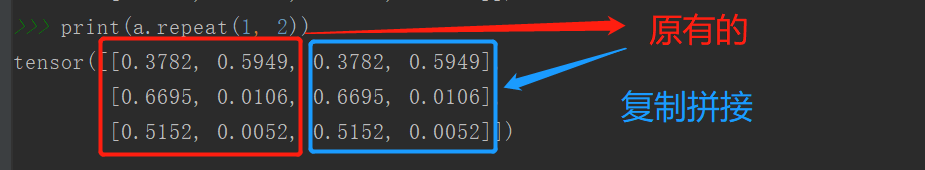

print(a.repeat(1, 2)) # 复制后大小:【3,4】

- repeat_interleave(复制的次数, dim=复制的维度)

a.repeat_interleave(2, dim=0)

解释:在【3,2】上,按每一个维度tensor复制

- repeat(第一维度复制的次数, 第二维度复制的次数)

注意:repeat参数是根据tensor的维度确定,如果a=[3,2,1],那就是repeat(dim0, dim1, dim2)

a.repeat(2, 1)

解释:保持原有的【3,2】复制2个,然后拼接在一起

对第二维度结果:

9万+

9万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?