论文阅读:Learning to Reduce Dual-level Discrepancy for Infrared-Visible Person Re-identification (CVPR2019)

(CVPR2019))

1、针对问题

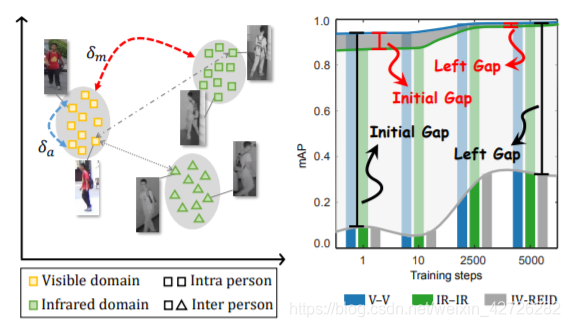

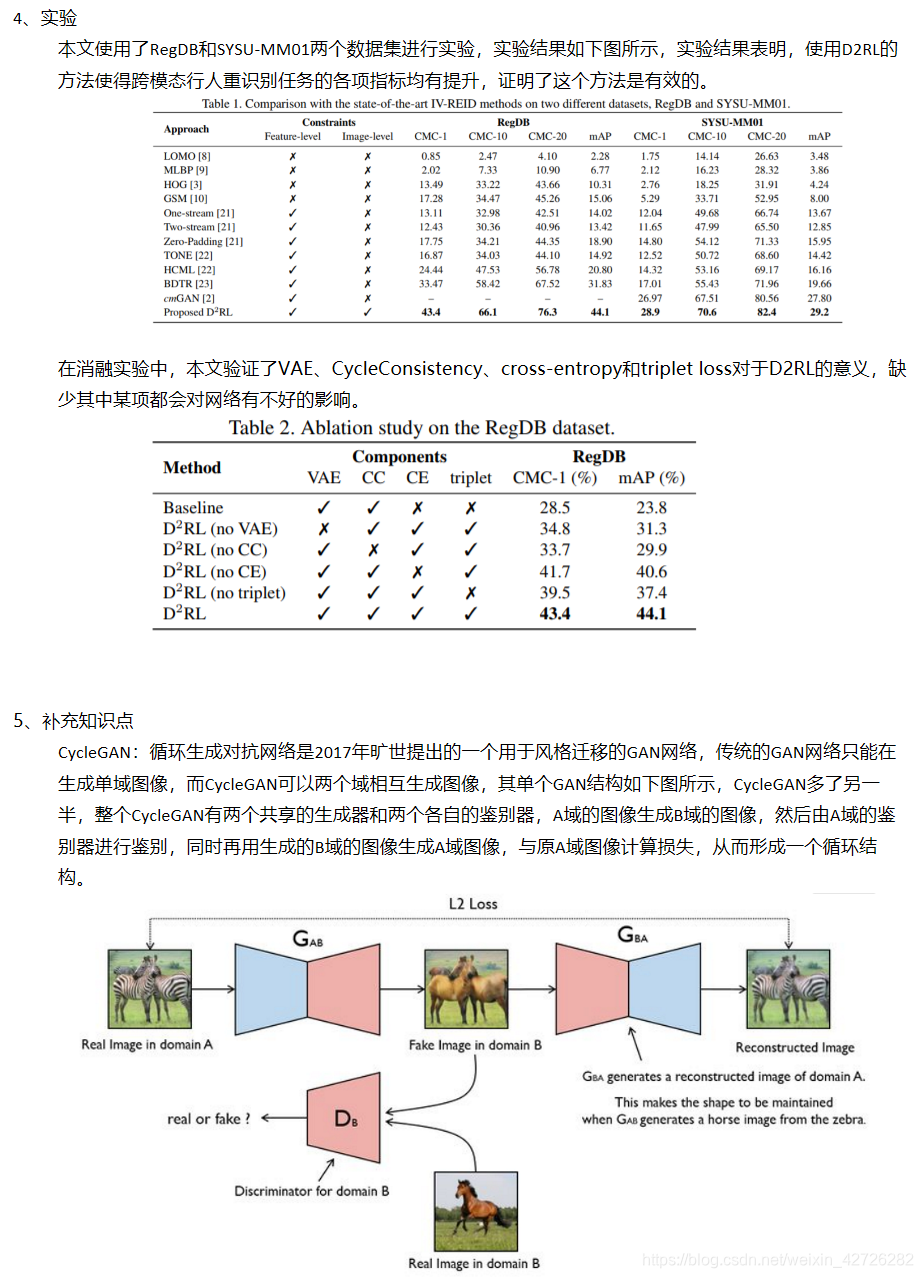

跨模态行人重识别面临可见光和红外光两种模态的巨大挑战,同时单模态中视角、光线和遮挡等问题仍然存在。文中指出,不同模态下的同一行人的距离要大于红外图像中同一行人的距离,因此,跨模态行人重识别的目标是减小跨模态同一行人的距离,增大同一模态下不同行人的距离。而以前的跨模态行人重识别主要通过约束可见光和红外图像特征来实现的,这是不够的。基于此,本文提出了一种新的Dual-level Discrepancy Reduction Learning (D2RL)方法解决跨模态问题。

2、本文思想

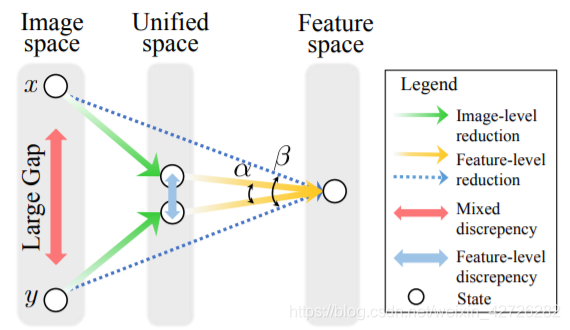

本文提出了D2RL的方法,即两级差异减小学习方法,该方法设计两个子网络,分别为 T_I 和 T_F 。T_I 子网络对可见光图像和红外图像都进行了加强,生成新的光谱图,从而减小了可见光图像和红外图像之间不同模态的差异,然后T_F 采用传统的跨模态行人重识别方法,减小约束下的特征差异。这两个子网络以端对端的方式级联并且联合优化,这种用两级子网络分别减小跨模态的图像差异和相同图像表示下的特征差异的方法,能够很好地解决跨模态差异的问题。D2RL的结构如下图所示。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?