学习任务

1、逻辑回归与线性回归的联系与区别

2、 逻辑回归的原理

3、逻辑回归损失函数推导及优化

4、 正则化与模型评估指标

5、逻辑回归的优缺点

6、样本不均衡问题解决办法

7、sklearn参数

1、逻辑回归与线性回归的联系与区别

逻辑回归是基于线性回归方法的扩展,是一种广义线性模型,link function为单调可微的对数几率函数。即用线性回归模型的预测结果去逼近真实标记y的对数几率(logit)。

逻辑回归:Logistic回归,用于分类问题,label为离散型数据。无须事先假设数据分布。

线性回归:用于回归问题,label为连续型数据。假设特征变量与响应变量满足线性关系。

2、 逻辑回归的原理

以二分类任务为例,以下过程可推广至多分类任务。

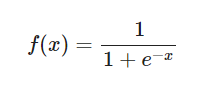

通过对数几率函数(sigmoid函数),将模型输出的真实标记y与线性模型的预测值联系起来:

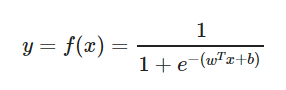

这样,模型就变成了:

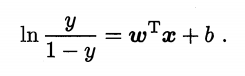

两边取对数:

将y实为正例(y=1)的概率,1-y实为反例(y=0)的概率,两者的比值称为“几率”(odds):

对几率取对数,得到“对数几率”(log odds或logit):

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

522

522

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?