前言

上一章我们结合手写数字识别的小程序学习了逻辑回归算法解决多分类问题的一般思路。这一章我们学习的是一个更加强大的分类算法:神经网络。

算法介绍

这一章,我们继续使用上一章的手写数字识别的例子,只不过,我们改成神经网络的算法。对人工智能感兴趣的同学想必都对神经网络算法不陌生,多层神经玩网络算法又叫做深度学习算法,更是大名鼎鼎了。

为什么要引入神经网络算法呢,个人理解,对于n个特征和K个待识别目标的问题,假设所有的边界都是特征的线性函数,即 θ T x = θ 0 + θ 1 x 1 + θ 2 x 2 + ⋯ + θ n x n \mathbf{\theta}^T\mathbf{x}=\theta_0+\theta_1x_1+\theta_2x_2+\cdots+\theta_nx_n θTx=θ0+θ1x1+θ2x2+⋯+θnxn,我们需要 n ∗ K n*K n∗K的参数。对于更复杂一些的问题,边界不是特征的线性函数的情况,假设边界是特征的D次函数,即 θ T x = θ 0 + θ 1 x 1 + θ 2 x 2 + ⋯ + θ n x n + θ n + 1 x 1 2 + θ n + 2 x 2 2 + ⋯ + θ M x n D \mathbf{\theta}^T\mathbf{x}=\theta_0+\theta_1x_1+\theta_2x_2+\cdots+\theta_nx_n+\theta_{n+1}x_1^2+\theta_{n+2}x_2^2+\cdots+\theta_Mx_n^D θTx=θ0+θ1x1+θ2x2+⋯+θnxn+θn+1x12+θn+2x22+⋯+θMxnD,那么一共需要 O ( n D ) O(n^D) O(nD)个参数,对于特征较多的问题,例如手写数字识别,参数的数量会随着问题的复杂程度而急剧增加,而神经网络算法可以避免出现这种情况。

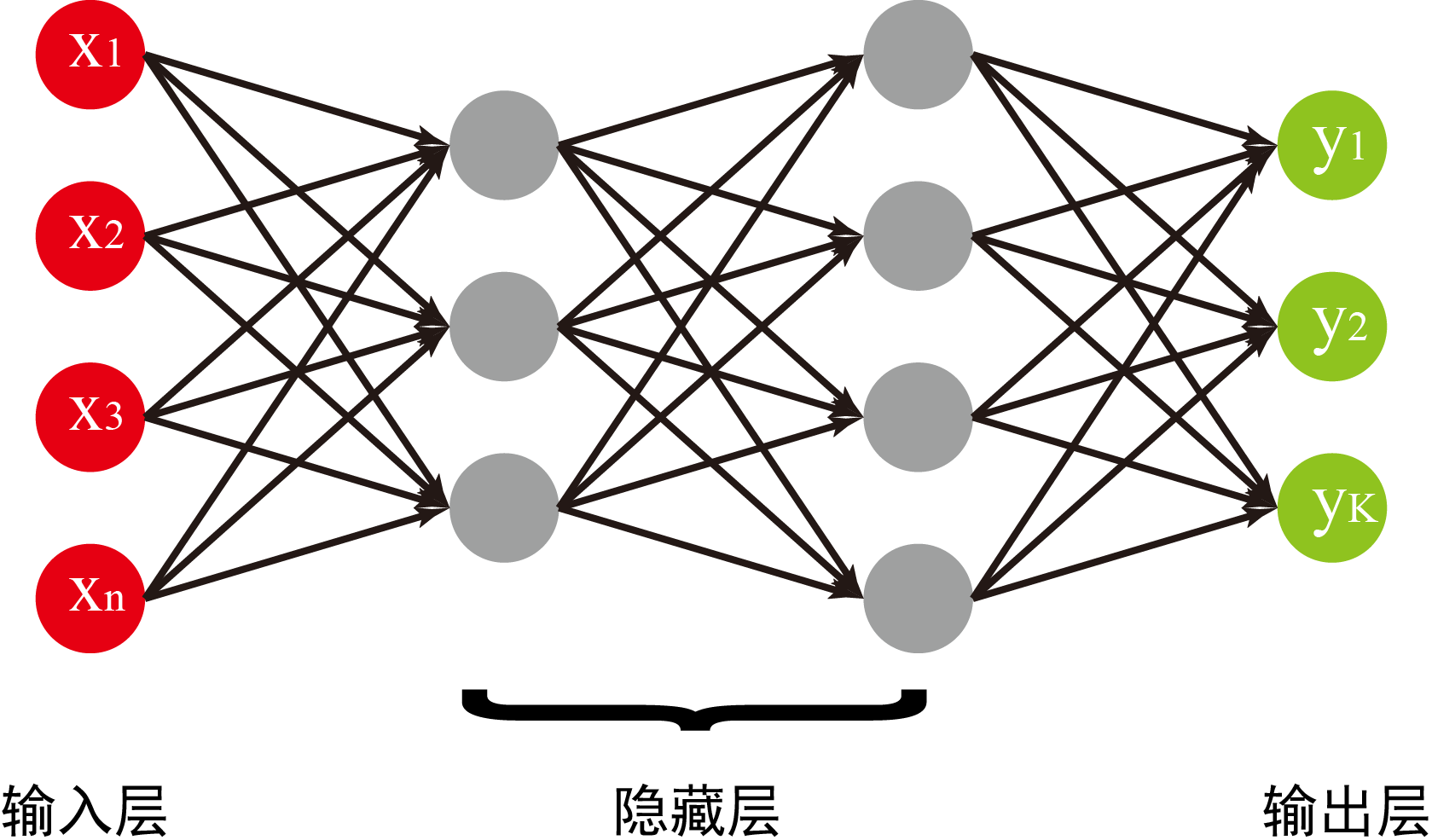

神经网络算法采用函数嵌套的方式,既解决了非线性边界的问题,又不会引入过多的未知参数。具体来讲,一个典型的神经网络结构如下图所示,由输入层,隐藏层和输出层组成,其中输入层就是我们所选择的所有特征,输出层就是我们要识别的标签种类,而中间层呢由于大部分情况下我们也不知道代表的啥,也就是说中间这些层的信息对我们是隐藏的,所以叫就它们隐藏层了。

神经网络的工作方式就是从最左边的输入层,按照箭头的指向,向右逐层计算,最终得到输出结果。网络中的每一个箭头都代表着不同的比重参数,神经网络算法的最终目的就是找到最优的比重参数。

符号定义

为了便于表述,我们先定义一些符合来代表神经网络的一些属性。我们用大写的 L L L代表神经网络的总层数,对于上图,我们有 L = 4 L=4 L=4;相应地我们用小写的 l l l代表具体的某一层, l = 1 , 2 , ⋯   , L l=1,2,\cdots,L l=1,2,⋯,L;按照以前的惯例,我们仍然用 n n n表示特征数,用大写的 K K K代表输出层的单元数,另外,我们用 S

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?