1、什么是stacking?

简单来说,stacking就是当用初始训练数据学习出若干个基学习器后,将这几个学习器的预测结果作为新的训练集,来学习一个新的学习器。

将个体学习器结合在一起的时候,使用的方法叫做结合策略。

- 对于分类问题,我们可以用投票方法来选择输出最多的类。

- 对于回归问题,我们可以将分类器输出的结果求平均值。

- stacking也是一种结合策略,它将个体机器学习器的结果结合在一起。

在stacking方法中,个体学习器叫做初级学习器,用于结合的学习器叫做次级或元学习器(meta-learner),次级学习器用于训练的数据叫做次级训练集。次级训练集是在原始数据训练集熵用初级学习器得到的。

2、如何进行stacking?

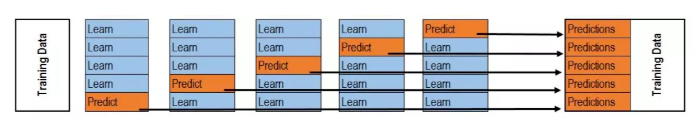

算法示意图如下:

- 过程1-3 是训练出来个体学习器,也就是初级学习器。

- 过程5-9是 使用训练出来的个体学习器来得预测的结果,这个预测的结果当做次级学习器的训练集。

- 过程11 是用初级学习器预测的结果训练出次级学习器,得到我们最后训练的模型。

3、Stacking的方法讲解

首先,我们先从一种“不那么正确”但是容易懂的Stacking方法讲起。

Stacking模型本质上是一种分层的结构,这里简单起见,只分析二级Stacking.假设我们有2个基模型 Model1_1、Model1_2 和 一个次级模型Model2

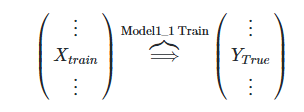

S t e p 1 Step 1 Step1. 基模型 Model1_1,对训练集train训练,然后用于预测 train 和 test 的标签列,分别是P1,T1

Model1_1 模型训练:

训练后的模型 Model1_1 分别在 train 和 test 上预测,得到预测标签分别是P1,T1

S

t

e

p

2

Step 2

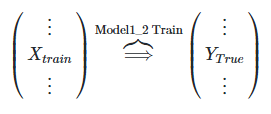

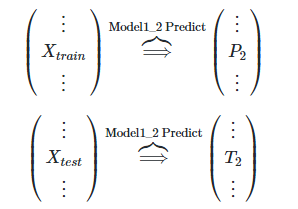

Step2. 基模型 Model1_2 ,对训练集train训练,然后用于预测train和test的标签列,分别是P2,T2

Model1_2 模型训练

训练后的模型 Model1_2 分别在 train 和 test 上预测,得到预测标签分别是P2,T2

S

t

e

p

3

Step 3

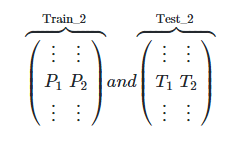

Step3. 分别把P1,P2以及T1,T2合并,得到一个新的训练集和测试集train2,test2.

再用次级模型Model_2以真实训练集标签训练,以train_2,为特征进行训练,预测test_2,得到的最终的测试集预测的标签列为

Y

P

r

e

Y_{Pre}

YPre

这是两层堆叠的一种基本的原始思路想法。在不同模型预测的结果基础上再加一层模型,进行再训练,从而得到模型最终的预测。

Stacking本质上就是这么直接的思路,但是当训练集和测试集分布不一致的情况下是存在问题的,其问题在于用初始模型训练的标签再利用真实标签进行再训练,毫无疑问会导致一定的模型过拟合训练,

举例:

from sklearn import linear_model

def Stacking_method(train_reg1,train_reg2,train_reg3,y_train_true

,test_pre1,test_pre2,test_pre3

,model_L2= linear_model.LinearRegression()):

model_L2.fit(pd.concat([pd.Series(train_reg1)

,pd.Series(train_reg2)

,pd.Series(train_reg3)],axis=1).values,y_train_true)

Stacking_result = model_L2.predict(pd.concat([pd.Series(test_pre1),pd.Series(test_pre2),pd.Series(test_pre3)],axis=1).values)

return Stacking_result

## 生成一些简单的样本数据,test_prei 代表第i个模型的预测值

train_reg1 = [3.2, 8.2, 9.1, 5.2]

train_reg2 = [2.9, 8.1, 9.0, 4.9]

train_reg3 = [3.1, 7.9, 9.2, 5.0]

# y_test_true 代表第模型的真实值

y_train_true = [3, 8, 9, 5]

test_pre1 = [1.2, 3.2, 2.1, 6.2]

test_pre2 = [0.9, 3.1, 2.0, 5.9]

test_pre3 = [1.1, 2.9, 2.2, 6.0]

# y_test_true 代表第模型的真实值

y_test_true = [1, 3, 2, 6]

model_L2= linear_model.LinearRegression()

Stacking_pre = Stacking_method(train_reg1,train_reg2,train_reg3,y_train_true,

test_pre1,test_pre2,test_pre3,model_L2)

print('Stacking_pre MAE:',metrics.mean_absolute_error(y_test_true, Stacking_pre))

这样或许模型在测试集上的泛化能力会有一定的下降,因此现在的问题变成了如何降低再训练的过拟合性,这里我们一般有两种方法。

1、次级模型尽量选择简单的线性模型。

2、利用K折交叉验证。

K-折交叉验证: 训练:

预测:

967

967

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?