前言

上篇文章对PySpark的RDD做了简单的介绍,以及总结了RDD的特性,该篇文章主要介绍RDD的创建方式,PySpark的RDD创建方式主要有两种,一种是在程序中直接创建,另一种是通过加载外部系统创建。

一、RDD创建

- 创建SparkContext对象

SparkContext为Spark程序的入口,代表和Spark集群的链接,Spark集群中通过SparkContext创建RDD,创建SparkContext对象前需要先创建SparkConf,该SparkConf对象用来传递应用的基本信息。

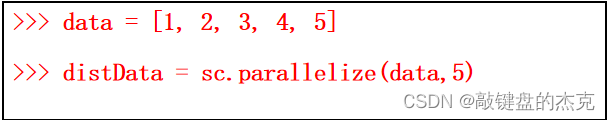

- 并行化方式创建RDD

第一步已经得到SparkContext对象,通过该对象的parallelize方法即可创建RDD,该方法需要传入可迭代的对象或集合;

使用SparkContext对象时可以指定分区数量

- 读取小文件创建RDD

实际需求中,有时需要读取大量的小文件,文件不大,但数量很多,如果一个文件读取为RDD的一个分区,处理数据效率较为低下,此时可以使用S

订阅专栏 解锁全文

订阅专栏 解锁全文

1584

1584

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?