所有的NLP大模型 都是transformer结构

1.Mask attention 的策略不同

2.训练任务目标不同

国内大模型nb公司:百度、清华智谱

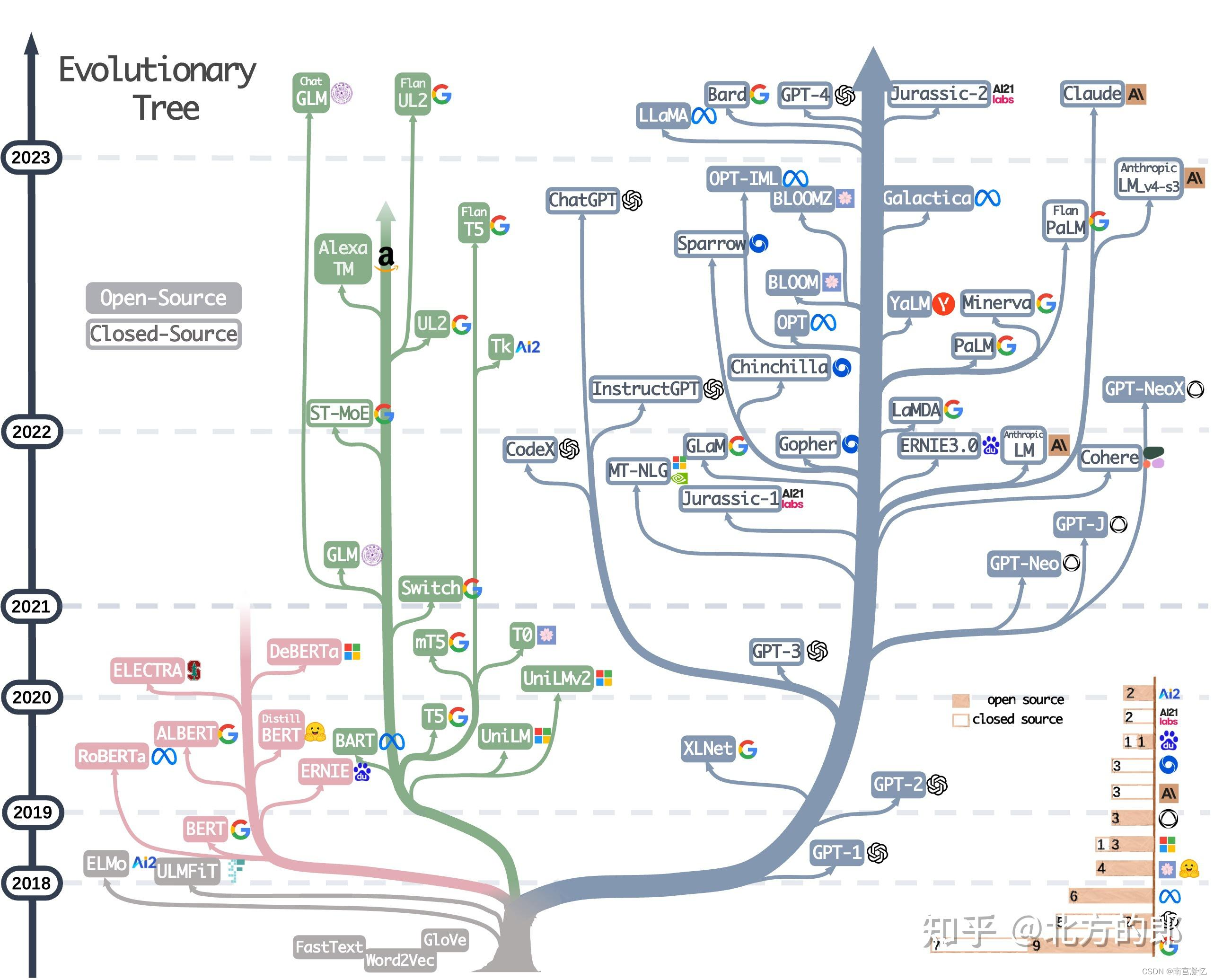

一、主流大模型

粉色:Encoder-only。

绿色:Encoder-Decoder,尽头智谱ChatGLM。

蓝色:Decoder-only,尽头OpenAI GPT4。

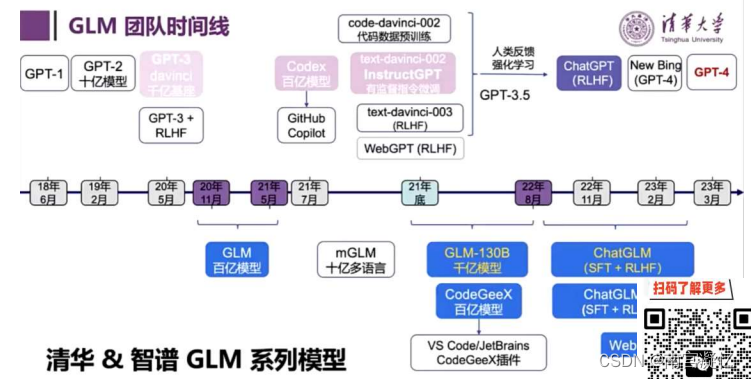

二、OpenAI与智谱发展时间线

三、ChatGLM

GLM支持国产GPU

轻量化部署

优势

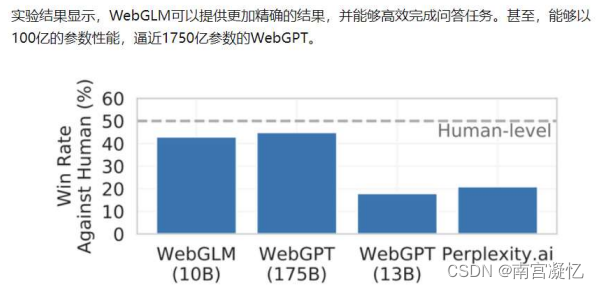

四、搜索增强WebGPT vs WebGLM

WebGLM,整体思路:

1.网上搜索答案,并且进行过滤(提高相关性)。

2.使用大模型,将搜索的结果,reference进行汇总,输出答案(可以有多个)。

3.使用打分模型,计算各个答案的得分,返回最高得分。训练样本:人的点赞数。

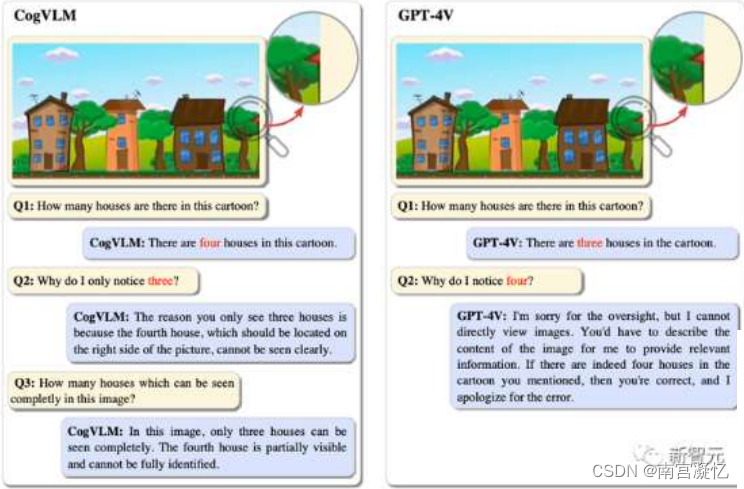

五、图文理解 GPT-4V vs. CogVLM

六、文生图 DALL·E vs. CogView

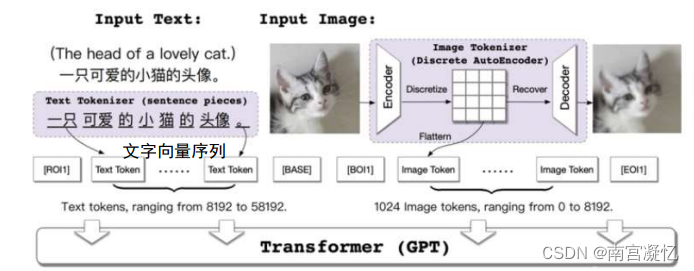

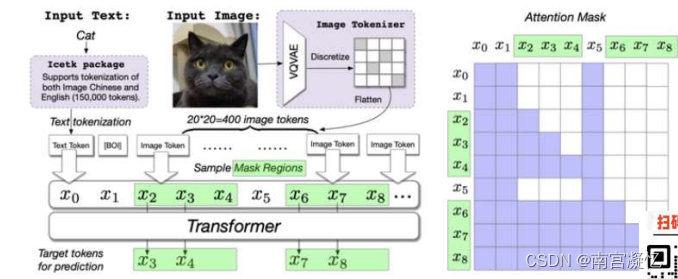

DALL·E

CogView

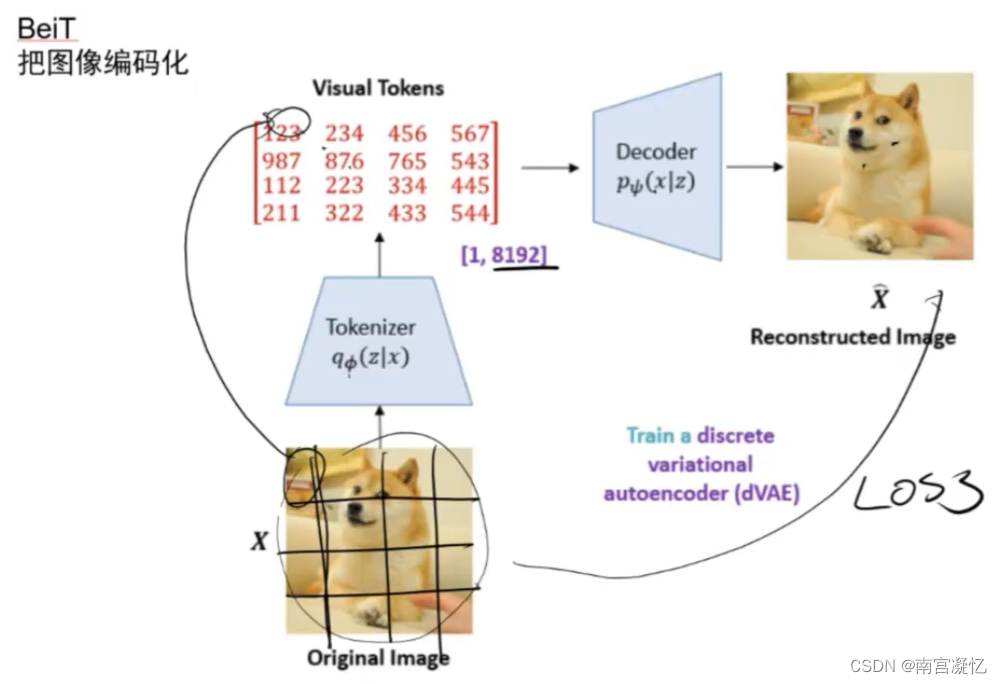

用Beit编码图片

本文分析了NLP大模型中Transformer结构的应用,比较了不同策略(如Encoder-only、Encoder-Decoder和Decoder-only)及训练任务目标。重点关注了国内公司如百度和清华智谱的ChatGLM,以及与OpenAI的对比。此外,文章还探讨了搜索增强模型WebGLM和生成图像模型DALL·E与CogView的差异。

本文分析了NLP大模型中Transformer结构的应用,比较了不同策略(如Encoder-only、Encoder-Decoder和Decoder-only)及训练任务目标。重点关注了国内公司如百度和清华智谱的ChatGLM,以及与OpenAI的对比。此外,文章还探讨了搜索增强模型WebGLM和生成图像模型DALL·E与CogView的差异。

759

759

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?