>- **🍨 本文为🔗365天深度学习训练营 中的学习记录博客**

>- **🍖 原作者:K同学啊**

本人往期文章可查阅: 深度学习总结

📌第P2周:彩色图片识别📌

- 难度:小白入门⭐

- 语言:Python3、Pytorch

🍺 要求:

- 学习如何编写一个完整的深度学习程序

- 手动推导卷积层与池化层的计算过程

🔔本次的重点在于学会构建CNN网络

🏡 我的环境:

- 语言环境:Python3.11.7

- 编译器:pyCharm 2024.1.3

- 深度学习环境:Pytorch

一、 前期准备

1. 设置GPU

如果设备上支持GPU就使用GPU,否则使用CPU

import torch

import torch.nn as nn

import matplotlib.pyplot as plt

import torchvision

# 设置硬件设备,如果有GPU则使用,没有则使用cpu

device=torch.device("cuda" if torch.cuda.is_available() else "cpu")

print(device)运行结果:

因办公室环境不允许,所以一直无法安装上GPU版本,故我的依旧显示结果为:cpu

2. 导入数据

2.1下载数据

CIFAR-10数据集的内容

CIFAR10数据集共有60000个样本,每个样本都是一张32*32像素的RGB图像(彩色图像),每个RGB图像又必定分为3个通道(R通道、G通道、B通道)。这60000个样本被分成了50000个训练样本和10000个测试样本。

CIFAR10数据集是用来监督学习训练的,那么每个样本就一定都配备了一个标签值(用来区分这个样本是什么),不同类别的物体用不同的标签值,CIFAR10中有10类物体,标签值分别按照0~9来区分,他们分别是飞机( airplane )、汽车( automobile )、鸟( bird )、猫( cat )、鹿( deer )、狗( dog )、青蛙( frog )、马( horse )、船( ship )和卡车( truck )。

使用dataset下载CIFAR10数据集,并划分好训练集与测试集

#导入数据

train_ds=torchvision.datasets.CIFAR10(root='D:\THE MNIST DATABASE',train=True,

transform=torchvision.transforms.ToTensor(),#将数据类型转化为Tensor

download=False)

test_ds=torchvision.datasets.CIFAR10(root='D:\THE MNIST DATABASE',train=False,

transform=torchvision.transforms.ToTensor(),#将数据类型转化为Tensor

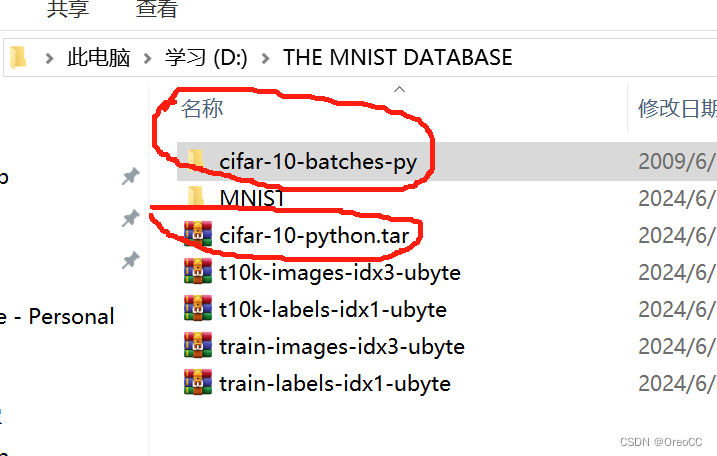

download=False)因办公室网络缘故,依然无法下载,显示超时错误,故利用别人百度云盘分享的CIFAR10的压缩包cifar-10-python.tar下载下来,放置于我的固定文件夹中,运行此段代码后发现压缩包已经被解压并自动生成文件夹cifar-10-batches-py,如图所示:

文件夹打开后内容如下所示,证明我们的数据已经准备完

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3272

3272

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?