先给出结论:

简易版:

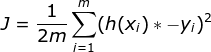

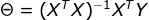

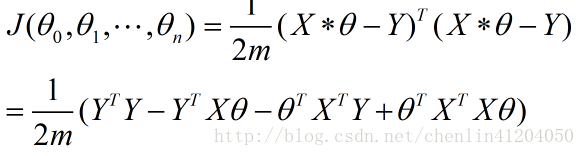

首先列出代价函数 ,其中X,Y,θ是向量或者矩阵。

,其中X,Y,θ是向量或者矩阵。

接下来我们要对代价函数Ĵ中预测值与真实值的差的平方的累加进行求导。

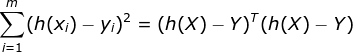

首先第一步, 消除累加。

消除累加。

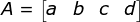

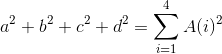

简单来复习一下现代知识:假设向量 ,则

,则

*

*  =

=

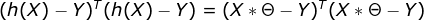

知道如何消去累加之后再将式子做进一步化简:

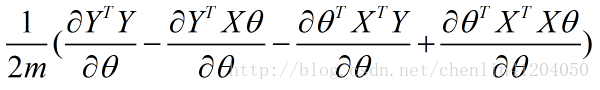

好了现在终于把原式子化简完成,接下来就要进行求导了。大家应该都知道多项式求导等于对各项求导相加。

我们将上式对θ求导:

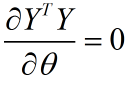

第一项: 是一个标量,所以是标量对向量求导 得

是一个标量,所以是标量对向量求导 得

第二项:同样是标量对向量求导 得

第三项:

第四项:0

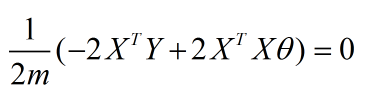

综上,对上式求导的结果是:

为了取到代价函数对最小值,所以让导函数等于零。

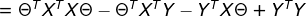

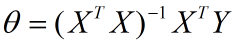

就得到了

详细版:

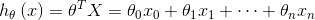

多变量线性回归代价函数为:

其中:

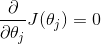

正规方程是通过求解下面的方程来找出使得代价函数最小的参数:

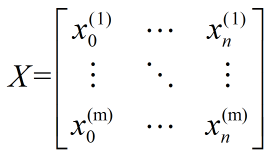

设有m个训练实例,每个实例有n个特征,则训练实例集为:

其中 描述表示第i个实例第j个特征。

描述表示第i个实例第j个特征。

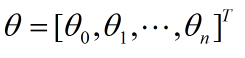

特征参数为:

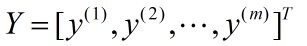

输出变量为:

故代价函数为:

进行求导,等价于如下的形式:

- 其中第一项:

- 第二项:

该矩阵求导为分母布局下的标量/向量形式,故有:

- 第三项:

该矩阵求导为分母布局下的标量/向量形式,故有:

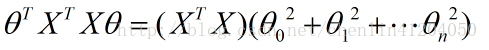

- 第四项:

该矩阵求导为分母布局下的标量/向量形式,故有:

综上,正规方程为:

最终可得特征参数的表示:

1637

1637

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?