1、虚拟节点+广度优先搜索

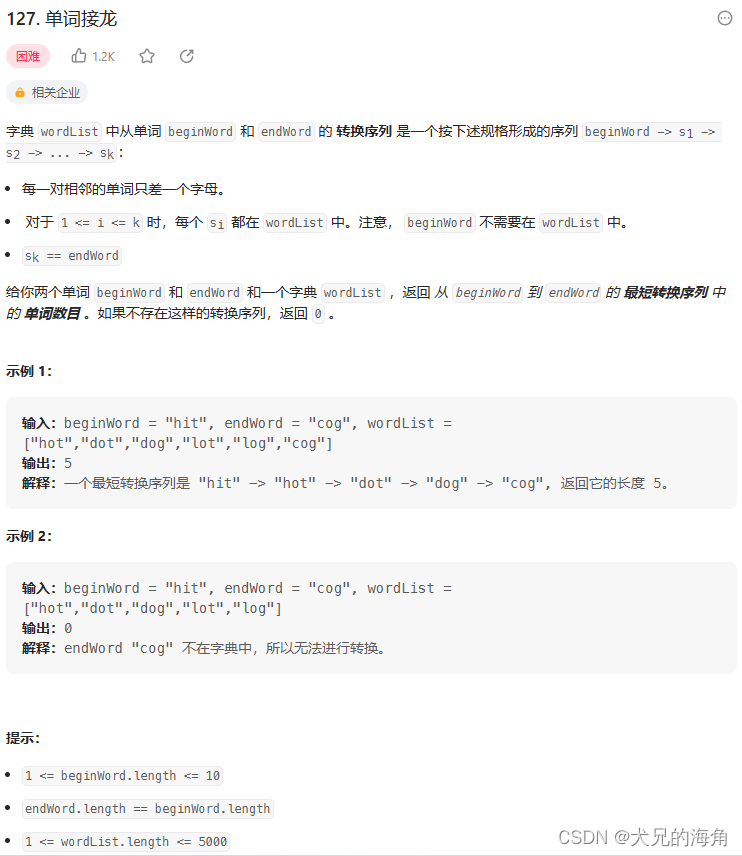

为了获得最短转化序列中的单词数目,我们可以假设每个单词是一个节点,可以互相转化的节点之间存在边,这样我们就能将最短转化序列问题转化为图的广度优先搜索问题。考虑到图中可能存在环,因此我们需要额外设置一个数组用于记录

b

e

g

i

n

W

o

r

d

beginWord

beginWord到每一个单词的最小转化数。

为了能够表示节点之间相互转化的关系,我们最简单的方法就是二重循环遍历整个

w

o

r

d

L

i

s

t

wordList

wordList,或者可以使用哈希表来减少查询的速度,但这样做会导致超时。因此我们可以通过引入虚拟节点来避免多余的循环。例如当

b

e

g

i

n

W

o

r

d

beginWord

beginWord是

h

i

t

hit

hit时,我们可以将该节点与虚拟节点

∗

i

t

,

h

∗

t

,

h

i

∗

\ast it,h\ast t,hi*

∗it,h∗t,hi∗相连,这样子当另外的单词与这些虚拟节点相连时,我们就可以判断该单词与

h

i

t

hit

hit是可以互相转化的,因此他们也是相连的。最终我们利用哈希表来记录单词与序号之间的关系,利用二维数组来构建图。

class Solution {

public:

unordered_map<string, int> wordId;

vector<vector<int>> edge;

int nodeNum = 0;

void addWord(string &word) {

if (!wordId.count(word)) {

wordId[word] = nodeNum++;

edge.emplace_back();

}

}

void addEdge(string &word) {

addWord(word);

int id1 = wordId[word];

for (char &it: word) {

char tmp = it;

it = '*';

addWord(word);

int id2 = wordId[word];

edge[id1].push_back(id2);

edge[id2].push_back(id1);

it = tmp;

}

}

int ladderLength(string beginWord, string endWord, vector<string> &wordList) {

for (string &word: wordList) {

addEdge(word);

}

addEdge(beginWord);

if (!wordId.count(endWord)) {

return 0;

}

vector<int> dis(nodeNum, INT_MAX);

int beginId = wordId[beginWord], endId = wordId[endWord];

dis[beginId] = 0;

queue<int> que;

que.push(beginId);

while (!que.empty()) {

int x = que.front();

que.pop();

if (x == endId) {

return dis[endId] / 2 + 1;

}

for (int &it: edge[x]) {

if (dis[it] == INT_MAX) {

dis[it] = dis[x] + 1;

que.push(it);

}

}

}

return 0;

}

};

2、双向广度优先搜索

为了减少搜索的次数,我们可以同时从 b e g i n W o r d beginWord beginWord和 e n d W o r d endWord endWord进行广度优先搜索,当两个方向的搜索都访问过同一节点时停止搜索。

class Solution {

public:

unordered_map<string, int> wordId;

vector<vector<int>> edge;

int nodeNum = 0;

void addWord(string& word) {

if (!wordId.count(word)) {

wordId[word] = nodeNum++;

edge.emplace_back();

}

}

void addEdge(string& word) {

addWord(word);

int id1 = wordId[word];

for (char& it : word) {

char tmp = it;

it = '*';

addWord(word);

int id2 = wordId[word];

edge[id1].push_back(id2);

edge[id2].push_back(id1);

it = tmp;

}

}

int ladderLength(string beginWord, string endWord, vector<string>& wordList) {

for (string& word : wordList) {

addEdge(word);

}

addEdge(beginWord);

if (!wordId.count(endWord)) {

return 0;

}

vector<int> disBegin(nodeNum, INT_MAX);

int beginId = wordId[beginWord];

disBegin[beginId] = 0;

queue<int> queBegin;

queBegin.push(beginId);

vector<int> disEnd(nodeNum, INT_MAX);

int endId = wordId[endWord];

disEnd[endId] = 0;

queue<int> queEnd;

queEnd.push(endId);

while (!queBegin.empty() && !queEnd.empty()) {

int queBeginSize = queBegin.size();

for (int i = 0; i < queBeginSize; ++i) {

int nodeBegin = queBegin.front();

queBegin.pop();

if (disEnd[nodeBegin] != INT_MAX) {

return (disBegin[nodeBegin] + disEnd[nodeBegin]) / 2 + 1;

}

for (int& it : edge[nodeBegin]) {

if (disBegin[it] == INT_MAX) {

disBegin[it] = disBegin[nodeBegin] + 1;

queBegin.push(it);

}

}

}

int queEndSize = queEnd.size();

for (int i = 0; i < queEndSize; ++i) {

int nodeEnd = queEnd.front();

queEnd.pop();

if (disBegin[nodeEnd] != INT_MAX) {

return (disBegin[nodeEnd] + disEnd[nodeEnd]) / 2 + 1;

}

for (int& it : edge[nodeEnd]) {

if (disEnd[it] == INT_MAX) {

disEnd[it] = disEnd[nodeEnd] + 1;

queEnd.push(it);

}

}

}

}

return 0;

}

};

515

515

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?