系列文章:

【RAG综述系列】之 RAG 先进方法与综合评估

【RAG综述系列】之 RAG 应用和未来方向

正文:

1 高级 RAG 方法

高级 RAG 方法是指超越基础 RAG 模型的技术,它们涵盖了一系列前沿方法,旨在克服基础 RAG 系统的局限性。这些方法在多个方面提升 RAG 系统的能力,包括训练优化、多模态处理、记忆增强和智能推理。本章节重点介绍四项关键进展:

- RAG 训练(RAG Training),关注检索与生成的协同优化;

- 多模态 RAG(Multimodal RAG),集成多种感知模态,以丰富输出内容;

- 记忆 RAG(Memory RAG),引入长期记忆以增强上下文推理和个性化能力;

- 智能 RAG(Agentic RAG),采用迭代和动态优化机制,以满足不断变化的信息需求。

这些方法共同推动 RAG 系统的能力边界,使其能够应对复杂、多变且高度专业化的任务。

1.1 RAG 训练

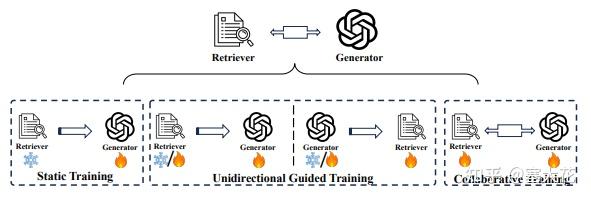

训练 RAG 模型的关键在于优化检索与生成组件之间的平衡,以实现最佳性能。有效的训练策略能够确保检索器获取相关信息,同时让生成器生成连贯且准确的内容。本节回顾了 RAG 训练的多种方法,包括静态训练、单向引导训练和协同训练,如 图 1 所示。每种方法都有其独特的优势和挑战,影响 RAG 模型在不同应用中的效果和适应性。通过探索这些训练范式,我们可以增强检索和生成过程的融合,从而提升 RAG 的整体性能。

图1:RAG训练方法,包括静态训练、单向引导训练和协同训练

1.1.1 静态训练(Static Training)

静态优化训练是一种直接而有效的方法,即在训练过程中固定检索器或生成器,使优化仅针对另一个组件。这种方法特别适用于计算资源有限或需要快速部署的场景。例如:

- 固定检索器,仅优化生成器,使其能够利用已有的检索机制(如 BM25 或预训练模型 BERT),无需同时训练检索器,从而加快训练速度并减少资源消耗。

然而,静态优化的主要缺点是可能会牺牲整体系统性能。由于仅优化一个组件,检索和生成之间的协同作用可能无法充分发挥,限制了模型在特定任务或领域中的适应能力。为了缓解这一问题,需要慎重选择固定的组件,并优化训练过程,使可调整的组件能够最大程度地利用固定组件提供的信息。

1.1.2 单向引导训练(Unidirectional Guided Training)

单向引导训练是一种定向优化策略,其中一个组件引导另一个组件的训练。这种方法可分为两种模式:

- 检索器引导生成器训练(Retriever-Guided Generator Training)

- 生成器引导检索器训练(Generator-Guided Retriever Training)

1)检索器引导生成器训练

在这种方法中,检索器在训练过程中起主导作用,通过提供高质量的检索文档来优化生成器。例如:

- RETRO :使用预训练 BERT 作为检索器,提供上下文以提升生成器的输出质量;

- RALMs:利用 COLBERTV2 作为检索器,优化大型语言模型(LLMs)的生成能力;

- ITER-RTGEN :使用 S-BERT 作为引导,优化 T5 生成器,以确保生成文本紧密匹配检索信息;

- SMALLCAP:将 CLIP 作为检索器,引导 GPT-2 生成精确且符合上下文的字幕。

这种方法能够确保生成器持续利用高质量的外部信息,从而提升生成内容的质量和相关性。

2)生成器引导检索器训练

在这种模式下,生成器的表现和需求影响检索器的选择过程。例如:

- DKRR:利用生成器的注意力权重来微调检索器,提高其选择相关信息的能力;

- AAR:使用较小的语言模型生成监督信号,引导检索器训练,以优化检索的准确性;

- RA-DIT:先微调大模型,再训练检索器,以确保二者更好地协同工作;

- UPRISE:使用冻结的大型语言模型(LLM)来引导提示词检索器的优化,提高其检索效率。

这种双向优化机制确保检索器能够与生成器协同进化,使 RAG 系统更加紧密结合、更加高效。

1.1.3 协同训练(Collaborative Training)

协同优化训练采用联合优化策略,同时优化检索器和生成器,以实现整体系统性能的最优提升。这种方法能够确保一个组件的改进能够增强另一个组件,从而最大化整个 RAG 系统的能力。

例如:使用联合训练范式,并结合最大内积搜索(MIPS),优化检索过程。

这种训练方法使检索器能够在生成器的反馈下逐步提升其相关性评分,同时生成器也能够更好地利用检索信息,最终形成更强大、适应性更强的 RAG 系统,使其能够更精准、流畅地处理各种任务和输入场景。

1.2 多模态 RAG

多模态 RAG 通过引入图像、音频、视频等多种模态

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?