基于Octave/Matlab的梯度下降算法——单变量线性回归问题的编程实现(吴恩达机器学习)

本实验基于吴恩达老师的机器学习课程课后作业,并进行了实现,理解和再整理。

梯度下降算法的基本思想

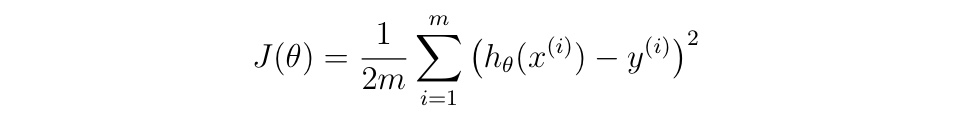

代价函数表达式:

J用以表示回归函数与实例之间偏差程度。

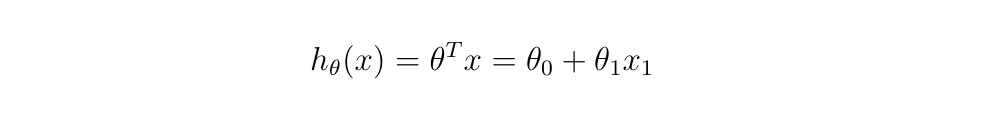

而在编程中的一大思想是实现向量化,即用向量和矩阵的相乘来实现基本计算。

例如模拟的线性回归方程就可以用theta矩阵的转置和X矩阵相乘来表示。

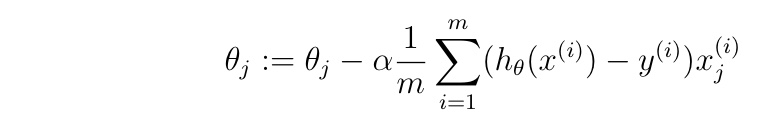

梯度下降算法的核心在于对于回归方程中参数的“同时”更新,用下式来不断逼近可以让J函数值最小的theta值。

以上就是梯度下降算法的最基础原理,如有不甚清楚的部分可以参考吴恩达老师的机器学习网课进行深入理解。

算法实现

本实验代码是在吴恩达老师的课程资料基础上进行的简化和汉化注释的编译

main函数

clear;close all;clc;

%数据提取部分

data = load('ex1data1.txt'); %数据文件的读入

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1342

1342

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?