F.softmax()就是softmax函数。

import torch

import torch.nn.functional as F

x = torch.rand(1,3,2)#1个3x2大小的矩阵

y = torch.rand(1,2,4)#1个2x4大小的矩阵

z = torch.bmm(x,y)

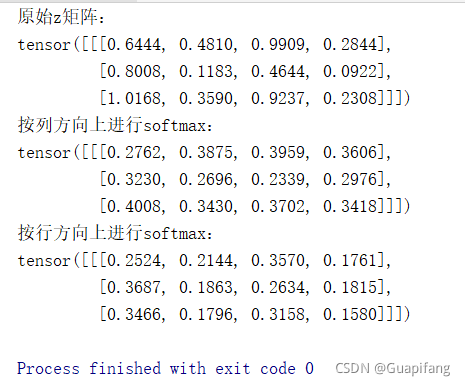

print('原始z矩阵:')

print(z)

print('按列方向上进行softmax:')

print(F.softmax(z, 1))

print('按行方向上进行softmax:')

print(F.softmax(z, 2))

这篇博客介绍了PyTorch中F.softmax()函数的用法,通过两个不同维度的矩阵实例展示了如何按列和行方向进行softmax运算。文章详细解释了softmax函数在神经网络中的作用,以及如何在实践中应用该函数来处理激活值。

这篇博客介绍了PyTorch中F.softmax()函数的用法,通过两个不同维度的矩阵实例展示了如何按列和行方向进行softmax运算。文章详细解释了softmax函数在神经网络中的作用,以及如何在实践中应用该函数来处理激活值。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?