Title:TransBTS: Multimodal Brain Tumor Segmentation Using Transformer

摘要-Abstract

本文考虑的是将Transformer和CNN二者结合起来处理脑肿瘤分割任务,使网络同时兼具了Transformer和CNN的优点。

局部和全局特征对于密集预测任务非常关键,尤其对于3D医学图像分割任务来说,为了捕获局部3D上下文,编码器首先利用3D CNN来提取空间特征图,同时对输入到Transformer的特征进行全局特征建模的Token改造,解码器利用Transformer嵌入的特征来执行上采样来预测详细的分割图。

Introduction

在卷积神经网络CNN中,由于卷积核的感受野有限的,很难建立起显式的长距离关系。

本文提出的网络结构为编码器-解码器结构,编码器首先利用3D CNN提取体积空间特征并对输入的3D图像进行下采样,从而生成紧凑体积特征图,有效的捕获本地3D上下文信息,然后将每个体素重新reshape为一个Token并输入Transformer进行全局特征建模。3D CNN解码器从Transformer中获取特征嵌入并执行上采样以预测全分辨率分割图。

Method-方法

整体架构图如下所示:

网络结构的整体概述

具体而言,首先给定输入数据X,我们首先利用3D CNN生成紧凑的特征图,捕获空间和深度信息。紧接着Transformer对全局空间中的长距离依赖性进行建模,之后反复叠加上采样的卷积层,逐渐产生高分辨率的分割结果。

网络的编码器部分

本文为了解决VIT中的Transformer无法跨空间和深度维度对图像的上下文进行建模以进行体积分割这一难题.

本文通过堆叠3*3*3卷积块(Stride=2)来逐渐将输入图像编码为低分辨率高级特征表示F ∈ RK× H/8 × W/8 × D/8 (K = 128)通过这种方式丰富的局部3D上下文特征被有效的嵌入到F中。然后将F输入到Transformer编码器当中以进一步学习全局感受野的长相关性

Transformer编码器的特征嵌入

给定特征图F,为了确保每个体素的全面表示,使用线性投影(一个3*3*3的卷积层)将通道维度从128增加到512.Transformer层一般来说将序列作为输入,因此我们将空间维度和深度维度折叠成一维得到一个d*N(N=H/8 × W/8 × D/8)的特征图f,也可以看做是N个d维标记,并且为了编码在分割任务中至关重要的位置信息引入了位置编码。将位置编码和特征图相加融合从而创建了Transformer的输入变量--特征嵌入公式为:

Zo=f+PE=W*F+PE

式子中的W起到升维的作用,PE是位置编码,Zo代表的是特征嵌入

Transformer层

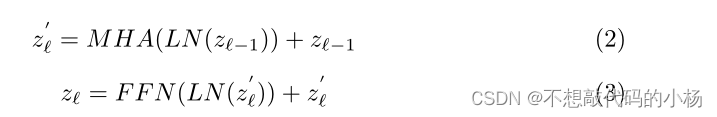

Transformer由一个多头注意力块和一个前馈网络组成。Transformer可以通过以下式子进行计算

式子中的LN表示 Layer Norm,FFN表示一个前馈神经网络。

网络解码器

为了在原始3D图像空间中生成分割结果,本文引入了3D CNN的解码器来执行特征上采样,为了适应3D CNN解码器的输入维度,将只有Transformer才能处理的序列数据投影回标准的4D特征映射。具体来说,首先将Transformer的输出序列zL ∈ Rd×N重新reshape为d*H/8 × W/8 × D/8,并且为了降低解码器的计算复杂度,采用卷积块将通道维数从d降低到K。通过这些操作,特征映射Z在特征编码部分获得了与F相同维数。

渐进式上采样

在进行完特征映射之后,将级联上采样操作和卷积块应用于Z,以逐渐恢复全分辨率分割结果R∈ RH×W×D。此外,跳跃连接用于通过级联将编码器特征与解码器对应特征融合,以获得具有更丰富空间细节的更精细分割预测结果。

总结

本文提出的新框架TransBTs有效的结合了3D CNN和Transformer来解决多模态的脑肿瘤分割问题。不仅继承了3D CNN建模局部上下文信息的优势,还利用到了Transformer学习全局语义相关性

6600

6600

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?