前言

2025年春节,DeepSeek作为国产领先的多模态大语言模型横空而出,以比OpenAI更低成本却实现与其不相上下的性能,DeepSeek支持复杂的推理任务和多轮对话。但是目前网页版访问人数过多,导致许多小伙伴一天问一次问题就服务器繁忙了。本地部署DeepSeek就能很好解决这个问题,因为他利用的是本地电脑的GPU资源进行处理。本教程将指导完成从环境准备到实际运行的完整本地部署流程,适用于开发测试与生产环境。

https://ollama.zhike.in/

1. 下载 ollama

首先进入 ollama 官网 https://ollama.com/,点击DOWNLOAD下载。

如果有的小伙伴下载速度过慢,可以在国内加速下载网站https://ollama.zhike.in/下载。

2. 安装 ollama

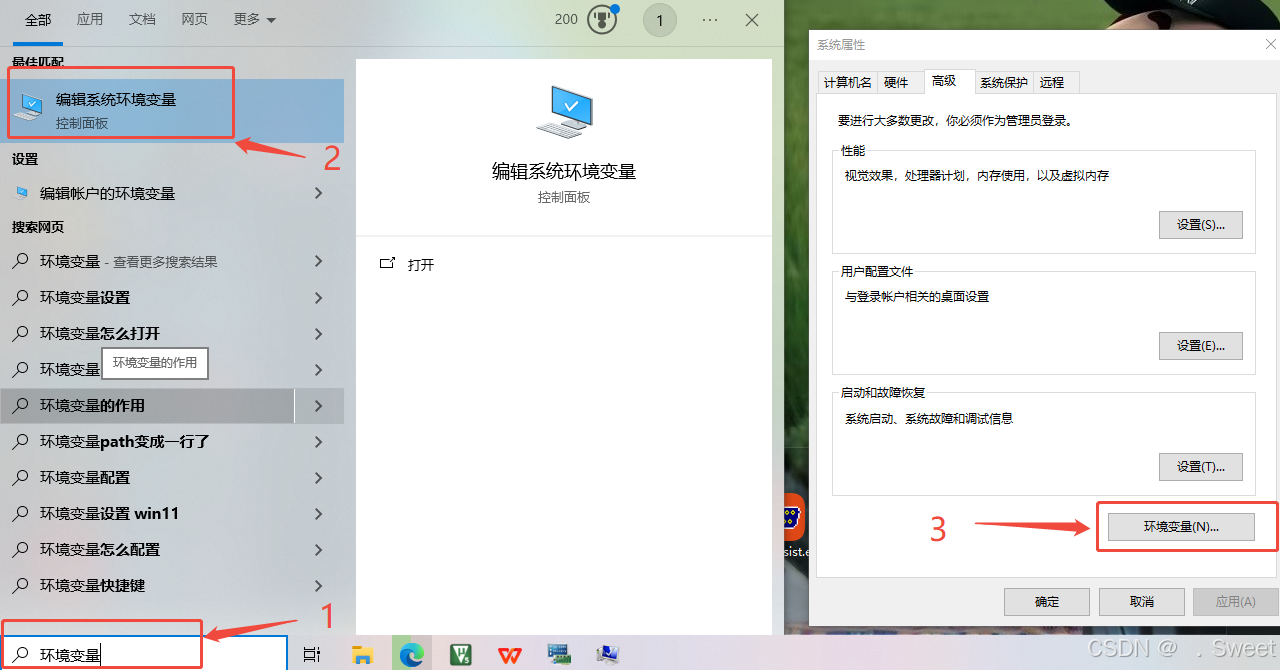

下载完后安装默认会安装到C盘,且后续安装大模型(大约几个G)也会安装到ollama所在的C盘目录下,如果是C盘内存很够或者硬盘土豪,任性,那就忽略这一步。否则,在下载安装完ollama后,将C:\Users\XX\AppData\Local\Programs\Ollama这个文件夹移动到D盘,例如改为D:\Ollama,并在D:\Ollama下新建一个models文件夹用于存储大模型文件。然后,双击进去修改环境变量中的用户变量的Path变量,将原来的C:\Users\XX\AppData\Local\Programs\Ollama路径更新为新的位置,即D:\Ollama,这一步的作用是能够让我们后续在终端能够调用ollama的指令。

在系统变量中新建一个名为OLLAMA_MODELS的变量,设置其值为模型文件的新位置,例如D:\Ollama\models。

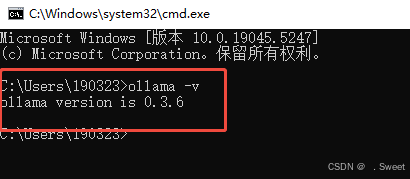

完成以上步骤后,使用win+r,输入cmd打开终端,尝试输入ollama -v,如果能显示ollama版本号,那说明文件转移到D盘成功!可以把C盘的Ollama相关文件删除了节省内存。否则就要继续检查上面的步骤是否异常。

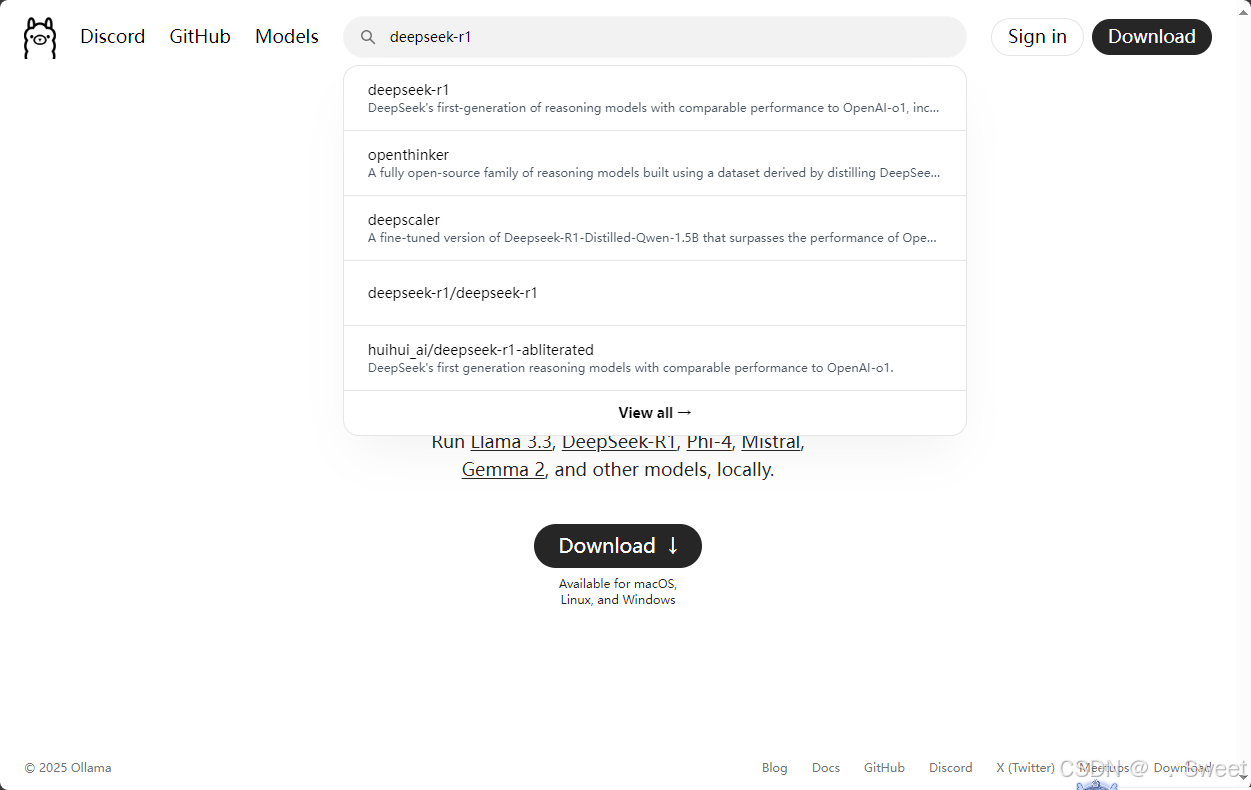

3. 部署 deepseek-r1

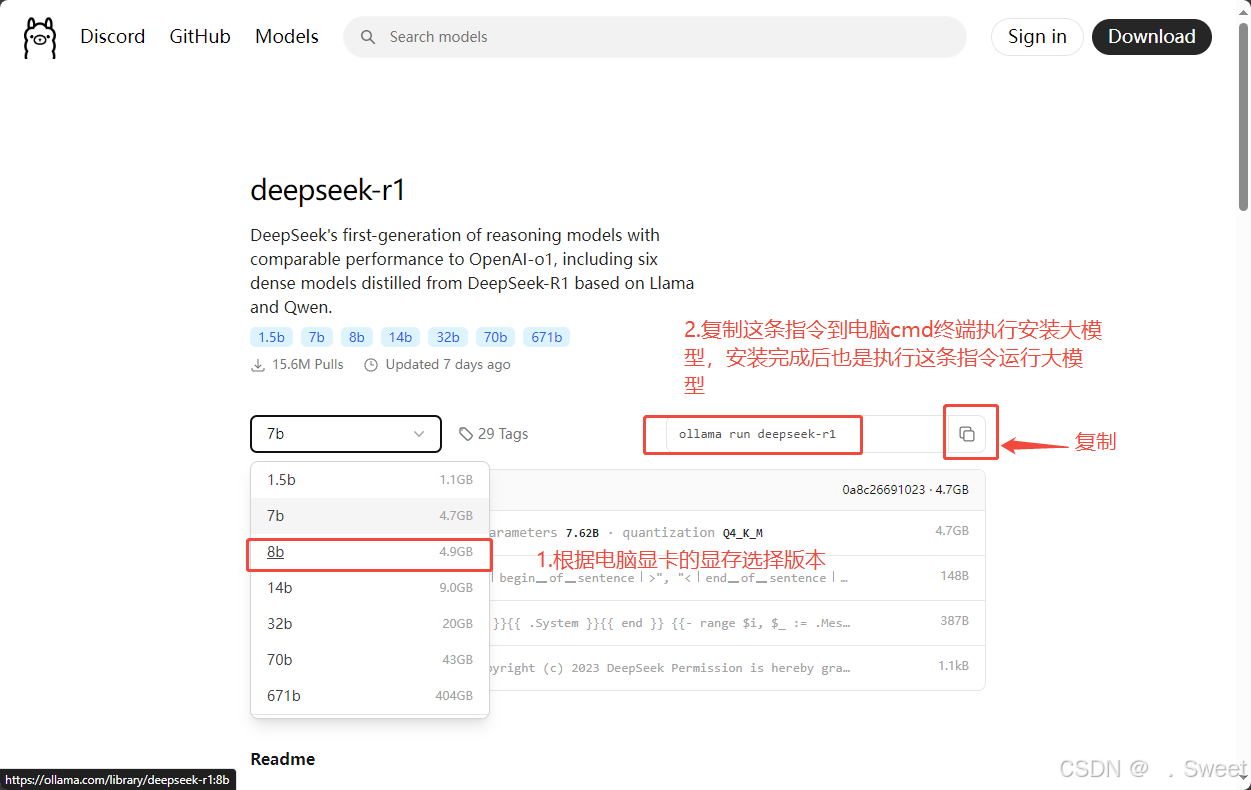

打开ollama官网,在上面搜索框输入deepseek-r1并点击

选择合适自己的版本进行安装,我的电脑室4060,显存为8G,只能选择8b版本,14b超过了我的显存,官方满血版是671b版本。

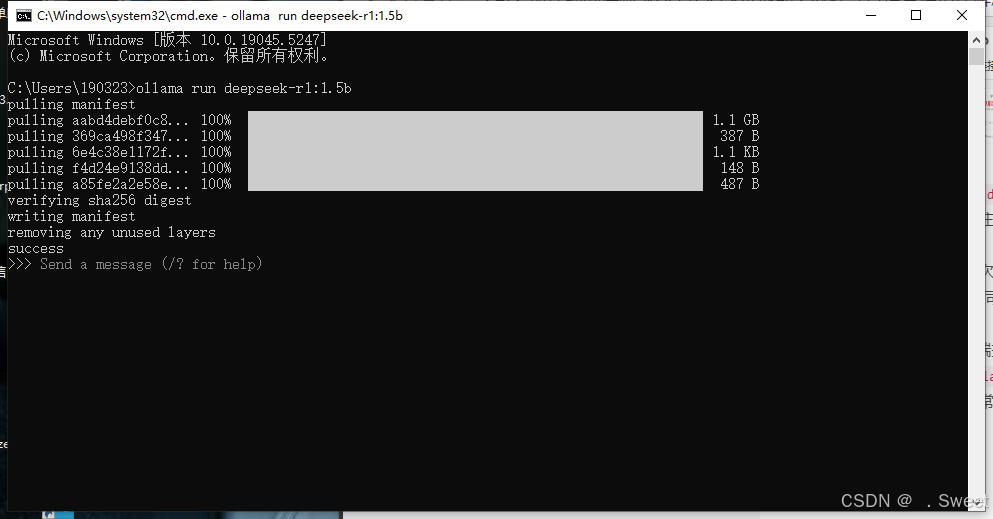

复制安装指令ollama run deepseek-r1到电脑终端回车执行安装大模型。需要注意的是,有的小伙伴复制执行后,会弹出报错内容,一般是因为网络波动问题,这时候只需多执行几次ollama run deepseek-r1就行,还有个问题是,有的同学下载到最后大概90%多的时候,下载速度会变慢,原本几十MB/s都会变成几十kb/s,这时只需要在终端按下ctrl+c取消当前安装,然后再次执行安装指令ollama run deepseek-r1接着上次的安装就能继续用正常速度下载了。

下载完成后就直接可以在终端和它聊天了!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?