Kafka启动成功且运行程序无报错,无法消费数据,即外网无法连接Kafka的消费者或生产者

sparkStreaming消费kafka中的数据,得不到数据以及无报错信息,找错误如下

首先检查一下,Kafka的消费者和Kafka生产者的Topic是否对应错误,以及其他错误

开启kafka使用下面指令,看kafka是否有错误

/opt/module/kafka/bin/kafka-server-start.sh /opt/module/kafka/config/server.properties

注意程序控制台是否出现错误

以及log4j.properties文件的配置

解决办法(无报错解决办法)

进入zookeeper的bin目录

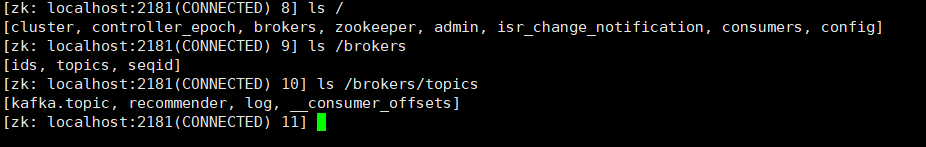

./zkCli.sh

删除zookeeper的kafka元数据

删除指令

rmr /brokers/topics

在kafka的conf的server.properties文件里面加入一下配置,(其中192.168.88.107是自己的对外地址)

###添加一下内容,xxxxxx为虚拟机IP(列入192.168.88.107)

listeners=PLAINTEXT://xxxxx:9092

###添加一下内容,xxxxxx为虚拟机IP(列入192.168.88.107)

advertised.listeners=PLAINTEXT://xxxxxxx:9092

3922

3922

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?