211为什么Lasso可以筛选变量?

L1是模型各个参数的绝对值之和∣w⃗∣0,那么对目标函数经过优化后,一部分参数会变为0,另一部分参数为非零实值。这样就起到了筛选特征的作用。

212L1正则化为什么能缓解过拟合

过拟合是由于特征过多,L1可以筛选特征,所以能够缓解过拟合

213BN+CONV融合公式及作用

网络完成训练后,在inference阶段,为了加速运算,通常将卷积层和BN层进行融合

214 初始化方法

• 全0初始化,

就是将所有权重置0。当然是不能这样的,神经网络通过梯度更新参数,参数都是0,梯度也就是0,神经网络就停止学习了。

• 随机初始化

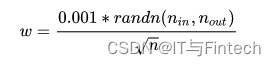

将参数随机化,不过随机参数服从高斯分布或均匀分布。高斯分布均值为0,方差为1。0.001为控制因子,这样使得参数期望尽量接近0

Xavier初始化

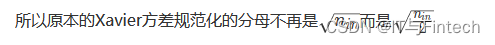

随机初始化没有控制方差,所以对于深层网络而言,随机初始化方法依然可能失效。理想的参数初始化还得控制方差,对w进行一个规范化。“Xavier初始化”维持了输入输出数据分布方差一致性。

He初始化

He初始化

对于非线性激活函数ReLU,“Xavi

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9624

9624

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?